Pytanie 1

Która topologia fizyczna umożliwia nadmiarowe połączenia pomiędzy urządzeniami w sieci?

Wynik: 26/40 punktów (65,0%)

Wymagane minimum: 20 punktów (50%)

Która topologia fizyczna umożliwia nadmiarowe połączenia pomiędzy urządzeniami w sieci?

Technologia procesorów z serii Intel Core, wykorzystywana w układach i5, i7 oraz i9, umożliwiająca podniesienie częstotliwości w sytuacji, gdy komputer potrzebuje większej mocy obliczeniowej, to

Jakie środowisko powinien wybrać administrator sieci, aby zainstalować serwer dla stron WWW w systemie Linux?

Aby przygotować ikony zaprezentowane na załączonym obrazku do wyświetlania na Pasku zadań w systemie Windows, należy skonfigurować

Recykling można zdefiniować jako

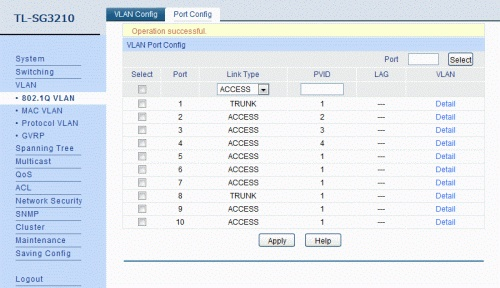

Na ilustracji przedstawiono konfigurację przełącznika z utworzonymi sieciami VLAN. Którymi portami można przesyłać oznaczone ramki z różnych sieci VLAN?

Serwer DNS pełni rolę

Na ilustracji zobrazowano

Aby przywrócić dane, które zostały usunięte za pomocą kombinacji klawiszy Shift + Delete, co należy zrobić?

Administrator systemu Linux wydał polecenie mount /dev/sda2 /mnt/flash . Spowoduje ono

Jaką cechę posiada przełącznik sieciowy?

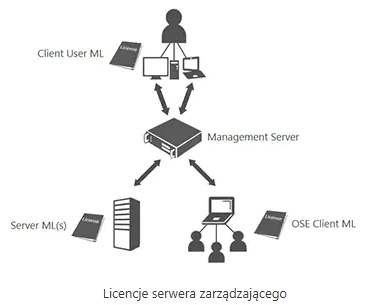

Wskaż model licencjonowania serwera zarządzającego (Management Serwer), oferowanego firmom przez Microsoft, którego schemat przedstawiono na ilustracji.

Użytkownicy w sieciach bezprzewodowych mogą być uwierzytelniani zdalnie przy pomocy usługi

Najskuteczniejszym sposobem na codzienną archiwizację pojedynczego pliku o objętości 4,8 GB, na jednym komputerze bez dostępu do sieci, jest

Program do odzyskiwania danych, stosowany w warunkach domowych, umożliwia przywrócenie danych z dysku twardego w sytuacji

Które z poniższych urządzeń jest przykładem urządzenia peryferyjnego wejściowego?

Zgodnie z aktualnymi przepisami BHP, odległość oczu od ekranu monitora powinna wynosić

Jakie zastosowanie ma narzędzie tracert w systemach operacyjnych rodziny Windows?

W nowoczesnych panelach dotykowych prawidłowe działanie wyświetlacza zapewnia mechanizm rozpoznający zmianę

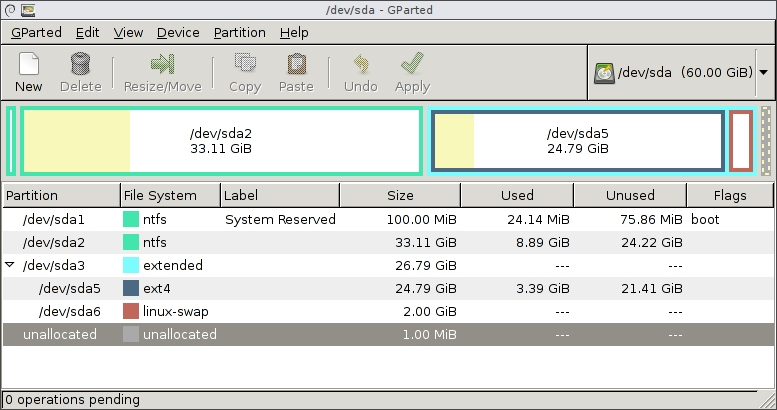

Badanie danych przedstawionych przez program umożliwia dojście do wniosku, że

Który z standardów korzysta z częstotliwości 5 GHz?

W systemie SI jednostką do mierzenia napięcia jest

Czym jest prefetching?

Protokół ARP (Address Resolution Protocol) służy do konwersji adresu IP na

Emisja dźwięków: jednego długiego oraz dwóch krótkich przez BIOS firmy AMI wskazuje na

Jakie polecenie pozwala na uzyskanie informacji o bieżących połączeniach TCP oraz o portach źródłowych i docelowych?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Ile par kabli jest używanych w standardzie 100Base-TX do obustronnej transmisji danych?

Pierwsze trzy bity adresu IP w formacie binarnym mają wartość 010. Jaką klasę reprezentuje ten adres?

Która z wymienionych czynności konserwacyjnych drukarek dotyczy tylko drukarki laserowej?

W systemie Linux program, który odpowiada aplikacji chkdsk z Windows, to

Osoba korzystająca z komputera publikuje w sieci Internet pliki, które posiada. Prawa autorskie zostaną złamane, gdy udostępni

NIEWŁAŚCIWE podłączenie taśmy sygnałowej do napędu dyskietek skutkuje

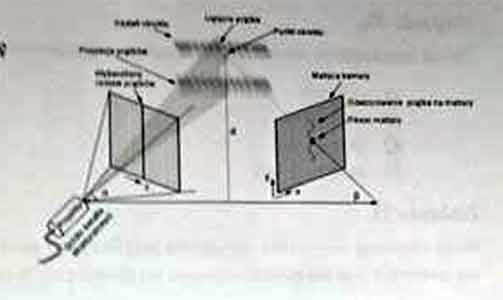

Zamieszczony poniżej diagram ilustruje zasadę działania skanera

W procedurze Power-On Self-Test w pierwszej kolejności wykonywane jest sprawdzanie

Zasadniczym sposobem zabezpieczenia danych przechowywanych na serwerze jest

Jakie polecenie należy zastosować w systemach operacyjnych z rodziny Windows, aby ustawić plik w trybie tylko do odczytu?

Dysk z systemem plików FAT32, na którym regularnie przeprowadza się działania usuwania starych plików oraz dodawania nowych plików, doświadcza

Jak należy rozmieszczać gniazda komputerowe RJ45 w odniesieniu do przestrzeni biurowej zgodnie z normą PN-EN 50174?

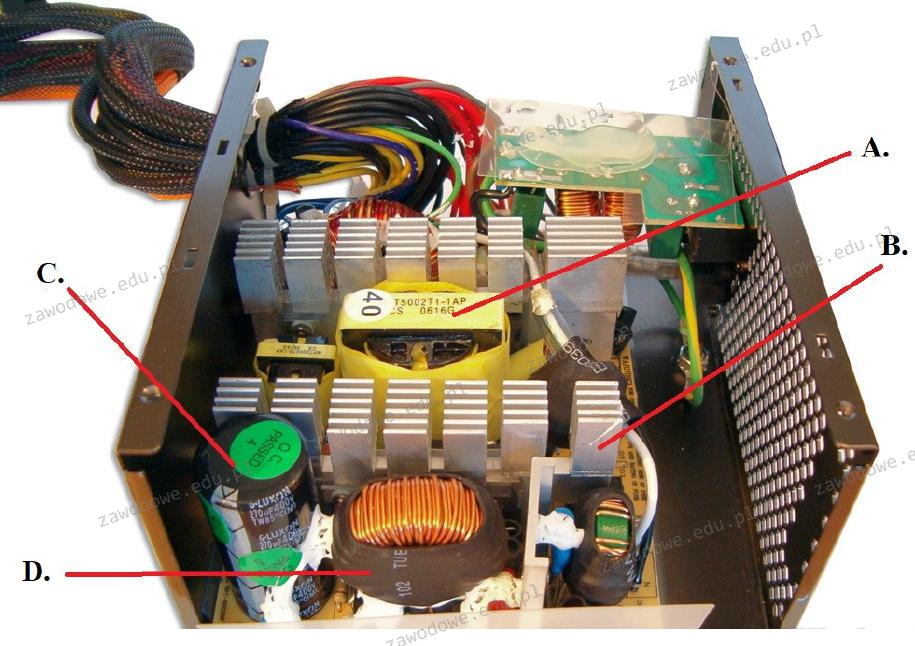

W przedstawionym zasilaczu transformator impulsowy oznaczono symbolami