Pytanie 1

W systemie Windows XP, aby zmienić typ systemu plików z FAT32 na NTFS, należy użyć programu

Wynik: 16/40 punktów (40,0%)

Wymagane minimum: 20 punktów (50%)

W systemie Windows XP, aby zmienić typ systemu plików z FAT32 na NTFS, należy użyć programu

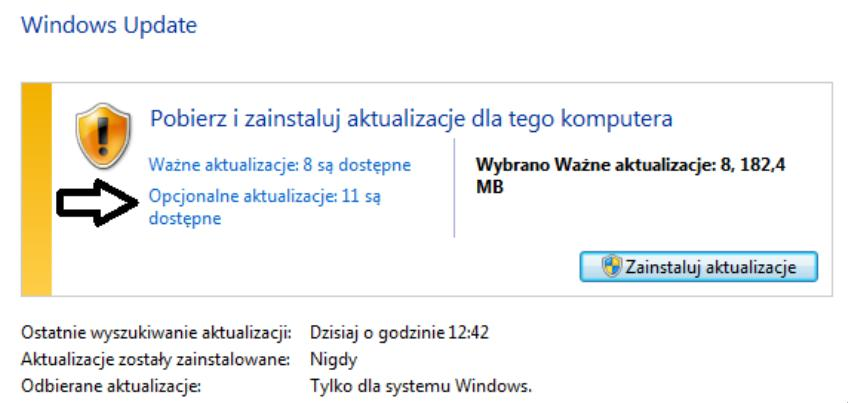

Jeżeli użytkownik zdecyduje się na pozycję wskazaną przez strzałkę, uzyska możliwość zainstalowania aktualizacji?

W systemie Windows dany użytkownik oraz wszystkie grupy, do których on przynależy, posiadają uprawnienia "odczyt" do folderu XYZ. Czy ten użytkownik będzie mógł zrealizować operacje

Która z usług musi być aktywna na ruterze, aby mógł on modyfikować adresy IP źródłowe oraz docelowe podczas przekazywania pakietów pomiędzy różnymi sieciami?

Jaki jest standardowy port dla serwera HTTP?

Samodzielną strukturą sieci WLAN jest

Które polecenie w systemie Windows Server 2008 pozwala na przekształcenie serwera w kontroler domeny?

Po wydaniu polecenia route skonfigurowano ```route add 192.168.35.0 MASK 255.255.255.0 192.168.0.2```

Zgodnie z aktualnymi przepisami BHP, odległość oczu od ekranu monitora powinna wynosić

Wskaż urządzenie wyjścia.

Co oznacza standard 100Base-T?

Według normy JEDEC, napięcie zasilające dla modułów pamięci RAM DDR3L wynosi

Który z podanych adresów IPv4 stanowi adres publiczny?

Jaka jest maska dla adresu IP 192.168.1.10/8?

Ile wyniesie całkowity koszt wymiany karty sieciowej w komputerze, jeżeli cena karty to 40 zł, czas pracy serwisanta wyniesie 90 minut, a koszt każdej rozpoczętej roboczogodziny to 60 zł?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Które z poniższych poleceń w systemie Linux NIE pozwala na przeprowadzenie testów diagnostycznych sprzętu komputerowego?

Jakie urządzenie w warstwie łącza danych modelu OSI analizuje adresy MAC zawarte w ramkach Ethernet i na tej podstawie decyduje o przesyłaniu sygnału pomiędzy segmentami sieci lub jego blokowaniu?

Program CHKDSK jest wykorzystywany do

Jaka jest maska podsieci dla adresu IP 217.152.128.100/25?

Jakiego rodzaju rekord jest automatycznie generowany w chwili zakupu strefy wyszukiwania do przodu w ustawieniach serwera DNS w systemach Windows Server?

Zintegrowana karta sieciowa na płycie głównej uległa awarii. Komputer nie może załadować systemu operacyjnego, ponieważ brakuje zarówno dysku twardego, jak i napędów optycznych, a system operacyjny jest uruchamiany z lokalnej sieci. W celu przywrócenia utraconej funkcjonalności, należy zainstalować w komputerze

Bezprzewodową komunikację komputerów w sieci lokalnej zapewnia

Aby zapewnić, że komputer uzyska od serwera DHCP określony adres IP, należy na serwerze zdefiniować

Jakie urządzenie sieciowe funkcjonuje w warstwie fizycznej modelu ISO/OSI, transmitując sygnał z jednego portu do wszystkich pozostałych portów?

Jakie narzędzie pozwala na zarządzanie menedżerem rozruchu w systemach Windows od wersji Vista?

Jednym z typowych symptomów mogących świadczyć o nadchodzącej awarii dysku twardego jest wystąpienie

Którego narzędzia można użyć, aby prześledzić trasę, którą pokonują pakiety w sieciach?

Jaki sprzęt powinno się wybrać do pomiarów schematu okablowania strukturalnego sieci lokalnej?

Uszkodzenie mechaniczne dysku twardego w komputerze stacjonarnym może być spowodowane

Protokół SNMP (Simple Network Management Protocol) jest wykorzystywany do

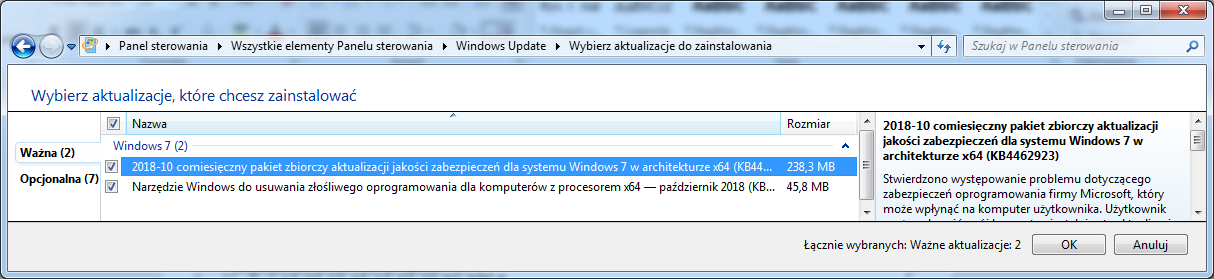

Głównie które aktualizacje zostaną zainstalowane po kliknięciu na przycisk OK prezentowany na zrzucie ekranu?

Adresy IPv6 są reprezentowane jako liczby

Który z poniższych adresów stanowi adres rozgłoszeniowy dla sieci 172.16.64.0/26?

Narzędziem do monitorowania, które umożliwia przechwytywanie, rejestrowanie oraz dekodowanie różnych pakietów sieciowych, jest

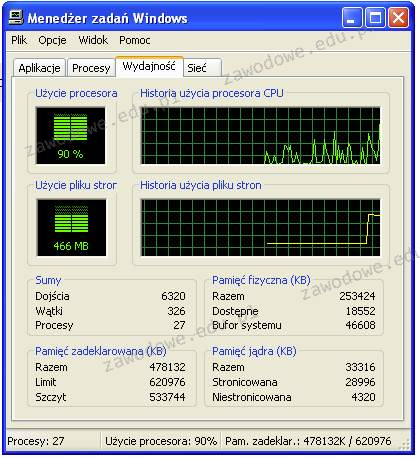

Przyglądając się przedstawionemu obrazkowi, można dostrzec, że deklarowany limit pamięci wynosi 620976 KB. Zauważamy również, że zainstalowana pamięć fizyczna w badanym systemie jest mniejsza niż pamięć zadeklarowana. Który typ pamięci wpływa na podniesienie limitu pamięci zadeklarowanej powyżej rozmiaru zainstalowanej pamięci fizycznej?

Jednym z rezultatów wykonania poniższego polecenia jest:

sudo passwd -n 1 -x 5 test

Nośniki informacji, takie jak dyski twarde, zapisują dane w jednostkach zwanych sektorami, które mają wielkość

Wskaż interfejsy płyty głównej widoczne na rysunku.

Cechą charakterystyczną transmisji w interfejsie równoległym synchronicznym jest to, że