Pytanie 1

Jakie oprogramowanie jest wykorzystywane do dynamicznej obsługi urządzeń w systemie Linux?

Wynik: 15/40 punktów (37,5%)

Wymagane minimum: 20 punktów (50%)

Jakie oprogramowanie jest wykorzystywane do dynamicznej obsługi urządzeń w systemie Linux?

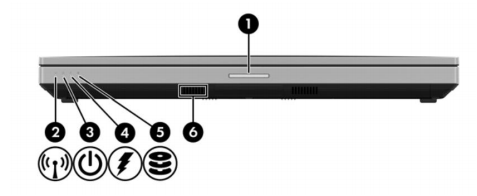

Na ilustracji widoczne jest oznaczenie sygnalizacji świetlnej w dokumentacji technicznej laptopa. Wskaż numer odpowiadający kontrolce, która zapala się podczas ładowania akumulatora?

Program typu recovery, w warunkach domowych, pozwala na odzyskanie danych z dysku twardego w przypadku

Jednym z metod ograniczenia dostępu do sieci bezprzewodowej dla osób nieuprawnionych jest

W protokole IPv4 adres broadcastowy, zapisany w formacie binarnym, bez podziału na podsieci, w sekcji przeznaczonej dla hosta zawiera

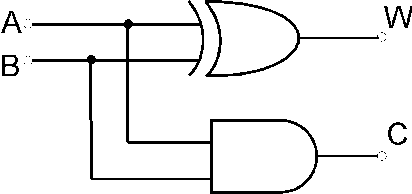

Wynikiem działania przedstawionego układu logicznego po podaniu na wejściach A i B sygnałów logicznych A=1 i B=1 są wartości logiczne:

Który adres IP reprezentuje hosta działającego w sieci o adresie 192.168.160.224/28?

Jakie urządzenie sieciowe powinno zastąpić koncentrator, aby podzielić sieć LAN na cztery odrębne domeny kolizji?

Co umożliwia zachowanie równomiernego rozkładu ciepła pomiędzy procesorem a radiatorem?

Która usługa pozwala na zdalne zainstalowanie systemu operacyjnego?

Jeśli jednostka alokacji ma 1024 bajty, to pliki podane w tabeli zajmują na dysku:

Nazwa Wielkość

Ala.exe 50B

Dom.bat 1024B

Wirus.exe 2kB

Domes.exr 350B

Aby aktywować funkcję S.M.A.R.T. dysku twardego, która odpowiada za monitorowanie i wczesne ostrzeganie przed awariami, należy skorzystać z

PCI\VEN_10EC&DEV_8168&SUBSYS_05FB1028&REV_12

Przedstawiony zapis jest

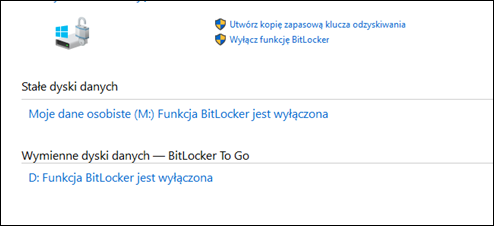

Przedstawione wbudowane narzędzie systemów Windows w wersji Enterprise lub Ultimate służy do

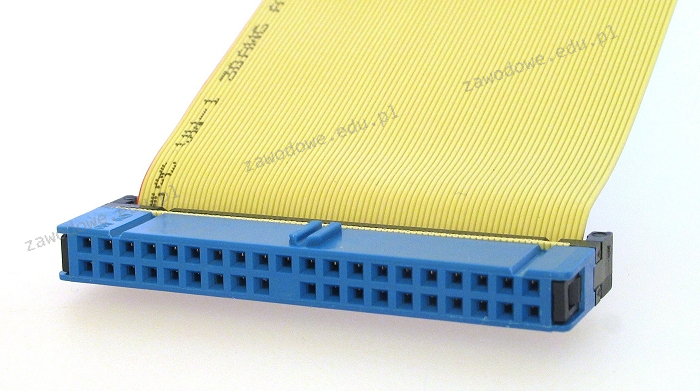

Na ilustracji przedstawiono taśmę (kabel) złącza

Aby połączyć dwa przełączniki oddalone o 200 m i osiągnąć minimalną przepustowość 200 Mbit/s, jakie rozwiązanie należy zastosować?

Aby sprawdzić minimalny czas ważności hasła w systemie Windows, stosuje się polecenie

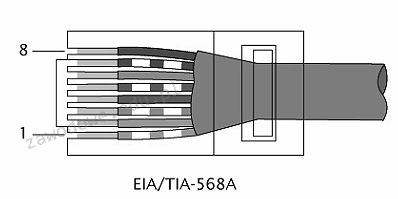

W technologii Ethernet 100BaseTX do przesyłania danych wykorzystywane są żyły kabla UTP podłączone do pinów

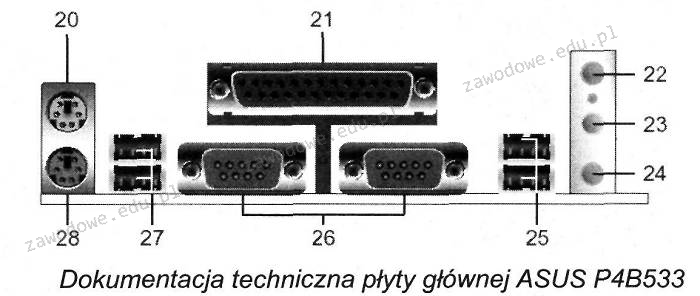

Na zaprezentowanej płycie głównej komputera złącza oznaczono cyframi 25 i 27

Domyślny port, na którym działa usługa "Pulpit zdalny", to

W jakim modelu płyty głównej można zainstalować procesor o wymienionych specyfikacjach?

| Intel Core i7-4790 3,6 GHz 8MB cache s. 1150 Box |

Który standard Gigabit Ethernet pozwala na tworzenie segmentów sieci o długości 550 m lub 5000 m przy prędkości transmisji 1 Gb/s?

Standard zwany IEEE 802.11, używany w lokalnych sieciach komputerowych, określa typ sieci:

Komputer zainstalowany w domenie Active Directory nie jest w stanie nawiązać połączenia z kontrolerem domeny, na którym znajduje się profil użytkownika. Jaki rodzaj profilu użytkownika zostanie stworzony na tym urządzeniu?

Które polecenie systemu Linux służy do wyświetlenia informacji o zainstalowanych podzespołach?

Aby zmierzyć moc zużywaną przez komputer, należy zastosować

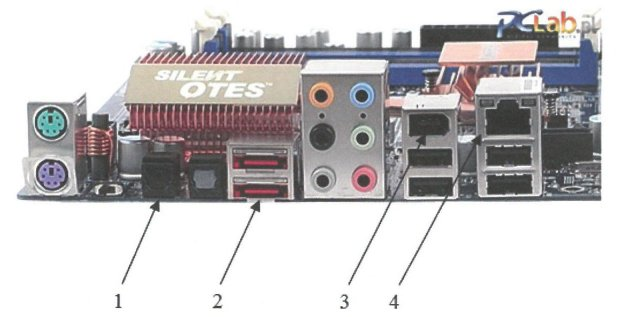

Który z portów na pokazanej płycie głównej pozwala na podłączenie zewnętrznego dysku za pośrednictwem interfejsu e-SATA?

Jakie narzędzie jest używane do diagnozowania łączności między hostami w systemie Windows?

Diody LED RGB pełnią funkcję źródła światła w skanerach

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Jaki protokół sygnalizacyjny jest wykorzystywany w technologii VoIP?

Industry Standard Architecture to standard magistrali, który określa, że szerokość szyny danych wynosi:

Narzędzia do dostosowywania oraz Unity Tweak Tool to aplikacje w systemie Linux przeznaczone do

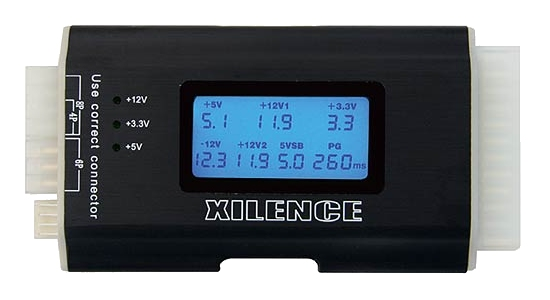

Przy użyciu urządzenia przedstawionego na ilustracji można sprawdzić działanie

W jakim oprogramowaniu trzeba zmienić konfigurację, aby użytkownik mógł wybrać z listy i uruchomić jeden z różnych systemów operacyjnych zainstalowanych na swoim komputerze?

Thunderbolt to interfejs

Aby osiągnąć prędkość przesyłania danych 100 Mbps w sieci lokalnej, wykorzystano karty sieciowe działające w standardzie Fast Ethernet, kabel typu UTP o odpowiedniej kategorii oraz przełącznik (switch) zgodny z tym standardem. Taka sieć jest skonstruowana w topologii

Aktywacja opcji OCR podczas ustawiania skanera umożliwia

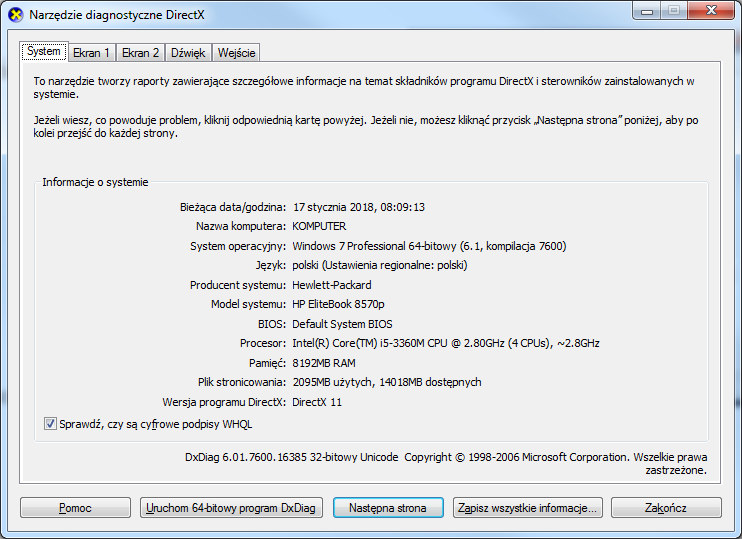

Aby uruchomić przedstawione narzędzie systemu Windows, należy użyć polecenia

Którego urządzenia z zakresu sieci komputerowych dotyczy symbol przedstawiony na ilustracji?