Pytanie 1

NAT64 (Network Address Translation 64) to proces, który przekształca adresy

Wynik: 16/40 punktów (40,0%)

Wymagane minimum: 20 punktów (50%)

NAT64 (Network Address Translation 64) to proces, który przekształca adresy

Norma EN 50167 odnosi się do rodzaju okablowania

Które z poniższych poleceń w systemie Linux NIE pozwala na przeprowadzenie testów diagnostycznych sprzętu komputerowego?

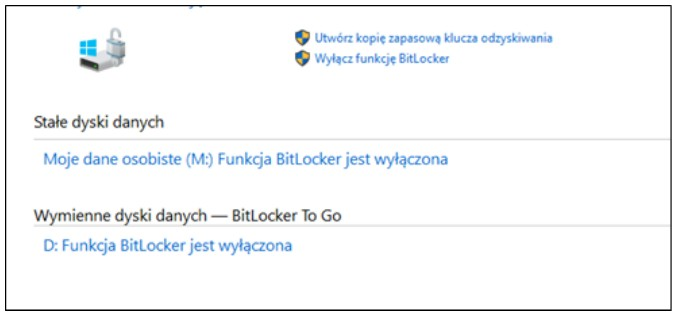

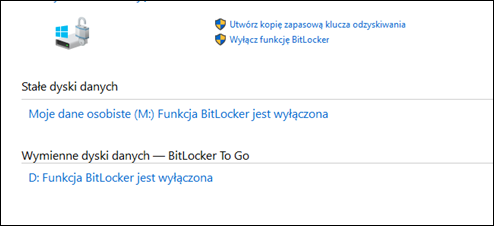

Narzędzie wbudowane w systemy Windows w edycji Enterprise lub Ultimate ma na celu

Przedstawione narzędzie jest przeznaczone do

Jaki parametr powinien być użyty do wywołania komendy netstat, aby pokazać statystykę interfejsu sieciowego (ilość wysłanych oraz odebranych bajtów i pakietów)?

Jak nazywa się współpracujące z monitorami CRT urządzenie wskazujące z końcówką wyposażoną w światłoczuły element, która poprzez dotknięcie ekranu monitora powoduje przesłanie sygnału do komputera, umożliwiając w ten sposób lokalizację kursora?

Przedstawione wbudowane narzędzie systemów Windows w wersji Enterprise lub Ultimate służy do

Jakiego protokołu używa polecenie ping?

Jaką funkcję pełni protokół ARP (Address Resolution Protocol)?

Jakie parametry można śledzić w przypadku urządzenia przy pomocy S.M.A.R.T.?

Które z urządzeń nie powinno być serwisowane podczas korzystania z urządzeń antystatycznych?

Z jakiej puli adresowej usługa APIPA przypisuje adres IP dla komputera z systemem Windows, jeśli w sieci nie funkcjonuje serwer DHCP?

Którego wbudowanego narzędzia w systemie Windows 8 Pro można użyć do szyfrowania danych?

Jakie polecenie należy wykorzystać, aby zmienić właściciela pliku w systemie Linux?

W systemie Linux można uzyskać listę wszystkich założonych kont użytkowników, wykorzystując polecenie

W których nośnikach pamięci masowej jedną z najczęstszych przyczyn uszkodzeń jest uszkodzenie powierzchni?

Klient przyniósł do serwisu uszkodzony sprzęt komputerowy. W trakcie procedury odbioru sprzętu, przed rozpoczęciem jego naprawy, serwisant powinien

Aby zweryfikować w systemie Windows działanie nowo zainstalowanej drukarki, co należy zrobić?

Równoległy interfejs, w którym magistrala składa się z 8 linii danych, 4 linii sterujących oraz 5 linii statusowych, nie zawiera linii zasilających i umożliwia transmisję na odległość do 5 metrów, pod warunkiem, że przewody sygnałowe są skręcane z przewodami masy; w przeciwnym razie limit wynosi 2 metry, nazywa się

Jakie oprogramowanie jest zabronione do użytku na sprzęcie instytucji rządowych lub edukacyjnych?

Literowym symbolem P oznacza się

Jakie urządzenie pozwala na połączenie lokalnej sieci komputerowej z Internetem?

Zamianę uszkodzonych kondensatorów w karcie graficznej umożliwi

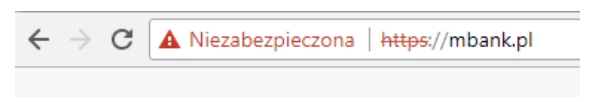

Zidentyfikuj powód pojawienia się komunikatu, który został pokazany na ilustracji

W systemie Windows przypadkowo usunięto konto użytkownika, ale katalog domowy pozostał. Czy możliwe jest odzyskanie niezaszyfrowanych danych z katalogu domowego tego użytkownika?

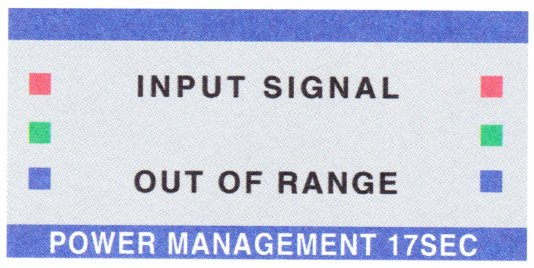

Gdy podłączono sprawny monitor do innego komputera, na ekranie pojawił się komunikat widoczny na rysunku. Co mogło spowodować ten komunikat?

Jak nazywa się jednostka danych PDU w warstwie sieciowej modelu ISO/OSI?

Do efektywnego zrealizowania macierzy RAID 1 wymagane jest minimum

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Adres MAC (Medium Access Control Address) stanowi fizyczny identyfikator interfejsu sieciowego Ethernet w obrębie modelu OSI

Licencja na Office 365 PL Personal (1 stanowisko, subskrypcja na 1 rok) ESD jest przypisana do

Analizując ruch w sieci, zauważono, że na adres serwera kierowano tysiące zapytań DNS na sekundę z różnych adresów IP, co doprowadziło do zawieszenia systemu operacyjnego. Przyczyną tego zjawiska był atak typu

Jakie jest kluczowe zadanie protokołu ICMP?

W jakiej logicznej topologii funkcjonuje sieć Ethernet?

Jaką maksymalną prędkość transferu danych pozwala osiągnąć interfejs USB 3.0?

Aby wymusić na użytkownikach lokalnych systemów z rodziny Windows Server regularną zmianę hasła oraz stosowanie haseł o odpowiedniej długości i spełniających wymagania dotyczące złożoności, należy ustawić

W systemie Linux do obsługi tablic partycji można zastosować komendę

Na którym z zewnętrznych nośników danych nie dojdzie do przeniknięcia wirusa podczas przeglądania jego zawartości?

Wykorzystanie polecenia net accounts w konsoli systemu Windows, które ustawia maksymalny okres ważności hasła, wymaga zastosowania opcji