Pytanie 1

Jakie wiązki promieniowania emituje medyczny akcelerator liniowy?

Wynik: 10/40 punktów (25,0%)

Wymagane minimum: 20 punktów (50%)

Jakie wiązki promieniowania emituje medyczny akcelerator liniowy?

Wskazaniem do wykonania przesiewowego badania densytometrycznego jest

W badaniu EEG w systemie „10-20” elektrody w okolicy skroniowej oznaczone są literą

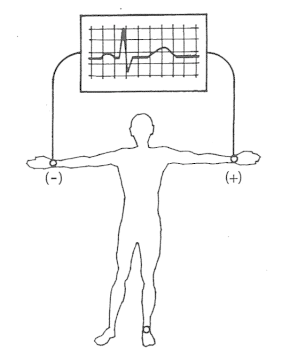

Które odprowadzenie elektrokardiograficzne przedstawiono na ilustracji?

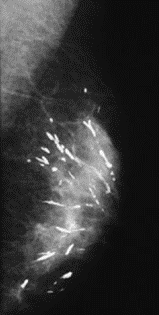

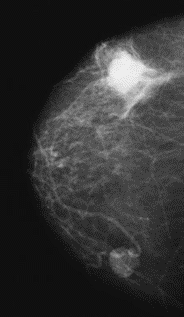

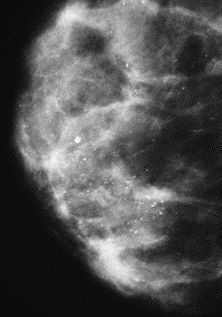

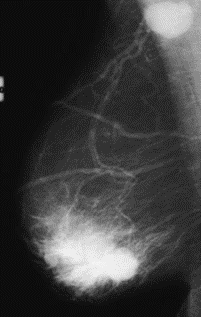

Na którym obrazie rentgenowskim sutka uwidoczniono zmianę patologiczną w obrębie węzłów chłonnych?

Brachyterapia polegająca na wielokrotnym wsuwaniu i wysuwaniu źródła promieniowania do tego samego aplikatora nosi nazwę

Która składowa prawidłowej krzywej EKG odpowiada powolnej repolaryzacji komór mięśnia sercowego?

Obszary napromieniania w technice IMRT w trakcie wykonywania zabiegu radioterapeutycznego wyznacza

Na obrazie ultrasonograficznym jamy brzusznej uwidoczniono

Parametrem krwi, który powinien zostać oznaczony u pacjenta przed wykonaniem badania MR z kontrastem jest

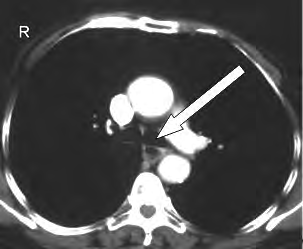

Na obrazie TK klatki piersiowej w przekroju poprzecznym strzałką oznaczono

Który narząd widoczny jest na wydruku badania ultrasonograficznego?

Po podaniu kontrastu obraz zmian nowotworowych w badaniu MR najlepiej uwidacznia się w sekwencji

Fistulografia to badanie kontrastowe

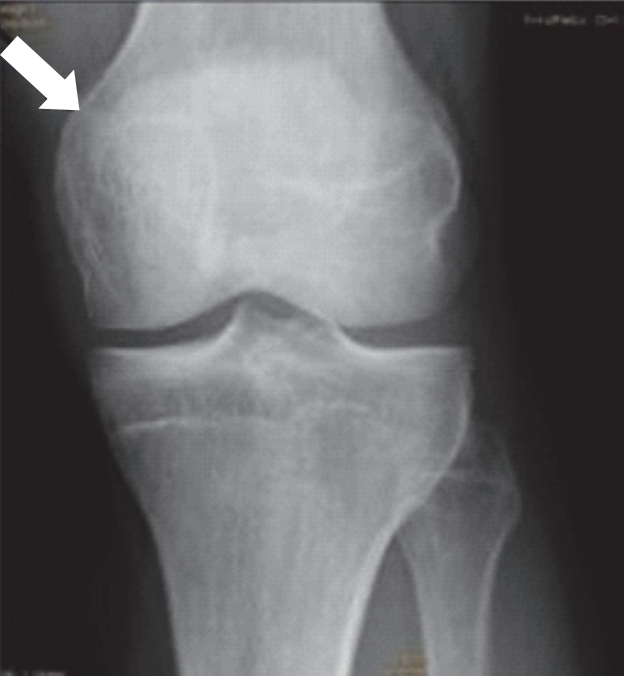

Którą strukturę anatomiczną zaznaczono na radiogramie stawu kolanowego?

Który parametr ekspozycji ma decydujący wpływ na kontrast obrazu rentgenowskiego?

Kolonoskopia to badanie, które ma na celu ocenę błony śluzowej

Podczas badania gammakamerą źródłem promieniowania jest

Który radioizotop jest emiterem promieniowania alfa?

Podczas wykonywania zdjęcia rentgenowskiego lewobocznego czaszki promień centralny powinien przebiegać

Czas repetycji w obrazowaniu metodą rezonansu magnetycznego to

W radiografii mianem SID określa się

Osłony na gonady dla osób dorosłych powinny posiadać równoważnik osłabienia promieniowania nie mniejszy niż

Teleradioterapia 4D na etapie planowania leczenia wykorzystuje obrazy

Na obrazie TK nadgarstka uwidocznione jest złamanie kości

Którym skrótem oznacza się tomografię komputerową wysokiej rozdzielczości?

Na obrazie TK kręgosłupa strzałką wskazano wyrostek

Która sekwencja w obrazowaniu MR jest stosowana do uwidocznienia naczyń krwionośnych?

Zgodnie z obowiązującymi przepisami powierzchnia gabinetu rentgenowskiego, w którym jest zainstalowany zestaw rentgenowski do badań naczyniowych, powinna wynosić

Przedstawiony obraz został zarejestrowany podczas wykonywania

W badaniu cystografii wstępującej środek kontrastowy należy podać

W radioterapii hadronowej leczenie odbywa się przy użyciu

Wskaż osłonę radiologiczną, która jest stosowana w pracowniach radiodiagnostyki stomatologicznej.

Odprowadzenie EKG mierzące różnicę potencjałów między lewym podudziem a prawym przedramieniem oznacza się jako

W jaki sposób należy ustawić promień centralny w stosunku do ramienia i przedramienia, by wykonać zdjęcie rentgenograficzne stawu łokciowego u pacjenta z przykurczem?

W jakiej projekcji i pod jakim kątem padania promienia centralnego został wykonany radiogram obojczyka?

Do pomiaru dawek indywidualnych u osób narażonych zawodowo na promieniowanie rentgenowskie są stosowane

Do prób aktywacyjnych stosowanych w badaniu EEG zalicza się

Odprowadzenie II rejestruje różnicę potencjałów między

Audiometria impedancyjna polega na pomiarze