Pytanie 1

Karta sieciowa przedstawiona na ilustracji jest w stanie przesyłać dane z maksymalną szybkością

Wynik: 30/40 punktów (75,0%)

Wymagane minimum: 20 punktów (50%)

Karta sieciowa przedstawiona na ilustracji jest w stanie przesyłać dane z maksymalną szybkością

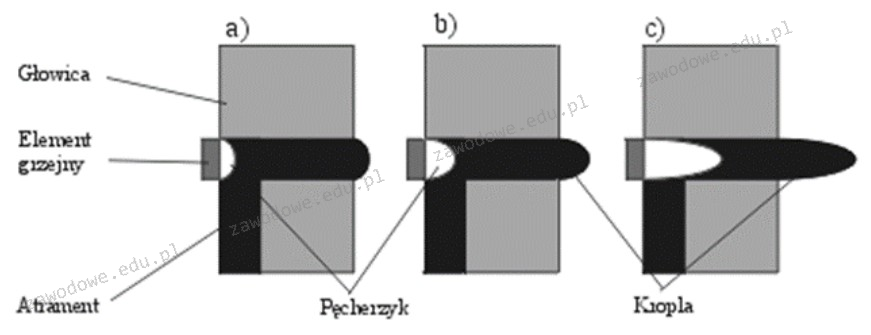

Rysunek obrazuje zasadę działania drukarki

Jakie narzędzie jest używane do zakończenia skrętki wtykiem 8P8C?

Jakie jest kluczowe zadanie protokołu ICMP?

Jakie zastosowanie ma oprogramowanie Microsoft Hyper-V?

Do stworzenia projektu sieci komputerowej dla obiektu szkolnego najlepiej użyć edytora grafiki wektorowej, którym jest oprogramowanie

Wyświetlony stan ekranu terminala został uzyskany podczas testu realizowanego w środowisku Windows. Techniczny pracownik zdobył w ten sposób informacje o:

Maksymalna długość łącza światłowodowego używanego do przesyłania danych w standardzie 10GBASE-SR wynosi

Jaki system operacyjny funkcjonuje w trybie tekstowym i umożliwia uruchomienie środowiska graficznego KDE?

Jaki rodzaj portu może być wykorzystany do podłączenia zewnętrznego dysku do laptopa?

Dysk twardy podczas pracy stuka i można zaobserwować bardzo powolne uruchamianie systemu oraz odczytywanie danych. Aby naprawić tę usterkę, po zabezpieczeniu danych na nośniku zewnętrznym należy

Jakie narzędzie wraz z odpowiednimi parametrami należy zastosować w systemie Windows, aby uzyskać przedstawione informacje o dysku twardym?

ST9500420AS Identyfikator dysku : A67B7C06 Typ : ATA Stan : Online Ścieżka : 0 Element docelowy : 0 Identyfikator jednostki LUN: 0 Ścieżka lokalizacji : PCIROOT(0)#ATA(C00T00L00) Bieżący stan tylko do odczytu : Nie Tylko do odczytu: Nie Dysk rozruchowy : Tak Dysk plików stronicowania: Tak Dysk plików hibernacji: Nie Dysk zrzutów awaryjnych: Tak Dysk klastrowany: Nie Wolumin ### Lit Etykieta Fs Typ Rozmiar Stan Info ----------- --- ----------- ----- ------------ ------- ------- -------- Wolumin 1 SYSTEM NTFS Partycja 300 MB Zdrowy System Wolumin 2 C NTFS Partycja 445 GB Zdrowy Rozruch Wolumin 3 D HP_RECOVERY NTFS Partycja 15 GB Zdrowy Wolumin 4 E HP_TOOLS FAT32 Partycja 5122 MB Zdrowy

Rodzaj systemu plików, który w systemie Windows pozwala na kompresję danych oraz przydzielanie uprawnień do plików i folderów, to

Na podstawie przedstawionego w tabeli standardu opisu pamięci PC-100 wskaż pamięć, która charakteryzuje się maksymalnym czasem dostępu wynoszącym 6 nanosekund oraz minimalnym opóźnieniem między sygnałami CAS i RAS równym 2 cyklom zegara?

| Specyfikacja wzoru: PC 100-abc-def jednolitego sposobu oznaczania pamięci. | ||

| a | CL (ang. CAS Latency) | minimalna liczba cykli sygnału taktującego, liczona podczas operacji odczytu, od momentu uaktywnienia sygnału CAS, do momentu pojawienia się danych na wyjściu modułu DIMM (wartość CL wynosi zwykle 2 lub 3); |

| b | tRCD (ang. RAS to CAS Delay) | minimalne opóźnienie pomiędzy sygnałami RAS i CAS, wyrażone w cyklach zegara systemowego; |

| c | tRP (ang. RAS Precharge) | czas wyrażony w cyklach zegara taktującego, określający minimalną pauzę pomiędzy kolejnymi komendami, wykonywanymi przez pamięć; |

| d | tAC | Maksymalny czas dostępu (wyrażony w nanosekundach); |

| e | SPD Rev | specyfikacja komend SPD (parametr może nie występować w oznaczeniach); |

| f | Parametr zapasowy | ma wartość 0; |

Jak prezentuje się adres IP 192.168.1.12 w formacie binarnym?

Który z wymienionych protokołów przekształca 48-bitowy adres MAC na 32-bitowy adres IP?

Który protokół przesyła datagramy bez gwarancji ich dostarczenia?

Kiedy wygasa autorskie prawo majątkowe dotyczące programu komputerowego, stworzonego przez kilku programistów, którzy jako jego autorzy podpisali aplikację swoimi imionami i nazwiskami?

W systemie Linux plik posiada uprawnienia ustawione na 541. Właściciel ma możliwość pliku

Jakie oznaczenie odnosi się do normy dotyczącej okablowania strukturalnego?

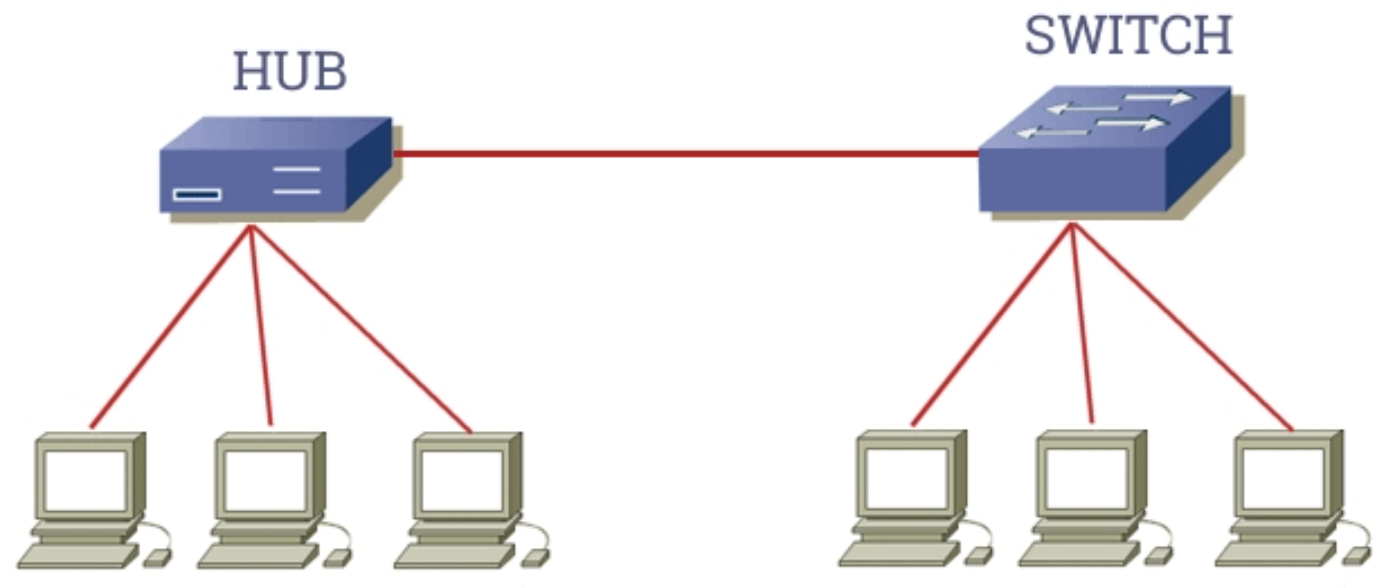

Jaką topologię fizyczną sieci komputerowej przedstawia załączony rysunek?

Graficzny symbol pokazany na ilustracji oznacza

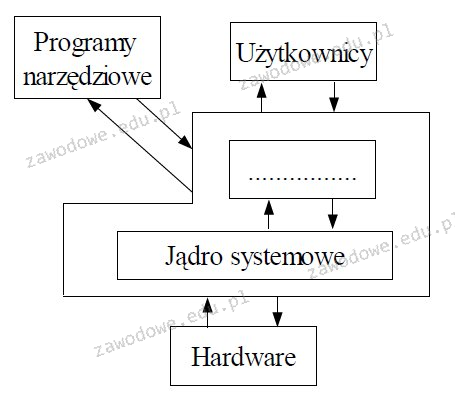

Jaki termin powinien zostać umieszczony w miejscu z kropkami na schemacie blokowym przedstawiającym strukturę systemu operacyjnego?

Komputer ma podłączoną mysz bezprzewodową, a kursor podczas pracy nie porusza się płynnie, „skacze” po ekranie. Przyczyną usterki urządzenia może być

Symbol graficzny przedstawiony na ilustracji oznacza złącze

Program "VirtualPC", dostępny do pobrania z witryny Microsoft, jest przeznaczony do korzystania:

Diody LED RGB funkcjonują jako źródło światła w różnych modelach skanerów

Jakie narzędzie w systemie Windows pozwala na kontrolowanie stanu sprzętu, aktualizowanie sterowników oraz rozwiązywanie problemów z urządzeniami?

Ile domen kolizyjnych występuje w sieci pokazanej na rysunku?

Matryce monitorów typu charakteryzują się najmniejszymi kątami widzenia

Jakie korzyści płyną z zastosowania systemu plików NTFS?

Rysunek ilustruje sposób działania drukarki

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jaką minimalną ilość pamięci RAM musi mieć komputer, aby móc uruchomić 64-bitowy system operacyjny Windows 7 w trybie graficznym?

Polecenie tar w systemie Linux służy do

Która z poniższych wskazówek nie jest właściwa w kontekście konserwacji skanera płaskiego?

Aby naprawić uszkodzony sektor rozruchowy dysku w systemie Windows 7, należy użyć polecenia

Jaką czynność konserwacyjną należy wykonywać przy użytkowaniu skanera płaskiego?

Jaka usługa musi być aktywna na serwerze, aby stacja robocza mogła automatycznie uzyskać adres IP?

Protokół, który zajmuje się identyfikowaniem i usuwaniem kolizji w sieciach Ethernet, to