Pytanie 1

Co nie wpływa na utratę z pamięci masowej HDD?

Wynik: 16/40 punktów (40,0%)

Wymagane minimum: 20 punktów (50%)

Co nie wpływa na utratę z pamięci masowej HDD?

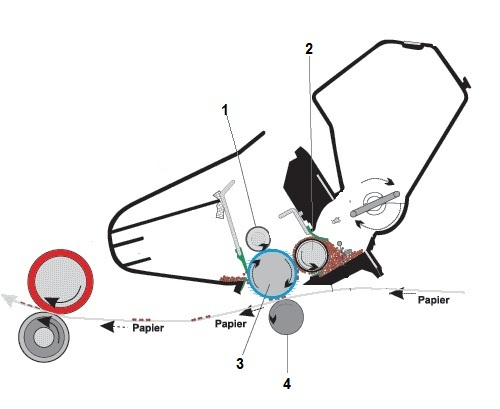

Na przedstawionym schemacie drukarki laserowej wałek światłoczuły oznaczono numerem

W systemach Windows, aby określić, w którym miejscu w sieci zatrzymał się pakiet, stosuje się komendę

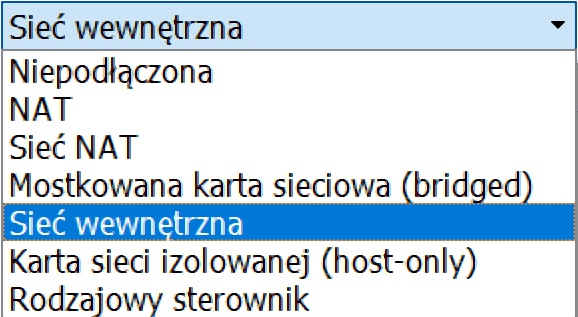

Na ilustracji przedstawiono opcje karty sieciowej w oprogramowaniu VirtualBox. Ustawienie na wartość sieć wewnętrzna, spowoduje, że

Protokół ARP (Address Resolution Protocol) pozwala na przypisanie logicznych adresów warstwy sieciowej do rzeczywistych adresów warstwy

Jakie urządzenie powinno być zainstalowane w serwerze, aby umożliwić automatyczne archiwizowanie danych na taśmach magnetycznych?

Cechą charakterystyczną transmisji za pomocą interfejsu równoległego synchronicznego jest to, że

Symbole i oznaczenia znajdujące się na zamieszczonej tabliczce znamionowej podzespołu informują między innymi o tym, że produkt jest

Natychmiast po dostrzeżeniu utraty istotnych plików na dysku twardym, użytkownik powinien

Jakie urządzenie pozwoli na połączenie kabla światłowodowego zastosowanego w okablowaniu pionowym sieci z przełącznikiem, który ma jedynie złącza RJ45?

Jak określa się typ licencji, który pozwala na pełne korzystanie z programu, lecz można go uruchomić tylko przez ograniczoną, niewielką liczbę razy od momentu instalacji?

Aby zweryfikować indeks stabilności systemu Windows Server, należy zastosować narzędzie

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Podczas realizacji projektu sieci LAN zastosowano medium transmisyjne zgodne ze standardem Ethernet 1000Base-T. Które z poniższych stwierdzeń jest prawdziwe?

Do weryfikacji funkcjonowania serwera DNS na systemach Windows Server można zastosować narzędzie nslookup. Jeżeli w poleceniu jako argument zostanie podana nazwa komputera, np. nslookup host.domena.com, to system sprawdzi

Ile par kabli w standardzie 100Base-TX jest używanych do transmisji danych w obie strony?

Do efektywnego zrealizowania macierzy RAID 1 wymagane jest minimum

Zjawiskiem typowym, które może świadczyć o nadchodzącej awarii twardego dysku, jest wystąpienie

Wskaż nazwę modelu przechowywania i przetwarzania danych opartego na użytkowaniu zasobów dyskowych, obliczeniowych i programowych, udostępnionych przez usługodawcę za pomocą sieci komputerowej.

Zgodnie z wytycznymi dotyczącymi karty graficznej, jej możliwości pracy z systemem AGP 2X/4X pozwalają na

Elementem eksploatacyjnym drukarki laserowej jest wszystko oprócz

Narzędziem systemu Windows, służącym do sprawdzenia wpływu poszczególnych procesów i usług na wydajność procesora oraz tego, w jakim stopniu generują one obciążenie pamięci czy dysku, jest

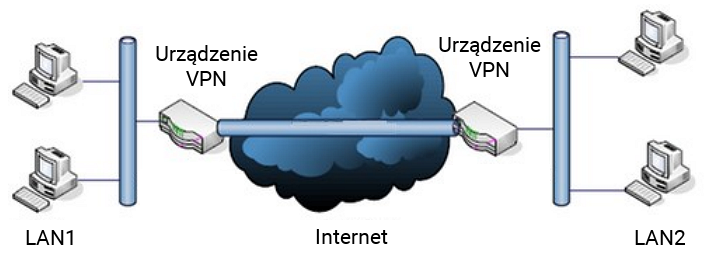

Schemat ilustruje sposób funkcjonowania sieci VPN noszącej nazwę

Celem złocenia styków złącz HDMI jest

Metoda transmisji żetonu (ang. token) znajduje zastosowanie w topologii

Zwiększenie zarówno wydajności operacji (zapis/odczyt), jak i bezpieczeństwa przechowywania danych jest możliwe dzięki zastosowaniu macierzy dyskowej

Jaką rolę pełni usługa NAT działająca na ruterze?

Na ilustracji zobrazowano

Na ilustracji zaprezentowano kabel

Narzędziem systemu Windows, służącym do sprawdzenia wpływu poszczególnych procesów i usług na wydajność procesora oraz tego, w jakim stopniu generują one obciążenie pamięci czy dysku, jest

Komputer, którego serwis ma być wykonany u klienta, nie odpowiada na naciśnięcie przycisku POWER. Jakie powinno być pierwsze zadanie w planie działań związanych z identyfikacją i naprawą tej awarii?

W systemie Linux Ubuntu Server, aby przeprowadzić instalację serwera DHCP, należy wykorzystać polecenie

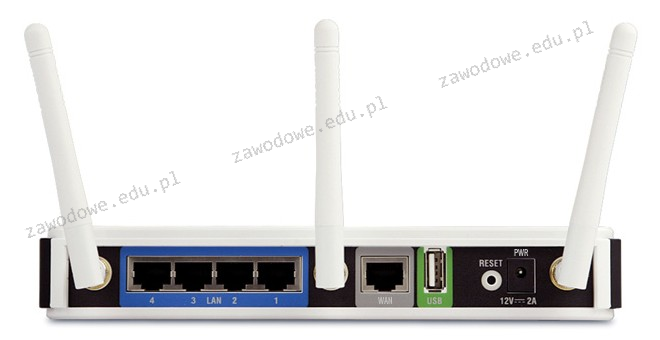

Jakie urządzenie jest pokazane na ilustracji?

W systemie Windows do instalacji aktualizacji oraz przywracania sterowników urządzeń należy użyć przystawki

Do jakiego portu należy podłączyć kabel sieciowy zewnętrzny, aby uzyskać pośredni dostęp do sieci Internet?

Jeżeli podczas uruchamiania systemu BIOS od AWARD komputer wydał długi sygnał oraz dwa krótkie, co to oznacza?

ARP (Adress Resolution Protocol) jest protokołem, który umożliwia przekształcenie adresu IP na

Który z zapisów adresu IPv4 z maską jest niepoprawny?

Do wymiany uszkodzonych kondensatorów w karcie graficznej potrzebne jest

Jakie polecenie jest używane do monitorowania statystyk protokołów TCP/IP oraz bieżących połączeń sieciowych w systemach operacyjnych z rodziny Windows?