Pytanie 1

W jednostce ALU do rejestru akumulatora wprowadzono liczbę dziesiętną 600. Jak wygląda jej reprezentacja w systemie binarnym?

Wynik: 25/40 punktów (62,5%)

Wymagane minimum: 20 punktów (50%)

W jednostce ALU do rejestru akumulatora wprowadzono liczbę dziesiętną 600. Jak wygląda jej reprezentacja w systemie binarnym?

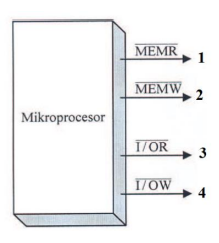

Sygnał kontrolny generowany przez procesor, umożliwiający zapis do urządzeń wejściowych i wyjściowych, został na diagramie oznaczony numerem

Aby zmienić istniejące konto użytkownika przy użyciu polecenia net user oraz wymusić reset hasła po kolejnej sesji logowania użytkownika, jaki parametr należy dodać do tego polecenia?

Jakie urządzenie powinno być wykorzystane do pomiaru mapy połączeń w okablowaniu strukturalnym sieci lokalnej?

Aktywacja opcji OCR podczas ustawiania skanera umożliwia

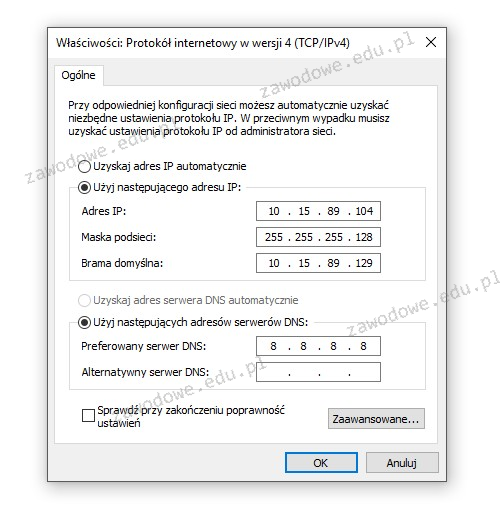

Na rysunku przedstawiono ustawienia karty sieciowej urządzenia z adresem IP 10.15.89.104/25. Co z tego wynika?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

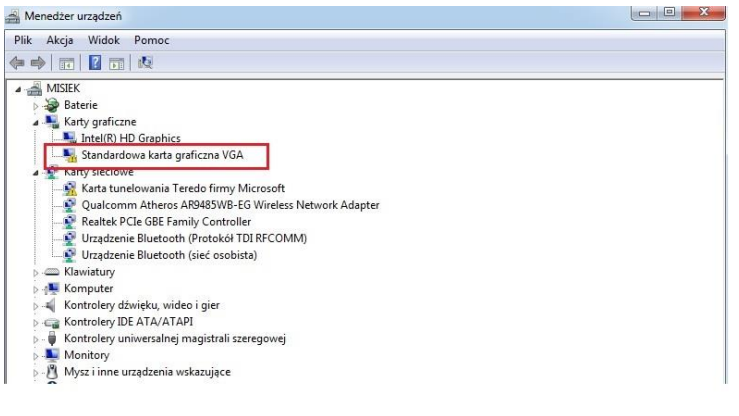

Jakie kroki powinien podjąć użytkownik, aby wyeliminować błąd zaznaczony na rysunku ramką?

Która z grup w systemie Windows Server ma najniższe uprawnienia?

Program fsck jest stosowany w systemie Linux do

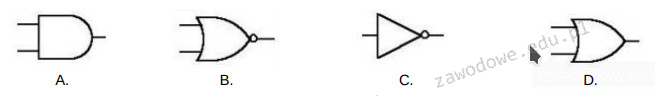

Wskaź rysunek ilustrujący symbol bramki logicznej NOT?

Komputer wyposażony w BIOS firmy Award wygenerował komunikat o treści Primary/Secondary master/slave hard disk fail. Komunikat ten może oznaczać konieczność wymiany

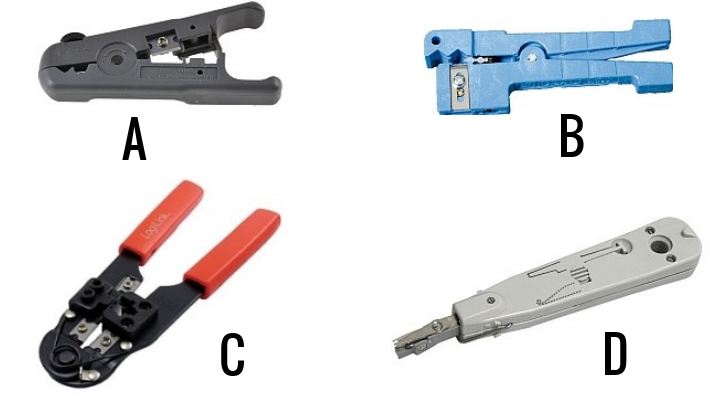

Do czego służy nóż uderzeniowy?

Przesyłanie danych przez router, które wiąże się ze zmianą adresów IP źródłowych lub docelowych, określa się skrótem

Jakiego rodzaju interfejsem jest UDMA?

Jakie polecenie umożliwia uzyskanie danych dotyczących bieżących połączeń TCP oraz informacji o portach źródłowych i docelowych?

Co umożliwia zachowanie jednolitego rozkładu temperatury pomiędzy procesorem a radiatorem?

Która z grup w systemie Windows Serwer dysponuje najmniejszymi uprawnieniami?

Aby zweryfikować połączenia kabla U/UTP Cat. 5e w systemie okablowania strukturalnego, jakiego urządzenia należy użyć?

Aby komputery mogły udostępniać dane w sieci, NIE powinny mieć tych samych

Zrzut ekranu ilustruje wynik polecenia arp -a. Jak należy zrozumieć te dane?

Jakie narzędzie wykorzystuje się do przytwierdzania kabla w module Keystone?

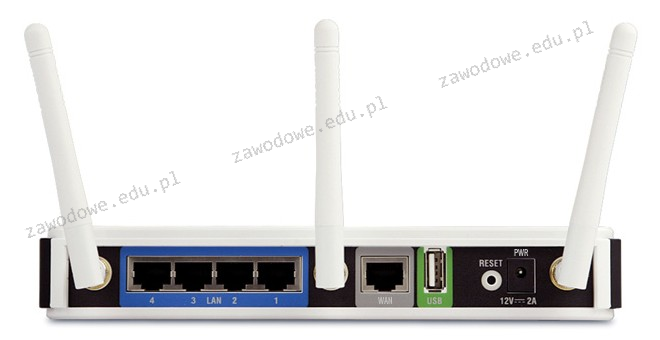

Do jakiego portu należy podłączyć kabel sieciowy zewnętrzny, aby uzyskać pośredni dostęp do sieci Internet?

Aby stworzyć las w strukturze katalogów AD DS (Active Directory Domain Services), konieczne jest utworzenie przynajmniej

Jakie narzędzie w systemie Linux pozwala na wyświetlenie danych o sprzęcie zapisanych w BIOS?

Program iftop działający w systemie Linux ma na celu

W systemie binarnym liczba 51(10) przyjmuje formę

W systemie SI jednostką do mierzenia napięcia jest

Podczas pracy wskaźnik przewodowej myszy optycznej nie reaguje na przesuwanie urządzenia po padzie, dopiero po odpowiednim ułożeniu myszy kursor zaczyna zmieniać położenie. Objawy te wskazują na uszkodzenie

Programem służącym do archiwizacji danych w systemie Linux jest

Kluczowe znaczenie przy tworzeniu stacji roboczej dla wielu wirtualnych maszyn ma

Po zainstalowaniu Systemu Windows 7 dokonano zmiany w BIOS-ie komputera, skonfigurowano dysk SATA z AHCI na IDE. Po ponownym uruchomieniu systemu komputer będzie

Aby przekształcić zeskanowany obraz w tekst, należy użyć oprogramowania, które wykorzystuje metody

Jakiego materiału używa się w drukarkach tekstylnych?

Który z komponentów NIE JEST zgodny z płytą główną MSI A320M Pro-VD-S socket AM4, 1x PCI-Ex16, 2x PCI-Ex1, 4x SATA III, 2x DDR4- max 32 GB, 1x D-SUB, 1x DVI-D, ATX?

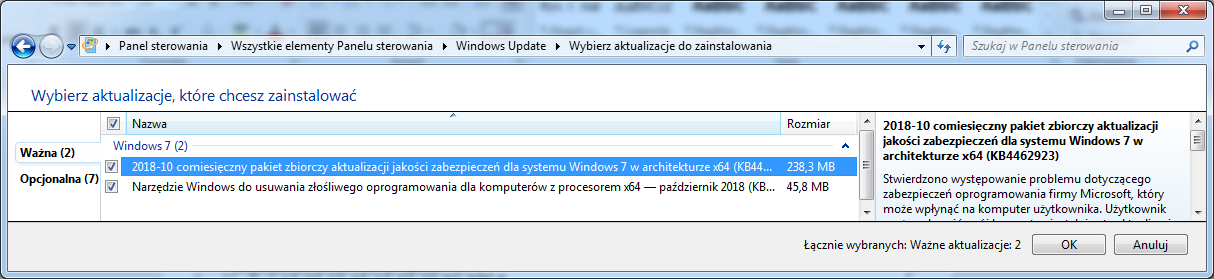

Głównie które aktualizacje zostaną zainstalowane po kliknięciu na przycisk OK prezentowany na zrzucie ekranu?

Długi oraz dwa krótkie dźwięki sygnałowe BIOS POST od AMI i AWARD sygnalizują problem

Najczęściej używany kodek audio przy ustawianiu bramki VoIP to

Które z poniższych stwierdzeń odnosi się do sieci P2P – peer to peer?

Główną metodą ochrony sieci komputerowej przed zagrożeniem z zewnątrz jest zastosowanie