Pytanie 1

Jak nazywa się topologia fizyczna, w której każdy węzeł łączy się bezpośrednio ze wszystkimi innymi węzłami?

Wynik: 18/40 punktów (45,0%)

Wymagane minimum: 20 punktów (50%)

Jak nazywa się topologia fizyczna, w której każdy węzeł łączy się bezpośrednio ze wszystkimi innymi węzłami?

Jaki procesor powinien być zastosowany przy składaniu komputera osobistego z płytą główną Asus M5A78L-M/USB3 AMD760G socket AM3+?

Wtyczka zaprezentowana na fotografii stanowi element obwodu elektrycznego zasilającego

int a;

Podaną zmienną wyświetl na 2 sposoby.

Który z poniższych elementów jest częścią mechanizmu drukarki atramentowej?

Do konwersji kodu źródłowego na program wykonywalny używany jest

Podczas przetwarzania pakietów danych w sieci, wartość pola TTL (ang. Time To Live) jest modyfikowana za każdym razem, gdy pakiet przechodzi przez ruter. Jaką wartość tego pola należy ustawić, aby ruter skasował pakiet?

W systemie Windows Server, możliwość udostępnienia folderu jako zasobu sieciowego, który jest widoczny na stacji roboczej jako dysk oznaczony literą, można uzyskać poprzez realizację czynności

Na przedstawionym rysunku widoczna jest karta rozszerzeń z systemem chłodzenia

Jakie urządzenie sieciowe powinno zastąpić koncentrator, aby podzielić sieć LAN na cztery odrębne domeny kolizji?

Technologia opisana w systemach należących do rodziny Windows to

| Jest to technologia obsługująca automatyczną konfigurację komputera PC i wszystkich zainstalowanych w nim urządzeń. Umożliwia ona rozpoczęcie korzystania z nowego urządzenia (na przykład karty dźwiękowej lub modemu) natychmiast po jego zainstalowaniu bez konieczności przeprowadzania ręcznej jego konfiguracji. Technologia ta jest implementowana w warstwach sprzętowej i systemu operacyjnego, a także przy użyciu sterowników urządzeń i BIOS-u. |

W systemie Windows, który obsługuje przydziały dyskowe, użytkownik o nazwie Gość

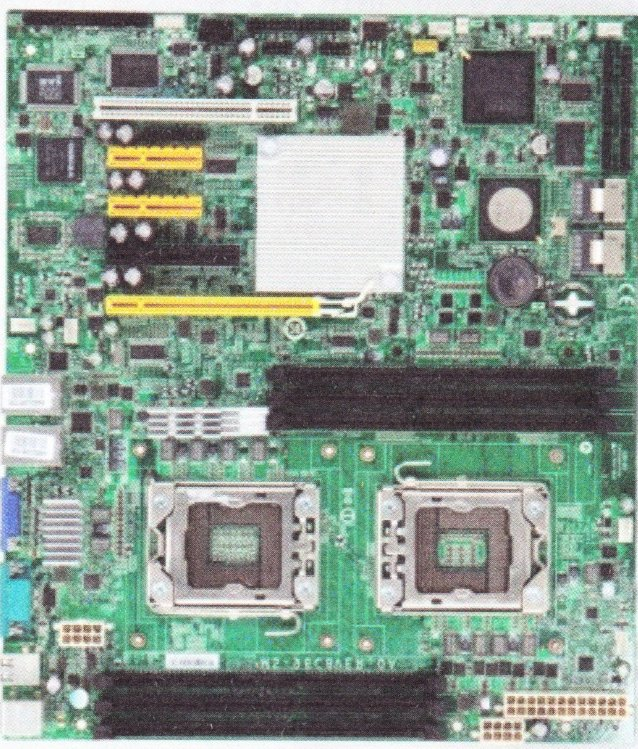

W komputerze użyto płyty głównej widocznej na obrazku. Aby podnieść wydajność obliczeniową maszyny, zaleca się

Mechanizm, który pozwala na podłączenie urządzeń peryferyjnych do systemu komputerowego, w którym każde urządzenie jest identyfikowane przez przypisany mu numer, to

Który z parametrów należy użyć w poleceniu netstat, aby uzyskać statystyki interfejsu sieciowego dotyczące liczby przesłanych oraz odebranych bajtów i pakietów?

Które z poniższych kont nie jest wbudowane w system Windows XP?

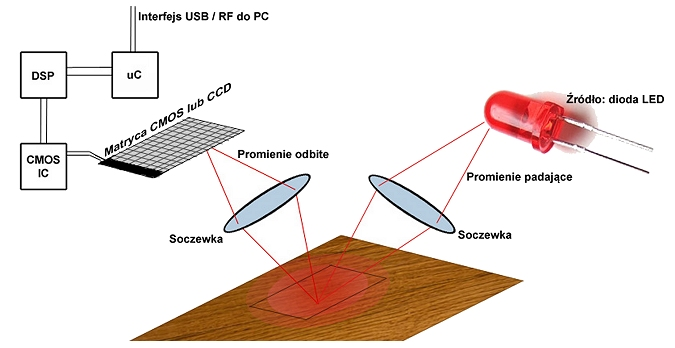

Zaprezentowany diagram ilustruje zasadę funkcjonowania

Która z wymienionych właściwości kabla koncentrycznego RG-58 sprawia, że nie jest on obecnie używany do tworzenia lokalnych sieci komputerowych?

Administrator systemu Linux wykonał listę zawartości folderu /home/szkola w terminalu, uzyskując następujący wynik -rwx -x r-x 1 admin admin 25 04-09 15:17 szkola.txt. Następnie wpisał polecenie: ```chmod ug=rw szkola.txt | ls -l``` Jaki rezultat jego działania zostanie pokazany w terminalu?

Aby skonfigurować wolumin RAID 5 na serwerze, wymagane jest minimum

Aby zabezpieczyć system przed atakami typu phishing, nie zaleca się

Jakiego numeru kodu należy użyć w komendzie do zmiany uprawnień folderu w systemie Linux, aby właściciel miał dostęp do zapisu i odczytu, grupa miała prawo do odczytu i wykonania, a pozostali użytkownicy mogli jedynie odczytywać zawartość?

Protokół ARP (Address Resolution Protocol) służy do konwersji adresu IP na

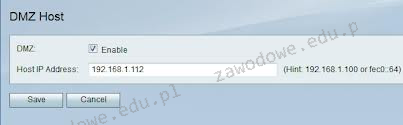

Na ilustracji widać zrzut ekranu ustawień strefy DMZ na routerze. Aktywacja opcji "Enable DMZ" spowoduje, że komputer z adresem IP 192.168.0.106

Która z anten cechuje się najwyższym zyskiem mocy i pozwala na nawiązanie łączności na dużą odległość?

Jakie zakresy zostaną przydzielone przez administratora do adresów prywatnych w klasie C, przy użyciu maski 24 bitowej dla komputerów w lokalnej sieci?

Na ilustracji przedstawiono część procesu komunikacji z serwerem, która została przechwycona przez aplikację Wireshark. Jaki to serwer?

Discover - Transaction ID 0x6a16b7a5 Offer - Transaction ID 0x6a16b7a5 Request - Transaction ID 0x6a16b7a5 ACK - Transaction ID 0x6a16b7a5

Członkostwo komputera w danej sieci wirtualnej nie może być ustalane na podstawie

Wykonane polecenia, uruchomione w interfejsie CLI rutera marki CISCO, spowodują ```Router#configure terminal Router(config)#interface FastEthernet 0/0 Router(config-if)#ip address 10.0.0.1 255.255.255.0 Router(config-if)#ip nat inside```

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Adres IP lokalnej podsieci komputerowej to 172.16.10.0/24. Komputer1 posiada adres IP 172.16.0.10, komputer2 - 172.16.10.100, a komputer3 - 172.16.255.20. Który z wymienionych komputerów należy do tej podsieci?

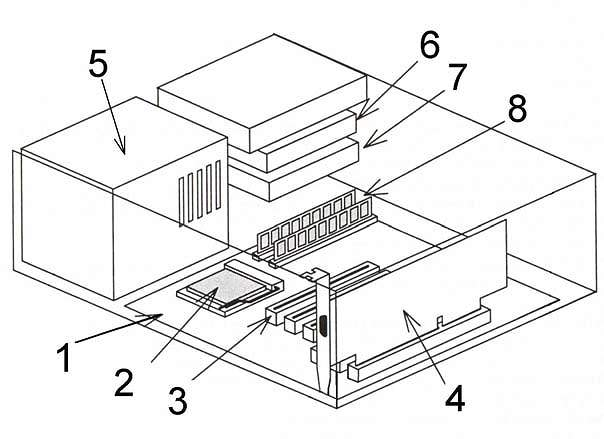

Na ilustracji procesor jest oznaczony liczbą

Sieć 192.200.100.0 z maską 255.255.255.128 podzielono na 4 równe podsieci. Ile maksymalnie adresów hostów jest dostępnych w każdej podsieci?

Jakie urządzenie umożliwia zwiększenie zasięgu sieci bezprzewodowej?

W systemie Windows Professional aby ustawić czas dostępności dla drukarki, należy skorzystać z zakładki

Jakie są zakresy częstotliwości oraz maksymalne prędkości przesyłu danych w standardzie 802.11g WiFi?

Aby uporządkować dane pliku zapisane na dysku twardym, które znajdują się w nie sąsiadujących klastrach, tak by zajmowały one sąsiadujące ze sobą klastry, należy przeprowadzić

Aby przywrócić poprawne wersje plików systemowych w systemie Windows, wykorzystuje się narzędzie

Komputer jest podłączony do sieci Internet, a na jego pokładzie brak oprogramowania antywirusowego. Jak można sprawdzić, czy ten komputer jest zainfekowany wirusem, nie zmieniając ustawień systemowych?

Serwisant dotarł do klienta, który znajdował się 11 km od siedziby firmy, i przeprowadził u niego działania naprawcze wymienione w poniższej tabeli. Oblicz całkowity koszt brutto jego usług, wiedząc, że dojazd do klienta kosztuje 1,20 zł/km brutto w obie strony. Stawka VAT na usługi wynosi 23%.