Pytanie 1

Brak informacji o parzystości liczby lub o znaku wyniku operacji w ALU może sugerować problemy z funkcjonowaniem

Wynik: 22/40 punktów (55,0%)

Wymagane minimum: 20 punktów (50%)

Brak informacji o parzystości liczby lub o znaku wyniku operacji w ALU może sugerować problemy z funkcjonowaniem

W systemie Windows, z jakiego polecenia można skorzystać, aby sprawdzić bieżące połączenia sieciowe i ich statystyki?

Który adres IP jest przypisany do klasy A?

Która z wymienionych czynności nie jest związana z personalizacją systemu operacyjnego Windows?

Jaką funkcję serwera z grupy Windows Server trzeba dodać, aby serwer mógł realizować usługi rutingu?

Adware to rodzaj oprogramowania

Jakie polecenie powinno być użyte do obserwacji lokalnych połączeń?

Jakie urządzenie w warstwie łącza danych modelu OSI analizuje adresy MAC zawarte w ramkach Ethernet i na tej podstawie decyduje o przesyłaniu sygnału pomiędzy segmentami sieci lub jego blokowaniu?

Jakie urządzenie powinno się zastosować do przeprowadzenia testu POST dla komponentów płyty głównej?

Jednym z programów stosowanych do tworzenia kopii zapasowych partycji oraz dysków jest

Który z poniższych adresów IPv4 wraz z prefiksem reprezentuje adres sieci?

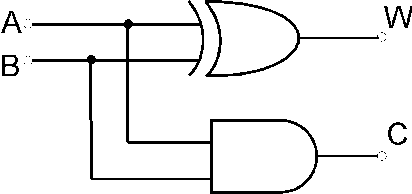

Wynikiem działania przedstawionego układu logicznego po podaniu na wejściach A i B sygnałów logicznych A=1 i B=1 są wartości logiczne:

Materiałem eksploatacyjnym stosowanym w drukarkach tekstylnych jest

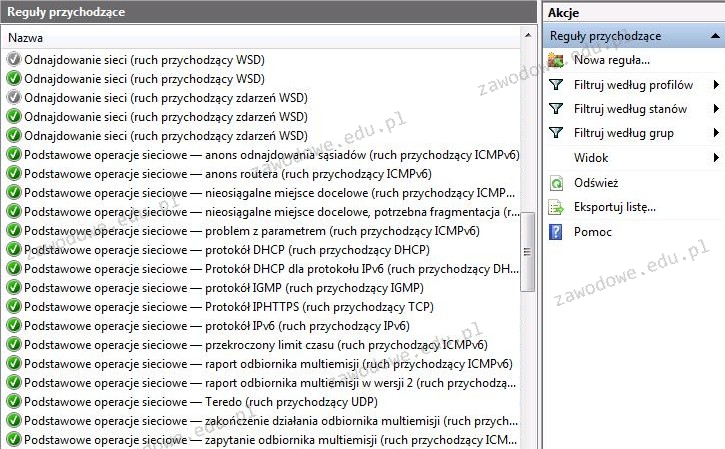

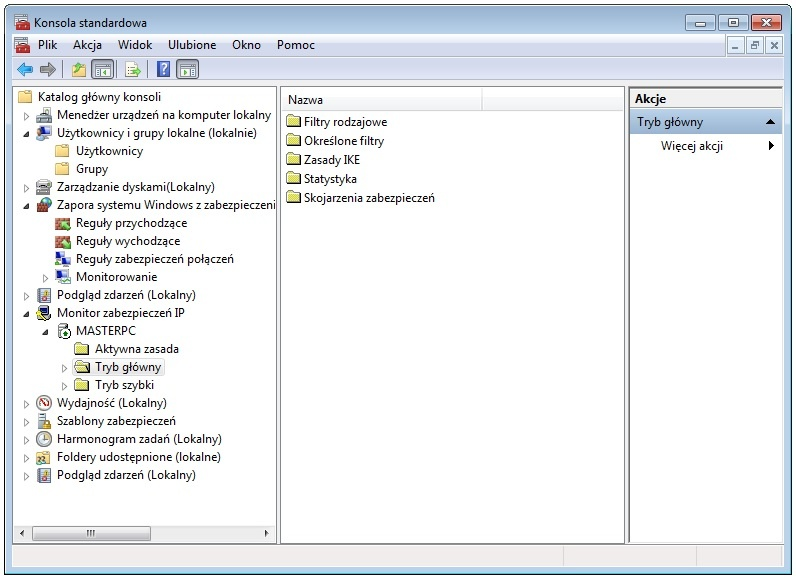

Zrzut ekranu ilustruje aplikację

W systemie Linux program top umożliwia

W jednostce ALU do rejestru akumulatora wprowadzono liczbę dziesiętną 600. Jak wygląda jej reprezentacja w systemie binarnym?

Jednym z metod ograniczenia dostępu do sieci bezprzewodowej dla osób nieuprawnionych jest

Jaką topologię fizyczną sieci komputerowej przedstawia rysunek?

Co nie wpływa na utratę z pamięci masowej HDD?

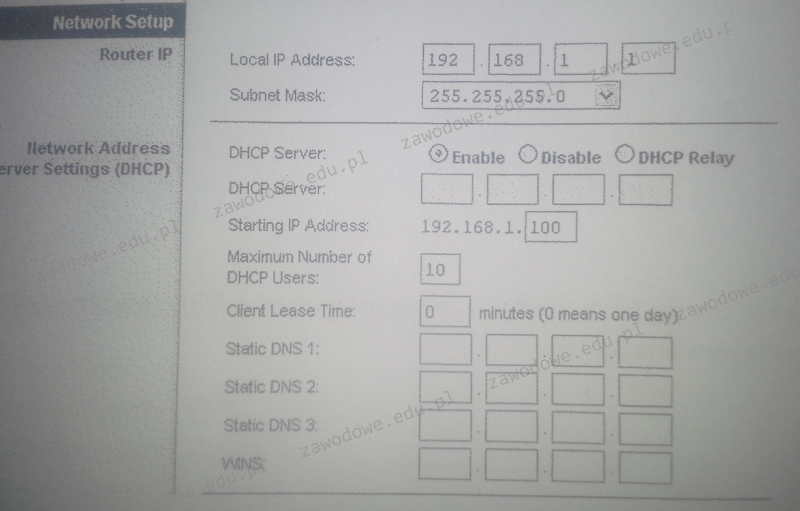

Na przedstawionym zrzucie panelu ustawień rutera można zauważyć, że serwer DHCP

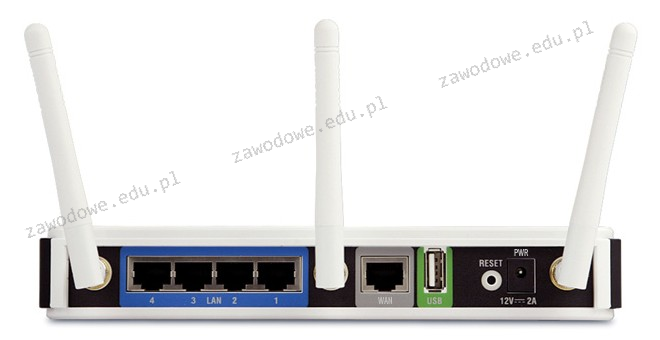

Do jakiego portu należy podłączyć kabel sieciowy zewnętrzny, aby uzyskać pośredni dostęp do sieci Internet?

Chusteczki namoczone w płynie o działaniu antystatycznym są używane do czyszczenia

Mysz bezprzewodowa jest podłączona do komputera, jednak kursor nie porusza się gładko i „skacze” po ekranie. Możliwą przyczyną problemu z urządzeniem może być

Aby serwer mógł przesyłać dane w zakresach częstotliwości 2,4 GHz oraz 5 GHz, konieczne jest zainstalowanie w nim karty sieciowej działającej w standardzie

Usługa odpowiedzialna za konwersję nazw domen na adresy sieciowe to

Jakiego rodzaju złącze powinna mieć płyta główna, aby umożliwić zainstalowanie karty graficznej przedstawionej na rysunku?

Interfejs graficzny systemu Windows, który wyróżnia się przezroczystością przypominającą szkło oraz delikatnymi animacjami okien, nazywa się

Wskaż technologię stosowaną do zapewnienia dostępu do Internetu w połączeniu z usługą telewizji kablowej, w której światłowód oraz kabel koncentryczny pełnią rolę medium transmisyjnego

Jaki będzie wynik operacji odejmowania dwóch liczb szesnastkowych: 60Aₕ – 3BFₕ?

Określenie najlepszej trasy dla połączenia w sieci to

Grupa protokołów, która charakteryzuje się wspólną metodą szyfrowania, to

Wykonanie polecenia perfmon w terminalu systemu Windows spowoduje

Okno narzędzia przedstawionego na ilustracji można uzyskać poprzez wykonanie polecenia

Jaką liczbę warstw określa model ISO/OSI?

Aby uzyskać listę procesów aktualnie działających w systemie Linux, należy użyć polecenia

Jakie polecenie powinien wydać root w systemie Ubuntu Linux, aby przeprowadzić aktualizację wszystkich pakietów (całego systemu) do najnowszej wersji z zainstalowaniem nowego jądra?

Na ilustracji złącze monitora, które zostało zaznaczone czerwoną ramką, będzie współdziałać z płytą główną posiadającą interfejs

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Licencja Windows OEM nie zezwala na wymianę

Który z poniższych protokołów należy do warstwy aplikacji w modelu ISO/OSI?