Pytanie 1

Program df działający w systemach z rodziny Linux pozwala na wyświetlenie

Wynik: 19/40 punktów (47,5%)

Wymagane minimum: 20 punktów (50%)

Program df działający w systemach z rodziny Linux pozwala na wyświetlenie

W systemie Windows mechanizm ostrzegający przed uruchamianiem nieznanych aplikacji oraz plików pobranych z Internetu funkcjonuje dzięki

Jakie narzędzie należy zastosować w systemie Windows, aby skonfigurować właściwości wszystkich zainstalowanych urządzeń lub wyświetlić ich listę?

Zamieszczony poniżej diagram ilustruje zasadę działania skanera

W systemie Linux plik posiada uprawnienia ustawione na 765. Grupa przypisana do tego pliku ma możliwość

Aby połączyć projektor multimedialny z komputerem, nie można zastosować złącza

Jakie narzędzie wraz z odpowiednimi parametrami należy zastosować w systemie Windows, aby uzyskać przedstawione informacje o dysku twardym?

ST9500420AS Identyfikator dysku : A67B7C06 Typ : ATA Stan : Online Ścieżka : 0 Element docelowy : 0 Identyfikator jednostki LUN: 0 Ścieżka lokalizacji : PCIROOT(0)#ATA(C00T00L00) Bieżący stan tylko do odczytu : Nie Tylko do odczytu: Nie Dysk rozruchowy : Tak Dysk plików stronicowania: Tak Dysk plików hibernacji: Nie Dysk zrzutów awaryjnych: Tak Dysk klastrowany: Nie Wolumin ### Lit Etykieta Fs Typ Rozmiar Stan Info ----------- --- ----------- ----- ------------ ------- ------- -------- Wolumin 1 SYSTEM NTFS Partycja 300 MB Zdrowy System Wolumin 2 C NTFS Partycja 445 GB Zdrowy Rozruch Wolumin 3 D HP_RECOVERY NTFS Partycja 15 GB Zdrowy Wolumin 4 E HP_TOOLS FAT32 Partycja 5122 MB Zdrowy

Która z grup w systemie Windows Server ma najniższe uprawnienia?

Który z poniższych programów nie jest wykorzystywany do zdalnego administrowania komputerami w sieci?

Jak określamy atak na sieć komputerową, który polega na łapaniu pakietów przesyłanych w sieci?

Okablowanie pionowe w systemie strukturalnym łączy się

Jakie zastosowanie ma oprogramowanie Microsoft Hyper-V?

Na rysunkach technicznych dotyczących instalacji sieci komputerowej oraz dedykowanej instalacji elektrycznej, symbolem pokazanym na rysunku oznaczane jest gniazdo

Jaka usługa musi być aktywna na serwerze, aby stacja robocza mogła automatycznie uzyskać adres IP?

Wskaż rodzaj konserwacji, który powinien być przeprowadzony, gdy na wydruku z drukarki atramentowej pojawiają się smugi, kolory są nieprawidłowe lub brakuje niektórych barw.

Serwer zajmuje się rozgłaszaniem drukarek w sieci, organizowaniem zadań do wydruku oraz przydzielaniem uprawnień do korzystania z drukarek

Jaką liczbę bitów posiada adres logiczny IPv6?

Jaką topologię fizyczną sieci komputerowej przedstawia załączony rysunek?

Określenie najbardziej efektywnej trasy dla połączenia w sieci to

Jak można skonfigurować sieć VLAN?

Który z protokołów przesyła datagramy użytkownika BEZ GWARANCJI ich dostarczenia?

Uruchomienie systemu Windows jest niemożliwe z powodu awarii oprogramowania. W celu przeprowadzenia jak najmniej inwazyjnej diagnostyki i usunięcia tej usterki, zaleca się

W systemie DNS, aby powiązać nazwę hosta z adresem IPv4, konieczne jest stworzenie rekordu

Jak wygląda liczba 356 w systemie binarnym?

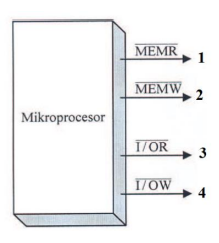

Sygnał kontrolny generowany przez procesor, umożliwiający zapis do urządzeń wejściowych i wyjściowych, został na diagramie oznaczony numerem

Po wykonaniu instalacji z domyślnymi parametrami system Windows XP NIE OBSŁUGUJE formatu systemu plików

Wtyk przedstawiony na ilustracji powinien być użyty do zakończenia kabli kategorii

Która z poniższych opcji nie jest usługą katalogową?

Który z wymienionych składników stanowi element pasywny w sieci?

Zastosowanie programu firewall ma na celu ochronę

Jak wygląda liczba 257 w systemie dziesiętnym?

Monitor CRT jest podłączany do karty graficznej przy użyciu złącza

Administrator pragnie udostępnić w sieci folder C:instrukcje trzem użytkownikom z grupy Serwisanci. Jakie rozwiązanie powinien wybrać?

Złącze umieszczone na płycie głównej, które umożliwia podłączanie kart rozszerzeń o różnych ilościach pinów, w zależności od wersji, nazywane jest

Jakie funkcje realizuje system informatyczny?Kursy informatyczne

W przypadku awarii którego urządzenia w sieci lokalnej, cała sieć przestaje działać w topologii magistrali?

Zamontowany w notebooku trackpoint jest urządzeniem wejściowym reagującym na

Wskaż procesor współpracujący z przedstawioną płytą główną.

W których nośnikach pamięci masowej jedną z najczęstszych przyczyn uszkodzeń jest uszkodzenie powierzchni?

Trollowanie w Internecie polega na