Pytanie 1

Minimalna ilość pamięci RAM wymagana dla systemu operacyjnego Windows Server 2008 wynosi przynajmniej

Wynik: 26/40 punktów (65,0%)

Wymagane minimum: 20 punktów (50%)

Minimalna ilość pamięci RAM wymagana dla systemu operacyjnego Windows Server 2008 wynosi przynajmniej

Jakie urządzenie w warstwie łącza danych modelu OSI analizuje adresy MAC zawarte w ramkach Ethernet i na tej podstawie decyduje o przesyłaniu sygnału pomiędzy segmentami sieci lub jego blokowaniu?

Który poziom macierzy RAID zapisuje dane jednocześnie na wielu dyskach jako jedno urządzenie?

Czym wyróżniają się procesory CISC?

Nie jest możliwe wykonywanie okresowych kopii zapasowych dysków serwera na nośnikach wymiennych typu

Jakie z podanych urządzeń stanowi część jednostki centralnej?

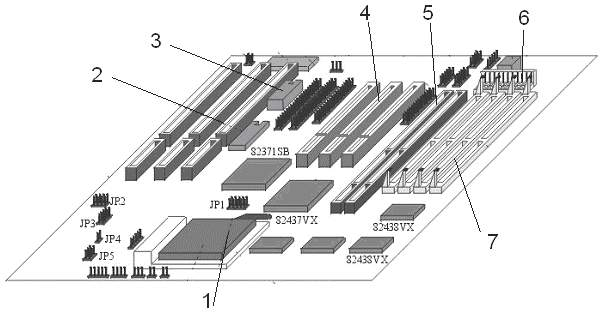

Na schemacie płyty głównej port PCI oznaczony jest numerem

Poleceniem systemu Linux służącym do wyświetlenia informacji, zawierających aktualną godzinę, czas działania systemu oraz liczbę zalogowanych użytkowników, jest

Który z protokołów funkcjonuje w warstwie aplikacji modelu ISO/OSI, umożliwiając wymianę informacji kontrolnych między urządzeniami sieciowymi?

Który rekord DNS powinien zostać dodany w strefie wyszukiwania do przodu, aby skojarzyć nazwę domeny DNS z adresem IP?

W technologii Ethernet 100Base-TX do przesyłania danych używane są żyły kabla UTP podłączone do pinów:

Programem służącym do archiwizacji danych w systemie Linux jest

W schemacie logicznym struktury okablowania, zgodnie z polską terminologią zawartą w normie PN-EN 50174, cechą kondygnacyjnego punktu dystrybucyjnego jest to, że

Aby wykonać ręczne ustawienie interfejsu sieciowego w systemie LINUX, należy użyć polecenia

Program do monitorowania, który umożliwia przechwytywanie, nagrywanie oraz dekodowanie różnych pakietów sieciowych to

Aby zabezpieczyć system przed atakami z sieci nazywanymi phishingiem, nie powinno się

Każdorazowo automatycznie szyfrowany staje się plik, który został zaszyfrowany przez użytkownika za pomocą systemu NTFS 5.0, w momencie

Który z protokołów pełni rolę protokołu połączeniowego?

Zużyty sprzęt elektryczny lub elektroniczny, na którym znajduje się symbol zobrazowany na ilustracji, powinien być

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jak powinno być usytuowanie gniazd komputerowych RJ45 względem powierzchni biurowej zgodnie z normą PN-EN 50174?

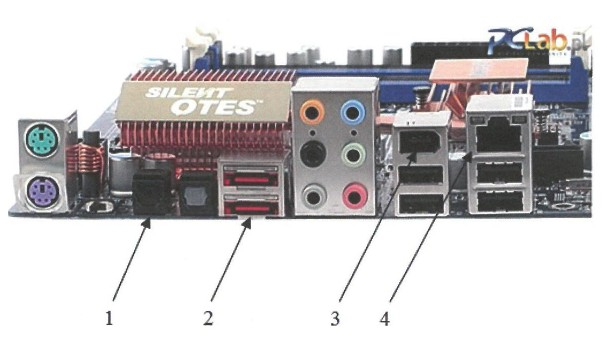

Który z portów na zaprezentowanej płycie głównej umożliwia podłączenie zewnętrznego dysku przez interfejs e-SATA?

Gdzie w dokumencie tekstowym Word umieszczony jest nagłówek oraz stopka?

Na płycie głównej z chipsetem Intel 865G

W systemie Windows przypadkowo usunięto konto użytkownika, ale katalog domowy pozostał. Czy możliwe jest odzyskanie niezaszyfrowanych danych z katalogu domowego tego użytkownika?

W systemie Linux do obserwacji działania sieci, urządzeń sieciowych oraz serwerów można zastosować aplikację

Która z wymienionych czynności konserwacyjnych związana jest wyłącznie z drukarką laserową?

Aby poprawić wydajność procesora serii Intel za pomocą 'podkręcania' (ang. overclocking), należy użyć procesora oznaczonego

Aby uzyskać uprawnienia administratora w systemie Linux, należy w terminalu wpisać polecenie

Jaki typ grupy jest automatycznie przypisany dla nowo tworzonej grupy w kontrolerze domeny systemu Windows Server?

Odmianą pamięci, która jest tylko do odczytu i można ją usunąć za pomocą promieniowania ultrafioletowego, jest pamięć

Protokół TCP (Transmission Control Protocol) funkcjonuje w trybie

Standardowe napięcie zasilające dla modułów pamięci RAM DDR4 wynosi

Jak nazywa się bezklasowa metoda podziału przestrzeni adresowej IPv4?

Jaką najwyższą liczbę urządzeń można przypisać w sieci z adresacją IPv4 klasy C?

Polecenie to zostało wydane przez Administratora systemu operacyjnego w trakcie ręcznej konfiguracji sieciowego interfejsu. Wynikiem wykonania tego polecenia jest ```netsh interface ip set address name="Glowna" static 151.10.10.2 255.255.0.0 151.10.0.1```

Największą pojemność spośród nośników optycznych posiada płyta

W celu zapewnienia jakości usługi QoS, w przełącznikach warstwy dostępu stosuje się mechanizm

Zbiór usług sieciowych dla systemów z rodziny Microsoft Windows jest reprezentowany przez skrót

Moc zasilacza wynosi 450 W, co oznacza, że