Pytanie 1

Jakie urządzenie należy wykorzystać w sieci Ethernet, aby zredukować liczbę kolizji pakietów?

Wynik: 28/40 punktów (70,0%)

Wymagane minimum: 20 punktów (50%)

Jakie urządzenie należy wykorzystać w sieci Ethernet, aby zredukować liczbę kolizji pakietów?

Który z poniższych programów NIE służy do testowania sieci komputerowej w celu wykrywania problemów?

Na ilustracji zaprezentowano końcówkę kabla

W dokumentacji technicznej efektywność głośnika podłączonego do komputera wyraża się w jednostce

Która funkcja serwera Windows umożliwia użytkownikom końcowym sieci pokazanej na rysunku dostęp do Internetu?

W ramce przedstawiono treść jednego z plików w systemie operacyjnym MS Windows. Jest to plik

| [boot loader] Time out=30 Default=Multi(0)disk(0)rdisk(0)partition(1)WINDOWS [operating system] Multi(0)disk(0)rdisk(0)partition(1)WINDOWS="Microsoft Windows XP Home Edition"/ fastdetect/NoExecute=OptOut |

Polecenie tar w systemie Linux służy do

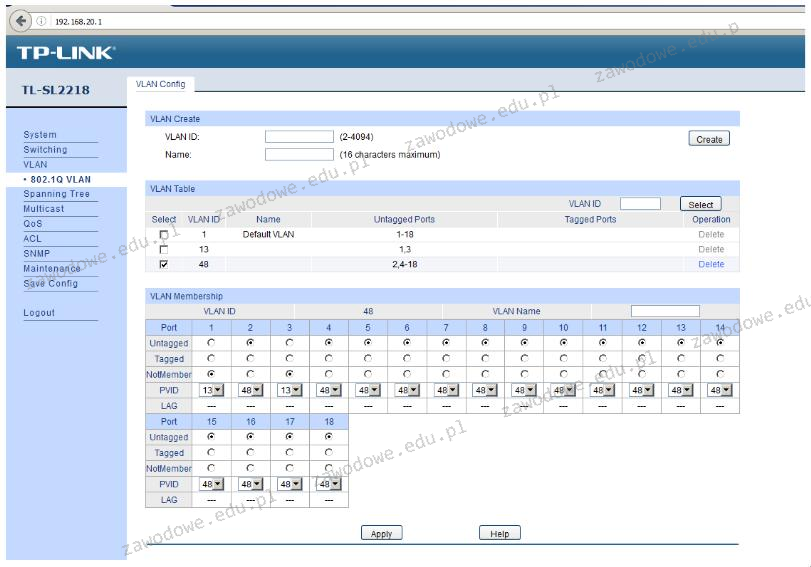

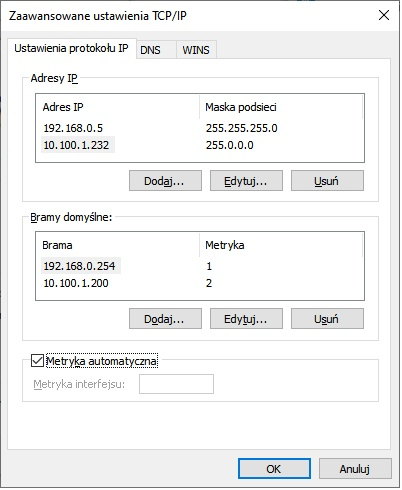

Na ilustracji zaprezentowano konfigurację urządzenia, co sugeruje, że

Obudowa oraz wyświetlacz drukarki fotograficznej są bardzo brudne. Jakie środki należy zastosować, aby je wyczyścić?

Każdy następny router IP na ścieżce pakietu

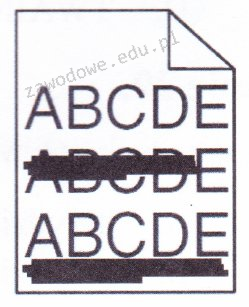

Co może być przyczyną problemów z wydrukiem z drukarki laserowej przedstawionych na ilustracji?

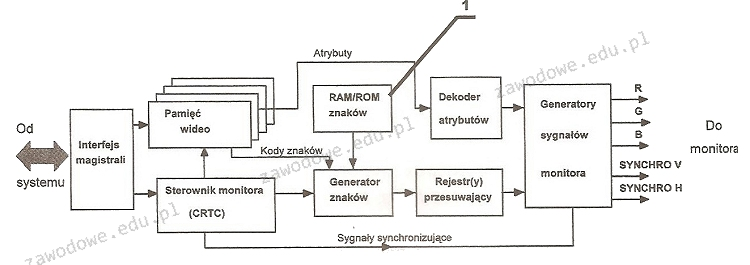

Element oznaczony cyfrą 1 na diagramie blokowym karty graficznej?

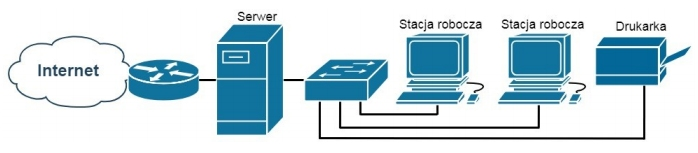

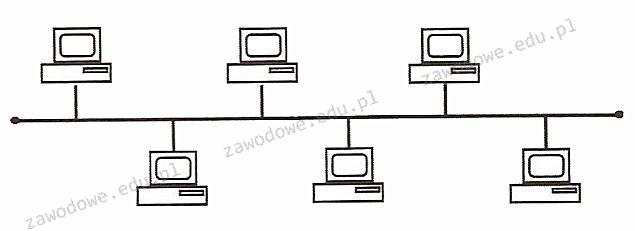

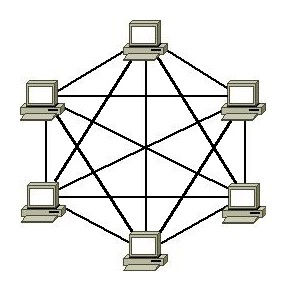

Na ilustracji ukazano sieć o układzie

Najwyższą prędkość transmisji danych w sieci bezprzewodowej zapewnia standard

Funkcja systemu operacyjnego, która umożliwia jednoczesne uruchamianie wielu aplikacji w trybie podziału czasu, z tym że realizacja tego podziału odbywa się przez same aplikacje, nosi nazwę

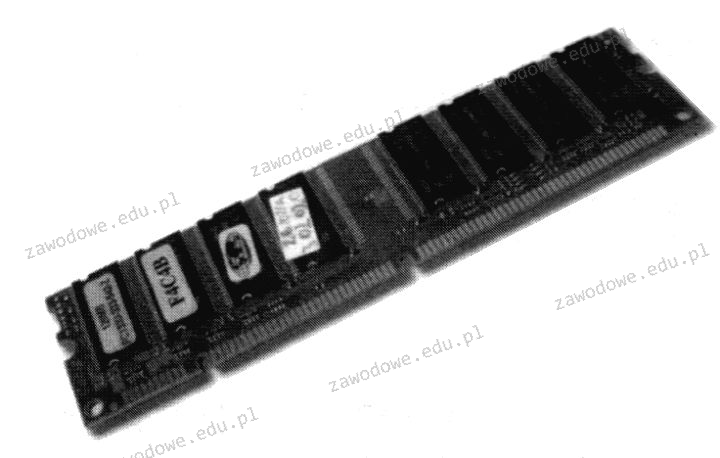

Na fotografii ukazana jest pamięć o 168 stykach

Narzędziem wykorzystywanym do diagnozowania połączeń między komputerami w systemie Windows jest

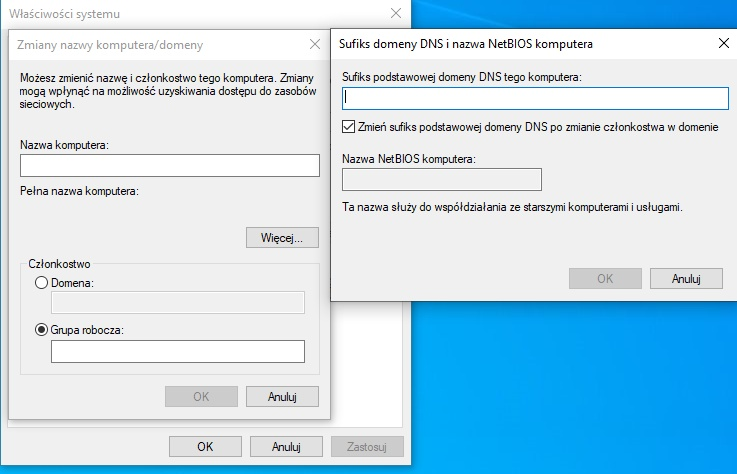

Aby podłączyć stację roboczą z zainstalowanym systemem Windows do domeny zst.local należy

Aby skaner działał prawidłowo, co należy zrobić?

Jaka usługa musi być aktywna na serwerze, aby stacja robocza mogła automatycznie uzyskać adres IP?

Karta sieciowa przedstawiona na ilustracji jest w stanie przesyłać dane z maksymalną szybkością

Na podstawie przedstawionej na ilustracji konfiguracji, w przypadku, gdy komputer żąda połączenia z inną siecią, w pierwszej kolejności dane zostaną wysłane do urządzenia o adresie

Jakiego rodzaju adresację stosuje protokół IPv6?

Na zdjęciu widać kartę

Jakie oprogramowanie dostarcza najwięcej informacji diagnostycznych na temat procesora CPU?

W technologii Ethernet 100Base-TX do przesyłania danych używane są żyły kabla UTP podłączone do pinów:

W sieci o adresie 192.168.20.0 użyto maski podsieci 255.255.255.248. Jak wiele adresów IP będzie dostępnych dla urządzeń?

Jak określamy atak na sieć komputerową, który polega na łapaniu pakietów przesyłanych w sieci?

Jak nazywa się protokół warstwy transportowej modelu TCP/IP, który nie gwarantuje dostarczenia danych?

Jakiego rodzaju fizyczna topologia sieci komputerowej jest zobrazowana na rysunku?

W interfejsie graficznym systemów Ubuntu lub SuSE Linux, aby zainstalować aktualizacje programów systemowych, można zastosować aplikacje

Jaki będzie najniższy koszt zakupu kabla UTP, potrzebnego do okablowania kategorii 5e, aby połączyć panel krosowniczy z dwoma podwójnymi gniazdami natynkowymi 2 x RJ45, które są oddalone odpowiednio o 10 m i 20 m od panelu, jeśli cena 1 m kabla wynosi 1,20 zł?

Adres IP przydzielony komputerowi pozwala odbiorcy pakietu IP na odróżnienie identyfikatorów

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

W sieci z maską 255.255.255.128 można przypisać adresy dla

Po włączeniu komputera na ekranie wyświetlił się komunikat "Non-system disk or disk error. Replace and strike any key when ready". Możliwą przyczyną tego może być

Jakiego typu wkrętak należy użyć do wypięcia dysku twardego mocowanego w laptopie za pomocą podanych śrub?

Pliki specjalne urządzeń, tworzone podczas instalacji sterowników w systemie Linux, są zapisywane w katalogu

Jaką wartość ma moc wyjściowa (ciągła) zasilacza według parametrów przedstawionych w tabeli?

| Napięcie wyjściowe | +5 V | +3.3 V | +12 V1 | +12 V2 | -12 V | +5 VSB |

| Prąd wyjściowy | 18,0 A | 22,0 A | 18,0 A | 17,0 A | 0,3 A | 2,5 A |

| Moc wyjściowa | 120 W | 336W | 3,6 W | 12,5 W |

Program firewall nie zapewnia ochrony przed