Pytanie 1

Aby skonfigurować i dostosować środowisko graficzne GNOME w różnych dystrybucjach Linux, należy użyć programu

Wynik: 32/40 punktów (80,0%)

Wymagane minimum: 20 punktów (50%)

Aby skonfigurować i dostosować środowisko graficzne GNOME w różnych dystrybucjach Linux, należy użyć programu

Jakie złącze powinna mieć karta graficzna, aby mogła być bezpośrednio podłączona do telewizora LCD, który ma tylko analogowe złącze do komputera?

Jaki interfejs umożliwia transfer danych w formie cyfrowej i analogowej między komputerem a monitorem?

Tworzenie obrazu dysku ma na celu

Który z wymienionych protokołów jest szyfrowanym protokołem do zdalnego dostępu?

Czym jest parametr, który określa, o ile moc sygnału w danej parze przewodów zmniejszy się po przejściu przez cały tor kablowy?

W przypadku wpisania adresu HTTP w przeglądarkę internetową pojawia się błąd "403 Forbidden", co oznacza, że

Aby sygnały pochodzące z dwóch routerów w sieci WiFi pracującej w standardzie 802.11g nie wpływały na siebie nawzajem, należy skonfigurować kanały o numerach

Jaka jest maksymalna prędkość transferu danych w sieci lokalnej, w której zastosowano przewód UTP kat.5e do budowy okablowania strukturalnego?

Jaki akronim oznacza wydajność sieci oraz usługi, które mają na celu między innymi priorytetyzację przesyłanych pakietów?

W topologii gwiazdy każde urządzenie działające w sieci jest

W dokumentacji powykonawczej dotyczącej fizycznej oraz logicznej struktury sieci lokalnej powinny być zawarte

Który z protokołów jest używany podczas rozpoczynania sesji VoIP?

Domyślny port, na którym działa usługa "Pulpit zdalny", to

Jaka usługa musi być aktywna na serwerze, aby stacja robocza mogła automatycznie uzyskać adres IP?

Aby przeprowadzić instalację bez nadzoru w systemie Windows, konieczne jest przygotowanie pliku odpowiedzi o nazwie

Karta sieciowa przedstawiona na ilustracji jest w stanie przesyłać dane z maksymalną szybkością

Jaką liczbę bitów posiada adres logiczny IPv6?

Cechą charakterystyczną transmisji za pomocą interfejsu równoległego synchronicznego jest to, że

Użycie skrętki kategorii 6 (CAT 6) o długości 20 metrów w sieci LAN oznacza jej maksymalną przepustowość wynoszącą

Jakie narzędzie służy do obserwacji zdarzeń w systemie Windows?

W systemie Windows odpowiednikiem macierzy RAID 1 jest wolumin o nazwie

Komputery K1, K2, K3, K4 są podłączone do interfejsów przełącznika, które są przypisane do VLAN-ów wymienionych w tabeli. Które z tych komputerów mają możliwość komunikacji ze sobą?

| Nazwa komputera | Adres IP | Nazwa interfejsu | VLAN |

| K1 | 10.10.10.1/24 | F1 | VLAN 10 |

| K2 | 10.10.10.2/24 | F2 | VLAN 11 |

| K3 | 10.10.10.3/24 | F3 | VLAN 10 |

| K4 | 10.10.11.4/24 | F4 | VLAN 11 |

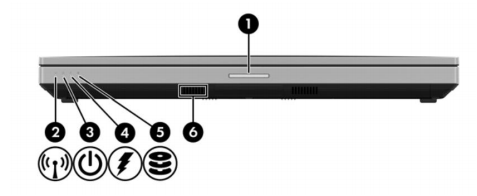

Na ilustracji widoczne jest oznaczenie sygnalizacji świetlnej w dokumentacji technicznej laptopa. Wskaż numer odpowiadający kontrolce, która zapala się podczas ładowania akumulatora?

W którym systemie operacyjnym może pojawić się komunikat podczas instalacji sterowników dla nowego urządzenia?

| System.......nie może zweryfikować wydawcy tego sterownika. Ten sterownik nie ma podpisu cyfrowego albo podpis nie został zweryfikowany przez urząd certyfikacji. Nie należy instalować tego sterownika, jeżeli nie pochodzi z oryginalnego dysku producenta lub od administratora systemu. |

Jakie zastosowanie ma przedstawione narzędzie?

Drukarka, która zapewnia zdjęcia o wysokiej jakości to drukarka

Jakie urządzenie umożliwia połączenie sieci lokalnej z siecią rozległą?

W nowoczesnych panelach dotykowych prawidłowe działanie wyświetlacza zapewnia mechanizm rozpoznający zmianę

Na podstawie danych przedstawionych w tabeli dotyczącej twardego dysku, ustal, który z wniosków jest poprawny?

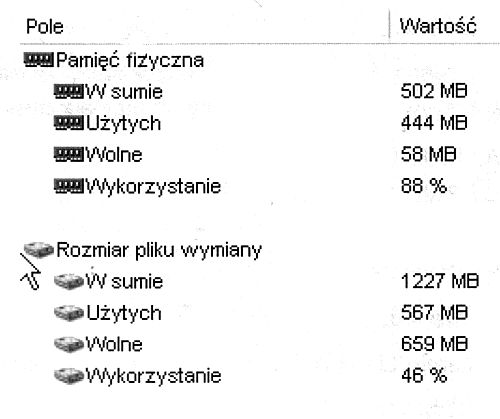

Zgodnie z zamieszczonym fragmentem testu w systemie komputerowym zainstalowane są

Który adres IPv4 identyfikuje urządzenie działające w sieci z adresem 14.36.64.0/20?

W nagłówku ramki standardu IEEE 802.3, który należy do warstwy łącza danych, znajduje się

Jakie urządzenie jest używane do pomiaru napięcia w zasilaczu?

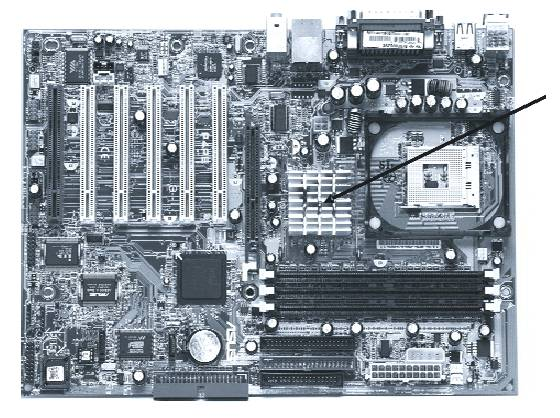

Na ilustracji pokazano płytę główną komputera. Strzałką wskazano

W celu zbudowania sieci komputerowej w danym pomieszczeniu wykorzystano 25 metrów kabli UTP, 5 gniazd RJ45 oraz odpowiednią liczbę wtyków RJ45 potrzebnych do stworzenia 5 kabli połączeniowych typu patchcord. Jaki jest całkowity koszt zastosowanych materiałów do budowy sieci? Ceny jednostkowe materiałów są przedstawione w tabeli.

| Material | Jednostka miary | Cena |

|---|---|---|

| Skrętka UTP | m | 1 zł |

| Gniazdo RJ45 | szt. | 10 zł |

| Wtyk RJ45 | szt. | 50 gr |

Której komendy wiersza poleceń z opcji zaawansowanych naprawy systemu Windows należy użyć, aby naprawić uszkodzony MBR dysku?

Do jednoczesnej zmiany tła pulpitu, kolorów okien, dźwięków oraz wygaszacza ekranu na komputerze z zainstalowanym systemem Windows należy wykorzystać

Magistrala PCI-Express wykorzystuje do transmisji danych metodę komunikacji

Które urządzenie może zostać wykorzystane do rutowania ruchu sieciowego między sieciami VLAN?