Pytanie 1

Urządzenie, które pozwala komputerom na bezprzewodowe łączenie się z siecią komputerową przewodową, to

Wynik: 29/40 punktów (72,5%)

Wymagane minimum: 20 punktów (50%)

Urządzenie, które pozwala komputerom na bezprzewodowe łączenie się z siecią komputerową przewodową, to

Jakiego rodzaju papieru należy użyć, aby wykonać "naprasowankę" na T-shircie z własnym zdjęciem przy pomocy drukarki atramentowej?

Jakie polecenie powinno zostać użyte, aby wyświetlić listę pokazanych plików?

Jak można skonfigurować interfejs sieciowy w systemie Linux, modyfikując plik

Miarą wyrażaną w decybelach, która określa różnicę pomiędzy mocą sygnału wysyłanego w parze zakłócającej a mocą sygnału generowanego w parze zakłócanej, jest

ACPI to akronim, który oznacza

Który standard z rodziny IEEE 802 odnosi się do sieci bezprzewodowych, zwanych Wireless LAN?

Okablowanie pionowe w sieci strukturalnej łączy się

Która z wymienionych czynności konserwacyjnych związana jest wyłącznie z drukarką laserową?

Aby odzyskać dane ze sformatowanego dysku twardego, należy wykorzystać program

Na których urządzeniach do przechowywania danych uszkodzenia mechaniczne są najczęściej spotykane?

Jakiego działania nie wykonują serwery plików?

Tryb pracy portu równoległego, bazujący na magistrali ISA, umożliwiający transfer danych do 2,4 MB/s, dedykowany dla skanerów i urządzeń wielofunkcyjnych, to

Jakie narzędzie w systemie Windows Server umożliwia zarządzanie zasadami grupy?

Który z wymienionych składników zalicza się do elementów pasywnych sieci?

Jakie procesory można wykorzystać w zestawie komputerowym z płytą główną wyposażoną w gniazdo procesora typu Socket AM3?

Jakie polecenie w systemie Linux umożliwia wyświetlenie zawartości katalogu?

Aby oddzielić komputery pracujące w sieci z tym samym adresem IPv4, które są podłączone do przełącznika zarządzalnego, należy przypisać

Który podzespół nie jest kompatybilny z płytą główną MSI A320M Pro-VD-S socket AM4, 1 x PCI-Ex16, 2 x PCI-Ex1, 4 x SATA III, 2 x DDR4- max 32 GB, 1 x D-SUB, 1x DVI-D, ATX?

Do usunięcia kurzu z wnętrza obudowy drukarki fotograficznej zaleca się zastosowanie

Aby określić długość prefiksu w adresie IPv4, należy ustalić

Ile minimalnie pamięci RAM powinien mieć komputer, aby możliwe było uruchomienie 32-bitowego systemu operacyjnego Windows 7 w trybie graficznym?

Który protokół odpowiada za bezpieczne przesyłanie danych w sieciach komputerowych?

Ile adresów IP można wykorzystać do adresowania komputerów w sieci o adresie 192.168.100.0 oraz masce 255.255.255.0?

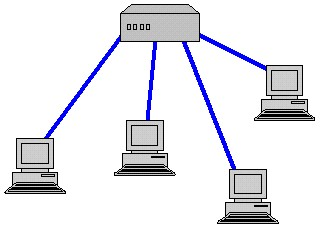

Jaką topologię fizyczną sieci ukazuje przedstawiony rysunek?

Która norma określa parametry transmisji dla komponentów kategorii 5e?

Transmisja w standardzie 100Base-T korzysta z kabli skrętkowych, które mają

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Co nie ma wpływu na utratę danych z dysku HDD?

Emisja dźwięków: jednego długiego oraz dwóch krótkich przez BIOS firmy AMI wskazuje na

Jakie znaczenie mają zwory na dyskach z interfejsem IDE?

Jakie zakresy częstotliwości określa klasa EA?

Element trwale zainstalowany, w którym znajduje się zakończenie poziomego okablowania strukturalnego abonenta, to

Atak DDoS (z ang. Distributed Denial of Service) na serwer może spowodować

Do czego służy program CHKDSK?

W systemie Linux narzędzie top pozwala na

Które z poniższych stwierdzeń na temat protokołu DHCP jest poprawne?

Pamięć, która działa jako pośrednik pomiędzy pamięcią operacyjną a procesorem o dużej prędkości, to

Zamiana baterii jest jedną z czynności związanych z użytkowaniem

Jaką pojemność ma dwuwarstwowa płyta Blu-ray?