Pytanie 1

Aby dodać nowe konto „rejestracja” w systemie Windows, należy wykorzystać polecenie

Wynik: 38/40 punktów (95,0%)

Wymagane minimum: 20 punktów (50%)

Aby dodać nowe konto „rejestracja” w systemie Windows, należy wykorzystać polecenie

Który zasilacz pozwala na tymczasowe utrzymanie zasilania akumulatorowego w razie braku zasilania sieciowego?

Na rysunku przedstawiono urządzenie z dodatkową kartą pamięci. Który rodzaj karty może zostać zastosowany w urządzeniu?

Technologia dual channel dotyczy pracy dwóch takich samych

W programowaniu, aby przerwać wykonywanie pętli i wyjść z niej, należy użyć polecenia

W dokumentacji Medycznego Systemu Informatycznego zapisano, że „przed użyciem programów instalacyjnych należy się upewnić, że niektóre porty w środowisku są dostępne do użycia z instalowanym oprogramowaniem pośrednim.” W celu sprawdzenia dostępności portu należy użyć programu narzędziowego

Ile elektrod wykorzystuje się podczas wykonywania standardowego badania EKG przy pomocy 12 odprowadzeń?

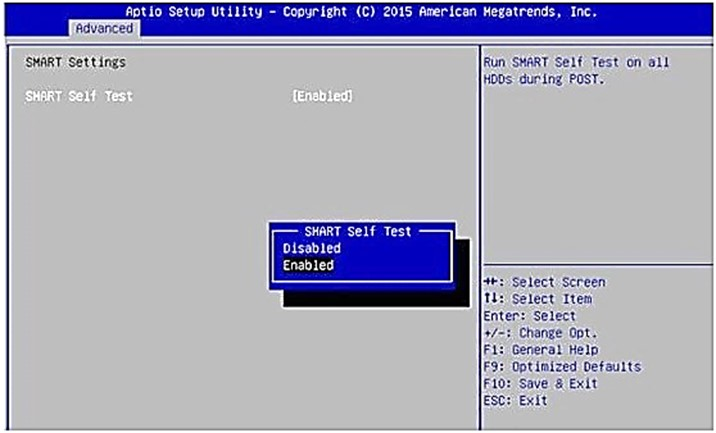

Jaką funkcję pełni przedstawiona na rysunku procedura BIOS?

Zapisana w ramce funkcja zawiera

| Funkcja oblicz(n) Jeżeli n=0 oblicz=1 W przeciwnym wypadku oblicz=(n-1)*oblicz(n-1) |

Które polecenie umożliwia śledzenie drogi pakietów w sieci?

Jaki format danych należy zastosować do archiwizacji, kompresji i szyfrowania danych?

W celu rejestracji promieniowania radioizotopu nagromadzonego w narządach stosowana jest

W dokumencie urządzenia elektroniki medycznej podano następujące informacje:

Interfejs obrazu DICOM • Maksymalna szybkość przesyłania wg standardu Ethernet: 100 Mb/s. • Szybkość przesyłania obrazów: 2 MB/s. Interfejs RIS/CIS zgodny z DICOM • Maksymalna szybkość przesyłania wg standardu Ethernet: 100 Mb/s. |

Podczas uruchamiania komputera procedura POST testuje poprawność działania

Zaćma fotochemiczna jest wywoływana promieniowaniem

Zabieg diametrii krótkofalowej powoduje

Które ustawienie należy wybrać na multimetrze w celu pomiaru napięcia 12 V w obwodzie prądu stałego?

Technologia OLED znajduje zastosowanie w

Który system plików jest dedykowany systemowi Linux oraz nie jest używany w systemie Windows?

Pierwszym krokiem podczas prac serwisowych wymagających modyfikowania rejestru w systemie Windows jest wykonanie

Parametr CL (czas opóźnienia, jaki upływa między wysłaniem przez kontroler RAM żądania dostępu do kolumny pamięci a otrzymaniem danych z tej kolumny) jest wyrażany w

Pojęcie „Architektura Harvardska” odnosi się do

Operacje stałoprzecinkowe w procesorze wykonuje jednostka oznaczona jako

Który sterownik odpowiada za bezpośredni dostęp do pamięci?

W jakim celu stosuje się Standard HL7 (Health Level Seven)?

Który podzespół komputerowy posiada obudowę o zamieszczonej specyfikacji?

| Specyfikacja obudowy | |

|---|---|

| Obsługiwane gniazda | LGA775 |

| TCASE | 71,4°C |

| Wymiary obudowy | 37,5 mm x 37,5 mm |

| Rozmiar płytki półprzewodnikowej | 214 mm² |

| Liczba tranzystorów płytki półprzewodnikowej | 820 milion |

| Dostępne opcje obniżonej zawartości halogenków | Patrz MDDS |

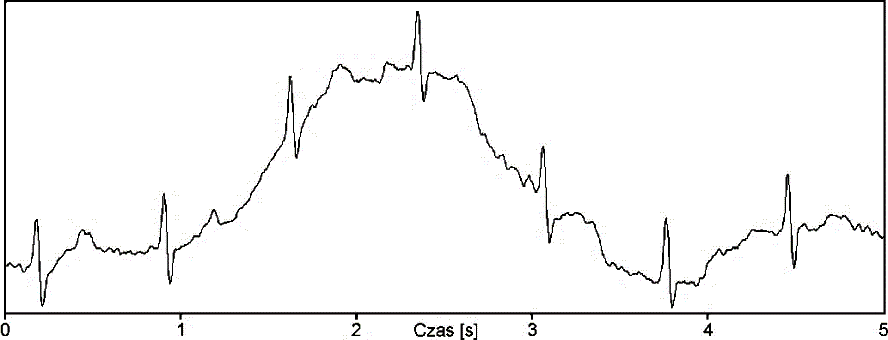

Z elektrokardiogramu wynika, że rytm serca rejestrowany i wskazywany przez elektrokardiograf wynosi

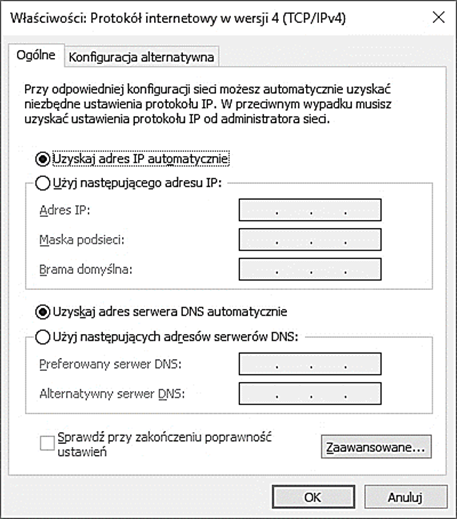

Aby karta sieciowa automatycznie uzyskiwała adres IP, ruter musi mieć włączony serwer

Niezbędna jest archiwizacja danych na płycie Blue-Ray jednokrotnego zapisu. Płyta taka ma oznaczenie

W jakim celu stosuje się podział użytkowników na grupy w systemie operacyjnym?

Które polecenie SQL nie modyfikuje tabeli bazy danych?

Które polecenie SQL służy do utworzenia bazy danych?

W celu archiwizacji danych w systemie Windows, jest wymagane kopiowanie z katalogu źródłowego (kat_zrodlowy) do katalogu docelowego (kat_docelowy). Do kopiowania danych należy użyć polecenia

Aby zapobiec utracie danych w programie obsługi przychodni, należy codziennie wykonywać

W programowaniu obiektowym zmienne widoczne w ramach klasy oraz poza nią nazywane są

Jaki wpływ na organizm ludzki ma promieniowanie podczerwone IR?

Na zdjęciu przedstawiono

Najważniejszą cechą pamięci operacyjnych serwerowych jest ich niezawodność, dlatego powinny być wyposażone w mechanizm kontroli błędów określany skrótem

W celu przerwania działania funkcji i powrotu do miejsca jej wywołania należy użyć instrukcji

Podczas wymiany podzespołów elektronicznych czułych na wyładowania elektrostatyczne należy zastosować