Pytanie 1

Który zabieg wymusza naprzemienną pracę mięśni zginaczy i prostowników poprzez stymulację mięśni impulsem prądowym?

Wynik: 40/40 punktów (100,0%)

Wymagane minimum: 20 punktów (50%)

Który zabieg wymusza naprzemienną pracę mięśni zginaczy i prostowników poprzez stymulację mięśni impulsem prądowym?

Które oznaczenie określa zapis elektryczny aktywności mózgu?

Zasilacz, który podczas normalnej pracy zasila urządzenie, jednocześnie ładując akumulator, a podczas awarii zasilania sieciowego zasila urządzenie z akumulatora, oznaczany jest skrótem

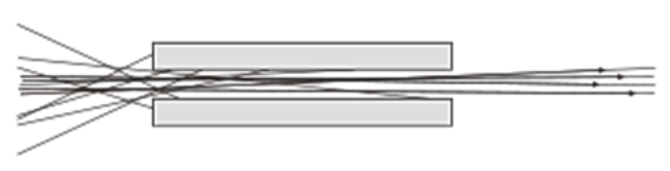

Przedstawiony na rysunku kolimator stanowi część

Na którym rysunku przedstawiony jest interfejs zapewniający najwyższą prędkość transferu urządzeń elektroniki medycznej?

Do badań ultrasonograficznych struktur płytko położonych (np. tarczycy) stosuje się głowicę

Jakiego typu papier należy zastosować w aparacie elektrokardiograficznym?

Symbole: 1U, 2U, 3U stosowane do oznaczenia modułów w szafach typu rack określają

Ile elektrod wykorzystuje się podczas wykonywania standardowego badania EKG przy pomocy 12 odprowadzeń?

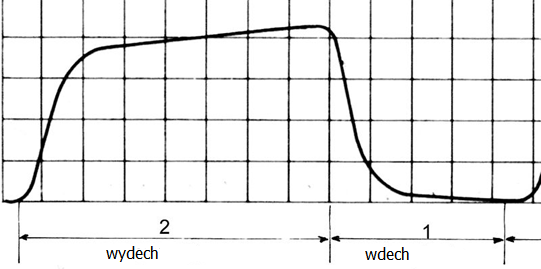

Stężenie którego gazu z wydychanego powietrza prezentuje kapnogram?

Który przyrząd należy wybrać celem sprawdzenia poprawnej prędkości transmisji danych na łączu RS232 urządzenia elektroniki medycznej?

Która tkanka najsilniej pochłania fale ultradźwiękowe?

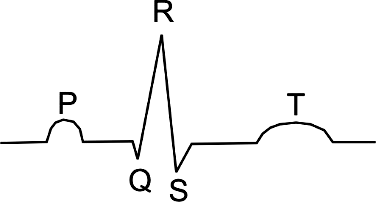

W sygnale elektrokardiograficznym za repolaryzację mięśnia komór odpowiada załamek

Na zdjęciu RTG najjaśniejsze pole stanowi tkanka kostna, przez którą promieniowanie rentgenowskie jest

Największą zdolność pochłaniania promieniowania rentgenowskiego o energii 60–160 keV wykazuje tkanka

Promieniowanie IR jest wykorzystywane w

Prezentacja A, B, M jest charakterystyczna dla badania

Jaki wpływ na organizm ludzki ma promieniowanie podczerwone IR?

W dokumentacji testera aparatury medycznej podano następujące informacje:

|

Wybierz narzędzie służące do zamocowania przedstawionej na rysunku końcówki kompresyjnej F na kablu koncentrycznym.

Do pomiaru częstotliwości rezonansowej generatora kwarcowego w kardiotokografii należy zastosować

Do kruszenia kamieni w pęcherzu moczowym stosowane są fale

Materiałem eksploatacyjnym w drukarce laserowej jest

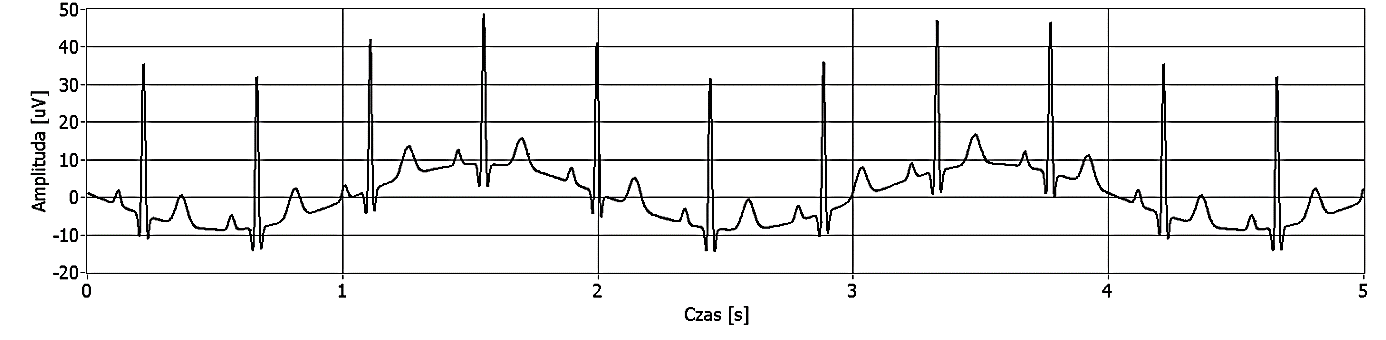

Podczas testowania elektrokardiografu otrzymano przedstawiony przebieg. Na jego podstawie stwierdzono, że nieprawidłowo działa filtr zakłóceń

Czujnik tensometryczny i sonda ultradźwiękowa są elementami aparatu

Na rysunku przedstawiono urządzenie z dodatkową kartą pamięci. Który rodzaj karty może zostać zastosowany w urządzeniu?

Przepływ przez organizm człowieka prądów o wysokiej częstotliwości, mających zastosowanie w elektrochirurgii, może powodować

Zaćma fotochemiczna jest wywoływana promieniowaniem

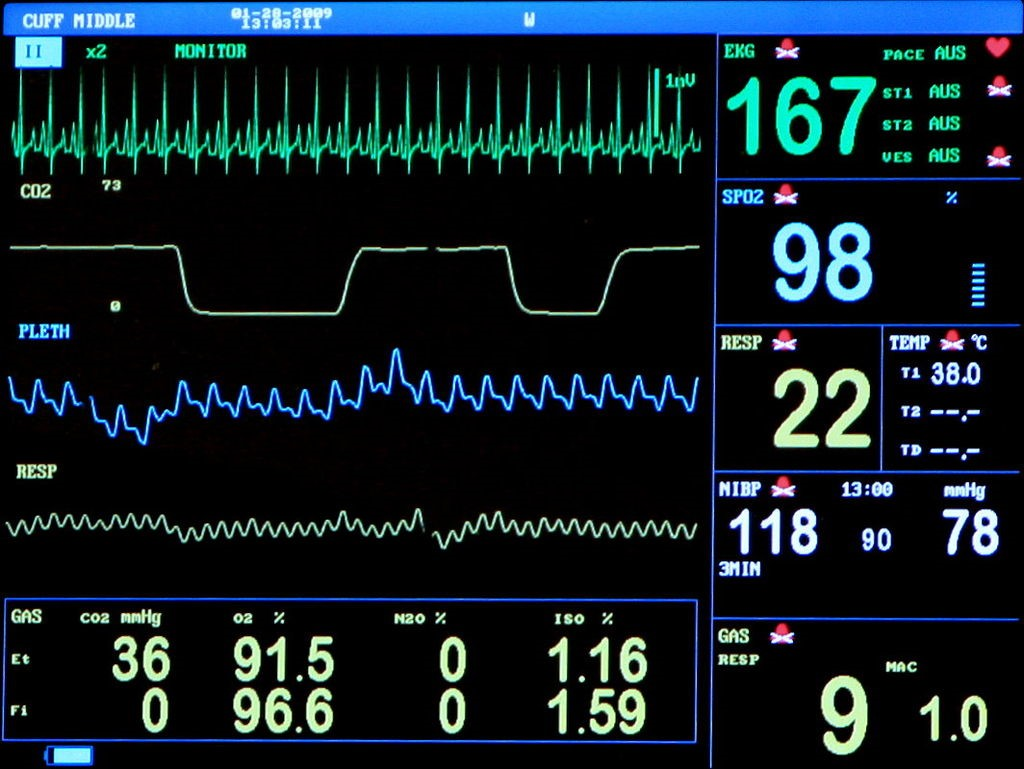

Z ekranu urządzenia wynika, że pełni ono między innymi funkcję

Które urządzenie medyczne wspomaga lub zastępuje mięśnie pacjenta w oddychaniu?

Urządzenie, którego dotyczy fragment podanej specyfikacji, jest przystosowane do

| ■ Architektura sieci LAN: | Wireless IEEE 802.11ac, Wireless IEEE 802.11a, Wireless IEEE 802.11b, Wireless IEEE 802.11g, Wireless IEEE 802.11n |

| ■ Dodatkowe informacje: | PoE, RJ-45 Serial |

| ■ Typ urządzenia: | Bezprzewodowy kontroler |

| ■ Typ złącza anteny zewnętrznej: | 3x3 MIMO |

Który rodzaj promieniowania jonizującego jest całkowicie pochłaniany przez naskórek, nie docierając do głębszych warstw tkanek?

Do pomiaru objętości i pojemności płuc w różnych fazach cyklu oddechowego służy

Zapis w dokumentacji układu holterowskiego „metoda pomiaru – oscylometryczna” świadczy o możliwości monitorowania

W dokumentacji skanera zapisano „rozdzielczość optyczna 600 x 600 [dpi]”. Skrót dpi określa liczbę punktów

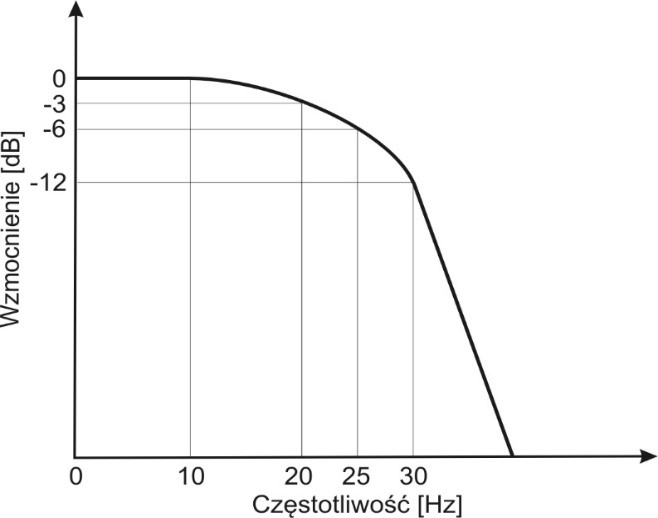

W urządzeniu medycznym wyznaczono charakterystykę filtru jak na rysunku. Jest to filtr

Dla której wartości z wymienionych rezystancji, zastosowanie układu poprawnie mierzonego prądu zapewnia najmniejszy błąd pomiaru?

Na zdjęciu przedstawiono

Ilość jodu-131 podana pacjentowi w terapii tarczycy zmniejszy się o połowę po

Membrana półprzepuszczalna jest podstawowym elementem