Pytanie 1

Jaką liczbę punktów abonenckich (2 x RJ45) zgodnie z wytycznymi normy PN-EN 50167 powinno się zainstalować w biurze o powierzchni 49 m2?

Wynik: 27/40 punktów (67,5%)

Wymagane minimum: 20 punktów (50%)

Jaką liczbę punktów abonenckich (2 x RJ45) zgodnie z wytycznymi normy PN-EN 50167 powinno się zainstalować w biurze o powierzchni 49 m2?

Urządzenie ADSL wykorzystuje się do nawiązania połączenia

Na ilustracji ukazano narzędzie systemu Windows 7 służące do

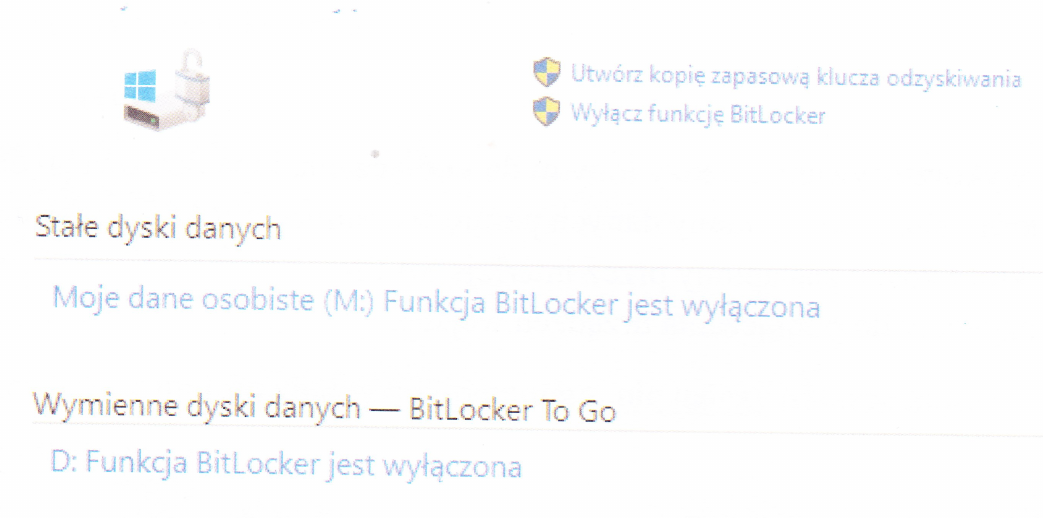

Wbudowane narzędzie dostępne w systemach Windows w edycji Enterprise lub Ultimate jest przeznaczone do

Aby procesor działał poprawnie, konieczne jest podłączenie złącza zasilania 4-stykowego lub 8-stykowego o napięciu

Umożliwienie stacjom roboczym Windows, OS X oraz Linux korzystania z usług drukowania Linuxa i serwera plików zapewnia serwer

Jaki pakiet powinien zostać zainstalowany na serwerze Linux, aby umożliwić stacjom roboczym z systemem Windows dostęp do plików i drukarek udostępnianych przez ten serwer?

Wydanie komendy chmod 400 nazwa_pliku w systemie Linux spowoduje, że właściciel pliku

Udostępniono w sieci lokalnej jako udział specjalny folder o nazwie egzamin znajdujący się na komputerze o nazwie SERWER_2 w katalogu głównym dysku C:. Jak powinna wyglądać ścieżka dostępu do katalogu egzamin, w którym przechowywany jest folder macierzysty dla konta użytkownika o określonym loginie?

Aby przeprowadzić diagnozę systemu operacyjnego Windows oraz stworzyć plik z listą wszystkich ładujących się sterowników, konieczne jest uruchomienie systemu w trybie

Płyta główna wyposażona w gniazdo G2 będzie współpracowała z procesorem

Aby stworzyć las w strukturze AD DS (Active Directory Domain Services), konieczne jest utworzenie przynajmniej

Karta rozszerzeń przedstawiona na zdjęciu dysponuje systemem chłodzenia

Do obserwacji stanu urządzeń w sieci wykorzystywane jest oprogramowanie operujące na podstawie protokołu

Aby w systemie Windows XP stworzyć nowego użytkownika o nazwisku egzamin z hasłem qwerty, powinno się zastosować polecenie

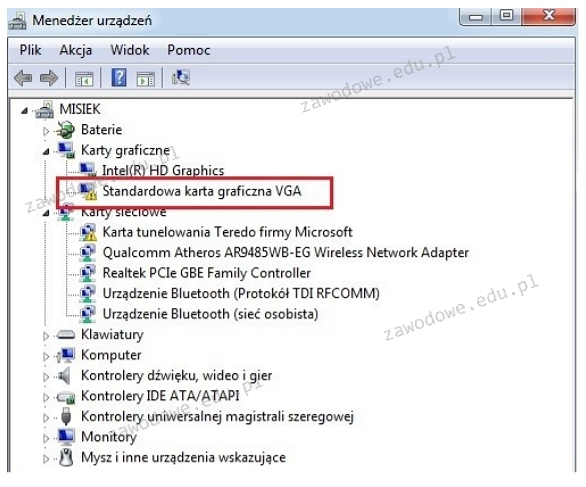

Na ilustracji ukazany jest komunikat systemowy. Jakie kroki powinien podjąć użytkownik, aby naprawić błąd?

W których nośnikach pamięci masowej uszkodzenia mechaniczne są najbardziej prawdopodobne?

Do usunięcia elementu Wszystkie programy z prostego Menu Start systemu Windows należy wykorzystać przystawkę

Do zarządzania przydziałami przestrzeni dyskowej w systemach Windows 7 oraz Windows 8 wykorzystywane jest narzędzie

W przypadku awarii którego urządzenia w sieci lokalnej, cała sieć przestaje działać w topologii magistrali?

Jakim parametrem definiuje się stopień zmniejszenia mocy sygnału w danej parze przewodów po przejściu przez cały tor kablowy?

Aby zapobiec uszkodzeniu sprzętu podczas modernizacji laptopa, która obejmuje wymianę modułów pamięci RAM, należy

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Której aplikacji należy użyć, aby sprawdzić parametry S.M.A.R.T.?

Jakie oznaczenie nosi wtyk powszechnie znany jako RJ45?

W celu zrealizowania instalacji sieciowej na stacjach roboczych z systemem operacyjnym Windows, należy na serwerze zainstalować usługi

W dokumentacji technicznej wydajność głośnika połączonego z komputerem wyraża się w jednostce:

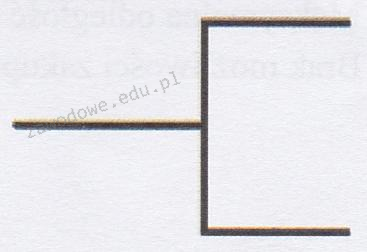

Co symbolizuje graficzny znak przedstawiony na ilustracji?

Do ilu sieci należą komputery o podanych w tabeli adresach IP i standardowej masce sieci?

| Komputer | Adres IP |

|---|---|

| Komputer 1 | 172.16.15.5 |

| Komputer 2 | 172.18.15.6 |

| Komputer 3 | 172.18.16.7 |

| Komputer 4 | 172.20.16.8 |

| Komputer 5 | 172.20.16.9 |

| Komputer 6 | 172.21.15.10 |

Adres MAC (Medium Access Control Address) to sprzętowy identyfikator karty sieciowej Ethernet w warstwie modelu OSI

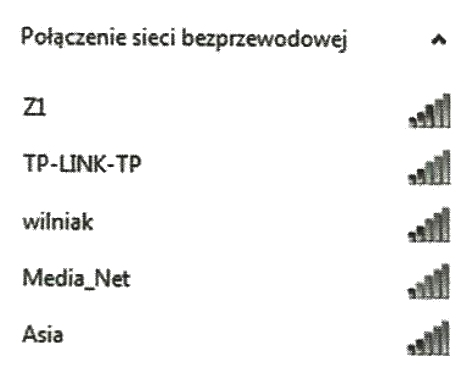

Użytkownik laptopa z systemem Windows 7 widzi dostępne sieci Wi-Fi, jak przedstawiono na ilustracji. Przy konfiguracji połączenia z siecią Z1 musi wprowadzić

Do podłączenia projektora multimedialnego do komputera, nie można użyć złącza

Do monitorowania aktywnych połączeń sieciowych w systemie Windows służy polecenie

Błąd typu STOP w systemie Windows (Blue Screen), który występuje w momencie, gdy system odwołuje się do niepoprawnych danych w pamięci RAM, to

Rejestr procesora, znany jako licznik rozkazów, przechowuje

Aby wyjąć dysk twardy zamocowany w laptopie przy użyciu podanych śrub, najlepiej zastosować wkrętak typu

Materiałem eksploatacyjnym stosowanym w drukarkach tekstylnych jest

Użytkownicy dysków SSD powinni unikać wykonywania następujących działań konserwacyjnych

Aktualizacja systemów operacyjnych to proces, którego głównym zadaniem jest

W dokumentacji jednego z komponentów komputera zawarto informację, że urządzenie obsługuje OpenGL. Jakiego elementu dotyczy ta dokumentacja?