Pytanie 1

Która pula adresów IPv6 jest odpowiednikiem adresów prywatnych w IPv4?

Wynik: 7/40 punktów (17,5%)

Wymagane minimum: 20 punktów (50%)

Która pula adresów IPv6 jest odpowiednikiem adresów prywatnych w IPv4?

Jaki element sieci SIP określamy jako telefon IP?

W dokumentacji dotyczącej karty dźwiękowej można znaleźć informację: częstotliwość próbkowania 22 kHz oraz rozdzielczość próbkowania 16 bitów. Jaka będzie przybliżona objętość pliku audio z 10-sekundowym nagraniem mono (jednokanałowym)?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Do automatycznej synchronizacji dokumentów redagowanych przez kilka osób w tym samym czasie, należy użyć

Największą pojemność spośród nośników optycznych posiada płyta

Jakie gniazdo w notebooku jest przeznaczone do podłączenia kamery cyfrowej przez interfejs i.Link?

Na ilustracji ukazano złącze zasilające

Proces aktualizacji systemów operacyjnych ma na celu przede wszystkim

Komputer z adresem IP 192.168.5.165 oraz maską podsieci 255.255.255.192 funkcjonuje w sieci o adresie

Podaj adres rozgłoszeniowy dla podsieci 86.10.20.64/26?

Jakie polecenie w systemie Linux służy do przypisania adresu IP oraz maski podsieci dla interfejsu eth0?

Która lokalizacja umożliwia utworzenie kopii zapasowej dysku systemowego Windows 11?

Aby odzyskać dane ze sformatowanego dysku twardego, należy wykorzystać program

Jakie urządzenie powinno być użyte w sieci Ethernet, aby zredukować liczbę kolizji pakietów?

Jakim wynikiem jest suma liczb binarnych 1001101 oraz 11001?

Jaki będzie najniższy koszt zakupu kabla UTP, potrzebnego do okablowania kategorii 5e, aby połączyć panel krosowniczy z dwoma podwójnymi gniazdami natynkowymi 2 x RJ45, które są oddalone odpowiednio o 10 m i 20 m od panelu, jeśli cena 1 m kabla wynosi 1,20 zł?

Jak wielu hostów można maksymalnie zaadresować w sieci lokalnej, mając do dyspozycji jeden blok adresów klasy C protokołu IPv4?

Protokół kontrolny z rodziny TCP/IP, który odpowiada między innymi za identyfikację usterek w urządzeniach sieciowych, to

Zabrudzony czytnik w napędzie optycznym powinno się czyścić

Uzyskanie przechowywania kopii często odwiedzanych witryn oraz zwiększenia bezpieczeństwa przez odfiltrowanie konkretnych treści w sieci Internet można osiągnąć dzięki

Element trwale zamontowany, w którym znajduje się zakończenie okablowania strukturalnego poziomego dla abonenta, to

W systemie Linux plik posiada uprawnienia ustawione na 541. Właściciel ma możliwość pliku

Jaką cechę posiada przełącznik sieciowy?

Informacje ogólne dotyczące zdarzeń systemowych w systemie Linux są zapisywane w

Wskaż standard protokołu wykorzystywanego do kablowego połączenia dwóch urządzeń

Watomierz jest stosowany do pomiaru

Pozyskiwanie materiałów z odpadów w celu ich ponownego użycia to

Część programu antywirusowego działająca w tle jako kluczowy element zabezpieczeń, mająca na celu nieustanne monitorowanie ochrony systemu komputerowego, to

Jakie funkcje posiada program tar?

Określ prawidłową sekwencję działań, które należy wykonać, aby nowy laptop był gotowy do użycia?

Przydzielaniem adresów IP w sieci zajmuje się serwer

Jaką konfigurację sieciową powinien mieć komputer, który jest częścią tej samej sieci LAN co komputer z adresem 10.8.1.10/24?

fps (ang. frames per second) odnosi się bezpośrednio do

Na świeżo zainstalowanym komputerze program antywirusowy powinno się zainstalować

Wskaż interfejsy płyty głównej widoczne na rysunku.

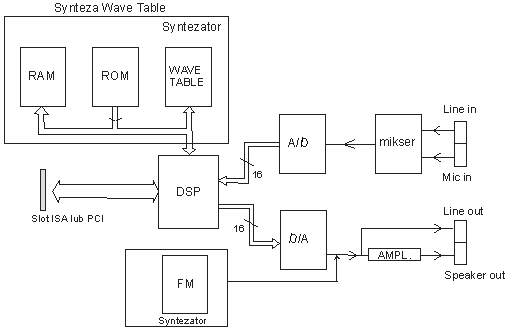

Który z elementów przedstawionych na diagramie karty dźwiękowej na rysunku jest odpowiedzialny za cyfrowe przetwarzanie sygnałów?

W systemie Linux można uzyskać kopię danych przy użyciu komendy

Jakie zakresy częstotliwości określa klasa EA?

W jaki sposób powinny być skonfigurowane uprawnienia dostępu w systemie Linux, aby tylko właściciel mógł wprowadzać zmiany w wybranym katalogu?