Pytanie 1

Program fsck jest stosowany w systemie Linux do

Wynik: 19/40 punktów (47,5%)

Wymagane minimum: 20 punktów (50%)

Program fsck jest stosowany w systemie Linux do

Jeżeli szybkość pobierania danych z sieci wynosi 8 Mb/s, to w ciągu 6 s możliwe jest pobranie pliku o maksymalnej wielkości równej

Odnalezienie głównego rekordu rozruchowego, wczytującego system z aktywnej partycji umożliwia

Aby ustalić fizyczny adres karty sieciowej, w terminalu systemu Microsoft Windows należy wpisać komendę

Zgodnie z zamieszczonym cennikiem, średni koszt wyposażenia stanowiska komputerowego wynosi:

| Nazwa sprzętu | Cena minimalna | Cena maksymalna |

|---|---|---|

| Jednostka centralna | 1300,00 zł | 4550,00 zł |

| Monitor | 650,00 zł | 2000,00 zł |

| Klawiatura | 28,00 zł | 100,00 zł |

| Myszka | 22,00 zł | 50,00 zł |

Jaką maksymalną długość kabla typu skrętka pomiędzy panelem krosowniczym a gniazdem abonenckim przewiduje norma PN-EN 50174-2?

Zaprezentowany schemat ilustruje funkcjonowanie

Który z protokołów NIE jest używany do ustawiania wirtualnej sieci prywatnej?

Jakie polecenie wykorzystano do analizy zaprezentowanej konfiguracji interfejsów sieciowych w systemie Linux?

enp0s25 Link encap:Ethernet HWaddr a0:b3:cc:28:8f:37 UP BROADCAST MULTICAST MTU:1500 Metric:1 RX packets:0 errors:0 dropped:0 overruns:0 frame:0 TX packets:0 errors:0 dropped:0 overruns:0 carrier:0 collisions:0 txqueuelen:1000 RX bytes:0 (0.0 B) TX bytes:0 (0.0 B) Interrupt:20 Memory:d4700000-d4720000 lo Link encap:Local Loopback inet addr:127.0.0.1 Mask:255.0.0.0 inet6 addr: ::1/128 Scope:Host UP LOOPBACK RUNNING MTU:65536 Metric:1 RX packets:172 errors:0 dropped:0 overruns:0 frame:0 TX packets:172 errors:0 dropped:0 overruns:0 carrier:0 collisions:0 txqueuelen:1000 RX bytes:13728 (13.7 KB) TX bytes:13728 (13.7 KB) wlo1 Link encap:Ethernet HWaddr 60:67:20:3f:91:22 inet addr:192.168.1.11 Bcast:192.168.1.255 Mask:255.255.255.0 inet6 addr: fe80::dcf3:c20b:57f7:21b4/64 Scope:Link UP BROADCAST RUNNING MULTICAST MTU:1500 Metric:1 RX packets:7953 errors:0 dropped:0 overruns:0 frame:0 TX packets:4908 errors:0 dropped:0 overruns:0 carrier:0 collisions:0 txqueuelen:1000 RX bytes:9012314 (9.0 MB) TX bytes:501345 (501.3 KB)

Jakie cechy posiadają procesory CISC?

Który z poniższych protokołów służy do zarządzania urządzeniami w sieciach?

Aby serwer z systemem Linux mógł udostępniać pliki i drukarki komputerom klienckim z systemem Windows, należy zainstalować na nim

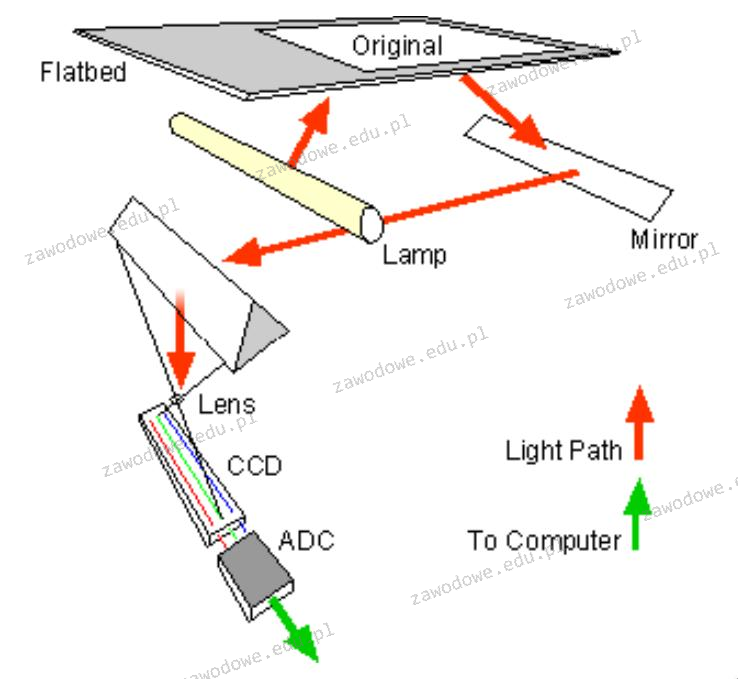

Na ilustracji zaprezentowane jest urządzenie, które to

Jakie jednostki stosuje się do wyrażania przesłuchu zbliżonego NEXT?

Osoba korzystająca z systemu operacyjnego Linux pragnie przypisać adres IP 152.168.1.200 255.255.0.0 do interfejsu sieciowego. Jakie polecenie powinna wydać, mając uprawnienia administratora?

Aby chronić urządzenia w sieci LAN przed przepięciami oraz różnicami potencjałów, które mogą się pojawić w trakcie burzy lub innych wyładowań atmosferycznych, należy zastosować

Jaki protokół jest stosowany przez WWW?

Jak można zwolnić miejsce na dysku, nie tracąc przy tym danych?

Jakiego rekordu DNS należy użyć w strefie wyszukiwania do przodu, aby powiązać nazwę domeny DNS z adresem IP?

Zgodnie z normą 802.3u w sieciach FastEthernet 100Base-FX stosuje się

Na wyświetlaczu drukarki pojawił się komunikat „PAPER JAM”. Aby usunąć usterkę, należy w pierwszej kolejności

Który adres IP posiada maskę w postaci pełnej, zgodną z klasą adresu?

Usługa RRAS serwera Windows 2019 jest przeznaczona do

Jaką kwotę trzeba będzie zapłacić za wymianę karty graficznej w komputerze, jeśli koszt karty wynosi 250 zł, czas wymiany to 80 minut, a cena za każdą rozpoczętą roboczogodzinę to 50 zł?

Jakie informacje można uzyskać za pomocą polecenia uname -s w systemie Linux?

Najłatwiej zidentyfikować błędy systemu operacyjnego Windows wynikające z konfliktów sprzętowych, takich jak przydzielanie pamięci, przerwań IRQ oraz kanałów DMA, przy użyciu narzędzia

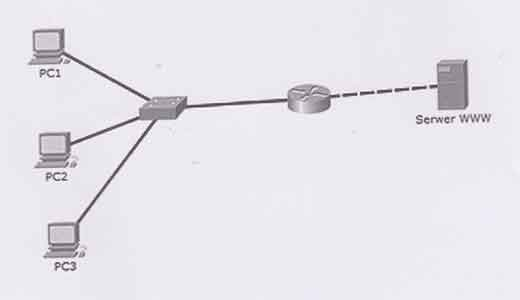

Użytkownicy w sieci lokalnej mogą się komunikować między sobą, lecz nie mają możliwości połączenia z serwerem WWW. Wynik polecenia ping z komputerów do bramy jest pozytywny. Który element sieci nie może być źródłem problemu?

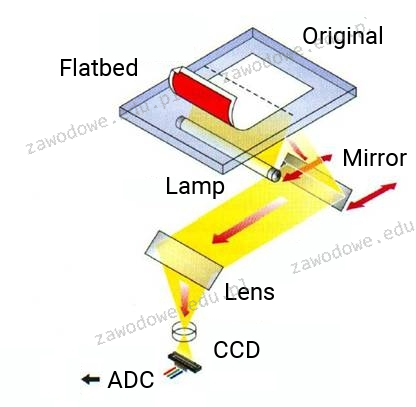

Ilustrowany schemat obrazuje zasadę funkcjonowania

Urządzeniem peryferyjnym pokazanym na ilustracji jest skaner biometryczny, który wykorzystuje do identyfikacji

Jakie narzędzie wraz z odpowiednimi parametrami należy zastosować w systemie Windows, aby uzyskać przedstawione informacje o dysku twardym?

ST9500420AS Identyfikator dysku : A67B7C06 Typ : ATA Stan : Online Ścieżka : 0 Element docelowy : 0 Identyfikator jednostki LUN: 0 Ścieżka lokalizacji : PCIROOT(0)#ATA(C00T00L00) Bieżący stan tylko do odczytu : Nie Tylko do odczytu: Nie Dysk rozruchowy : Tak Dysk plików stronicowania: Tak Dysk plików hibernacji: Nie Dysk zrzutów awaryjnych: Tak Dysk klastrowany: Nie Wolumin ### Lit Etykieta Fs Typ Rozmiar Stan Info ----------- --- ----------- ----- ------------ ------- ------- -------- Wolumin 1 SYSTEM NTFS Partycja 300 MB Zdrowy System Wolumin 2 C NTFS Partycja 445 GB Zdrowy Rozruch Wolumin 3 D HP_RECOVERY NTFS Partycja 15 GB Zdrowy Wolumin 4 E HP_TOOLS FAT32 Partycja 5122 MB Zdrowy

Wskaż rysunek ilustrujący symbol używany do oznaczania portu równoległego LPT?

Na podstawie przedstawionego w tabeli standardu opisu pamięci PC-100 wskaż pamięć, która charakteryzuje się maksymalnym czasem dostępu wynoszącym 6 nanosekund oraz minimalnym opóźnieniem między sygnałami CAS i RAS równym 2 cyklom zegara?

| Specyfikacja wzoru: PC 100-abc-def jednolitego sposobu oznaczania pamięci. | ||

| a | CL (ang. CAS Latency) | minimalna liczba cykli sygnału taktującego, liczona podczas operacji odczytu, od momentu uaktywnienia sygnału CAS, do momentu pojawienia się danych na wyjściu modułu DIMM (wartość CL wynosi zwykle 2 lub 3); |

| b | tRCD (ang. RAS to CAS Delay) | minimalne opóźnienie pomiędzy sygnałami RAS i CAS, wyrażone w cyklach zegara systemowego; |

| c | tRP (ang. RAS Precharge) | czas wyrażony w cyklach zegara taktującego, określający minimalną pauzę pomiędzy kolejnymi komendami, wykonywanymi przez pamięć; |

| d | tAC | Maksymalny czas dostępu (wyrażony w nanosekundach); |

| e | SPD Rev | specyfikacja komend SPD (parametr może nie występować w oznaczeniach); |

| f | Parametr zapasowy | ma wartość 0; |

Podczas normalnego działania systemu operacyjnego w laptopie pojawił się komunikat o konieczności formatowania wewnętrznego dysku twardego. Wskazuje on na

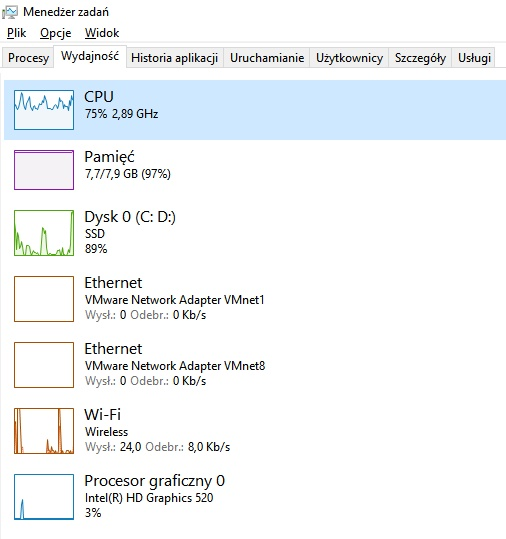

Grafik komputerowy sygnalizuje bardzo wolną pracę komputera. Z ilustracji przedstawiającej okno wydajności komputera wynika, że przyczyną tego może być

Jaki protokół komunikacyjny jest używany do przesyłania plików w modelu klient-serwer oraz może funkcjonować w dwóch trybach: aktywnym i pasywnym?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Aby uniknąć utraty danych w systemie do ewidencji uczniów, po zakończeniu codziennej pracy należy wykonać

Mamy do czynienia z siecią o adresie 192.168.100.0/24. Ile podsieci można utworzyć, stosując maskę 255.255.255.224?

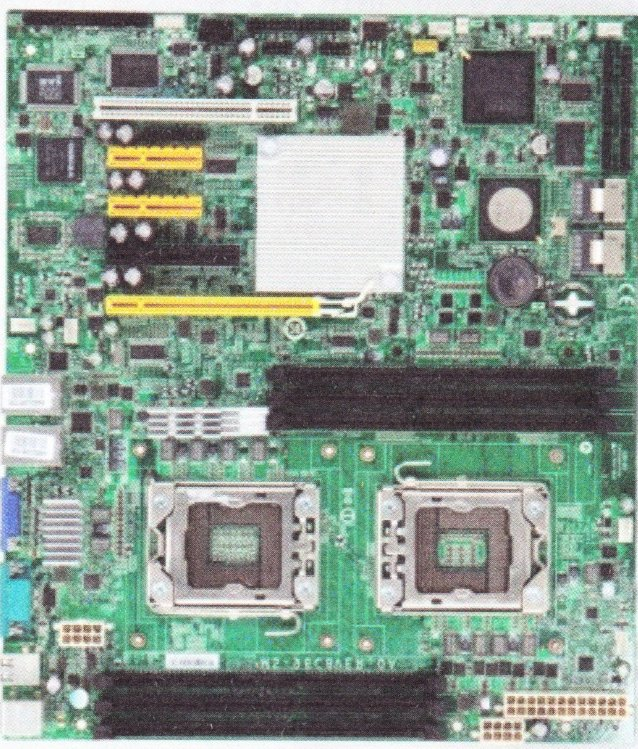

W komputerze użyto płyty głównej widocznej na obrazku. Aby podnieść wydajność obliczeniową maszyny, zaleca się

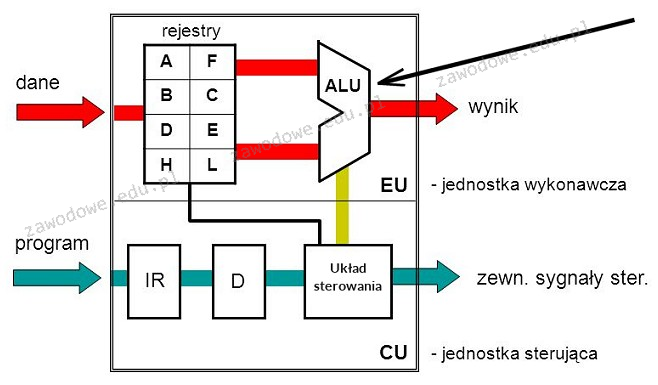

Na diagramie mikroprocesora blok wskazany strzałką pełni rolę