Pytanie 1

Router Wi-Fi działający w technologii 802.11n umożliwia osiągnięcie maksymalnej prędkości przesyłu danych

Wynik: 21/40 punktów (52,5%)

Wymagane minimum: 20 punktów (50%)

Router Wi-Fi działający w technologii 802.11n umożliwia osiągnięcie maksymalnej prędkości przesyłu danych

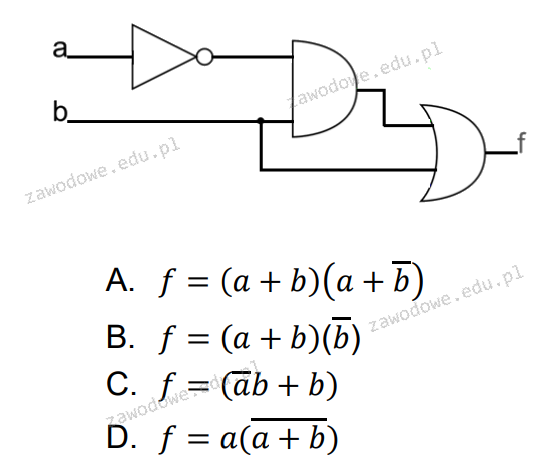

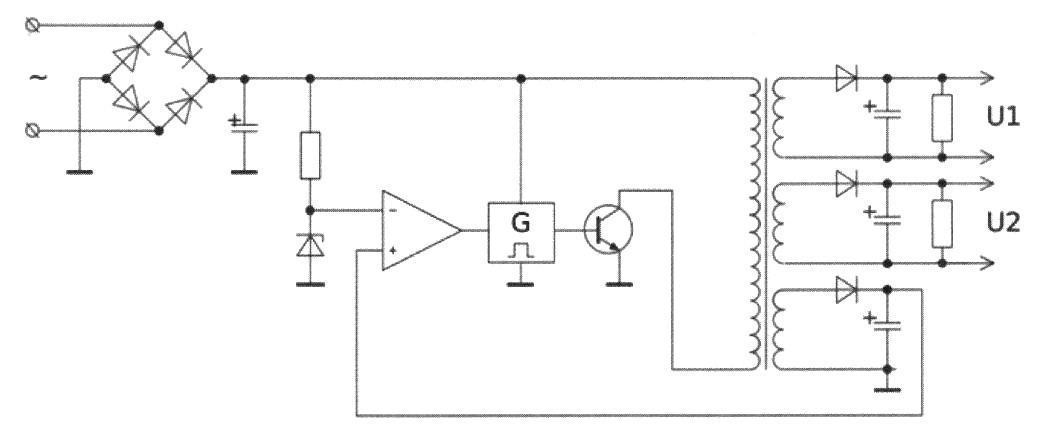

Jaką funkcję wykonuje zaprezentowany układ?

Czym jest parametr, który określa, o ile moc sygnału w danej parze przewodów zmniejszy się po przejściu przez cały tor kablowy?

Polecenie chmod +x test

Aby system operacyjny mógł szybciej uzyskiwać dostęp do plików na dysku twardym, należy wykonać

Podczas skanowania reprodukcji obrazu z magazynu, na skanie obrazu ukazały się regularne wzory, zwane morą. Jakiej funkcji skanera należy użyć, aby usunąć te wzory?

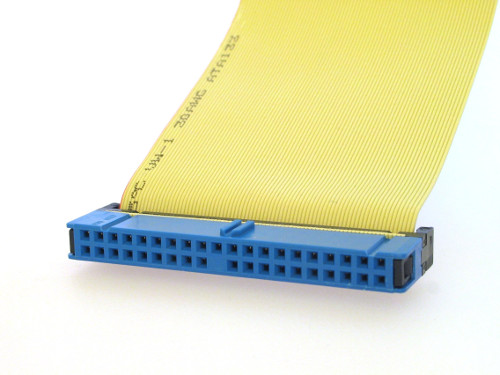

Na ilustracji pokazano wtyczkę taśmy kabel)

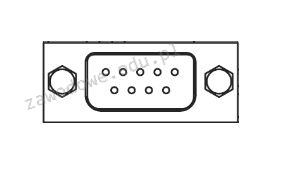

Obrazek ilustruje rodzaj złącza

W jakiej topologii fizycznej sieci każde urządzenie ma dokładnie dwa połączenia, jedno z najbliższymi sąsiadami, a dane są przesyłane z jednego komputera do kolejnego w formie pętli?

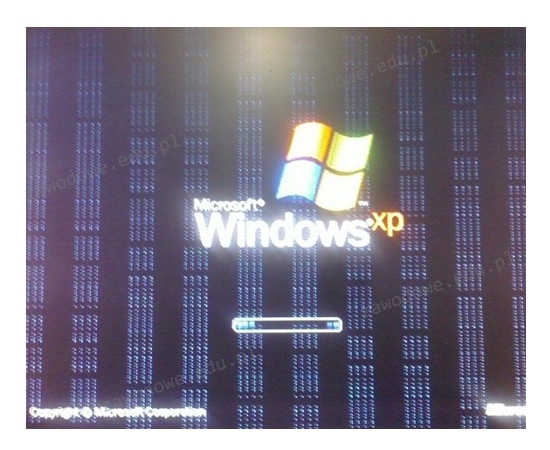

Usterka zaprezentowana na ilustracji, widoczna na monitorze, nie może być spowodowana przez

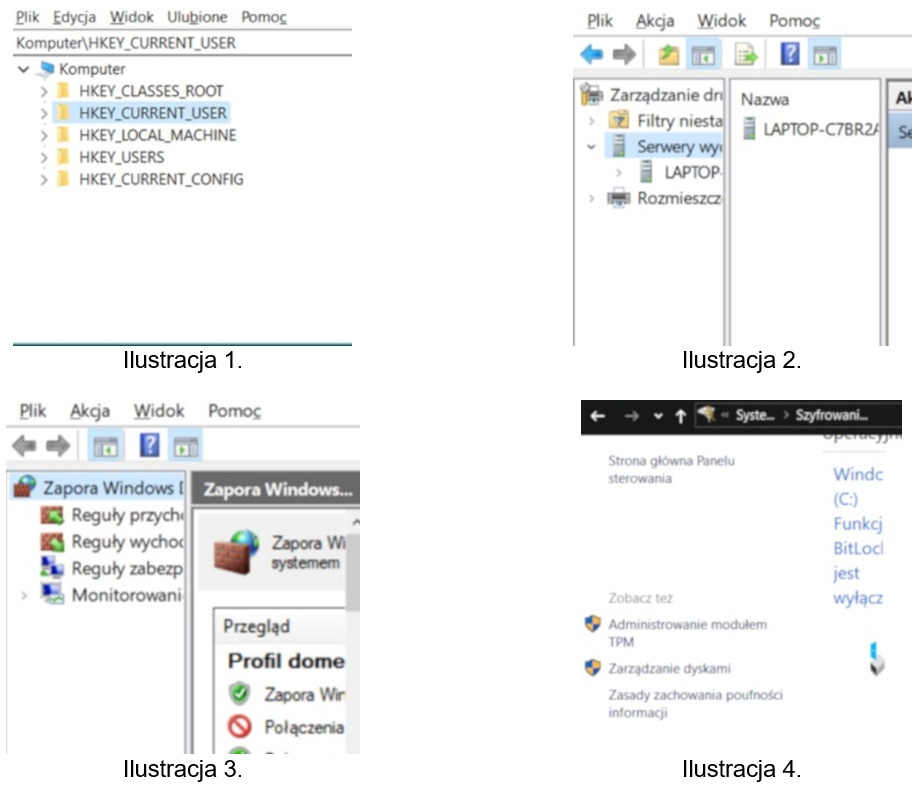

Na której ilustracji przedstawiono Edytor rejestru w systemie Windows?

Która funkcja przełącznika zarządzalnego pozwala na łączenie kilku przełączników fizycznych w jedną wirtualną linię, aby zwiększyć przepustowość łącza?

Który z wymienionych adresów stanowi adres hosta w obrębie sieci 10.128.0.0/10?

Który standard w połączeniu z odpowiednią kategorią kabla skrętki jest skonfigurowany w taki sposób, aby umożliwiać maksymalny transfer danych?

Osoba korzystająca z systemu Linux, chcąc zweryfikować dysk twardy pod kątem obecności uszkodzonych sektorów, ma możliwość skorzystania z programu

Jaką liczbę dziesiętną reprezentuje liczba 11110101U2)?

Jakie działanie nie przyczynia się do personalizacji systemu operacyjnego Windows?

Aby poprawić organizację plików na dysku i przyspieszyć działanie systemu, co należy zrobić?

Komputer wyposażony w BIOS firmy Award wygenerował komunikat o treści Primary/Secondary master/slave hard disk fail. Komunikat ten może oznaczać konieczność wymiany

Która z kart graficznych nie będzie kompatybilna z monitorem, posiadającym złącza pokazane na ilustracji (zakładając, że nie można użyć adaptera do jego podłączenia)?

Po przeprowadzeniu diagnostyki komputerowej ustalono, że temperatura pracy karty graficznej z wyjściami HDMI oraz D-SUB, zainstalowanej w gnieździe PCI Express komputera stacjonarnego, wynosi 87°C. W związku z tym, serwisant powinien

EN IEC 60276:2019 to przykład oznaczenia normy

W systemie Linux dane dotyczące okresu ważności hasła są przechowywane w pliku

W jakim trybie pracy znajduje się system Linux, kiedy osiągalny jest tylko minimalny zestaw funkcji systemowych, często używany do napraw?

Licencja CAL (Client Access License) uprawnia użytkownika do

W systemie Windows, aby udostępnić folder jako ukryty, należy na końcu nazwy udostępniania umieścić znak

W celu zrealizowania instalacji sieciowej na stacjach roboczych z systemem operacyjnym Windows, należy na serwerze zainstalować usługi

Przedstawione na ilustracji narzędzie służy do

Jakie narzędzie w systemie Linux pozwala na wyświetlenie danych o sprzęcie zapisanych w BIOS?

Który z trybów nie jest dostępny dla narzędzia powiększenia w systemie Windows?

Jak w systemie Windows zmienić port drukarki, która została zainstalowana?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Cechą charakterystyczną transmisji za pomocą interfejsu równoległego synchronicznego jest to, że

Komputer ma podłączoną mysz bezprzewodową, a kursor podczas pracy nie porusza się płynnie, „skacze” po ekranie. Przyczyną usterki urządzenia może być

Jak nazywa się proces dodawania do danych z warstwy aplikacji informacji powiązanych z protokołami funkcjonującymi na różnych poziomach modelu sieciowego?

Na rysunku zobrazowano schemat

Jakie polecenie należy wykorzystać, aby w terminalu pokazać przedstawione informacje o systemie Linux?

Arch Linux 2.6.33-ARCH (myhost) (tty1)

myhost login: root

Password:

[root@myhost ~]#

Linux myhost 2.6.33-ARCH #1 SMP PREEMPT Thu May 13 12:06:25 CEST 2010 i686 Intel

(R) Pentium(R) 4 CPU 2.80GHz GenuineIntel GNU/LinuxJakie będzie całkowite koszty materiałów potrzebnych do zbudowania sieci lokalnej dla 6 komputerów, jeśli do realizacji sieci wymagane są 100 m kabla UTP kat. 5e oraz 20 m kanału instalacyjnego? Ceny komponentów sieci zostały przedstawione w tabeli

| Elementy sieci | j.m. | cena brutto |

|---|---|---|

| Kabel UTP kat. 5e | m | 1,00 zł |

| Kanał instalacyjny | m | 8,00 zł |

| Gniazdo komputerowe | szt. | 5,00 zł |

Aby zmierzyć tłumienie łącza światłowodowego w dwóch zakresach transmisyjnych 1310nm oraz 1550nm, powinno się zastosować

Do serwisu komputerowego przyniesiono laptopa, którego matryca wyświetla obraz w bardzo słabej jakości. Dodatkowo obraz jest znacząco ciemny i widoczny jedynie z niewielkiej odległości. Co może być przyczyną tej usterki?