Pytanie 1

Przedmiot widoczny na ilustracji to

Wynik: 26/40 punktów (65,0%)

Wymagane minimum: 20 punktów (50%)

Przedmiot widoczny na ilustracji to

Jakie pole znajduje się w nagłówku protokołu UDP?

Ile bitów trzeba wydzielić z części hosta, aby z sieci o adresie IPv4 170.16.0.0/16 utworzyć 24 podsieci?

Dostosowanie ustawień parametrów TCP/IP urządzenia na podstawie adresu MAC karty sieciowej jest funkcją protokołu

Aby zweryfikować integralność systemu plików w systemie Linux, które polecenie powinno zostać użyte?

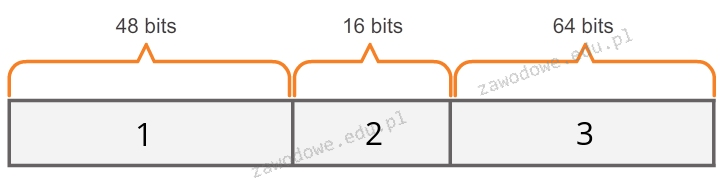

Jaką sekwencję mają elementy adresu globalnego IPv6 typu unicast ukazanym na diagramie?

Zestaw narzędzi niezbędnych do instalacji okablowania miedzianego typu "skrętka" w lokalnej sieci powinien obejmować

Podanie nieprawidłowych napięć do płyty głównej może skutkować

Aby połączyć projektor multimedialny z komputerem, nie można zastosować złącza

W systemie Linux do śledzenia wykorzystania procesora, pamięci, procesów oraz obciążenia systemu wykorzystuje się polecenie

Która z poniższych opcji nie jest wykorzystywana do zdalnego zarządzania stacjami roboczymi?

Aby zminimalizować główne zagrożenia dotyczące bezpieczeństwa podczas pracy na komputerze podłączonym do sieci Internet, najpierw należy

W przypadku dysku twardego, w jakiej jednostce wyrażana jest wartość współczynnika MTBF (Mean Time Between Failure)?

Jakie będą wydatki na materiały potrzebne do produkcji 20 kabli typu patchcord o długości 50 cm?

| Nazwa towaru | Cena jedn. brutto |

|---|---|

| wtyk RJ45 | 1,00 zł / szt. |

| koszulka ochronna na wtyk RJ45 | 1,00 zł / szt. |

| skrętka UTP | 1,20 zł / m |

Wskaż zewnętrzny protokół rutingu?

Zgodnie z normą EIA/TIA T568B, żyły pary odbiorczej w skrętce są pokryte izolatorem w kolorze

Switch jako kluczowy komponent występuje w sieci o strukturze

Wskaż tryb operacyjny, w którym komputer wykorzystuje najmniej energii

Jak nazywa się topologia fizyczna sieci, która wykorzystuje fale radiowe jako medium transmisyjne?

Aby wyświetlić listę wszystkich zainstalowanych urządzeń w systemie Windows lub zmienić ich właściwości, należy skorzystać z narzędzia

Kabel typu skrętka, w którym każda para żył jest umieszczona w oddzielnym ekranie z folii, a wszystkie przewody znajdują się w jednym ekranie, ma oznaczenie

Wyświetlony stan ekranu terminala został uzyskany podczas testu realizowanego w środowisku Windows. Techniczny pracownik zdobył w ten sposób informacje o:

Jaką topologię fizyczną sieci komputerowej przedstawia załączony rysunek?

Która usługa pozwala na zdalne logowanie do komputerów, wykonywanie poleceń systemowych oraz zarządzanie siecią?

Jaką minimalną ilość pamięci RAM powinien posiadać komputer, aby możliwe było zainstalowanie 32-bitowego systemu operacyjnego Windows 7 i praca w trybie graficznym?

Posiadacz notebooka pragnie zainstalować w nim dodatkowy dysk twardy. Urządzenie ma jedynie jedną zatokę na HDD. Możliwością rozwiązania tego wyzwania może być użycie dysku z interfejsem

Jakie jest zadanie programu Wireshark?

Element płyty głównej odpowiedzialny za wymianę danych między mikroprocesorem a pamięcią operacyjną RAM oraz magistralą karty graficznej jest na rysunku oznaczony numerem

Osoba korzystająca z systemu operacyjnego Linux pragnie przypisać adres IP 152.168.1.200 255.255.0.0 do interfejsu sieciowego. Jakie polecenie powinna wydać, mając uprawnienia administratora?

Aby podnieść wydajność komputera w grach, karta graficzna Sapphire Radeon R9 FURY OC, 4GB HBM (4096 Bit), HDMI, DVI, 3xDP została wzbogacona o technologię

Użytkownik systemu Windows doświadcza komunikatów o niewystarczającej pamięci wirtualnej. Jak można rozwiązać ten problem?

Który z poniższych zapisów reprezentuje adres strony internetowej oraz przypisany do niego port?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Komenda "mmc" w systemach Windows 2000 oraz Windows XP uruchamia aplikację do tworzenia, zapisywania i otwierania

Jaką maksymalną wartość rozplotu kabla UTP można uzyskać we wtyku RJ45 według normy PN-EN 50173?

Jaką usługą można pobierać i przesyłać pliki na serwer?

Użytkownik pragnie ochronić dane na karcie pamięci przed przypadkowym usunięciem. Taką zabezpieczającą cechę oferuje karta

Program o nazwie dd, którego przykład użycia przedstawiono w systemie Linux, umożliwia:

dd if=/dev/sdb of=/home/uzytkownik/Linux.iso

Użytkownik drukarki samodzielnie i prawidłowo napełnił pojemnik z tonerem. Po jego zamontowaniu drukarka nie podejmuje próby drukowania. Przyczyną tej usterki może być

Przedstawiony skaner należy podłączyć do komputera przy użyciu złącza