Pytanie 1

Metoda zwana rytownictwem dotyczy zasady działania plotera

Wynik: 27/40 punktów (67,5%)

Wymagane minimum: 20 punktów (50%)

Metoda zwana rytownictwem dotyczy zasady działania plotera

Podczas próby nawiązania połączenia z serwerem FTP, uwierzytelnienie anonimowe nie powiodło się, natomiast logowanie za pomocą loginu i hasła zakończyło się sukcesem. Co może być przyczyną tej sytuacji?

Jakie urządzenie NIE powinno być serwisowane podczas korzystania z urządzeń antystatycznych?

Użytkownik systemu Linux, który pragnie usunąć konto innej osoby wraz z jej katalogiem domowym, powinien użyć polecenia

Aby zarządzać aplikacjami i usługami uruchamianymi podczas startu systemu operacyjnego w Windows 7, należy skorzystać z programu

Który z podanych adresów IPv4 należy do kategorii B?

Wskaż zakres adresów hostów w sieci 172.16.4.0/24?

Wyższą efektywność aplikacji multimedialnych w systemach z rodziny Windows zapewnia technologia

Jakie medium transmisyjne w sieciach LAN zaleca się do użycia w budynkach zabytkowych?

W lokalnej sieci protokołem odpowiedzialnym za dynamiczną konfigurację adresów IP jest

Obrazek ilustruje rezultat działania programu

│ ├── Checkbox_checked.svg │ └── Checkbox_unchecked.svg │ ├── revisions.txt │ ├── tools │ │ ├── howto.txt │ │ ├── Mangler │ │ │ ├── make.sh │ │ │ └── src │ │ │ └── Mangler.java │ │ └── WiFi101 │ │ ├── tool │ │ │ └── firmwares │ │ │ ├── 19.4.4 │ │ │ │ ├── m2m_aio_2b0.bin │ │ │ │ └── m2m_aio_3a0.bin │ │ │ └── 19.5.2 │ │ │ └── m2m_aio_3a0.bin │ │ └── WiFi101.jar │ ├── tools-builder │ │ └── ctags │ │ └── 5.8-arduino11 │ │ └── ctags │ └── uninstall.sh └── brother └── PTouch └── ql570 └── cupswrapper ├── brcupsconfpt1 └── cupswrapperql570pt1

Jakim protokołem jest realizowana kontrola poprawności transmisji danych w sieciach Ethernet?

Na komputerze z zainstalowanymi systemami operacyjnymi Windows i Linux, po przeprowadzeniu reinstalacji systemu Windows, drugi system przestaje się uruchamiać. Aby przywrócić możliwość uruchamiania systemu Linux oraz zachować dane i ustawienia w nim zgromadzone, co należy zrobić?

Podaj właściwe przyporządkowanie usługi z warstwy aplikacji oraz standardowego numeru portu, na którym ta usługa działa?

Który z wymienionych formatów płyt głównych charakteryzuje się najmniejszymi wymiarami?

Osoba korzystająca z systemu Linux, chcąc zweryfikować dysk twardy pod kątem obecności uszkodzonych sektorów, ma możliwość skorzystania z programu

Czym jest parametr, który określa, o ile moc sygnału w danej parze przewodów zmniejszy się po przejściu przez cały tor kablowy?

Jakie polecenie w systemie Windows dedykowane dla stacji roboczej, umożliwia skonfigurowanie wymagań dotyczących logowania dla wszystkich użytkowników tej stacji roboczej?

Jaką maksymalną liczbę hostów można przypisać w sieci o adresie IP klasy B?

Jakie protokoły pełnią rolę w warstwie transportowej modelu ISO/OSI?

Cechą charakterystyczną transmisji w interfejsie równoległym synchronicznym jest to, że

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

NOWY, GOTOWY, OCZEKUJĄCY oraz AKTYWNY to

Jeśli rozdzielczość myszy wynosi 200dpi, a monitor ma rozdzielczość Full HD, to aby przesunąć kursor wzdłuż ekranu, należy przesuń mysz o

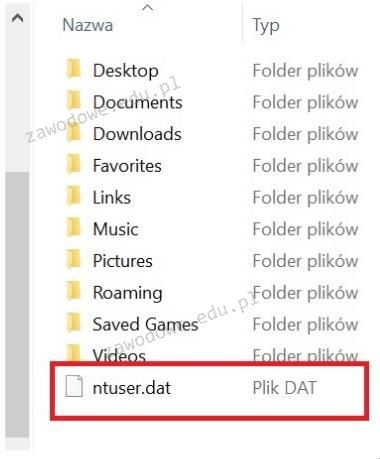

Aby zmienić profil na obowiązkowy, trzeba zmodyfikować rozszerzenie pliku ntuser.dat na

Wskaż urządzenie wyjścia.

Stacja robocza powinna znajdować się w tej samej podsieci co serwer o adresie IP 192.168.10.150 i masce 255.255.255.192. Który adres IP powinien być skonfigurowany w ustawieniach protokołu TCP/IP karty sieciowej stacji roboczej?

Użytkownik drukarki samodzielnie i prawidłowo napełnił pojemnik z tonerem. Po jego zamontowaniu drukarka nie podejmuje próby drukowania. Przyczyną tej usterki może być

Pamięć oznaczona jako PC3200 nie jest kompatybilna z magistralą

W jakiej warstwie modelu ISO/OSI wykorzystywane są adresy logiczne?

Sprawdzenie ilości wolnego miejsca na dysku twardym w systemie Linux umożliwia polecenie

Wskaż poprawną kolejność czynności prowadzących do zamontowania procesora w gnieździe LGA na nowej płycie głównej, odłączonej od źródła zasilania.

| Nr czynności | Działanie |

|---|---|

| 1 | Odgięcie dźwigni i otwarcie klapki |

| 2 | Montaż układu chłodzącego |

| 3 | Zamknięcie klapki i dociśnięcie dźwigni |

| 4 | Podłączenie układu chłodzącego do zasilania |

| 5 | Lokalizacja gniazda procesora |

| 6 | Nałożenie pasty termoprzewodzącej |

| 7 | Włożenie procesora do gniazda |

Do zarządzania konfiguracją grup komputerowych oraz użytkowników w systemach Windows Server, należy wykorzystać narzędzie

W przedsiębiorstwie trzeba było zreperować 5 komputerów i serwer. Czas potrzebny na naprawę każdego z komputerów wyniósł 1,5 godziny, a serwera 2,5 godziny. Stawka za usługę to 100,00 zł za roboczogodzinę, a do tego doliczany jest podatek VAT w wysokości 23%. Jaka kwota brutto będzie należna za tę usługę?

Jednym ze sposobów na ograniczenie dostępu do sieci bezprzewodowej dla nieuprawnionych osób jest

Aby przeprowadzić rezerwację adresów IP w systemie Windows Server na podstawie fizycznych adresów MAC urządzeń, konieczne jest skonfigurowanie usługi

Jaką sumę należy zapłacić za wymianę karty graficznej w komputerze, jeżeli cena karty wynosi 250 zł, a czas wymiany przez pracownika serwisu to 80 minut, przy czym każda rozpoczęta godzina pracy kosztuje 50 zł?

Do jakiego celu służy program fsck w systemie Linux?

Jakie polecenie umożliwia wyświetlanie oraz modyfikację tabel translacji adresów IP do adresów fizycznych?

W układzie SI jednostką, która mierzy napięcie, jest