Pytanie 1

Najskuteczniejszym sposobem na dodanie skrótu do konkretnego programu na pulpitach wszystkich użytkowników w domenie jest

Wynik: 29/40 punktów (72,5%)

Wymagane minimum: 20 punktów (50%)

Najskuteczniejszym sposobem na dodanie skrótu do konkretnego programu na pulpitach wszystkich użytkowników w domenie jest

Wskaż poprawną wersję maski podsieci?

Wskaż poprawną kolejność czynności prowadzących do zamontowania procesora w gnieździe LGA na nowej płycie głównej, odłączonej od źródła zasilania.

| Nr czynności | Działanie |

|---|---|

| 1 | Odgięcie dźwigni i otwarcie klapki |

| 2 | Montaż układu chłodzącego |

| 3 | Zamknięcie klapki i dociśnięcie dźwigni |

| 4 | Podłączenie układu chłodzącego do zasilania |

| 5 | Lokalizacja gniazda procesora |

| 6 | Nałożenie pasty termoprzewodzącej |

| 7 | Włożenie procesora do gniazda |

Aby ocenić stabilność systemu Windows Server, należy użyć narzędzia

Oprogramowanie, które pozwala na interakcję pomiędzy kartą sieciową a systemem operacyjnym, to

Polecenie grep w systemie Linux pozwala na

Domyślnie dostęp anonimowy do zasobów serwera FTP umożliwia

Która z poniższych informacji odnosi się do profilu tymczasowego użytkownika?

Jaki poziom macierzy RAID umożliwia równoległe zapisywanie danych na wielu dyskach działających jako jedno urządzenie?

Według modelu TCP/IP, protokoły DNS, FTP oraz SMTP zaliczają się do warstwy

Recykling można zdefiniować jako

Który z protokołów służy do synchronizacji czasu?

Jakie medium transmisyjne powinno być użyte do połączenia dwóch punktów dystrybucyjnych oddalonych o 600m?

Jaką metodę stosuje się do dostępu do medium transmisyjnego z wykrywaniem kolizji w sieciach LAN?

Dobrze zaprojektowana sieć komputerowa powinna zapewniać możliwość rozbudowy, czyli charakteryzować się

Elementem płyty głównej, który odpowiada za wymianę informacji pomiędzy procesorem a innymi komponentami płyty, jest

Interfejs UDMA to typ interfejsu

Który adres IP jest zaliczany do klasy B?

W przedsiębiorstwie zainstalowano pięć komputerów z adresami kart sieciowych zawartymi w tabeli. W związku z tym można wyróżnić

| Adres IP | Maska |

|---|---|

| 10.1.61.10 | 255.255.0.0 |

| 10.1.61.11 | 255.255.0.0 |

| 10.3.63.20 | 255.255.0.0 |

| 10.3.63.21 | 255.255.0.0 |

| 10.5.63.10 | 255.255.0.0 |

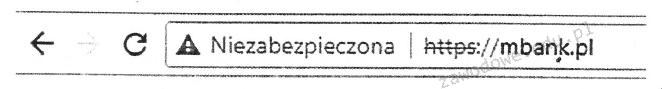

Zidentyfikuj powód pojawienia się komunikatu, który widoczny jest na ilustracji.

Jakie polecenie należy wprowadzić w wierszu polecenia systemów Windows Server, aby zaktualizować dzierżawy adresów DHCP oraz przeprowadzić rejestrację nazw w systemie DNS?

Monolityczne jądro (kernel) występuje w którym systemie?

Rodzajem złośliwego oprogramowania będącego programem rezydentnym, który działa, wykonując konkretną operację, nie powiela się przez sieć, a jedną z jego metod jest samoreplikacja aż do wyczerpania pamięci komputera, jest

Aby podłączyć drukarkę igłową o wskazanych parametrach do komputera, należy umieścić kabel dołączony do drukarki w porcie

Której aplikacji należy użyć, aby sprawdzić parametry S.M.A.R.T.?

Urządzenie przedstawione na obrazie jest przeznaczone do

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

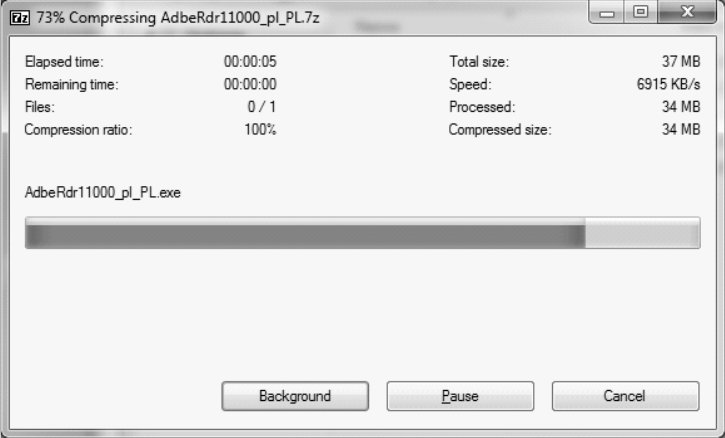

Na dołączonym obrazku ukazano proces

Program Mozilla Firefox jest udostępniany na zasadach licencji

W systemie działającym w trybie wielozadaniowości z wywłaszczeniem program, który zatrzymał się

Udostępniono w sieci lokalnej jako udział specjalny folder o nazwie egzamin znajdujący się na komputerze o nazwie SERWER_2 w katalogu głównym dysku C:. Jak powinna wyglądać ścieżka dostępu do katalogu egzamin, w którym przechowywany jest folder macierzysty dla konta użytkownika o określonym loginie?

Który typ rekordu w bazie DNS (Domain Name System) umożliwia ustalenie aliasu dla rekordu A?

W pierwszym oktecie adresów IPv4 klasy B znajdują się liczby mieszczące się w przedziale

Aby wykonać ręczne ustawienie interfejsu sieciowego w systemie LINUX, należy użyć polecenia

Jaki program powinien zostać zainstalowany na serwerze internetowym opartym na Linuxie, aby umożliwić korzystanie z baz danych?

Złącze widoczne na obrazku pozwala na podłączenie

W systemie Windows do wyświetlenia treści pliku tekstowego służy polecenie

Aby poprawić bezpieczeństwo prywatnych danych sesji na stronie internetowej, zaleca się dezaktywację w ustawieniach przeglądarki

Zachowanie kopii często odwiedzanych witryn oraz zwiększenie ochrony przez filtrowanie pewnych treści witryn internetowych można osiągnąć dzięki

Narzędzie zaprezentowane na rysunku jest wykorzystywane do przeprowadzania testów