Pytanie 1

Która z poniższych informacji odnosi się do profilu tymczasowego użytkownika?

Wynik: 23/40 punktów (57,5%)

Wymagane minimum: 20 punktów (50%)

Która z poniższych informacji odnosi się do profilu tymczasowego użytkownika?

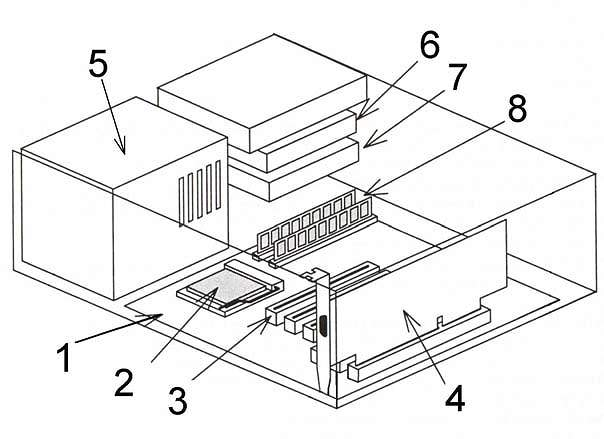

Na ilustracji procesor jest oznaczony liczbą

ile bajtów odpowiada jednemu terabajtowi?

Po wydaniu polecenia route skonfigurowano ```route add 192.168.35.0 MASK 255.255.255.0 192.168.0.2```

W usłudze, jaką funkcję pełni protokół RDP?

Klient przyniósł do serwisu uszkodzony sprzęt komputerowy. W trakcie procedury odbioru sprzętu, przed rozpoczęciem jego naprawy, serwisant powinien

Interfejs równoległy, który ma magistralę złożoną z 8 linii danych, 4 linii sterujących oraz 5 linii statusowych, nie zawiera linii zasilających i umożliwia transmisję na dystans do 5 metrów, gdy kable sygnałowe są skręcone z przewodami masy, a w przeciwnym razie na dystans do 2 metrów, jest określany mianem

Jakie narzędzie jest używane do zakończenia skrętki wtykiem 8P8C?

ACPI to interfejs, który umożliwia

Serwisant dotarł do klienta, który znajdował się 11 km od siedziby firmy, i przeprowadził u niego działania naprawcze wymienione w poniższej tabeli. Oblicz całkowity koszt brutto jego usług, wiedząc, że dojazd do klienta kosztuje 1,20 zł/km brutto w obie strony. Stawka VAT na usługi wynosi 23%.

Co jest główną funkcją serwera DHCP w sieci komputerowej?

Producent wyświetlacza LCD stwierdził, że spełnia on wymagania klasy II według normy ISO 13406-2. Na podstawie danych przedstawionych w tabeli określ, ile pikseli z defektem typu 3 musi wystąpić na wyświetlaczu o naturalnej rozdzielczości 1280x800 pikseli, aby uznać go za uszkodzony?

| Klasa | Maksymalna liczba dopuszczalnych błędów na 1 milion pikseli | ||

|---|---|---|---|

| Typ 1 | Typ 2 | Typ 3 | |

| I | 0 | 0 | 0 |

| II | 2 | 2 | 5 |

| III | 5 | 15 | 50 |

| IV | 50 | 150 | 500 |

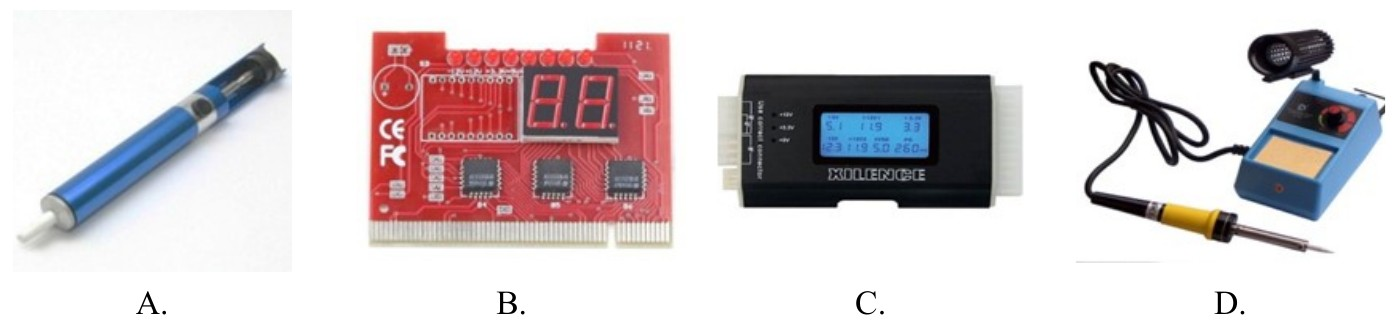

Przy użyciu urządzenia zobrazowanego na rysunku możliwe jest sprawdzenie działania

Jakie parametry otrzyma interfejs sieciowy eth0 po wykonaniu poniższych poleceń w systemie Linux?

W systemie Windows przy użyciu polecenia assoc można

Jaki protokół służy komputerom do informowania rutera o przynależności do konkretnej grupy multicastowej?

Jakie narzędzie powinno być użyte do zbadania wyników testu POST dla modułów na płycie głównej?

Korzystając z polecenia taskmgr, użytkownik systemu Windows może

Jakie urządzenie umożliwia zwiększenie zasięgu sieci bezprzewodowej?

Wartość 101011101102 zapisana w systemie szesnastkowym to

Aby stworzyć archiwum danych w systemie operacyjnym Ubuntu, należy użyć programu

Aby uzyskać największą prędkość przepływu danych w przypadku, gdy domowy ruter pracuje w paśmie częstotliwości 5 GHz, do notebooka powinno się zamontować bezprzewodową kartę sieciową pracującą w standardzie

Który typ rekordu w bazie DNS (Domain Name System) umożliwia ustalenie aliasu dla rekordu A?

Organizacja zajmująca się normalizacją na świecie, która stworzyła 7-warstwowy Model Referencyjny Otwartej Architektury Systemowej, to

Użytkownik systemu Windows doświadcza problemów z niewystarczającą pamięcią wirtualną. Jak można temu zaradzić?

Cena wydruku jednej strony tekstu wynosi 95 gr, a koszt wykonania jednej płyty CD to 1,54 zł. Jakie wydatki poniesie firma, tworząc płytę z prezentacjami oraz poradnik liczący 120 stron?

Zastosowanie której zasady zwiększy bezpieczeństwo podczas korzystania z portali społecznościowych?

Aby wydobyć informacje znajdujące się w archiwum o nazwie dane.tar, osoba korzystająca z systemu Linux powinna zastosować komendę

Jakie jest ciało odpowiedzialne za publikację dokumentów RFC (Request For Comments), które określają zasady rozwoju Internetu?

Aby przywrócić dane, które zostały usunięte dzięki kombinacji klawiszy Shift+Delete, trzeba

Który zakres adresów pozwala na komunikację multicast w sieciach z użyciem adresacji IPv6?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Narzędzie służące do oceny wydajności systemu komputerowego to

Interfejs HDMI w komputerze umożliwia przesyłanie sygnału

Gniazdo w sieciach komputerowych, które jednoznacznie identyfikuje dany proces na urządzeniu, stanowi kombinację

Schemat ilustruje fizyczną strukturę

Z powodu uszkodzenia kabla typu skrętka utracono dostęp między przełącznikiem a stacją roboczą. Który instrument pomiarowy powinno się wykorzystać, aby zidentyfikować i naprawić problem bez wymiany całego kabla?

Komputer prawdopodobnie jest zainfekowany wirusem typu boot. Jakie działanie umożliwi usunięcie wirusa w najbardziej nieinwazyjny sposób dla systemu operacyjnego?

Norma TIA/EIA-568-B.2 definiuje szczegóły dotyczące parametrów transmisji

Aby osiągnąć optymalną prędkość przesyłu danych, gdy domowy ruter działa w paśmie 5 GHz, do laptopa należy zainstalować kartę sieciową bezprzewodową obsługującą standard