Pytanie 1

Aby określić długość prefiksu w adresie IPv4, należy ustalić

Wynik: 22/40 punktów (55,0%)

Wymagane minimum: 20 punktów (50%)

Aby określić długość prefiksu w adresie IPv4, należy ustalić

W sytuacji, gdy nie ma możliwości uruchomienia programu BIOS Setup, jak przywrócić domyślne ustawienia płyty głównej?

Jak wygląda konwencja zapisu ścieżki do udziału w sieci, zgodna z UNC (Universal Naming Convention)?

AES (ang. Advanced Encryption Standard) to?

Który protokół jest używany do zdalnego zarządzania komputerem przez terminal w systemach Linux?

Aby aktywować lub dezaktywować usługi w zainstalowanej wersji systemu operacyjnego Windows, należy wykorzystać narzędzie

Komunikat "BIOS checksum error" pojawiający się podczas uruchamiania komputera zazwyczaj wskazuje na

Aby system operacyjny był skutecznie chroniony przed atakami złośliwego oprogramowania, po zainstalowaniu programu antywirusowego należy

Ataki na systemy komputerowe, które odbywają się poprzez podstępne pozyskiwanie od użytkowników ich danych osobowych, często wykorzystywane są w postaci fałszywych komunikatów z różnych instytucji lub od dostawców usług e-płatności i innych znanych organizacji, to

Menedżer urządzeń w systemie Windows umożliwia identyfikację

Optyczna rozdzielczość to jeden z atrybutów

Co należy zrobić, aby chronić dane przesyłane w sieci przed działaniem sniffera?

PCI\VEN_10EC&DEV_8168&SUBSYS_05FB1028&REV_12

Przedstawiony zapis jest

Problemy z laptopem, objawiające się zmienionymi barwami lub brakiem określonego koloru na ekranie, mogą być spowodowane uszkodzeniem

Jak określa się atak w sieci lokalnej, który polega na usiłowaniu podszycia się pod inną osobę?

Standardowo, w systemie Linux, twardy dysk w standardzie SATA jest oznaczany jako

W hierarchicznym modelu sieci, komputery należące do użytkowników są składnikami warstwy

W adresacji IPv6 standardowy podział długości dla adresu sieci oraz identyfikatora hosta wynosi odpowiednio

Jakie przyporządkowanie: urządzenie - funkcja, którą pełni, jest błędne?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jakiego rodzaju wkręt powinno się zastosować do przymocowania napędu optycznego o szerokości 5,25" w obudowie, która wymaga użycia śrub do mocowania napędów?

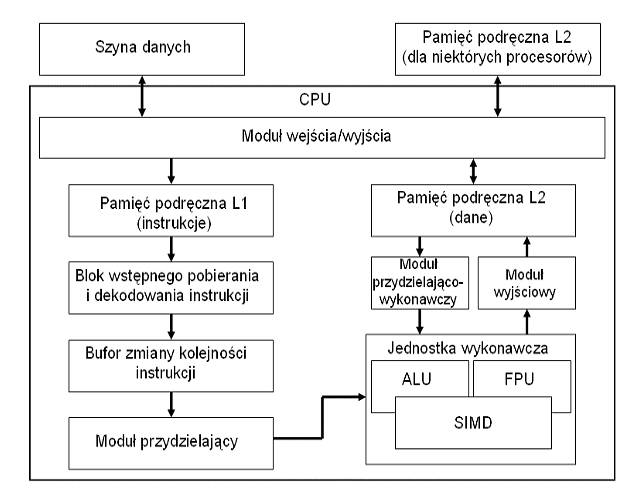

Na diagramie blokowym procesora blok funkcjonalny oznaczony jako SIMD to

Przy użyciu urządzenia zobrazowanego na rysunku możliwe jest sprawdzenie działania

Informacje ogólne na temat zdarzeń systemowych w systemie Linux są zapisywane w

Gdy użytkownik zauważy, że ważne pliki zniknęły z dysku twardego, powinien

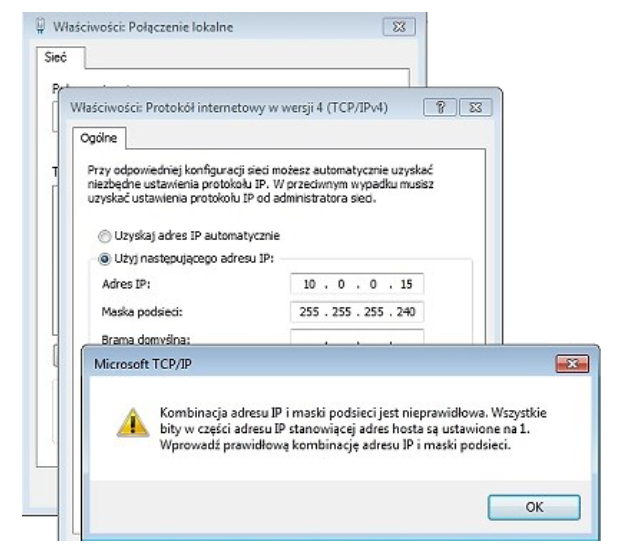

Na ilustracji widoczny jest komunikat, który pojawia się po wprowadzeniu adresu IP podczas ustawiania połączenia sieciowego na komputerze. Adres IP podany przez administratora to adres IP

Narzędzie używane do przechwytywania oraz analizy danych przesyłanych w sieci, to

Aby uzyskać adres IPv4, za pomocą usługi DHCP, komputer kliencki wysyła żądania z portu

Który rodzaj kopii zapasowej należy wybrać, aby wykonać przyrostową kopię danych?

Wykonanie polecenia net localgroup w systemie Windows spowoduje

Który z wymienionych interfejsów stanowi port równoległy?

Jakie są zasadnicze różnice pomiędzy poleceniem ps a poleceniem top w systemie Linux?

Na ilustracji zaprezentowane jest urządzenie, które to

Które z urządzeń używanych w sieciach komputerowych nie modyfikuje liczby kolizyjnych domen?

Administrator systemu Linux wydał polecenie mount /dev/sda2 /mnt/flash . Spowoduje ono

Jakie urządzenie jest używane do pomiaru wartości rezystancji?

Kable światłowodowe nie są powszechnie używane w lokalnych sieciach komputerowych z powodu

Protokół, który umożliwia po połączeniu z serwerem pocztowym przesyłanie na komputer tylko nagłówków wiadomości, a wysyłanie treści oraz załączników następuje dopiero po otwarciu konkretnego e-maila, to

Zamiana taśmy barwiącej jest związana z eksploatacją drukarki

Jakie kolory wchodzą w skład trybu CMYK?