Pytanie 1

Jakie parametry można śledzić w przypadku urządzenia przy pomocy S.M.A.R.T.?

Wynik: 19/40 punktów (47,5%)

Wymagane minimum: 20 punktów (50%)

Jakie parametry można śledzić w przypadku urządzenia przy pomocy S.M.A.R.T.?

Aby przekształcić zeskanowany obraz na tekst, należy użyć oprogramowania, które stosuje techniki

Możliwość odzyskania listy kontaktów na telefonie z systemem Android występuje, jeśli użytkownik wcześniej zsynchronizował dane urządzenia z Google Drive za pomocą

W systemie NTFS do zmiany nazwy pliku konieczne jest posiadanie uprawnienia

Podstawowym celem użycia przełącznika /renew w poleceniu ipconfig w systemie Windows jest

Która z anten charakteryzuje się najwyższym zyskiem energetycznym oraz pozwala na nawiązywanie połączeń na dużą odległość?

Aktualizacja systemów operacyjnych to proces, którego głównym zadaniem jest

W standardzie Ethernet 100BaseTX do przesyłania danych używane są żyły kabla UTP podłączone do pinów

Uzyskanie przechowywania kopii często odwiedzanych witryn oraz zwiększenia bezpieczeństwa przez odfiltrowanie konkretnych treści w sieci Internet można osiągnąć dzięki

Wskaż zdanie, które jest nieprawdziwe:

Minimalna ilość pamięci RAM wymagana dla systemu operacyjnego Windows Server 2008 wynosi przynajmniej

Osoba pragnąca jednocześnie drukować dokumenty w wersji oryginalnej oraz trzech kopiach na papierze samokopiującym, powinna nabyć drukarkę

Ile bitów zawiera adres MAC karty sieciowej?

W systemie działającym w trybie wielozadaniowości z wywłaszczeniem program, który zatrzymał się

Jakim elementem sieci SIP jest telefon IP?

Który z wewnętrznych protokołów routingu bazuje na metodzie wektora odległości?

Najlepszym sposobem na zabezpieczenie domowej sieci Wi-Fi jest

W systemie Windows do wyświetlenia treści pliku tekstowego służy polecenie

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Adres IP 192.168.2.0/24 podzielono na cztery różne podsieci. Jaką maskę mają te nowe podsieci?

Aby zmierzyć moc zużywaną przez komputer, należy zastosować

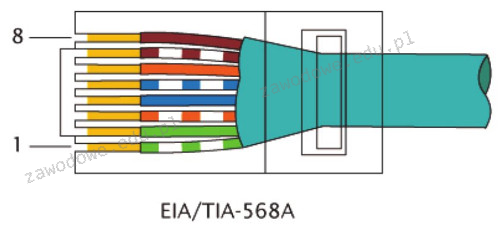

Jak wygląda układ przewodów w złączu RJ45 zgodnie z kolejnością połączeń T568A?

Jakie urządzenie można kontrolować pod kątem parametrów za pomocą S.M.A.R.T.?

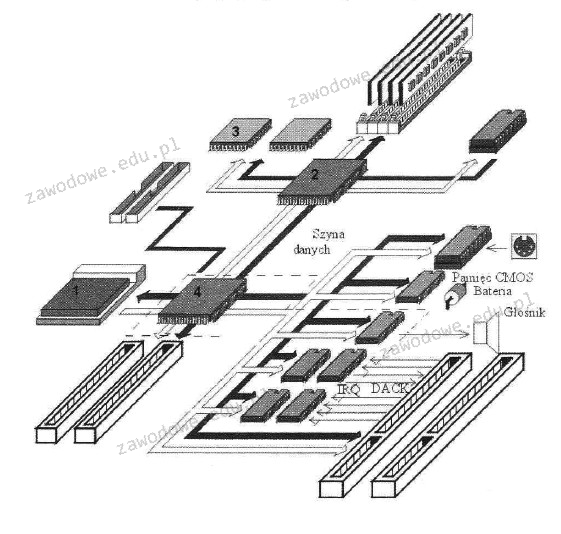

Jaką liczbą oznaczono procesor na diagramie płyty głównej komputera?

Kable światłowodowe nie są szeroko używane w lokalnych sieciach komputerowych z powodu

Jakie urządzenie jest pokazane na ilustracji?

Jakie narzędzie pozwala na zarządzanie menedżerem rozruchu w systemach Windows od wersji Vista?

Aby zweryfikować połączenia kabla U/UTP Cat. 5e w systemie okablowania strukturalnego, jakiego urządzenia należy użyć?

W skanerach z systemem CIS źródłem światła oświetlającym dokument jest

Lokalny komputer dysponuje adresem 192.168.0.5. Po otwarciu strony internetowej z tego urządzenia, która identyfikuje adresy w sieci, uzyskano informację, że adresem komputera jest 195.182.130.24. Co to oznacza?

Wskaź na zakres adresów IP klasy A, który jest przeznaczony do prywatnej adresacji w sieciach komputerowych?

Który z standardów korzysta z częstotliwości 5 GHz?

Jak sprawdzić, który z programów w systemie Windows generuje największe obciążenie dla procesora?

Jakie polecenie w terminalu systemu operacyjnego Microsoft Windows wyświetla dane dotyczące wszystkich zasobów udostępnionych na komputerze lokalnym?

Aby uruchomić monitor wydajności oraz niezawodności w systemie Windows, należy skorzystać z przystawki

Dane dotyczące kont użytkowników w systemie Linux są przechowywane w pliku

Który z poniższych programów nie jest wykorzystywany do zdalnego administrowania komputerami w sieci?

Jakie urządzenie NIE powinno być serwisowane podczas korzystania z urządzeń antystatycznych?

Transmisja w standardzie 100Base-T korzysta z kabli skrętkowych, które mają

Wskaż symbol umieszczany na urządzeniach elektrycznych przeznaczonych do sprzedaży i obrotu w Unii Europejskiej?