Pytanie 1

Jak na diagramach sieciowych LAN oznaczane są punkty dystrybucyjne znajdujące się na różnych kondygnacjach budynku, zgodnie z normą PN-EN 50173?

Wynik: 10/40 punktów (25,0%)

Wymagane minimum: 20 punktów (50%)

Jak na diagramach sieciowych LAN oznaczane są punkty dystrybucyjne znajdujące się na różnych kondygnacjach budynku, zgodnie z normą PN-EN 50173?

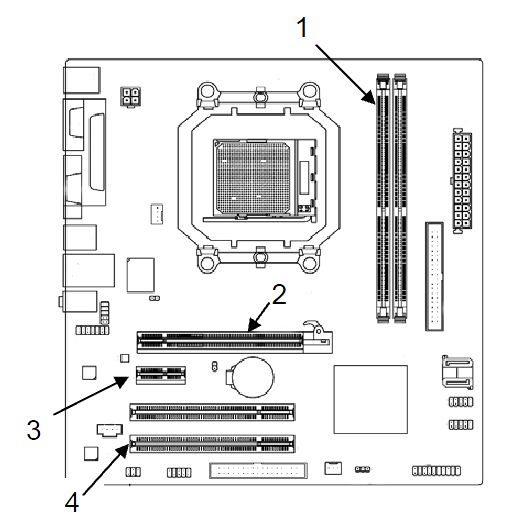

Na ilustracji widoczna jest pamięć operacyjna

Do weryfikacji funkcjonowania serwera DNS na systemach Windows Server można zastosować narzędzie nslookup. Jeżeli w poleceniu jako argument zostanie podana nazwa komputera, np. nslookup host.domena.com, to system sprawdzi

Klawiatura w układzie QWERTY, która pozwala na wpisywanie znaków typowych dla języka polskiego, jest znana jako klawiatura

Jednym z programów ochronnych, które zabezpieczają system przed oprogramowaniem, które bez zgody użytkownika zbiera i przesyła jego dane osobowe, numery kart kredytowych, informacje o odwiedzanych stronach WWW, hasła oraz używane adresy e-mail, jest aplikacja

Jaką maksymalną liczbę adresów można przypisać urządzeniom w sieci 10.0.0.0/22?

Złącze umieszczone na płycie głównej, które umożliwia podłączanie kart rozszerzeń o różnych ilościach pinów, w zależności od wersji, nazywane jest

Do interfejsów pracujących równolegle należy interfejs

Jaką maksymalną wartość rozplotu kabla UTP można uzyskać we wtyku RJ45 według normy PN-EN 50173?

Topologia fizyczna sieci komputerowej przedstawiona na ilustracji to topologia

Włączenie systemu Windows w trybie debugowania umożliwia

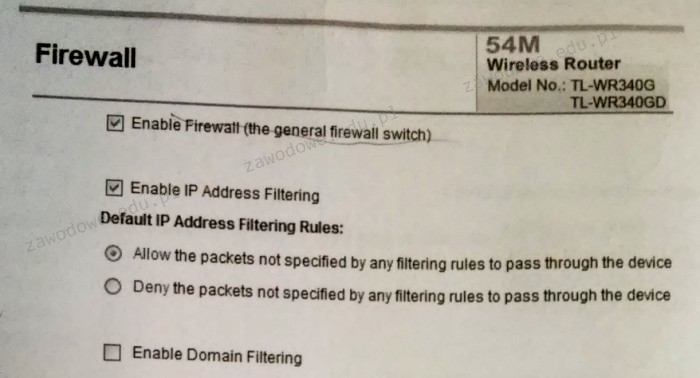

Poniższy rysunek ilustruje ustawienia zapory ogniowej w ruterze TL-WR340G. Jakie zasady dotyczące konfiguracji zapory zostały zastosowane?

Umożliwienie stacjom roboczym Windows, OS X oraz Linux korzystania z usług drukowania Linuxa i serwera plików zapewnia serwer

Ile hostów można zaadresować w podsieci z maską 255.255.255.248?

Aby zatrzymać wykonywanie programu zapisanego w pliku wsadowym Windows do momentu naciśnięcia dowolnego klawisza, należy zastosować komendę

Switch jako kluczowy komponent występuje w sieci o strukturze

W dokumentacji technicznej wydajność głośnika połączonego z komputerem wyraża się w jednostce:

Czym jest kopia różnicowa?

Aby poprawić bezpieczeństwo zasobów sieciowych, administrator sieci komputerowej w firmie otrzymał zadanie podziału aktualnej lokalnej sieci komputerowej na 16 podsieci. Obecna sieć posiada adres IP 192.168.20.0 i maskę 255.255.255.0. Jaką maskę sieci powinien zastosować administrator?

Lista sprzętu kompatybilnego z systemem operacyjnym Windows, publikowana przez firmę Microsoft to

W jakiej warstwie modelu ISO/OSI wykorzystywane są adresy logiczne?

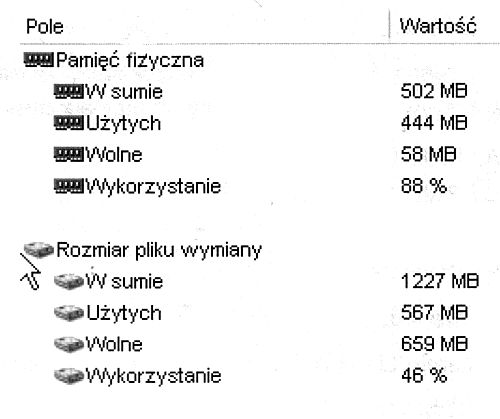

Zgodnie z zamieszczonym fragmentem testu w systemie komputerowym zainstalowane są

Dokument mający na celu przedstawienie oferty cenowej dla inwestora dotyczącej przeprowadzenia robót instalacyjnych w sieci komputerowej, to

Wskaż technologię stosowaną do zapewnienia dostępu do Internetu w połączeniu z usługą telewizji kablowej, w której światłowód oraz kabel koncentryczny pełnią rolę medium transmisyjnego

Która z wymienionych czynności konserwacyjnych związana jest wyłącznie z drukarką laserową?

Wskaż złącze, które nie jest obecne w zasilaczach ATX?

Wskaż poprawną kolejność czynności prowadzących do zamontowania procesora w gnieździe LGA na nowej płycie głównej, odłączonej od źródła zasilania.

| Nr czynności | Działanie |

|---|---|

| 1 | Odgięcie dźwigni i otwarcie klapki |

| 2 | Montaż układu chłodzącego |

| 3 | Zamknięcie klapki i dociśnięcie dźwigni |

| 4 | Podłączenie układu chłodzącego do zasilania |

| 5 | Lokalizacja gniazda procesora |

| 6 | Nałożenie pasty termoprzewodzącej |

| 7 | Włożenie procesora do gniazda |

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

W celu zainstalowania systemu openSUSE oraz dostosowania jego ustawień, można skorzystać z narzędzia

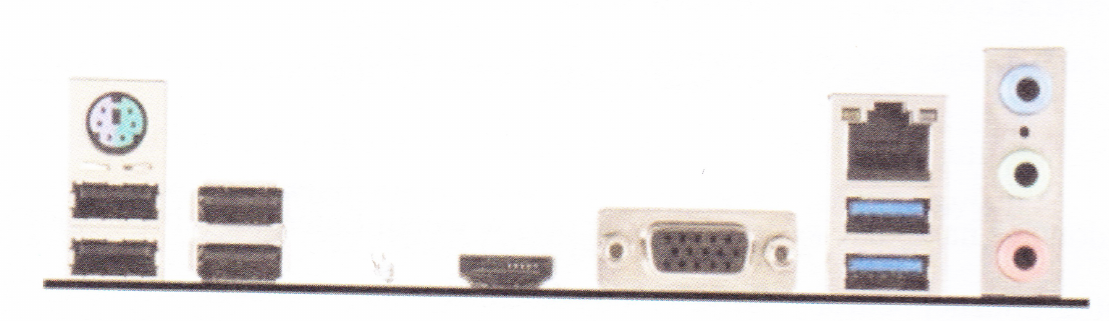

Zidentyfikuj interfejsy znajdujące się na panelu tylnym płyty głównej:

Który z protokołów przesyła datagramy użytkownika BEZ GWARANCJI ich dostarczenia?

Jakie informacje można uzyskać za pomocą programu Wireshark?

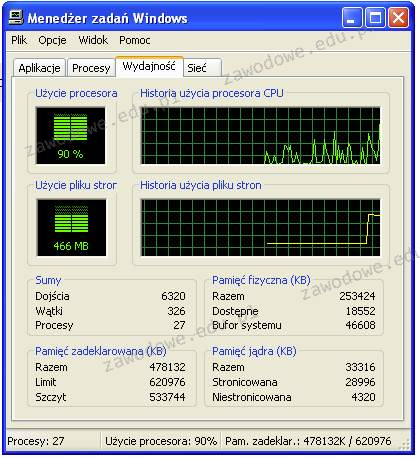

Przyglądając się przedstawionemu obrazkowi, można dostrzec, że deklarowany limit pamięci wynosi 620976 KB. Zauważamy również, że zainstalowana pamięć fizyczna w badanym systemie jest mniejsza niż pamięć zadeklarowana. Który typ pamięci wpływa na podniesienie limitu pamięci zadeklarowanej powyżej rozmiaru zainstalowanej pamięci fizycznej?

Aby naprawić zasilacz laptopa poprzez wymianę kondensatorów, jakie narzędzie powinno się wykorzystać?

Jakie urządzenie jest przedstawione na rysunku?

O ile zwiększy się liczba dostępnych adresów IP w podsieci po zmianie maski z 255.255.255.240 (/28) na 255.255.255.224 (/27)?

Cena wydrukowania jednej strony tekstu to 95 gr, a koszt przygotowania jednej płyty CD wynosi 1,54 zł. Jakie wydatki poniesie firma, tworząca płytę z prezentacjami oraz 120-stronicowy poradnik?

Jaką maskę domyślną mają adresy IP klasy B?

Na schemacie płyty głównej, gdzie można zamontować moduły pamięci RAM, gniazdo oznaczone cyfrą to

Głowica drukująca, składająca się z wielu dysz zintegrowanych z mechanizmem drukarki, wykorzystywana jest w drukarce