Pytanie 1

Jeśli sieć 172.16.6.0/26 zostanie podzielona na dwie równe podsieci, to ile adresowalnych hostów będzie w każdej z nich?

Wynik: 11/40 punktów (27,5%)

Wymagane minimum: 20 punktów (50%)

Jeśli sieć 172.16.6.0/26 zostanie podzielona na dwie równe podsieci, to ile adresowalnych hostów będzie w każdej z nich?

Firma uzyskała zakres adresów 10.10.10.0/16. Po podzieleniu na podsieci zawierające 510 hostów, jakie są adresy podsieci z zastosowaną maską?

Jakie funkcje pełni protokół ARP (Address Resolution Protocol)?

Jak należy rozmieszczać gniazda komputerowe RJ45 w odniesieniu do przestrzeni biurowej zgodnie z normą PN-EN 50174?

Określenie najlepszej trasy dla połączenia w sieci to

Jakie urządzenie pozwala na podłączenie drukarki, która nie ma karty sieciowej, do lokalnej sieci komputerowej?

Jakie parametry można śledzić w przypadku urządzenia przy pomocy S.M.A.R.T.?

Administrator pragnie udostępnić w sieci folder c:\instrukcje tylko trzem użytkownikom z grupy Serwisanci. Jakie działanie powinien podjąć?

Aby podłączyć 6 komputerów do sieci przy użyciu światłowodu, potrzebny jest kabel z co najmniej taką ilością włókien:

Jakie narzędzie jest używane do zarządzania alokacjami dyskowymi w systemach Windows 7 i Windows 8?

Zainstalowanie gniazda typu keystone w serwerowej szafie jest możliwe w

Który z poniższych programów nie jest wykorzystywany do zdalnego administrowania komputerami w sieci?

Pomiar strukturalnego okablowania metodą Permanent Link polega na

Program, który nie jest przeznaczony do analizy stanu komputera to

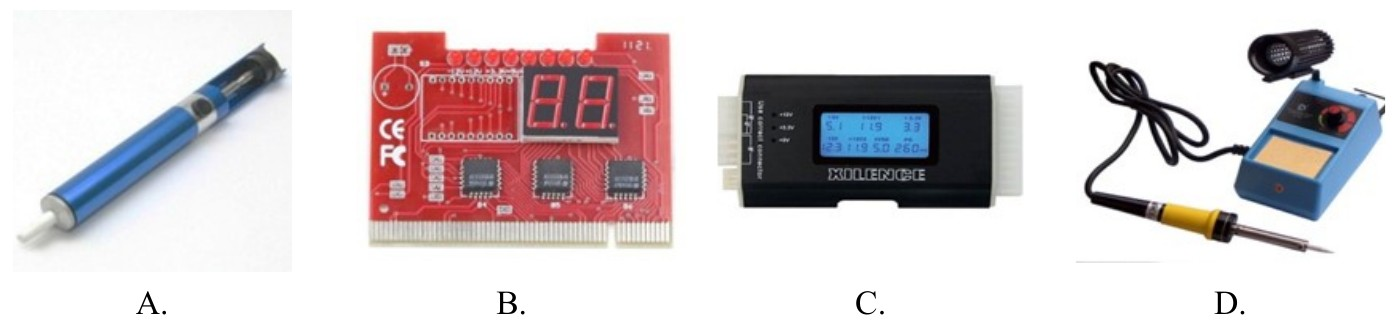

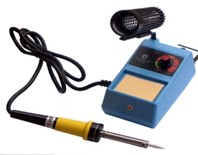

Jakie narzędzie powinno być użyte do zbadania wyników testu POST dla modułów na płycie głównej?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Który z standardów korzysta z częstotliwości 5 GHz?

W wyniku wykonania przedstawionych poleceń systemu Linux interfejs sieciowy eth0 otrzyma:

ifconfig eth0 10.0.0.100 netmask 255.255.255.0 broadcast 10.0.0.255 up route add default gw 10.0.0.10

Które narzędzie należy wykorzystać do uzyskania wyników testu POST dla modułów płyty głównej?

Który profil użytkownika ulega modyfikacji i jest zapisywany na serwerze dla klienta działającego w sieci Windows?

Na ilustracji zaprezentowano strukturę topologiczną

Które z poniższych twierdzeń nie odnosi się do pamięci cache L1?

Urządzenie używane do zestawienia 6 komputerów w sieci lokalnej to:

Termin "PIO Mode" odnosi się do trybu operacyjnego

Oznaczenie CE świadczy o tym, że

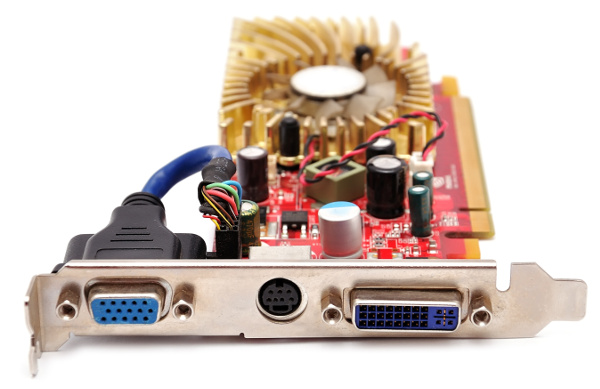

Na przedstawionej fotografii karta graficzna ma widoczne złącza

Który z początkowych znaków w nazwie pliku w systemie Windows wskazuje na plik tymczasowy?

Pliki specjalne urządzeń, tworzone podczas instalacji sterowników w systemie Linux, są zapisywane w katalogu

Użytkownik dysponuje komputerem o podanej konfiguracji i systemie Windows 7 Professional 32bit. Która z opcji modernizacji komputera NIE przyczyni się do zwiększenia wydajności?

| Płyta główna | ASRock Z97 Anniversary Z97 DualDDR3-1600 SATA3 RAID HDMI ATX z czterema slotami DDR3 i obsługą RAID poziomu 0,1 |

| Procesor | i3 |

| Pamięć | 1 x 4 GB DDR3 |

| HDD | 2 x 1 TB |

Cechą oprogramowania służącego do monitorowania zdarzeń metodą Out-Of-Band w urządzeniach sieciowych jest

Jakie złącze powinna mieć karta graficzna, aby mogła być bezpośrednio podłączona do telewizora LCD, który ma tylko analogowe złącze do komputera?

Jakie narzędzie służy do usuwania izolacji z włókna światłowodowego?

Domyślny port, na którym działa usługa "Pulpit zdalny", to

W celu zapewnienia jakości usługi QoS, w przełącznikach warstwy dostępu stosuje się mechanizm

Zgodnie z normą TIA/EIA-568-B.1 kabel UTP 5e z przeplotem powstaje poprzez zamianę lokalizacji w wtyczce 8P8C następujących par żył (odpowiednio według kolorów):

Aby zweryfikować adresy MAC komputerów, które są połączone z przełącznikiem, można zastosować następujące polecenie

Który adres IP posiada maskę w postaci pełnej, zgodną z klasą adresu?

W sieciach opartych na standardzie, jaką metodę dostępu do medium wykorzystuje CSMA/CA?

Który model pamięci RAM, można umieścić na płycie, której fragment specyfikacji przedstawiono na ilustracji?

| Pamięć | |

|---|---|

| Obsługiwana pamięć | DDR4 |

| Rodzaj obsługiwanej pamięci | DIMM (do PC) |

| Typ obsługiwanej pamięci | DDR4-2133 (PC4-17000) DDR4-2400 (PC4-19200) DDR4-2666 (PC4-21300) DDR4-2800 (PC4-22400) DDR4-3200 (PC4-25600) |

| Typ obsługiwanej pamięci OC | DDR4-3466 (PC4-27700) DDR4-3600 (PC4-28800) DDR4-3866 (PC4-30900) DDR4-4000 (PC4-32000) DDR4-4133 (PC4-33000) DDR4-4400 (PC4-35200) DDR4-4600 (PC4-36800) |

| Dwukanałowa obsługa pamięci | tak |

| Ilość gniazd pamięci | 4 szt. |

| Maks. pojemność pamięci | 128 GB |

Ilustracja pokazuje rezultat testu sieci komputerowej za pomocą komendy