Pytanie 1

Jaki instrument jest wykorzystywany do sprawdzania zasilaczy komputerowych?

Wynik: 27/40 punktów (67,5%)

Wymagane minimum: 20 punktów (50%)

Jaki instrument jest wykorzystywany do sprawdzania zasilaczy komputerowych?

Aby sprawdzić, czy zainstalowana karta graficzna w komputerze jest przegrzewana, użytkownik ma możliwość użycia programu

Aktualizacja systemów operacyjnych to proces, którego głównym zadaniem jest

Analizując ruch w sieci, zauważono, że na adres serwera kierowano tysiące zapytań DNS na sekundę z różnych adresów IP, co doprowadziło do zawieszenia systemu operacyjnego. Przyczyną tego zjawiska był atak typu

Trzech użytkowników komputera z systemem operacyjnym Windows XP Pro posiada swoje foldery z dokumentami w głównym katalogu dysku C:. Na dysku znajduje się system plików NTFS. Użytkownicy mają utworzone konta z ograniczonymi uprawnieniami. Jak można zabezpieczyć folder każdego z użytkowników, aby inni nie mieli możliwości modyfikacji jego zawartości?

Twórca zamieszczonego programu pozwala na jego darmowe korzystanie tylko w przypadku

| Ancient Domains of Mystery | |

|---|---|

| Autor | Thomas Biskup |

| Platforma sprzętowa | DOS, OS/2, Macintosh, Microsoft Windows, Linux |

| Pierwsze wydanie | 23 października 1994 |

| Aktualna wersja stabilna | 1.1.1 / 20 listopada 2002 r. |

| Aktualna wersja testowa | 1.2.0 Prerelease 18 / 1 listopada 2013 |

| Licencja | postcardware |

| Rodzaj | roguelike |

Aby zwiększyć lub zmniejszyć rozmiar ikony na pulpicie, należy obracać kółkiem myszy, trzymając jednocześnie wciśnięty klawisz

Co nie wpływa na utratę z pamięci masowej HDD?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Poleceniem systemu Linux służącym do wyświetlenia informacji, zawierających aktualną godzinę, czas działania systemu oraz liczbę zalogowanych użytkowników, jest

Jakie polecenie w systemie Windows powinno zostać użyte, aby uzyskać wynik zbliżony do tego na załączonym obrazku?

TCP 192.168.0.14:57989 185.118.124.154:http ESTABLISHED TCP 192.168.0.14:57997 fra15s17-in-f8:http ESTABLISHED TCP 192.168.0.14:58010 fra15s11-in-f14:https TIME_WAIT TCP 192.168.0.14:58014 wk-in-f156:https ESTABLISHED TCP 192.168.0.14:58015 wk-in-f156:https TIME_WAIT TCP 192.168.0.14:58016 104.20.87.108:https ESTABLISHED TCP 192.168.0.14:58022 ip-2:http TIME_WAIT

Jaką funkcję pełni serwer FTP?

Aby bezpiecznie połączyć się z firmowym serwerem przez Internet i mieć dostęp do zasobów firmy, należy wykorzystać odpowiednie oprogramowanie klienckie

Które urządzenie należy zainstalować, w celu zwiększenia obszaru zasięgu sieci bezprzewodowej?

Wskaż komponent, który reguluje wartość napięcia pochodzącego z sieci elektrycznej, wykorzystując transformator do przeniesienia energii między dwoma obwodami elektrycznymi z zastosowaniem zjawiska indukcji magnetycznej?

W przedsiębiorstwie zastosowano adres klasy B do podziału na 100 podsieci, z maksymalnie 510 dostępnymi adresami IP w każdej z nich. Jaka maska została użyta do utworzenia tych podsieci?

Zwiększenie zarówno wydajności operacji (zapis/odczyt), jak i bezpieczeństwa przechowywania danych jest możliwe dzięki zastosowaniu macierzy dyskowej

Administrator Active Directory w domenie firma.local pragnie skonfigurować mobilny profil dla wszystkich użytkowników. Ma on być przechowywany na serwerze serwer1, w folderze pliki, który jest udostępniony w sieci jako dane$. Który z parametrów w ustawieniach profilu użytkownika spełnia opisane wymagania?

Który adres IP reprezentuje hosta działającego w sieci o adresie 192.168.160.224/28?

Która z wymienionych właściwości kabla koncentrycznego RG-58 sprawia, że nie jest on obecnie używany do tworzenia lokalnych sieci komputerowych?

Zadania systemu operacyjnego nie obejmują

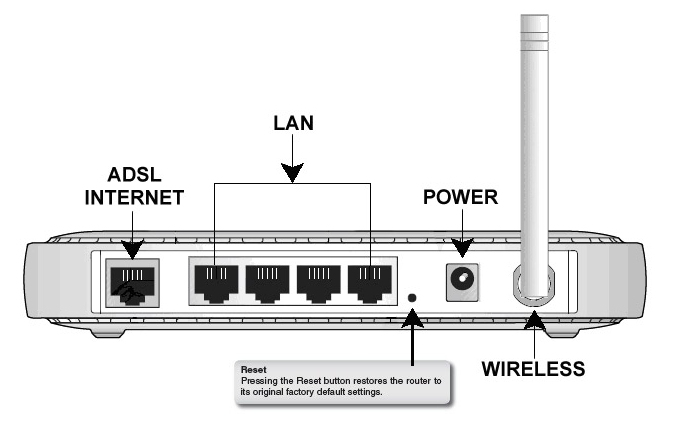

Przycisk znajdujący się na obudowie rutera, którego charakterystyka została podana w ramce, służy do

Zastosowanie programu Wireshark polega na

Na dysku należy umieścić 100 tysięcy oddzielnych plików, z których każdy ma rozmiar 2570 bajtów. W takim przypadku, zapisane pliki będą zajmować najmniej miejsca na dysku z jednostką alokacji wynoszącą

Wskaż koszt brutto wykonanych przez serwisanta usług, jeśli do rachunku doliczony jest również koszt dojazdu w wysokości 55,00 zł netto.

| LP | Wykonana usługa | Cena usługi netto w zł | Stawka podatku VAT |

|---|---|---|---|

| 1. | Instalacja/ konfiguracja programu | 10,00 | 23% |

| 2. | Wymiana zasilacza | 40,00 | |

| 3. | Tworzenie kopii zapasowej i archiwizacja danych | 40,00 | |

| 4. | Konfiguracja przełącznika | 25,00 | |

| 5. | Instalacja i konfiguracja skanera | 45,00 |

Aby podłączyć dysk z interfejsem SAS, należy użyć kabla przedstawionego na diagramie

Aby umożliwić wymianę informacji pomiędzy sieciami VLAN, wykorzystuje się

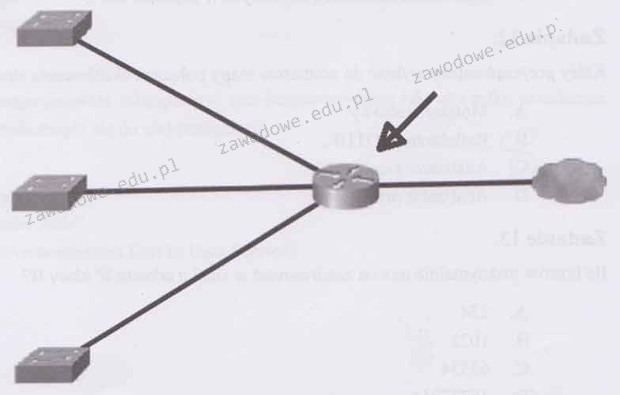

Którego urządzenia dotyczy strzałka na rysunku?

Które z kont nie jest wbudowanym kontem w systemie Windows XP?

Jakie urządzenie pełni rolę wskaźnika?

W systemie Windows, po wydaniu komendy systeminfo, nie da się uzyskać danych o

Po wykonaniu eksportu klucza HKCU zostanie zapisana kopia rejestru zawierająca informacje, dotyczące konfiguracji

Płyta główna wyposażona w gniazdo G2 będzie współpracowała z procesorem

Wskaż procesor współpracujący z przedstawioną płytą główną.

Ile wyniesie całkowity koszt wymiany karty sieciowej w komputerze, jeżeli cena karty to 40 zł, czas pracy serwisanta wyniesie 90 minut, a koszt każdej rozpoczętej roboczogodziny to 60 zł?

W systemie oktalnym liczba heksadecymalna 1E2F16 ma zapis w postaci

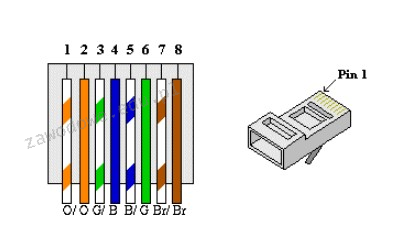

Na rysunku przedstawiono schemat ethernetowego połączenia niekrosowanych, ośmiopinowych złączy 8P8C. Jaką nazwę nosi ten schemat?

Jakie urządzenie powinno być użyte do podłączenia komputerów, aby mogły działać w różnych domenach rozgłoszeniowych?

Aby poprawić bezpieczeństwo prywatnych danych sesji na stronie internetowej, zaleca się dezaktywację w ustawieniach przeglądarki

Jakie będą całkowite wydatki na materiały potrzebne do stworzenia 20 kabli połączeniowych typu patchcord, z których każdy ma długość 1,5m, jeśli cena 1 metra bieżącego kabla wynosi 1zł, a cena wtyku to 50 gr?