Pytanie 1

W medycznym przyspieszaczu liniowym jest generowana wiązka fotonów o energii w zakresie

Wynik: 22/40 punktów (55,0%)

Wymagane minimum: 20 punktów (50%)

W medycznym przyspieszaczu liniowym jest generowana wiązka fotonów o energii w zakresie

Która sekwencja obrazowania MR wykorzystuje impulsy RF o częstotliwości rezonansowej tłuszczu do tłumienia sygnału pochodzącego z tkanki tłuszczowej?

Który materiał światłoczuły należy zastosować w rentgenodiagnostyce analogowej, by zminimalizować dawkę promieniowania jonizującego otrzymaną przez pacjenta?

W obrazowaniu MR wykorzystuje się moment magnetyczny

W medycynie nuklearnej wykorzystuje się:

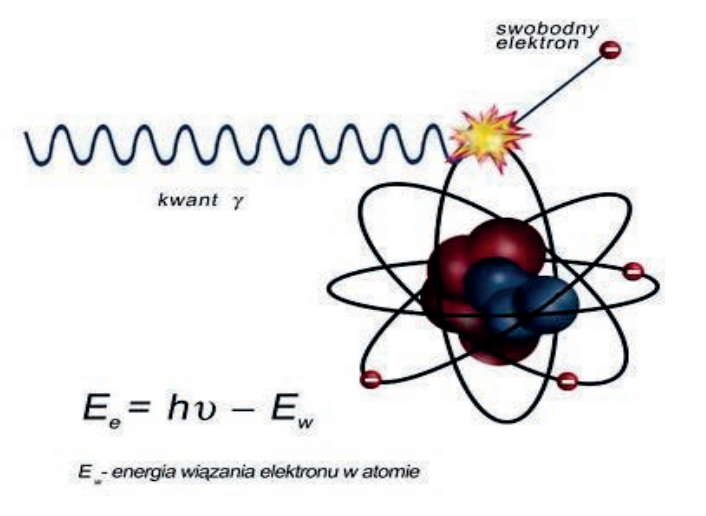

Rozpraszanie promieniowania X, w wyniku którego następuje zwiększenie długości fali promieniowania, to zjawisko

Zwiększenie napięcia na lampie rentgenowskiej powoduje

Jakie źródła promieniowania stosowane są w brachyterapii?

W badaniu PET CT wykorzystuje się radioizotopy emitujące promieniowanie

Promieniowanie rentgenowskie jest

Nieostrość geometryczna obrazu rentgenowskiego zależy od

Jaki jest cel stosowania bolusa w radioterapii?

W badaniu MR czas repetycji TR jest parametrem określającym odstęp czasu między

Planowany obszar napromieniania PTV obejmuje

Testy podstawowe z zakresu geometrii pola rentgenowskiego, przeznaczone do sprawdzenia zgodności pola wiązki promieniowania rentgenowskiego z symulacją świetlną, są wykonywane raz

W radiologii analogowej lampy rentgenowskiej z tubusem używa się do wykonania zdjęcia

Standardowo do wykonania których zdjęć należy zastosować kratkę przeciwrozproszeniową?

Podczas badania gammakamerą źródłem promieniowania jest

Brachyterapia polegająca na wielokrotnym wsuwaniu i wysuwaniu źródła promieniowania do tego samego aplikatora nosi nazwę

Do czego służy do symulator rentgenowski wykorzystywany w procesie radioterapii?

W lampie rentgenowskiej promieniowanie X powstaje w wyniku hamowania

Elementem systemu rejestracji obrazu, w którym fotony promieniowania X są bezpośrednio konwertowane na sygnał elektryczny, jest

Zastosowana w badaniu radiologicznym kratka przeciwrozproszeniowa powoduje

Nieostrość geometryczna obrazu rentgenowskiego zależy od

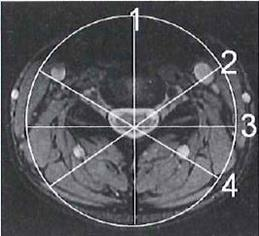

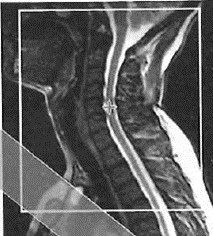

Na którym obrazie MR jest widoczne pasmo saturacji?

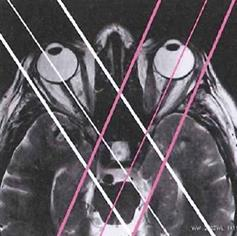

Wskaż przyczynę powstania artefaktu widocznego na obrazie MR.

Na zamieszczonej rycinie przedstawiono

Przemiana promieniotwórcza radu w ren opisana wzorem \( {}_{88}^{226}\text{Ra} \to {}_{86}^{222}\text{Rn} + {}_{2}^{4}\text{He} \) jest rozpadem

Która przyczyna spowodowała powstanie artefaktu widocznego na zamieszczonym obrazie MR?

Jaka jest odległość pomiędzy źródłem promieniowania a powierzchnią ciała pacjenta w technice izocentrycznej radioterapii?

W której technice obrazowania zostają zarejestrowane jednocześnie dwa przeciwbieżne kwanty promieniowania gamma o równej energii 511 keV?

W radioterapii konwencjonalnej pacjent jest leczony promieniowaniem pochodzącym

Do pomiaru dawek indywidualnych u osób narażonych zawodowo na promieniowanie rentgenowskie są stosowane

Gruboziarnista folia wzmacniająca wpływa na zwiększenie na obrazie rentgenowskim nieostrości

Promieniowanie rentgenowskie jest

Ligand stosuje się

Brachyterapia polega na napromieniowaniu pacjenta promieniowaniem

W której technice brachyterapii stosuje się źródła promieniowania o mocy dawki 2-12 Gy/h?

Hiperfrakcjonowanie dawki w teleradioterapii polega na napromienianiu 2 do 3 razy dziennie dawką frakcyjną

W sekwencji echa spinowego obraz T2-zależny uzyskuje się przy czasie repetycji TR