Pytanie 1

Użytkownik systemu Windows doświadcza problemów z niewystarczającą pamięcią wirtualną. Jak można temu zaradzić?

Wynik: 15/40 punktów (37,5%)

Wymagane minimum: 20 punktów (50%)

Użytkownik systemu Windows doświadcza problemów z niewystarczającą pamięcią wirtualną. Jak można temu zaradzić?

W komputerze zainstalowano nowy dysk twardy o pojemności 8 TB i podzielono go na dwie partycje, z których każda ma 4 TB. Jaki typ tablicy partycji powinien być zastosowany, aby umożliwić takie partycjonowanie?

Który model pamięci RAM, można umieścić na płycie, której fragment specyfikacji przedstawiono na ilustracji?

| Pamięć | |

|---|---|

| Obsługiwana pamięć | DDR4 |

| Rodzaj obsługiwanej pamięci | DIMM (do PC) |

| Typ obsługiwanej pamięci | DDR4-2133 (PC4-17000) DDR4-2400 (PC4-19200) DDR4-2666 (PC4-21300) DDR4-2800 (PC4-22400) DDR4-3200 (PC4-25600) |

| Typ obsługiwanej pamięci OC | DDR4-3466 (PC4-27700) DDR4-3600 (PC4-28800) DDR4-3866 (PC4-30900) DDR4-4000 (PC4-32000) DDR4-4133 (PC4-33000) DDR4-4400 (PC4-35200) DDR4-4600 (PC4-36800) |

| Dwukanałowa obsługa pamięci | tak |

| Ilość gniazd pamięci | 4 szt. |

| Maks. pojemność pamięci | 128 GB |

Do interfejsów pracujących równolegle należy interfejs

Aplikacją systemu Windows, która umożliwia analizę wpływu różnych procesów i usług na wydajność CPU oraz oceny stopnia obciążenia pamięci i dysku, jest

Jakie jest źródło pojawienia się komunikatu na ekranie komputera, informującego o wykryciu konfliktu adresów IP?

Jaką usługę powinno się aktywować na ruterze, aby każda stacja robocza mogła wymieniać pakiety z siecią Internet, gdy dostępnych jest 5 adresów publicznych oraz 18 stacji roboczych?

Z informacji przedstawionych w tabeli wynika, że efektywna częstotliwość pamięci DDR SDRAM wynosi

| 184 styki |

| 64-bitowa szyna danych |

| Pojemność 1024 MB |

| Przepustowość 3200 MB/s |

Na załączonym rysunku przedstawiono

W skład sieci komputerowej wchodzi 3 komputery stacjonarne oraz drukarka sieciowa, które są połączone kablem UTP z routerem mającym porty 1 x WAN oraz 5 x LAN. Które urządzenie sieciowe pozwoli na dołączenie kablem UTP dwóch dodatkowych komputerów do tej sieci?

Funkcja znana jako: "Pulpit zdalny" standardowo operuje na porcie

Który z adresów protokołu IP w wersji 4 jest poprawny pod względem struktury?

Osoba korzystająca z systemu Windows zdecydowała się na przywrócenie systemu do określonego punktu. Które pliki utworzone po tym punkcie NIE zostaną zmienione w wyniku tej operacji?

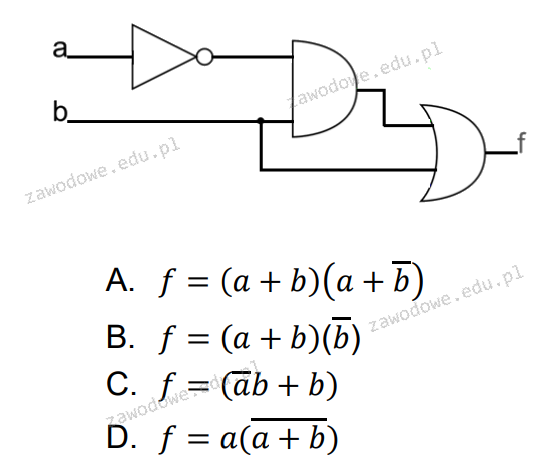

Jaką funkcję wykonuje zaprezentowany układ?

Określ rezultat wykonania zamieszczonego polecenia

| net user Test /expires:12/09/20 |

Najczęstszym powodem rozmazywania się tonera na wydrukach z drukarki laserowej jest

Który symbol przedstawia przełącznik?

Którego narzędzia można użyć, aby prześledzić trasę, którą pokonują pakiety w sieciach?

Jak określana jest transmisja w obie strony w sieci Ethernet?

Jakie polecenie w systemie Linux umożliwia wyświetlenie identyfikatora użytkownika?

Który procesor jest kompatybilny z płytą główną o przedstawionej specyfikacji?

ASUS micro-ATX, socket 1150, VT-d, DDR3 `1333, 1600 MHz), ATI Radeon X1250, 3 x PCI-Express x1, 3 x PCI-Express x16, 2 x Serial ATA III, USB 3.0, VGA, HDMI, DVI-D

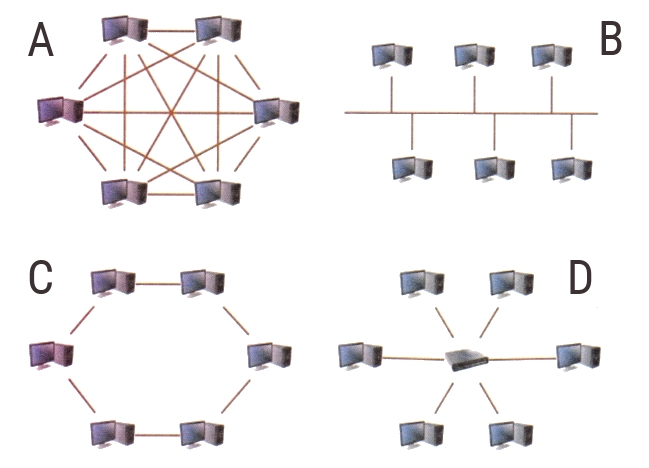

Która z przedstawionych na rysunkach topologii jest topologią siatkową?

Aby w systemie Windows ustawić właściwości wszystkich zainstalowanych urządzeń lub wyświetlić ich listę, należy użyć narzędzia

Program df pracujący w systemach z rodziny Linux pozwala na wyświetlenie

Które z poniższych kont nie jest wbudowane w system Windows XP?

Urządzenie komputerowe, które powinno być koniecznie podłączone do zasilania za pomocą UPS, to

Która z poniższych czynności NIE przyczynia się do personalizacji systemu operacyjnego Windows?

Która z licencji umożliwia korzystanie przez każdego użytkownika z programu bez ograniczeń wynikających z autorskich praw majątkowych?

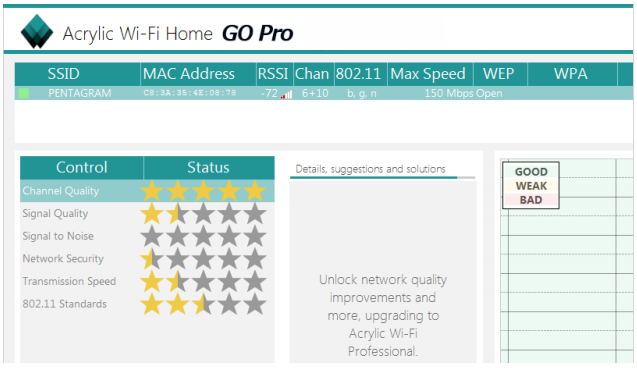

W programie Acrylic Wi-Fi Home przeprowadzono test, którego rezultaty ukazano na zrzucie ekranu. Na ich podstawie można stwierdzić, że sieć bezprzewodowa dostępna w danym momencie

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Który algorytm służy do weryfikacji, czy ramka Ethernet jest wolna od błędów?

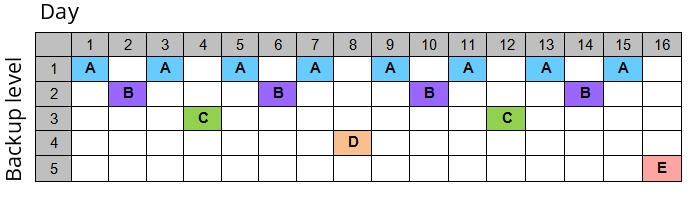

Strategia przedstawiona w diagramie dla tworzenia kopii zapasowych na nośnikach jest znana jako

Oprogramowanie OEM (Original Equipment Manufacturer) jest przypisane do

Który z protokołów w systemach operacyjnych Linux jest używany w sieciach lokalnych?

Do wykonania kopii danych na dysk USB w systemie Linux stosuje się polecenie

Na którym z domyślnych portów realizowana jest komunikacja protokołu ftp?

Aby monitorować stan dysków twardych w serwerach, komputerach osobistych i laptopach, można użyć programu

Na 16 bitach możemy przechować

W których nośnikach pamięci masowej jedną z najczęstszych przyczyn uszkodzeń jest uszkodzenie powierzchni?

Jak nazywa się system, który pozwala na konwersję nazwy komputera na adres IP w danej sieci?