Pytanie 1

Która z poniższych wskazówek nie jest właściwa w kontekście konserwacji skanera płaskiego?

Wynik: 17/40 punktów (42,5%)

Wymagane minimum: 20 punktów (50%)

Która z poniższych wskazówek nie jest właściwa w kontekście konserwacji skanera płaskiego?

Grupa, w której członkom można nadawać uprawnienia jedynie w obrębie tej samej domeny, co domena nadrzędna lokalnej grupy domeny, nosi nazwę grupa

Zarządzanie partycjami w systemach operacyjnych Windows

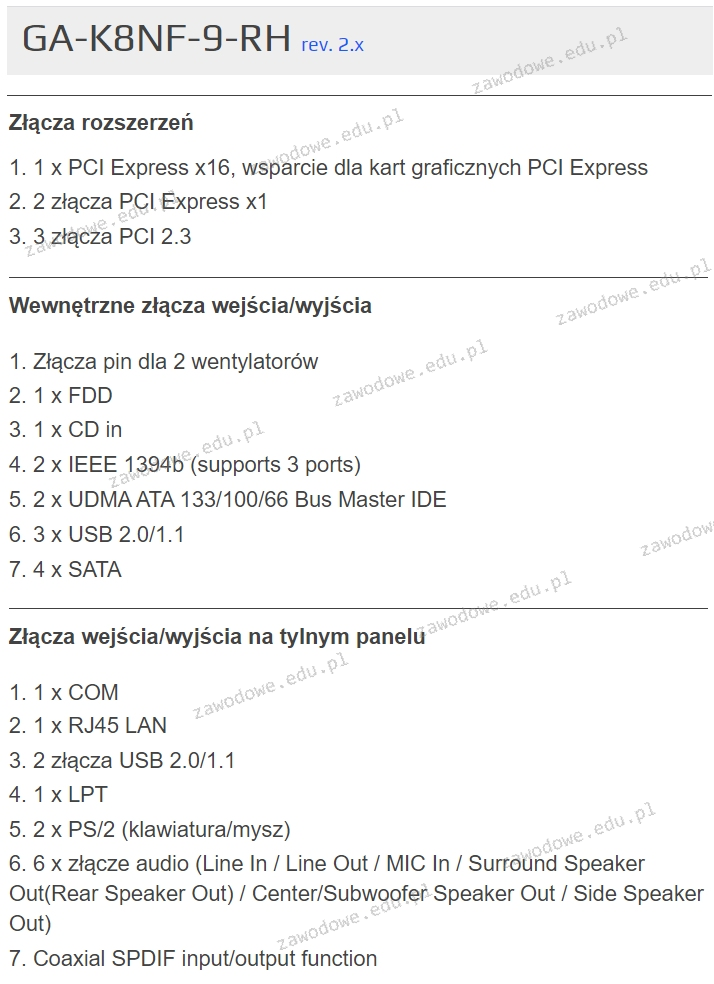

Na ilustracji ukazano fragment dokumentacji technicznej płyty głównej GA-K8NF-9-RH rev. 2.x. Z informacji wynika, że maksymalna liczba kart rozszerzeń, które można zainstalować (pomijając złącza USB), wynosi

Która z licencji ma charakter grupowy i pozwala instytucjom komercyjnym oraz organizacjom edukacyjnym, państwowym i charytatywnym na zakup większej ilości oprogramowania firmy Microsoft na korzystnych zasadach?

Układ na karcie graficznej, którego zadaniem jest zamiana cyfrowego sygnału generowanego poprzez kartę na sygnał analogowy, który może być wyświetlony poprzez monitor to

Który standard z rodziny IEEE 802 odnosi się do sieci bezprzewodowych, zwanych Wireless LAN?

Ile sieci obejmują komputery z adresami IP i maskami sieci podanymi w tabeli?

| Adres IPv4 | Maska |

|---|---|

| 10.120.16.10 | 255.255.0.0 |

| 10.120.18.16 | 255.255.0.0 |

| 10.110.16.18 | 255.255.255.0 |

| 10.110.16.14 | 255.255.255.0 |

| 10.130.16.12 | 255.255.255.0 |

Jaką maksymalną liczbę hostów można przypisać w lokalnej sieci, dysponując jedną klasą C adresów IPv4?

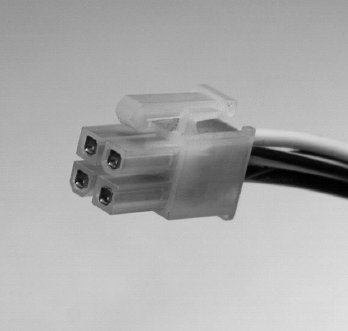

Wtyczka zaprezentowana na fotografie stanowi element obwodu elektrycznego zasilającego

W sieciach komputerowych miarą prędkości przesyłu danych jest

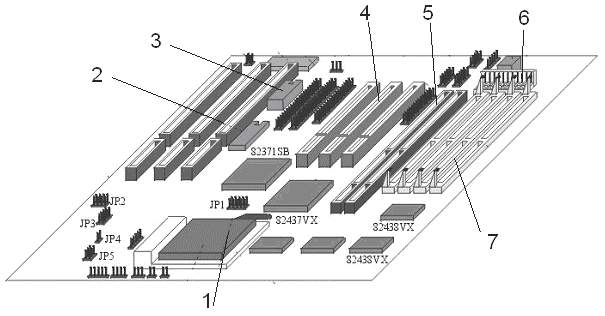

Na ilustracji zobrazowano

Do dynamicznej obsługi sprzętu w Linuxie jest stosowany system

Jak nazywa się protokół odpowiedzialny za wysyłkę wiadomości e-mail?

Na schemacie przedstawionej płyty głównej zasilanie powinno być podłączone do gniazda oznaczonego numerem

Zaprezentowany komunikat jest rezultatem wykonania następującego polecenia

C:\Windows NT_SERVICE\TrustedInstaller:(F)

NT_SERVICE\TrustedInstaller:(CI)(IO)(F)

ZARZĄDZANIE NT\SYSTEM:(M)

ZARZĄDZANIE NT\SYSTEM:(OI)(CI)(IO)(F)

BUILTIN\Administratorzy:(M)

BUILTIN\Administratorzy:(OI)(CI)(IO)(F)

BUILTIN\Użytkownicy:(RX)

BUILTIN\Użytkownicy:(OI)(CI)(IO)(GR,GE)

TWÓRCA-WŁAŚCICIEL:(OI)(CI)(IO)(F)

Sieć lokalna posiada adres IP 192.168.0.0/25. Który adres IP odpowiada stacji roboczej w tej sieci?

Aby załadować projekt wydruku bezpośrednio z komputera do drukarki 3D, której parametry przedstawiono w tabeli, można użyć złącza

| Technologia pracy | FDM (Fused Deposition Modeling) |

| Głowica drukująca | Podwójny ekstruder z unikalnym systemem unoszenia dyszy i wymiennymi modułami drukującymi (PrintCore) |

| Średnica filamentu | 2,85 mm |

| Platforma drukowania | Szklana, podgrzewana |

| Temperatura platformy | 20°C – 100°C |

| Temperatura dyszy | 180°C – 280°C |

| Łączność | WiFi, Ethernet, USB |

| Rozpoznawanie materiału | Skaner NFC |

W systemie Linux, gdzie przechowywane są hasła użytkowników?

Które z poniższych poleceń służy do naprawienia głównego rekordu rozruchowego dysku twardego w systemie Windows?

Narzędziem do monitorowania, które umożliwia przechwytywanie, rejestrowanie oraz dekodowanie różnych pakietów sieciowych, jest

Cienki klient (thin client) korzysta z protokołu

Zgodnie z normą TIA/EIA-568-B.1 kabel UTP 5e z przeplotem powstaje poprzez zamianę lokalizacji w wtyczce 8P8C następujących par żył (odpowiednio według kolorów):

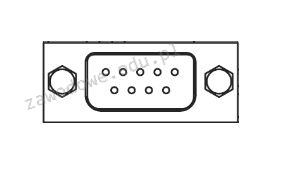

Obrazek ilustruje rodzaj złącza

Przy pomocy testów statycznych okablowania można zidentyfikować

Którego urządzenia z zakresu sieci komputerowych dotyczy symbol przedstawiony na ilustracji?

W doborze zasilacza do komputera kluczowe znaczenie

Określ najprawdopodobniejszą przyczynę pojawienia się komunikatu: CMOS checksum error press F1 to continue press DEL to setup podczas uruchamiania systemu

Który z protokołów służy do weryfikacji poprawności połączenia pomiędzy dwoma hostami?

Wskaż rodzaj konserwacji, który powinien być przeprowadzony, gdy na wydruku z drukarki atramentowej pojawiają się smugi, kolory są nieprawidłowe lub brakuje niektórych barw.

Diagnostykę systemu Linux można przeprowadzić za pomocą komendy

| Thread(s) per core: | 1 |

| Core(s) per socket: | 4 |

| Socket(s): | 1 |

| NUMA node(s): | 1 |

Interfejs HDMI w komputerze umożliwia przesyłanie sygnału

Do instalacji i usuwania oprogramowania w systemie Ubuntu wykorzystywany jest menedżer

Aby zmierzyć moc zużywaną przez komputer, należy zastosować

Jaka jest maksymalna prędkość transferu danych w sieci lokalnej, w której zastosowano przewód UTP kat.5e do budowy okablowania strukturalnego?

Do pomiaru wartości mocy pobieranej przez zestaw komputerowy służy

Który z systemów operacyjnych przeznaczonych do pracy w sieci jest dostępny na podstawie licencji GNU?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Ile warstw zawiera model ISO/OSI?

Które wbudowane narzędzie systemu Windows pozwala rozwiązywać problemy z błędnymi sektorami i integralnością plików?