Pytanie 1

Urządzenie przedstawione na obrazie jest przeznaczone do

Wynik: 20/40 punktów (50,0%)

Wymagane minimum: 20 punktów (50%)

Urządzenie przedstawione na obrazie jest przeznaczone do

Cienki klient (thin client) korzysta z protokołu

Watomierz jest stosowany do pomiaru

Jakim protokołem jest protokół dostępu do sieci pakietowej o maksymalnej prędkości 2 Mbit/s?

Czym jest MFT w systemie plików NTFS?

Wskaż komponent, który reguluje wartość napięcia pochodzącego z sieci elektrycznej, wykorzystując transformator do przeniesienia energii między dwoma obwodami elektrycznymi z zastosowaniem zjawiska indukcji magnetycznej?

Aby zwiększyć lub zmniejszyć wielkość ikony na pulpicie, należy obracać kółkiem myszy, trzymając jednocześnie klawisz:

Która z opcji konfiguracji ustawień konta użytkownika o ograniczonych uprawnieniach w systemie Windows jest dostępna dzięki narzędziu secpol?

W systemie Linux dane dotyczące haseł użytkowników są zapisywane w pliku:

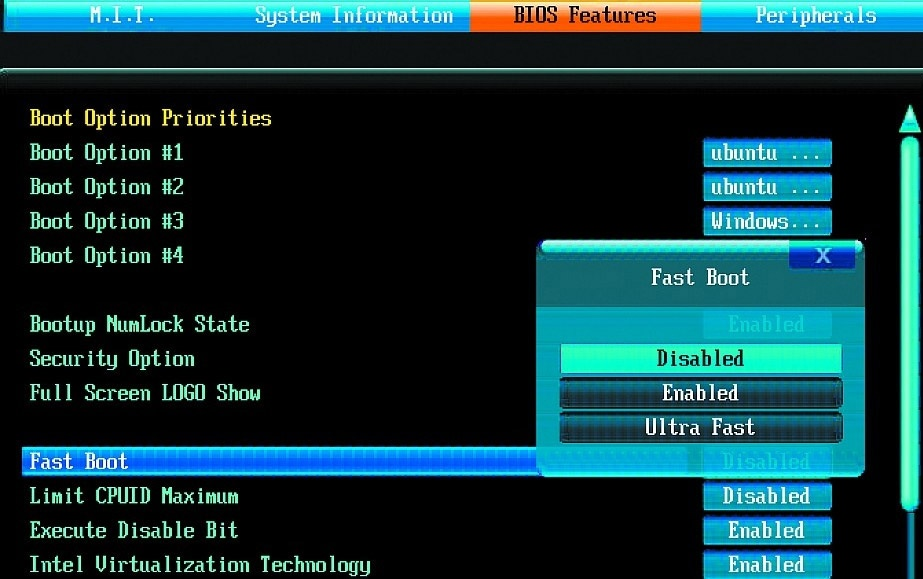

Co spowoduje zmiana opcji Fast Boot na wartość Enabledw konfiguracji BIOS przedstawionej na ilustracji?

Wykonanie polecenia net localgroup w systemie Windows spowoduje

Która z poniższych czynności konserwacyjnych jest specyficzna tylko dla drukarki laserowej?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Gniazdo na tablicy interaktywnej jest oznaczone tym symbolem. Które złącze powinno być wykorzystane do połączenia tablicy z komputerem?

Jaki element sieci SIP określamy jako telefon IP?

Usługa odpowiedzialna za konwersję nazw domen na adresy sieciowe to

W systemie Blu-ray nośnik przeznaczony do jednokrotnego zapisu jest oznaczany jako

Jak należy ustawić w systemie Windows Server 2008 parametry protokołu TCP/IP karty sieciowej, aby komputer mógł jednocześnie łączyć się z dwiema różnymi sieciami lokalnymi posiadającymi odrębne adresy IP?

Ile maksymalnie kanałów z dostępnego pasma kanałów w standardzie 802.11b może być używanych w Polsce?

Jakie narzędzie w systemie Windows pozwala na kontrolowanie stanu sprzętu, aktualizowanie sterowników oraz rozwiązywanie problemów z urządzeniami?

Jakie jest standardowe połączenie między skanerem a aplikacją graficzną?

Za przypisanie czasu procesora do wyznaczonych zadań odpowiada

W sieciach komputerowych miarą prędkości przesyłu danych jest

Aby prawidłowo uzupełnić składnię przedstawionego polecenia, które udostępnia folder 'Dane' pod nazwą 'test', w miejsce kropek należy wpisać odpowiednie słowo:

net ... test=C:\Dane

Jakie urządzenie sieciowe funkcjonuje w warstwie fizycznej modelu ISO/OSI, transmitując sygnał z jednego portu do wszystkich pozostałych portów?

W tabeli przedstawiono pobór mocy poszczególnych podzespołów zestawu komputerowego. Zestaw składa się z:

- płyty głównej,

- procesora,

- 2 modułów pamięci DDR3,

- dysku twardego SSD,

- dysku twardego z prędkością obrotową 7200,

- karty graficznej,

- napędu optycznego,

- myszy i klawiatury,

- wentylatora.

Który zasilacz należy zastosować dla przedstawionego zestawu komputerowego, uwzględniając co najmniej 20% rezerwy poboru mocy?

| Podzespół | Pobór mocy [W] | Podzespół | Pobór mocy [W] |

|---|---|---|---|

| Procesor Intel i5 | 60 | Płyta główna | 35 |

| Moduł pamięci DDR3 | 6 | Karta graficzna | 310 |

| Moduł pamięci DDR2 | 3 | Dysk twardy SSD | 7 |

| Monitor LCD | 80 | Dysk twardy 7200 obr./min | 16 |

| Wentylator | 5 | Dysk twardy 5400 obr./min | 12 |

| Mysz i klawiatura | 2 | Napęd optyczny | 30 |

W systemie Linux plik messages zawiera

Który program pozwoli na zarządzanie zasobami i czasem oraz stworzenie harmonogramu prac montażowych zgodnie z projektem sieci lokalnej w budynku?

Przedstawiony symbol znajdujący się na obudowie komputera stacjonarnego oznacza ostrzeżenie przed

W celu ochrony lokalnej sieci komputerowej przed atakami typu Smurf pochodzącymi z Internetu, należy zainstalować oraz właściwie skonfigurować

Aby system operacyjny był skutecznie chroniony przed atakami złośliwego oprogramowania, po zainstalowaniu programu antywirusowego należy

Na podstawie danych z "Właściwości systemu" można stwierdzić, że na komputerze zainstalowano fizycznie pamięć RAM o pojemności

| Komputer: Intel(R) Pentium (R)4 CPU 1.8GHz AT/XT Compatible 523 760 kB RAM |

System Windows 8, w którym wcześniej został utworzony punkt przywracania, doświadczył awarii. Jakie polecenie należy wydać, aby przywrócić ustawienia i pliki systemowe?

Do sprawdzenia, czy zainstalowana karta graficzna komputera przegrzewa się, użytkownik może wykorzystać program

Najczęściej używany kodek audio przy ustawianiu bramki VoIP to

Jakie oprogramowanie do wirtualizacji jest dostępne jako rola w systemie Windows Server 2012?

Jaka jest maksymalna liczba komputerów, które mogą być zaadresowane w podsieci z adresem 192.168.1.0/25?

Rodzajem złośliwego oprogramowania będącego programem rezydentnym, który działa, wykonując konkretną operację, nie powiela się przez sieć, a jedną z jego metod jest samoreplikacja aż do wyczerpania pamięci komputera, jest

Jakiego typu rozbudowa serwera wymaga zainstalowania dodatkowych sterowników?

NOWY, GOTOWY, OCZEKUJĄCY oraz AKTYWNY to