Pytanie 1

Oprogramowanie, które regularnie przerywa działanie przez pokazanie komunikatu o konieczności uiszczenia opłaty, co prowadzi do zniknięcia tego komunikatu, jest dystrybuowane na podstawie licencji

Wynik: 24/40 punktów (60,0%)

Wymagane minimum: 20 punktów (50%)

Oprogramowanie, które regularnie przerywa działanie przez pokazanie komunikatu o konieczności uiszczenia opłaty, co prowadzi do zniknięcia tego komunikatu, jest dystrybuowane na podstawie licencji

Wskaż komponent, który reguluje wartość napięcia pochodzącego z sieci elektrycznej, wykorzystując transformator do przeniesienia energii między dwoma obwodami elektrycznymi z zastosowaniem zjawiska indukcji magnetycznej?

Topologia fizyczna, w której wszystkie urządzenia końcowe są bezpośrednio połączone z jednym punktem centralnym, takim jak koncentrator lub switch, to topologia

Aby połączyć projektor multimedialny z komputerem, nie można zastosować złącza

W ramach zalecanych działań konserwacyjnych użytkownicy dysków SSD powinni unikać wykonywania

Jakie typy połączeń z Internetem mogą być współdzielone w sieci lokalnej?

Aby zarządzać aplikacjami i usługami uruchamianymi podczas startu systemu operacyjnego w Windows 7, należy skorzystać z programu

Jakie urządzenie wykorzystuje się do łączenia lokalnej sieci bezprzewodowej z siecią kablową?

Aby zapobiec uszkodzeniom układów scalonych przy serwisie sprzętu komputerowego, należy korzystać z

W celu ochrony lokalnej sieci komputerowej przed atakami typu Smurf pochodzącymi z Internetu, należy zainstalować oraz właściwie skonfigurować

Cienki klient (thin client) korzysta z protokołu

Którego wbudowanego narzędzia w systemie Windows 8 Pro można użyć do szyfrowania danych?

Po zainstalowaniu aplikacji VNC, używanej do obserwacji pulpitu konkretnego komputera, oprócz numeru portu należy wskazać jego

W bezprzewodowej sieci firmowej aktywowano usługę, która zajmuje się tłumaczeniem nazw mnemonicznych. Co to za usługa?

Jakie polecenie w systemie Windows powinno być użyte do obserwacji listy bieżących połączeń karty sieciowej w komputerze?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

W trakcie użytkowania przewodowej myszy optycznej wskaźnik nie reaguje na ruch urządzenia po podkładce, a kursor zmienia swoje położenie dopiero po właściwym ustawieniu myszy. Te symptomy sugerują uszkodzenie

Jakie polecenie w terminalu systemu operacyjnego Microsoft Windows umożliwi wyświetlenie szczegółów wszystkich zasobów udostępnionych na komputerze lokalnym?

Jakie polecenie w systemach Windows/Linux jest zazwyczaj wykorzystywane do monitorowania trasy pakietów w sieciach IP?

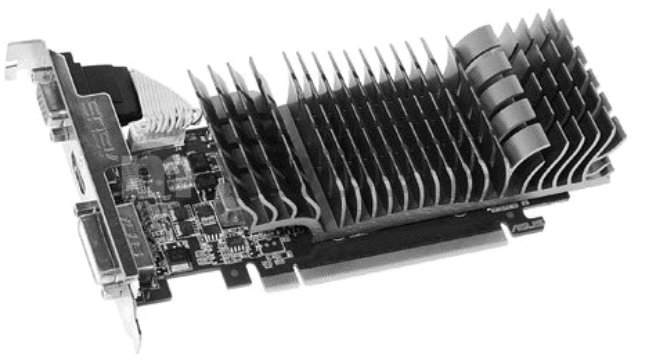

Karta rozszerzeń zaprezentowana na rysunku ma system chłodzenia

Polecenie uname -s w systemie Linux jest wykorzystywane do sprawdzenia

Która lokalizacja umożliwia utworzenie kopii zapasowej dysku systemowego Windows 11?

Planując prace modernizacyjne komputera przenośnego, związane z wymianą procesora, należy w pierwszej kolejności

W tabeli zaprezentowano specyfikacje czterech twardych dysków. Dysk, który oferuje najwyższą średnią prędkość odczytu danych, to

| Pojemność | 320 GB | 320 GB | 320 GB | 320 GB |

| Liczba talerzy | 2 | 3 | 2 | 2 |

| Liczba głowic | 4 | 6 | 4 | 4 |

| Prędkość obrotowa | 7200 obr./min | 7200 obr./min | 7200 obr./min | 7200 obr./min |

| Pamięć podręczna | 16 MB | 16 MB | 16 MB | 16 MB |

| Czas dostępu | 8.3 ms | 8.9 ms | 8.5 ms | 8.6 ms |

| Interfejs | SATA II | SATA II | SATA II | SATA II |

| Obsługa NCQ | TAK | NIE | TAK | TAK |

| Dysk | A. | B. | C. | D. |

Diody LED RGB funkcjonują jako źródło światła w różnych modelach skanerów

Po wykonaniu instalacji z domyślnymi parametrami system Windows XP NIE OBSŁUGUJE formatu systemu plików

Wskaż cechę platformy wirtualizacji Hyper-V.

Zidentyfikuj najprawdopodobniejszą przyczynę pojawienia się komunikatu "CMOS checksum error press F1 to continue press DEL to setup" podczas uruchamiania systemu komputerowego?

Użycie skrętki kategorii 6 (CAT 6) o długości 20 metrów w sieci LAN wskazuje na jej maksymalną przepustowość wynoszącą

Jak należy ustawić w systemie Windows Server 2008 parametry protokołu TCP/IP karty sieciowej, aby komputer mógł jednocześnie łączyć się z dwiema różnymi sieciami lokalnymi posiadającymi odrębne adresy IP?

Profil użytkownika systemu Windows, który można wykorzystać do logowania na dowolnym komputerze w sieci, przechowywany na serwerze i mogący być edytowany przez użytkownika, to profil

Rodzajem macierzy RAID, która nie jest odporna na awarię dowolnego z dysków wchodzących w jej skład, jest

Technologia ADSL pozwala na nawiązanie połączenia DSL

Jakie polecenie powinien wydać root w systemie Ubuntu Linux, aby zaktualizować wszystkie pakiety (cały system) do najnowszej wersji, łącznie z nowym jądrem?

Do utworzenia skompresowanego archiwum danych w systemie Linux można użyć polecenia

Udostępniono w sieci lokalnej jako udział specjalny folder o nazwie egzamin znajdujący się na komputerze o nazwie SERWER_2 w katalogu głównym dysku C:. Jak powinna wyglądać ścieżka dostępu do katalogu egzamin, w którym przechowywany jest folder macierzysty dla konta użytkownika o określonym loginie?

W tabeli przedstawiono pobór mocy poszczególnych podzespołów zestawu komputerowego. Zestaw składa się z:

- płyty głównej,

- procesora,

- 2 modułów pamięci DDR3,

- dysku twardego SSD,

- dysku twardego z prędkością obrotową 7200,

- karty graficznej,

- napędu optycznego,

- myszy i klawiatury,

- wentylatora.

Który zasilacz należy zastosować dla przedstawionego zestawu komputerowego, uwzględniając co najmniej 20% rezerwy poboru mocy?

| Podzespół | Pobór mocy [W] | Podzespół | Pobór mocy [W] |

|---|---|---|---|

| Procesor Intel i5 | 60 | Płyta główna | 35 |

| Moduł pamięci DDR3 | 6 | Karta graficzna | 310 |

| Moduł pamięci DDR2 | 3 | Dysk twardy SSD | 7 |

| Monitor LCD | 80 | Dysk twardy 7200 obr./min | 16 |

| Wentylator | 5 | Dysk twardy 5400 obr./min | 12 |

| Mysz i klawiatura | 2 | Napęd optyczny | 30 |

Jakie polecenie jest wysyłane do serwera DHCP, aby zwolnić wszystkie adresy przypisane do interfejsów sieciowych?

Aby sprawdzić dysk twardy w systemie Linux na obecność uszkodzonych sektorów, użytkownik może zastosować program

Urządzenie, które łączy różne segmenty sieci i przesyła ramki pomiędzy nimi, wybierając odpowiedni port, do którego są kierowane konkretne ramki, to