Pytanie 1

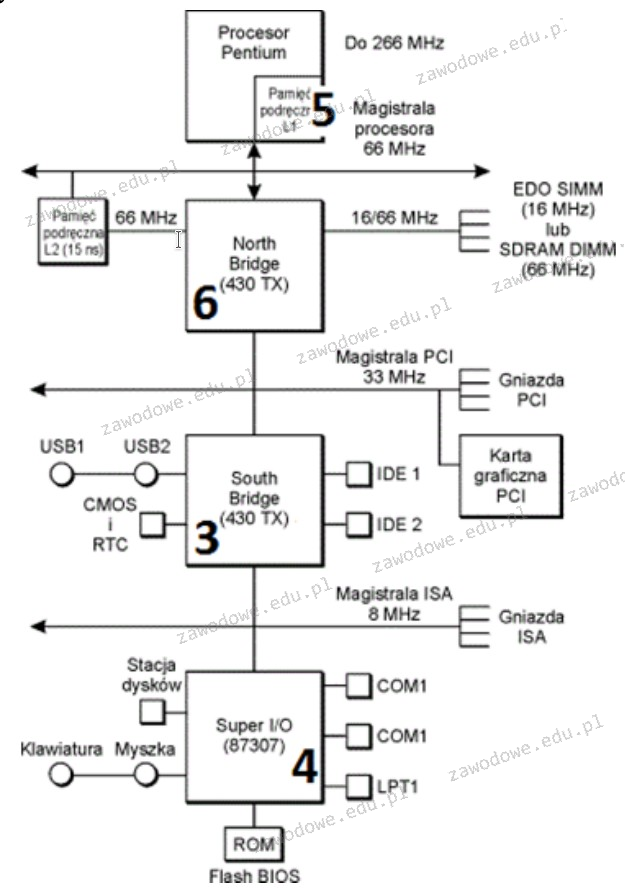

Część płyty głównej, która odpowiada za transmisję danych pomiędzy mikroprocesorem a pamięcią operacyjną RAM oraz magistralą karty graficznej, jest oznaczona na rysunku numerem

Wynik: 24/40 punktów (60,0%)

Wymagane minimum: 20 punktów (50%)

Część płyty głównej, która odpowiada za transmisję danych pomiędzy mikroprocesorem a pamięcią operacyjną RAM oraz magistralą karty graficznej, jest oznaczona na rysunku numerem

Zidentyfikowanie głównego rekordu rozruchowego, który uruchamia system z aktywnej partycji, jest możliwe dzięki

Czym są programy GRUB, LILO, NTLDR?

Które z poniższych kont nie jest wbudowane w system Windows XP?

int a;

Podaną zmienną wyświetl na 2 sposoby.

Przydzielanie przestrzeni dyskowej w systemach z rodziny Windows

Jakim procesem jest nieodwracalne usunięcie możliwości odzyskania danych z hard dysku?

Osoba planuje unowocześnić swój komputer poprzez zwiększenie pamięci RAM. Zainstalowana płyta główna ma specyfikacje przedstawione w tabeli. Wybierając dodatkowe moduły pamięci, powinien pamiętać, aby

| Parametry płyty głównej | |

|---|---|

| Model | H97 Pro4 |

| Typ gniazda procesora | Socket LGA 1150 |

| Obsługiwane procesory | Intel Core i7, Intel Core i5, Intel Core i3, Intel Pentium, Intel Celeron |

| Chipset | Intel H97 |

| Pamięć | 4 x DDR3- 1600 / 1333/ 1066 MHz, max 32 GB, ECC, niebuforowana |

| Porty kart rozszerzeń | 1 x PCI Express 3.0 x16, 3 x PCI Express x1, 2 x PCI |

Wskaź, które z poniższych stwierdzeń dotyczących zapory sieciowej jest nieprawdziwe?

Jaką funkcję pełni serwer ISA w systemie Windows?

W specyfikacji IEEE 802.3af opisano technologię dostarczania energii elektrycznej do różnych urządzeń sieciowych jako

W hierarchicznym modelu sieci komputery użytkowników stanowią część warstwy

Podczas realizacji projektu sieci LAN zastosowano medium transmisyjne zgodne ze standardem Ethernet 1000Base-T. Które z poniższych stwierdzeń jest prawdziwe?

Po wykonaniu podanego polecenia w systemie Windows:

net accounts /MINPWLEN:11liczba 11 zostanie przydzielona dla:

Jaką technologię wykorzystuje się do uzyskania dostępu do Internetu oraz odbioru kanałów telewizyjnych w formie cyfrowej?

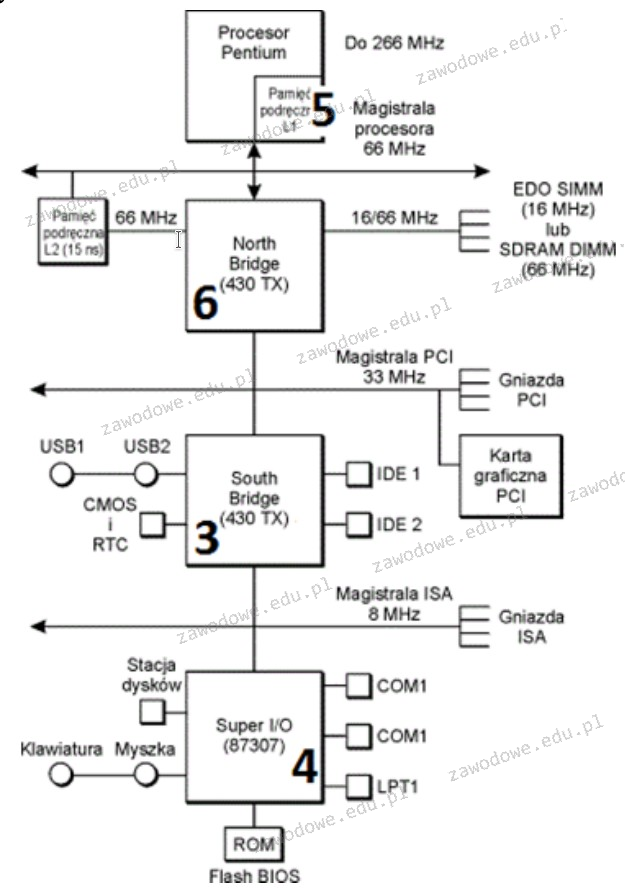

Na którym z przedstawionych rysunków ukazano topologię sieci typu magistrala?

Serwisant zrealizował w ramach zlecenia działania przedstawione w poniższej tabeli. Całkowity koszt zlecenia obejmuje wartość usług wymienionych w tabeli oraz koszt pracy serwisanta, którego stawka za godzinę wynosi 60,00 zł netto. Oblicz całkowity koszt zlecenia brutto. Stawka VAT na usługi wynosi 23%.

| LP | Czynność | Czas wykonania w minutach | Cena usługi netto w zł |

|---|---|---|---|

| 1. | Instalacja i konfiguracja programu | 35 | 20,00 |

| 2. | Wymiana płyty głównej | 80 | 50,00 |

| 3. | Wymiana karty graficznej | 30 | 25,00 |

| 4. | Tworzenie kopii zapasowej i archiwizacja danych | 65 | 45,00 |

| 5. | Konfiguracja rutera | 30 | 20,00 |

Protokół, który pozwala urządzeniom na uzyskanie od serwera informacji konfiguracyjnych, takich jak adres IP bramy sieciowej, to

Na podstawie wyników działania narzędzia diagnostycznego chkdsk, które są przedstawione na zrzucie ekranu, jaka jest wielkość pojedynczego klastra na dysku?

Typ systemu plików to FAT32.

Wolumin FTP utworzono 12-11-2005 18:31

Numer seryjny woluminu: 3CED-3B31

Trwa sprawdzanie plików i folderów...

Zakończono sprawdzanie plików i folderów.

Trwa sprawdzanie wolnego miejsca na dysku...

Zakończono sprawdzanie wolnego miejsca na dysku.

System Windows sprawdził system plików i nie znalazł żadnych problemów.

8 233 244 KB całkowitego miejsca na dysku.

1 KB w 13 plikach ukrytych.

2 KB w 520 folderach.

1 537 600 KB w 4 952 plikach.

6 690 048 KB jest dostępnych.

4 096 bajtów w każdej jednostce alokacji.

2 058 311 ogółem jednostek alokacji na dysku.

1 672 512 jednostek alokacji dostępnych na dysku.

C:\>

Błąd typu STOP Error (Blue Screen) w systemie Windows, który wiąże się z odniesieniem się systemu do niepoprawnych danych w pamięci RAM, to

Aby wyjąć dysk twardy zamocowany w laptopie przy użyciu podanych śrub, najlepiej zastosować wkrętak typu

Najskuteczniejszym sposobem na wykonanie codziennego archiwizowania pojedynczego pliku o wielkości 4,8 GB, na jednym komputerze bez dostępu do Internetu jest

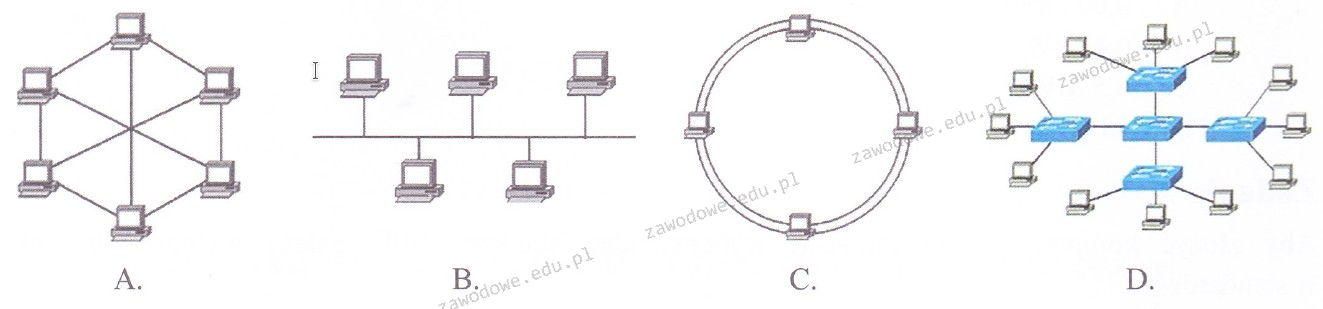

Za pomocą taśmy 60-pinowej pokazanej na ilustracji łączy się z płytą główną komputera

Podczas wyboru zasilacza do komputera kluczowe znaczenie

Jaką częstotliwość odświeżania należy ustawić, aby obraz na monitorze był odświeżany 85 razy na sekundę?

Czym charakteryzuje się technologia Hot swap?

Podczas monitorowania aktywności sieciowej zauważono, że na adres serwera przesyłano tysiące zapytań DNS w każdej sekundzie z różnych adresów IP, co doprowadziło do zawieszenia systemu operacyjnego. Przyczyną tego był atak typu

Jak określa się w systemie Windows profil użytkownika, który jest tworzony przy pierwszym logowaniu do komputera i zapisywany na lokalnym dysku twardym, a wszelkie jego modyfikacje dotyczą tylko tego konkretnego komputera?

Narzędzie, które chroni przed nieautoryzowanym dostępem do sieci lokalnej, to

fps (ang. frames per second) odnosi się bezpośrednio do

Problemy z laptopem, objawiające się zmienionymi barwami lub brakiem określonego koloru na ekranie, mogą być spowodowane uszkodzeniem

Ile maksymalnie dysków twardych można bezpośrednio podłączyć do płyty głównej, której fragment specyfikacji jest przedstawiony w ramce?

|

W lokalnej sieci protokołem odpowiedzialnym za dynamiczną konfigurację adresów IP jest

W jednostce ALU w akumulatorze zapisano liczbę dziesiętną 500. Jaką ona ma binarną postać?

Czym jest licencja OEM?

Programem służącym do archiwizacji danych w systemie Linux jest

Wynikiem działania (10101101)₍₂₎ − (10100)₍₂₎ jest

Przedstawiony moduł pamięci należy zamontować na płycie głównej w gnieździe

Która przystawka MMC systemu Windows umożliwia przegląd systemowego Dziennika zdarzeń?

Aby w systemie Windows Professional ustawić czas pracy drukarki oraz uprawnienia drukowania, należy skonfigurować