Pytanie 1

W systemie Linux do bieżącego monitorowania aktywnych procesów wykorzystuje się polecenie

Wynik: 25/40 punktów (62,5%)

Wymagane minimum: 20 punktów (50%)

W systemie Linux do bieżącego monitorowania aktywnych procesów wykorzystuje się polecenie

W hurtowni materiałów budowlanych zachodzi potrzeba równoczesnego wydruku faktur w kilku kopiach. Jakiej drukarki należy użyć?

Jaki akronim odnosi się do przepustowości sieci oraz usług, które mają między innymi na celu nadawanie priorytetów przesyłanym pakietom?

W jakiej topologii sieci komputerowej każdy węzeł ma bezpośrednie połączenie z każdym innym węzłem?

Jakie złącze powinna mieć karta graficzna, aby mogła być bezpośrednio podłączona do telewizora LCD, który ma tylko analogowe złącze do komputera?

Wskaż komponent, który nie jest zgodny z płytą główną o parametrach przedstawionych w tabeli

| Podzespół | Parametry |

|---|---|

| Płyta główna GIGABYTE | 4x DDR4, 4x PCI-E 16x, RAID, HDMI, D-Port, D-SUB, 2x USB 3.1, 8 x USB 2.0, S-AM3+ |

Wskaź narzędzie przeznaczone do mocowania pojedynczych żył kabla miedzianego w złączach?

Jednym z narzędzi zabezpieczających system przed oprogramowaniem, które bez wiedzy użytkownika pozyskuje i wysyła jego autorowi dane osobowe, numery kart płatniczych, informacje o adresach stron WWW odwiedzanych przez użytkownika, hasła i używane adresy mailowe, jest program

Protokół Transport Layer Security (TLS) jest rozszerzeniem którego z poniższych protokołów?

Aby zwolnić adres IP przypisany do konkretnej karty sieciowej w systemie Windows, należy wykorzystać polecenie systemowe

Jakim skrótem określa się połączenia typu punkt-punkt w ramach publicznej infrastruktury telekomunikacyjnej?

Użycie trunkingowego połączenia między dwoma przełącznikami umożliwia

Który port stosowany jest przez protokół FTP (File Transfer Protocol) do przesyłania danych?

Podstawowy protokół stosowany do ustalania ścieżki oraz przesyłania pakietów danych w sieci komputerowej to

W jakiej topologii fizycznej sieci każde urządzenie w sieci posiada dokładnie dwa połączenia, jedno z każdym z sąsiadów, a dane są przesyłane z jednego komputera do drugiego w formie pętli?

Menedżer usług IIS (Internet Information Services) w systemie Windows stanowi graficzny interfejs do konfiguracji serwera

Nie jest możliwe wykonywanie okresowych kopii zapasowych dysków serwera na nośnikach wymiennych typu

Aby była możliwa komunikacja pomiędzy dwiema różnymi sieciami, do których należą karty sieciowe serwera, należy w systemie Windows Server dodać rolę

W systemie Linux istnieją takie prawa dostępu do konkretnego pliku rwxr--r--. Jakie polecenie użyjemy, aby zmienić je na rwxrwx---?

W komunikacie o błędzie w systemie, informacja przedstawiana w formacie heksadecymalnym oznacza

Technik serwisowy zrealizował w ramach zlecenia działania wymienione w zestawieniu. Całkowity koszt zlecenia obejmuje cenę usług wymienionych w zestawieniu oraz wynagrodzenie serwisanta, którego stawka godzinowa wynosi 60,00 zł netto. Oblicz całkowity koszt zlecenia brutto. Stawka VAT na usługi wynosi 23%

| LP | Czynność | Czas wykonania w minutach | Cena usługi netto w zł |

|---|---|---|---|

| 1. | Instalacja i konfiguracja programu | 35 | 20,00 |

| 2. | Wymiana płyty głównej | 80 | 50,00 |

| 3. | Wymiana karty graficznej | 30 | 25,00 |

| 4. | Tworzenie kopii zapasowej i archiwizacja danych | 65 | 45,00 |

| 5. | Konfiguracja rutera | 30 | 20,00 |

Optyczna rozdzielczość to jeden z właściwych parametrów

Jakie polecenie diagnostyczne powinno się użyć, aby uzyskać informacje na temat tego, czy miejsce docelowe odpowiada oraz po jakim czasie nastąpiła odpowiedź?

Narzędzie przedstawione do nadzorowania sieci LAN to

C:\Users\egzamin>nmap localhost Starting Nmap 7.80 ( https://nmap.org ) at 2019-11-26 20:23 ?rodkowoeuropejski czas stand. Nmap scan report for localhost (127.0.0.1) Host is up (0.00s latency). Other addresses for localhost (not scanned): ::1 Not shown: 988 closed ports PORT STATE SERVICE 135/tcp open msrpc 445/tcp open microsoft-ds 1025/tcp open NFS-or-IIS 1026/tcp open LSA-or-nterm 1027/tcp open IIS 1029/tcp open ms-lsa 1030/tcp open iad1 1031/tcp open iad2 1044/tcp open dcutility 1234/tcp open hotline 2869/tcp open icslap 16992/tcp open amt-soap-http Nmap done: 1 IP address (1 host up) scanned in 0.94 seconds

Która topologia fizyczna umożliwia nadmiarowe połączenia pomiędzy urządzeniami w sieci?

Który z podanych programów pozwoli na stworzenie technicznego rysunku ilustrującego plan instalacji logicznej sieci lokalnej w budynku?

Podstawowym zadaniem mechanizmu Plug and Play jest:

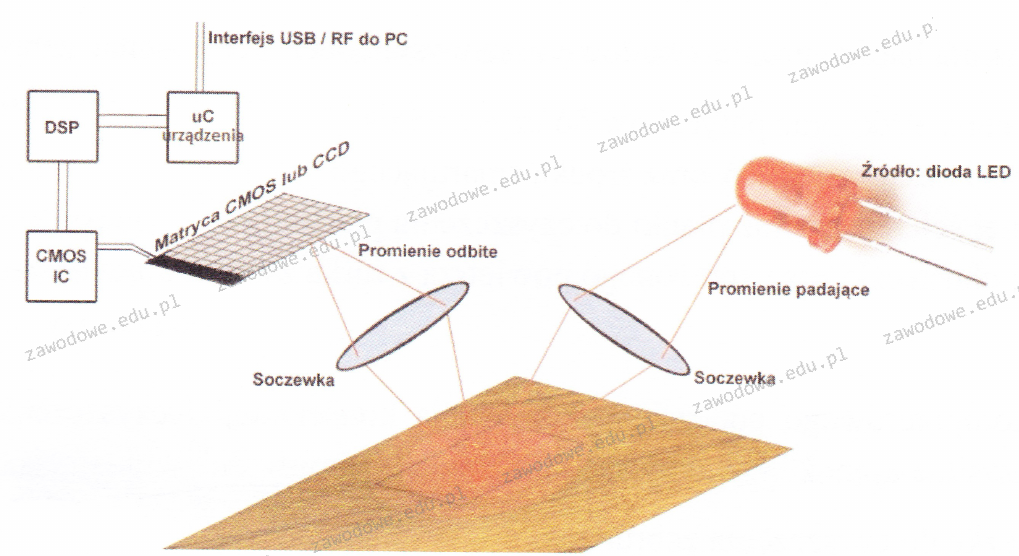

Zilustrowany schemat przedstawia zasadę funkcjonowania

Pamięć oznaczona jako PC3200 nie jest kompatybilna z magistralą

Jaką cechę posiada przełącznik sieciowy?

Jakie polecenie w systemie Windows należy użyć, aby ustalić liczbę ruterów pośrednich znajdujących się pomiędzy hostem źródłowym a celem?

System limitów dyskowych, umożliwiający kontrolowanie wykorzystania zasobów dyskowych przez użytkowników, nazywany jest

Aby kontrolować ilość transferu w sieci, administrator powinien zastosować program rodzaju

Czym jest dziedziczenie uprawnień?

Literowym symbolem P oznacza się

Jaka jest podstawowa funkcja protokołu SMTP?

Jaki jest powód sytuacji widocznej na przedstawionym zrzucie ekranu, mając na uwadze adres IP serwera, na którym umieszczona jest domena www.wp.pl, wynoszący 212.77.98.9?

C:\>ping 212.77.98.9

Pinging 212.77.98.9 with 32 bytes of data:

Reply from 212.77.98.9: bytes=32 time=29ms TTL=60

Reply from 212.77.98.9: bytes=32 time=29ms TTL=60

Reply from 212.77.98.9: bytes=32 time=30ms TTL=60

Reply from 212.77.98.9: bytes=32 time=29ms TTL=60

Ping statistics for 212.77.98.9:

Packets: Sent = 4, Received = 4, Lost = 0 (0% loss),

Approximate round trip times in milli-seconds:

Minimum = 29ms, Maximum = 30ms, Average = 29ms

C:\>ping www.wp.pl

Ping request could not find host www.wp.pl. Please check the name and try again.Który protokół zamienia adresy IP na adresy MAC, używane w sieciach Ethernet?

Aby zapewnić możliwość odzyskania ważnych danych, należy regularnie

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.