Pytanie 1

W systemie Linux do bieżącego monitorowania aktywnych procesów wykorzystuje się polecenie

Wynik: 19/40 punktów (47,5%)

Wymagane minimum: 20 punktów (50%)

W systemie Linux do bieżącego monitorowania aktywnych procesów wykorzystuje się polecenie

Symbol "LGA 775" obecny w dokumentacji technicznej płyty głównej wskazuje na typ gniazda dla procesorów:

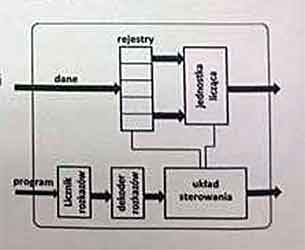

Rejestry widoczne na diagramie procesora mają rolę

Zjawisko przekazywania tokena (ang. token) występuje w sieci o fizycznej strukturze

Przydzielanie przestrzeni dyskowej w systemach z rodziny Windows

Pliki specjalne urządzeń, tworzone podczas instalacji sterowników w systemie Linux, są zapisywane w katalogu

Jaki jest adres broadcastowy dla sieci posiadającej adres IP 192.168.10.0/24?

Jakie zdanie charakteryzuje SSH Secure Shell?

Jakie polecenie w systemie operacyjnym Linux służy do prezentowania konfiguracji interfejsów sieciowych?

Jakie polecenie w systemie Linux pokazuje czas działania systemu oraz jego średnie obciążenie?

Z jakiego typu pamięci korzysta dysk SSD?

Na ilustracji zaprezentowano końcówkę wkrętaka typu

Jaki skrót odpowiada poniższej masce podsieci: 255.255.248.0?

Topologia fizyczna, w której każdy węzeł łączy się z wszystkimi innymi węzłami, to topologia

Aby aktywować funkcję S.M.A.R.T. dysku twardego, która odpowiada za monitorowanie i wczesne ostrzeganie przed awariami, należy skorzystać z

Jaki rodzaj dysków jest podłączany do złącza IDE na płycie głównej komputera?

Aby system operacyjny był skutecznie chroniony przed atakami złośliwego oprogramowania, po zainstalowaniu programu antywirusowego należy

Ile wyniesie całkowity koszt wymiany karty sieciowej w komputerze, jeżeli cena karty to 40 zł, czas pracy serwisanta wyniesie 90 minut, a koszt każdej rozpoczętej roboczogodziny to 60 zł?

Które polecenie systemu Linux służy do wyświetlenia informacji o zainstalowanych podzespołach?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Jakie funkcje realizuje system informatyczny?Kursy informatyczne

Które zdanie opisujące domenę Windows jest prawdziwe?

W modelu RGB, kolor w systemie szesnastkowym przedstawia się w ten sposób: ABCDEF. Wartość natężenia koloru niebieskiego w tym zapisie odpowiada liczbie dziesiętnej

Która norma w Polsce definiuje zasady dotyczące okablowania strukturalnego?

Które z urządzeń sieciowych jest przedstawione na grafice?

Protokół ARP (Address Resolution Protocol) pozwala na przypisanie logicznych adresów warstwy sieciowej do rzeczywistych adresów warstwy

Adres MAC (Medium Access Control Address) to sprzętowy identyfikator karty sieciowej Ethernet w warstwie modelu OSI

Wymogi działalności przedsiębiorstwa nakładają konieczność używania systemów plików, które zapewniają wysoki poziom zabezpieczeń oraz umożliwiają szyfrowanie informacji. W związku z tym należy wybrać system operacyjny Windows

Podczas pracy wskaźnik przewodowej myszy optycznej nie reaguje na przesuwanie urządzenia po padzie, dopiero po odpowiednim ułożeniu myszy kursor zaczyna zmieniać położenie. Objawy te wskazują na uszkodzenie

Nośniki danych, które są odporne na zakłócenia elektromagnetyczne oraz atmosferyczne, to

Która z wymienionych czynności konserwacyjnych związana jest wyłącznie z drukarką laserową?

Administrator pragnie udostępnić w sieci folder C:instrukcje trzem użytkownikom z grupy Serwisanci. Jakie rozwiązanie powinien wybrać?

W technologii Ethernet protokół dostępu do medium CSMA/CD jest metodą z

Jakie zabezpieczenie w dokumentacji technicznej określa mechanizm zasilacza komputerowego zapobiegający przegrzaniu urządzenia?

Główny protokół stosowany do ustalania ścieżki i przesyłania nią pakietów danych w sieci komputerowej to

Który układ mikroprocesora jest odpowiedzialny między innymi za pobieranie rozkazów z pamięci oraz generowanie sygnałów sterujących?

Topologia fizyczna, w której wszystkie urządzenia końcowe są bezpośrednio połączone z jednym punktem centralnym, takim jak koncentrator lub switch, to topologia

Określ adres sieci, do której przypisany jest host o adresie 172.16.0.123/27?

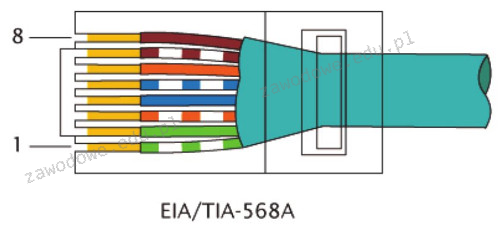

W standardzie Ethernet 100BaseTX do przesyłania danych używane są żyły kabla UTP podłączone do pinów

Jakie składniki systemu komputerowego wymagają utylizacji w wyspecjalizowanych zakładach przetwarzania z powodu obecności niebezpiecznych substancji lub pierwiastków chemicznych?