Pytanie 1

Jaki typ plików powinien być stworzony w systemie operacyjnym, aby zautomatyzować najczęściej wykonywane zadania, takie jak kopiowanie, utworzenie pliku lub folderu?

Wynik: 20/40 punktów (50,0%)

Wymagane minimum: 20 punktów (50%)

Jaki typ plików powinien być stworzony w systemie operacyjnym, aby zautomatyzować najczęściej wykonywane zadania, takie jak kopiowanie, utworzenie pliku lub folderu?

Komputer posiada mysz bezprzewodową, ale kursor nie porusza się gładko, tylko "skacze" na ekranie. Możliwą przyczyną problemu z urządzeniem może być

Równoważnym zapisem 232 bajtów jest zapis

Router Wi-Fi działający w technologii 802.11n umożliwia osiągnięcie maksymalnej prędkości przesyłu danych

Administrator Active Directory w domenie firma.local pragnie skonfigurować mobilny profil dla wszystkich użytkowników. Ma on być przechowywany na serwerze serwer1, w folderze pliki, który jest udostępniony w sieci jako dane$. Który z parametrów w ustawieniach profilu użytkownika spełnia opisane wymagania?

Jaki adres IP należy do urządzenia funkcjonującego w sieci 10.0.0.0/17?

Jakie funkcje pełni usługa katalogowa Active Directory w systemach Windows Server?

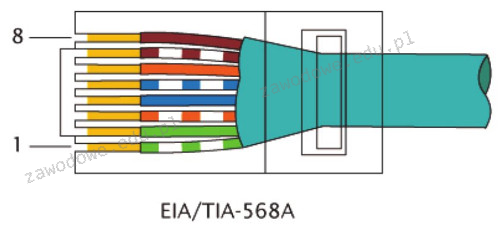

W standardzie Ethernet 100BaseTX do przesyłania danych używane są żyły kabla UTP podłączone do pinów

Jaką przepustowość określa standard Ethernet IEEE 802.3z?

Jakie polecenie w systemie Linux pozwala na dodanie istniejącego użytkownika nowak do grupy technikum?

Jakie są poszczególne elementy adresu globalnego IPv6 typu unicast pokazane na ilustracji?

| IPv6 | ||

|---|---|---|

| 1 | 2 | 3 |

| 48 bitów | 16 bitów | 64 bity |

Jakie polecenie jest używane do ustawienia konfiguracji interfejsu sieciowego w systemie Linux?

Administrator powinien podzielić adres 10.0.0.0/16 na 4 jednorodne podsieci zawierające równą liczbę hostów. Jaką maskę będą miały te podsieci?

Jakie jest zadanie usługi DNS?

Po zainstalowaniu aplikacji VNC, używanej do obserwacji pulpitu konkretnego komputera, oprócz numeru portu należy wskazać jego

W systemie Windows Professional aby ustawić czas dostępności dla drukarki, należy skorzystać z zakładki

Na ilustracji przedstawiono schemat konstrukcji logicznej

Aby zablokować hasło dla użytkownika egzamin w systemie Linux, jakie polecenie należy zastosować?

Program fsck jest stosowany w systemie Linux do

W systemie Linux można uzyskać kopię danych przy użyciu komendy

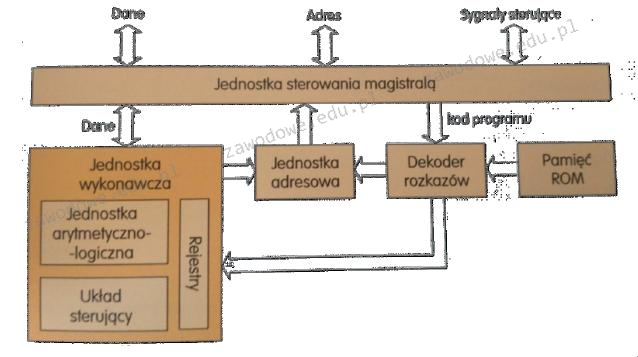

SuperPi to aplikacja używana do oceniania

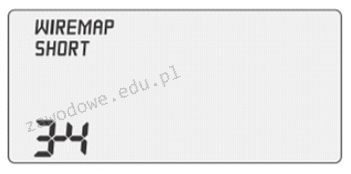

Narzędzie przedstawione do nadzorowania sieci LAN to

C:\Users\egzamin>nmap localhost Starting Nmap 7.80 ( https://nmap.org ) at 2019-11-26 20:23 ?rodkowoeuropejski czas stand. Nmap scan report for localhost (127.0.0.1) Host is up (0.00s latency). Other addresses for localhost (not scanned): ::1 Not shown: 988 closed ports PORT STATE SERVICE 135/tcp open msrpc 445/tcp open microsoft-ds 1025/tcp open NFS-or-IIS 1026/tcp open LSA-or-nterm 1027/tcp open IIS 1029/tcp open ms-lsa 1030/tcp open iad1 1031/tcp open iad2 1044/tcp open dcutility 1234/tcp open hotline 2869/tcp open icslap 16992/tcp open amt-soap-http Nmap done: 1 IP address (1 host up) scanned in 0.94 seconds

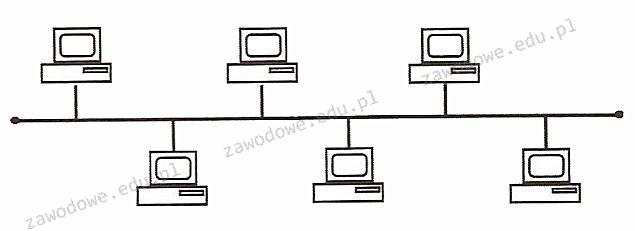

Fizyczna architektura sieci, inaczej określana jako topologia fizyczna sieci komputerowych, definiuje

Na ilustracji ukazano sieć o układzie

Na ilustracji pokazano wynik pomiaru okablowania. Jaką interpretację można nadać temu wynikowi?

Wskaż najkorzystniejszą trasę sumaryczną dla podsieci IPv4?

| 10.10.168.0/23 |

| 10.10.170.0/23 |

| 10.10.172.0/23 |

| 10.10.174.0/24 |

Aby wykonać ręczne ustawienie interfejsu sieciowego w systemie LINUX, należy użyć polecenia

Zgodnie z KNR (katalogiem nakładów rzeczowych), montaż na skrętce 4-parowej modułu RJ45 oraz złącza krawędziowego wynosi 0,07 r-g, a montaż gniazd abonenckich natynkowych to 0,30 r-g. Jaki będzie całkowity koszt robocizny za zamontowanie 10 pojedynczych gniazd natynkowych z modułami RJ45, jeśli wynagrodzenie godzinowe montera-instalatora wynosi 20,00 zł?

Jakie są przyczyny wyświetlenia na ekranie komputera komunikatu o wykryciu konfliktu adresów IP?

W architekturze ISO/OSI protokoły TCP oraz UDP funkcjonują w warstwie

Kluczowy sposób zabezpieczenia danych w sieci komputerowej przed nieautoryzowanym dostępem to

Funkcję S.M.A.R.T. w twardym dysku, która jest odpowiedzialna za nadzorowanie i wczesne ostrzeganie o możliwych awariach, można uruchomić poprzez

Funkcja systemu operacyjnego, która umożliwia jednoczesne uruchamianie wielu aplikacji w trybie podziału czasu, z tym że realizacja tego podziału odbywa się przez same aplikacje, nosi nazwę

Jakie znaczenie ma skrót MBR w kontekście technologii komputerowej?

W systemie Linux, jakie polecenie służy do zmiany hasła użytkownika?

Które z poniższych poleceń w systemie Linux służy do zmiany uprawnień pliku?

Które środowisko graficzne przeznaczone dla systemu Linux charakteryzuje się najmniejszymi wymaganiami parametrów pamięci RAM?

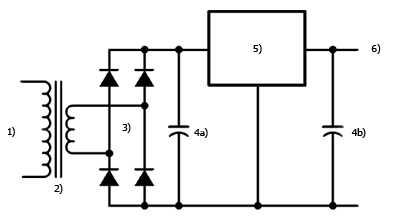

Na schemacie blokowym przedstawiającym zasadę działania zasilacza liniowego numerem 5) oznaczono

Jaką funkcję pełni polecenie tee w systemie Linux?

Które narzędzie jest przeznaczone do lekkiego odgięcia blachy obudowy komputera oraz zamocowania śruby montażowej w trudno dostępnym miejscu?