Pytanie 1

W procedurze Power-On Self-Test w pierwszej kolejności wykonywane jest sprawdzanie

Wynik: 20/40 punktów (50,0%)

Wymagane minimum: 20 punktów (50%)

W procedurze Power-On Self-Test w pierwszej kolejności wykonywane jest sprawdzanie

Podczas pracy z bazami danych, jakiego rodzaju operację wykonuje polecenie "SELECT"?

Jakie polecenie należy zastosować w systemach operacyjnych z rodziny Windows, aby zmienić właściwość pliku na tylko do odczytu?

Który protokół zamienia adresy IP na adresy MAC, używane w sieciach Ethernet?

EN IEC 60276:2019 to przykład oznaczenia normy

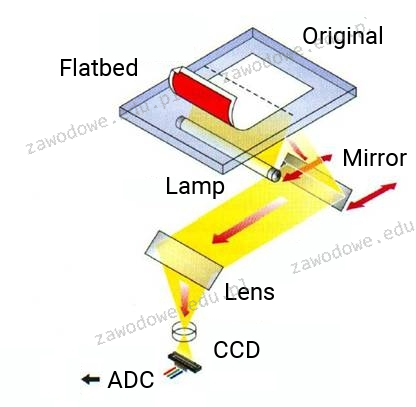

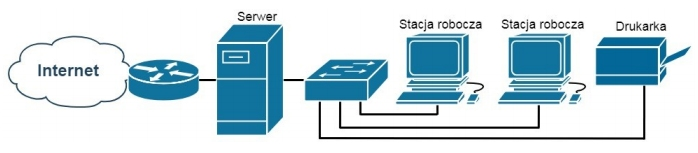

Zaprezentowany schemat ilustruje funkcjonowanie

Aby w systemie Linux wykonać kopię zapasową określonych plików, należy wprowadzić w terminalu polecenie programu

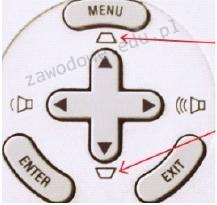

Na przedstawionym obrazku zaznaczone są strzałkami funkcje przycisków umieszczonych na obudowie projektora multimedialnego. Dzięki tym przyciskom można

Aby zapewnić, że komputer uzyska od serwera DHCP określony adres IP, należy na serwerze zdefiniować

Nierówne wydruki lub bladości w druku podczas korzystania z drukarki laserowej mogą sugerować

Adres IP 192.168.2.0/24 został podzielony na 8 podsieci. Jaką maskę należy zastosować dla tych nowych podsieci?

Z jaką informacją wiąże się parametr TTL po wykonaniu polecenia ping?

Lista sprzętu kompatybilnego z systemem operacyjnym Windows, publikowana przez firmę Microsoft to

Kiedy użytkownik wpisuje w przeglądarkę adres www.egzamin.pl, nie ma on możliwości otwarcia strony WWW, natomiast wpisujący adres 211.0.12.41 zyskuje dostęp do tej strony. Problem ten wynika z nieprawidłowej konfiguracji serwera

Po włączeniu komputera na ekranie wyświetlił się komunikat "Non-system disk or disk error. Replace and strike any key when ready". Możliwą przyczyną tego może być

Do pokazanej na ilustracji płyty głównej nie da się podłączyć urządzenia korzystającego z interfejsu

Której aplikacji należy użyć, aby sprawdzić parametry S.M.A.R.T.?

Co należy zrobić, gdy podczas uruchamiania komputera procedura POST sygnalizuje błąd odczytu lub zapisu pamięci CMOS?

Co umożliwia połączenie trunk dwóch przełączników?

W której fizycznej topologii awaria jednego komputera powoduje przerwanie pracy całej sieci?

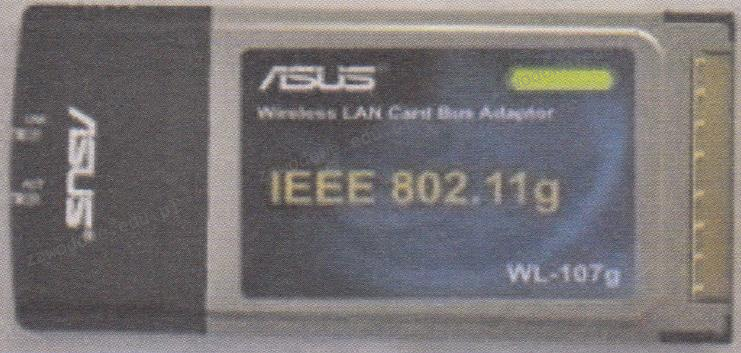

Karta sieciowa przedstawiona na ilustracji ma zdolność przesyłania danych z maksymalną prędkością

System limitów dyskowych, umożliwiający kontrolowanie wykorzystania zasobów dyskowych przez użytkowników, nazywany jest

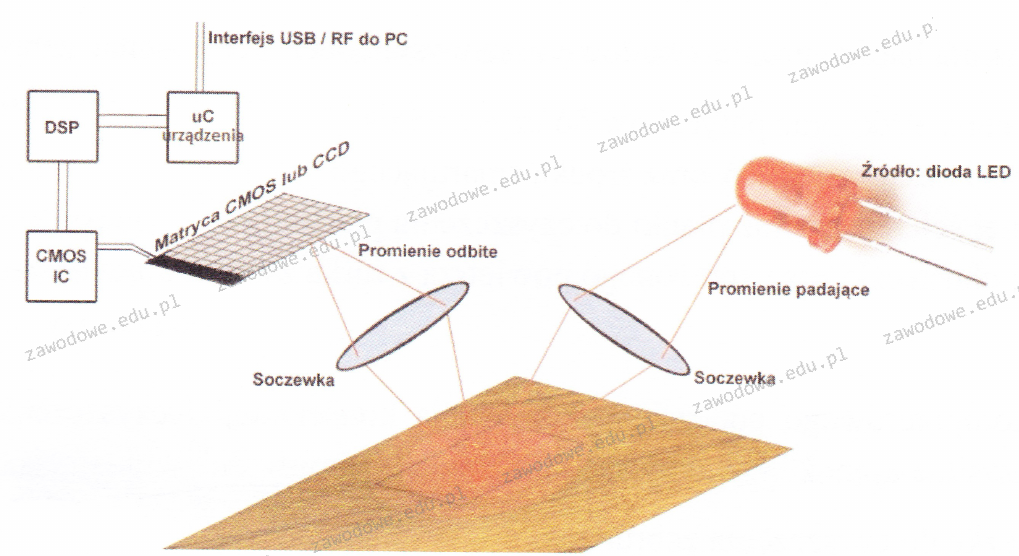

Zilustrowany schemat przedstawia zasadę funkcjonowania

Wskaż nieprawidłowy sposób podziału dysków MBR na partycje?

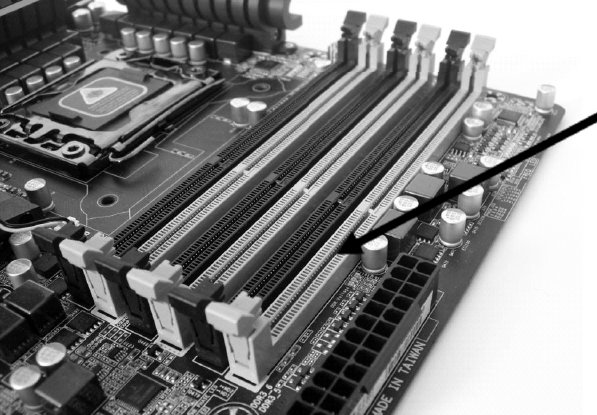

Jaki typ pamięci powinien być umieszczony na płycie głównej komputera w miejscu, które wskazuje strzałka?

Funkcja systemu operacyjnego, która umożliwia jednoczesne uruchamianie wielu aplikacji w trybie podziału czasu, z tym że realizacja tego podziału odbywa się przez same aplikacje, nosi nazwę

Wskaż urządzenie, które należy wykorzystać do połączenia drukarki wyposażonej w interfejs Wi-Fi z komputerem stacjonarnym bez interfejsu Wi-Fi, ale z interfejsem USB.

Jaki akronim oznacza wydajność sieci oraz usługi, które mają na celu między innymi priorytetyzację przesyłanych pakietów?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Fragment konfiguracji pliku httpd.conf dla serwera Apache wygląda następująco Listen 8012 Server Name localhost:8012 Aby zweryfikować prawidłowe działanie witryny WWW na serwerze, należy wpisać w przeglądarkę

Moduł Mini-GBiCSFP pełni funkcję

Która funkcja serwera Windows umożliwia użytkownikom końcowym sieci pokazanej na rysunku dostęp do Internetu?

Które medium transmisyjne charakteryzuje się najmniejszym ryzykiem narażenia na zakłócenia elektromagnetyczne przesyłanego sygnału?

Która czynność nie służy do personalizacji systemu operacyjnego Windows?

Podczas instalacji systemu operacyjnego Linux należy wybrać odpowiedni typ systemu plików

Licencja obejmująca oprogramowanie układowe, umieszczone na stałe w sprzętowej części systemu komputerowego, to

W jakim oprogramowaniu trzeba zmienić konfigurację, aby użytkownik mógł wybrać z listy i uruchomić jeden z różnych systemów operacyjnych zainstalowanych na swoim komputerze?

Wartość liczby dziesiętnej 128(d) w systemie heksadecymalnym wyniesie

Na przedstawionym rysunku widoczna jest karta rozszerzeń z systemem chłodzenia

W systemie Windows 7 program Cipher.exe w trybie poleceń jest używany do