Pytanie 1

Program Mozilla Firefox jest udostępniany na zasadach licencji

Wynik: 23/40 punktów (57,5%)

Wymagane minimum: 20 punktów (50%)

Program Mozilla Firefox jest udostępniany na zasadach licencji

Jak nazywa się urządzenie wskazujące, które współpracuje z monitorami CRT i ma końcówkę z elementem światłoczułym, a jego dotknięcie ekranu monitora skutkuje przesłaniem sygnału do komputera, co umożliwia lokalizację kursora?

Na zdjęciu widoczny jest

Który z protokołów jest używany w komunikacji głosowej przez internet?

Protokół, który pozwala urządzeniom na uzyskanie od serwera informacji konfiguracyjnych, takich jak adres IP bramy sieciowej, to

Wskaż program w systemie Linux, który jest przeznaczony do kompresji plików?

Aby poprawić wydajność procesora serii Intel za pomocą 'podkręcania' (ang. overclocking), należy użyć procesora oznaczonego

Jaka jest prędkość przesyłania danych w standardzie 1000Base-T?

Z powodu uszkodzenia kabla typu skrętka utracono dostęp między przełącznikiem a stacją roboczą. Który instrument pomiarowy powinno się wykorzystać, aby zidentyfikować i naprawić problem bez wymiany całego kabla?

Aby osiągnąć prędkość przesyłania danych 100 Mbps w sieci lokalnej, wykorzystano karty sieciowe działające w standardzie Fast Ethernet, kabel typu UTP o odpowiedniej kategorii oraz przełącznik (switch) zgodny z tym standardem. Taka sieć jest skonstruowana w topologii

Na ilustracji przedstawiono sieć komputerową w danej topologii

Instalacja systemów Linux oraz Windows 7 odbyła się bez żadnych problemów. Systemy zainstalowały się prawidłowo z domyślnymi konfiguracjami. Na tym samym komputerze, przy tej samej specyfikacji, podczas instalacji systemu Windows XP pojawił się komunikat o braku dysków twardych, co może sugerować

Komputer z adresem IP 192.168.5.165 oraz maską podsieci 255.255.255.192 funkcjonuje w sieci o adresie

Standard WIFI 802.11 b/g używa pasma

Można przywrócić pliki z kosza, korzystając z polecenia

Podczas skanowania reprodukcji obrazu z magazynu, na skanie pojawiły się regularne wzory, zwane morą. Jaką funkcję skanera należy zastosować, aby pozbyć się mory?

Czym są programy GRUB, LILO, NTLDR?

Jednym z narzędzi zabezpieczających system przed oprogramowaniem, które bez wiedzy użytkownika pozyskuje i wysyła jego autorowi dane osobowe, numery kart płatniczych, informacje o adresach stron WWW odwiedzanych przez użytkownika, hasła i używane adresy mailowe, jest program

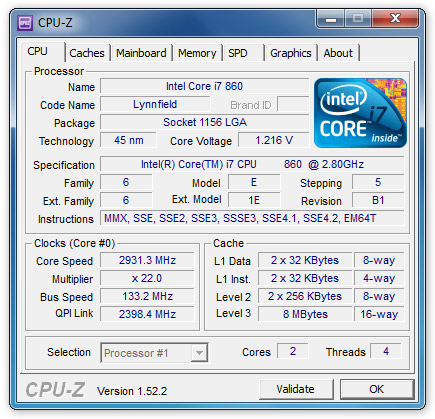

W dokumentacji technicznej procesora producent umieścił wyniki testu, który został wykonany przy użyciu programu CPU-Z. Z tych danych wynika, że procesor dysponuje

ACPI to interfejs, który pozwala na

Jakie cyfry należy wprowadzić na klawiaturze telefonu podłączonego do bramki VoIP po wcześniejszym wpisaniu *** aby ustalić adres bramy domyślnej sieci?

| Aby wejść w tryb konfiguracji należy wprowadzić *** po podniesieniu słuchawki. | ||

| Tabela przedstawia wszystkie parametry oraz ich opis | ||

| Parametr | Informacja | Opcje |

|---|---|---|

| Menu główne po wprowadzeniu *** | Wejście w tryb programowania | - następna opcja + powrót do menu głównego Należy wybrać parametr 01-05, 07, 12-17, 47 lub 99 |

| 01 | „DHCP" lub „statyczny IP" | Używając cyfry „9" przełączanie pomiędzy : statycznym i dynamicznym adresem. |

| 02 | Statyczny adres IP | Zostanie wyemitowany komunikat z adresem IP Należy wprowadzić nowy adres 12 cyfrowy za pomocą klawiatury numerycznej. |

| 03 | Maska podsieci + adres | Tak samo jak w przypadku 02 |

| 04 | Brama domyślna + adres | Tak samo jak w przypadku 02 |

| 05 | Adres serwera DNS | Tak samo jak w przypadku 02 |

Które z poniższych stwierdzeń na temat protokołu DHCP jest poprawne?

Aby monitorować stan dysków twardych w serwerach, komputerach osobistych i laptopach, można użyć programu

Które z urządzeń używanych w sieci komputerowej NIE WPŁYWA na liczbę domen kolizyjnych?

Narzędziem wbudowanym w systemie Windows, wykorzystywanym do diagnozowania problemów związanych z działaniem animacji w grach lub odtwarzaniem filmów, jest

W systemie Linux, jak można znaleźć wszystkie pliki z rozszerzeniem txt, które znajdują się w katalogu /home/user i rozpoczynają się na literę a, b lub c?

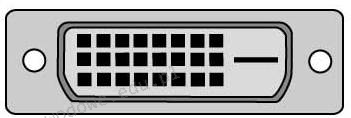

Jak brzmi nazwa portu umieszczonego na tylnym panelu komputera, który znajduje się na przedstawionym rysunku?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

W sekcji zasilania monitora LCD, powiększone kondensatory elektrolityczne mogą prowadzić do uszkodzenia

Bezpośrednio po usunięciu istotnych plików z dysku twardego, użytkownik powinien

Mechanizm, który pozwala na podłączenie urządzeń peryferyjnych do systemu komputerowego, w którym każde urządzenie jest identyfikowane przez przypisany mu numer, to

Autorskie prawo osobiste twórcy do programu komputerowego

Przed dokonaniem zakupu komponentu komputera lub urządzenia peryferyjnego na platformach aukcyjnych, warto zweryfikować, czy nabywane urządzenie ma wymagany w Polsce certyfikat

Zamontowany w notebooku trackpoint jest urządzeniem wejściowym reagującym na

Po włączeniu komputera na ekranie wyświetlił się komunikat "Non-system disk or disk error. Replace and strike any key when ready". Możliwą przyczyną tego może być

Jaką rolę serwera trzeba zainstalować w systemach z linii Windows Server, aby mogła zostać utworzona nowa strona FTP?

Układy sekwencyjne stworzone z grupy przerzutników, zazwyczaj synchronicznych typu D, wykorzystywane do magazynowania danych, to

W kontekście adresacji IPv6, użycie podwójnego dwukropka służy do

Który z parametrów okablowania strukturalnego definiuje stosunek mocy sygnału tekstowego w jednej parze do mocy sygnału wyindukowanego w sąsiedniej parze na tym samym końcu kabla?

Znak handlowy dla produktów certyfikowanych według standardów IEEE 802.11 to