Pytanie 1

Jaką funkcję pełni zarządzalny przełącznik, aby łączyć wiele połączeń fizycznych w jedno logiczne, co pozwala na zwiększenie przepustowości łącza?

Wynik: 10/40 punktów (25,0%)

Wymagane minimum: 20 punktów (50%)

Jaką funkcję pełni zarządzalny przełącznik, aby łączyć wiele połączeń fizycznych w jedno logiczne, co pozwala na zwiększenie przepustowości łącza?

Który z poniższych mechanizmów zagwarantuje najwyższy poziom ochrony w sieciach bezprzewodowych opartych na standardzie 802.11n?

Technologia, która umożliwia szerokopasmowy dostęp do Internetu z różnymi prędkościami pobierania i wysyłania danych, to

Wskaź protokół działający w warstwie aplikacji, który umożliwia odbieranie wiadomości e-mail, a w pierwszym etapie pobiera jedynie nagłówki wiadomości, podczas gdy pobranie ich treści oraz załączników następuje dopiero po otwarciu wiadomości.

W systemie Windows ochrona polegająca na ostrzeganiu przed uruchomieniem nierozpoznanych aplikacji i plików pobranych z Internetu jest realizowana przez

Który z wymienionych formatów płyt głównych charakteryzuje się najmniejszymi wymiarami?

Program o nazwie dd, którego przykład zastosowania przedstawiono w systemie Linux, umożliwia

Możliwości zmiany uprawnień dostępu do plików w systemie Windows 10 można uzyskać za pomocą komendy

Zewnętrzny dysk 3,5 cala o pojemności 5 TB, przeznaczony do archiwizacji lub tworzenia kopii zapasowych, dysponuje obudową z czterema różnymi interfejsami komunikacyjnymi. Który z tych interfejsów powinno się użyć do podłączenia do komputera, aby uzyskać najwyższą prędkość transferu?

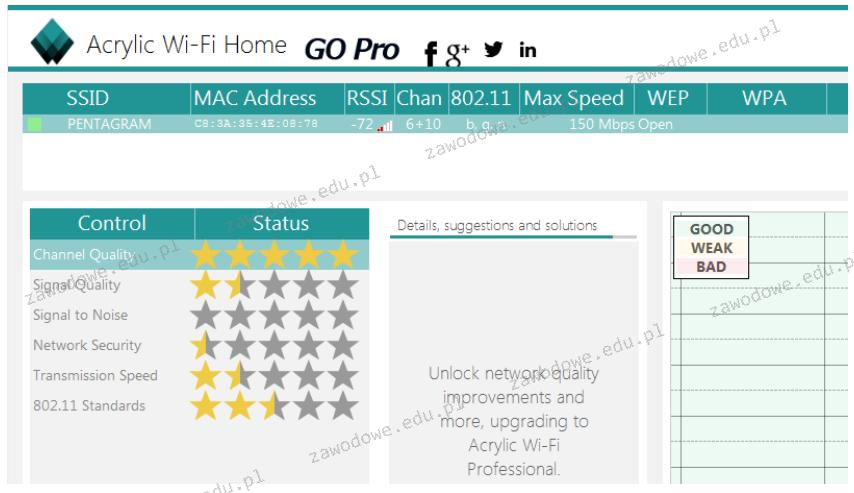

Wykonano test przy użyciu programu Acrylic Wi-Fi Home, a wyniki przedstawiono na zrzucie ekranu. Na ich podstawie można wnioskować, że dostępna sieć bezprzewodowa

Karta dźwiękowa, która pozwala na odtwarzanie plików w formacie MP3, powinna być zaopatrzona w układ

Program do diagnostyki komputera pokazał komunikat NIC ERROR. Co oznacza ten komunikat w kontekście uszkodzenia karty?

Jaką maksymalną liczbę adresów można przypisać urządzeniom w sieci 10.0.0.0/22?

Jaka usługa musi być aktywna na serwerze, aby stacja robocza mogła automatycznie otrzymywać adres IP?

Kiedy użytkownik wprowadza w wierszu poleceń komendę ping www.onet.pl, otrzymuje komunikat: "Żądanie polecenia ping nie może znaleźć hosta www.onet.pl. Sprawdź nazwę i ponów próbę." Natomiast po wpisaniu polecenia ping 213.180.141.140 (adres IP serwera www.onet.pl) użytkownik otrzymuje odpowiedź z serwera. Jakie mogą być przyczyny tego zjawiska?

W klasycznym adresowaniu, adres IP 74.100.7.8 przynależy do

Który z poniższych interfejsów powinien być wybrany do podłączenia dysku SSD do płyty głównej komputera stacjonarnego, aby uzyskać najwyższą szybkość zapisu oraz odczytu danych?

Osoba korzystająca z komputera publikuje w sieci Internet pliki, które posiada. Prawa autorskie zostaną złamane, gdy udostępni

Jakie jest oprogramowanie serwerowe dla systemu Linux, które pozwala na współdziałanie z grupami roboczymi oraz domenami Windows?

W jakim systemie jest przedstawiona liczba 1010(o)?

Jak powinno być usytuowanie gniazd komputerowych RJ45 względem powierzchni biurowej zgodnie z normą PN-EN 50174?

Podstawowym zadaniem mechanizmu Plug and Play jest

Jakie narzędzie w systemie Linux pozwala na wyświetlenie danych o sprzęcie zapisanych w BIOS?

Najlepszym sposobem na zabezpieczenie domowej sieci Wi-Fi jest

Jak wielu hostów można maksymalnie zaadresować w sieci lokalnej, mając do dyspozycji jeden blok adresów klasy C protokołu IPv4?

Aby poprawić bezpieczeństwo zasobów sieciowych, administrator sieci komputerowej w firmie otrzymał zadanie podziału aktualnej lokalnej sieci komputerowej na 16 podsieci. Obecna sieć posiada adres IP 192.168.20.0 i maskę 255.255.255.0. Jaką maskę sieci powinien zastosować administrator?

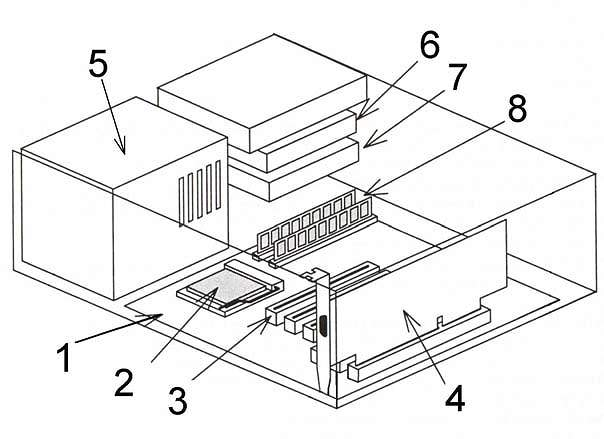

Na ilustracji procesor jest oznaczony liczbą

Oprogramowanie OEM (Original Equipment Manufacturer) jest związane z

Które z tych określeń nie odpowiada charakterystyce kabla światłowodowego?

Jaka jest maksymalna ilość pamięci RAM w GB, do której może uzyskać dostęp 32-bitowa wersja systemu Windows?

Na dysku konieczne jest zapisanie 100 tysięcy pojedynczych plików, każdy o wielkości 2570 bajtów. Zajętość zapisanych plików będzie minimalna na dysku o jednostce alokacji wynoszącej

Administrator Active Directory w domenie firma.local pragnie skonfigurować profil mobilny dla wszystkich użytkowników. Profil ma być zapisywany na serwerze serwer1, w folderze pliki, udostępnionym w sieci jako dane$. Który z parametrów w ustawieniach profilu użytkownika spełnia te wymagania?

Jaką kwotę będzie trzeba zapłacić za wymianę karty graficznej w komputerze, jeżeli jej koszt wynosi 250zł, czas wymiany to 80 minut, a każda rozpoczęta roboczogodzina to 50zł?

Zjawisko, w którym pliki przechowywane na dysku twardym są zapisywane w klastrach, które nie sąsiadują ze sobą, określane jest mianem

Jaka usługa musi być aktywna na serwerze, aby stacja robocza mogła automatycznie uzyskać adres IP?

Aby osiągnąć optymalną prędkość przesyłu danych, gdy domowy ruter działa w paśmie 5 GHz, do laptopa należy zainstalować kartę sieciową bezprzewodową obsługującą standard

Polecenie uname -s w systemie Linux jest wykorzystywane do sprawdzenia

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Który z protokołów będzie wykorzystany przez administratora do przesyłania plików na serwer?

Jaki rezultat uzyskamy po wykonaniu odejmowania dwóch liczb heksadecymalnych 60A (h) - 3BF (h)?