Pytanie 1

Podczas uruchamiania komputera wyświetla się komunikat CMOS checksum error press F1 to continue press DEL to setup. Naciśnięcie klawisza DEL spowoduje

Wynik: 25/40 punktów (62,5%)

Wymagane minimum: 20 punktów (50%)

Podczas uruchamiania komputera wyświetla się komunikat CMOS checksum error press F1 to continue press DEL to setup. Naciśnięcie klawisza DEL spowoduje

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Podczas uruchamiania komputera ukazuje się komunikat "CMOS checksum error press F1 to continue press DEL to setup". Naciśnięcie klawisza DEL skutkuje

Zjawisko crosstalk, które występuje w sieciach komputerowych, polega na

Rodzina adapterów stworzonych w technologii Powerline, pozwalająca na wykorzystanie przewodów elektrycznych w obrębie jednego domu lub mieszkania do przesyłania sygnałów sieciowych, nosi nazwę:

Do jakiej warstwy modelu ISO/OSI odnosi się segmentacja danych, komunikacja w trybie połączeniowym przy użyciu protokołu TCP oraz komunikacja w trybie bezpołączeniowym z protokołem UDP?

Standard zwany IEEE 802.11, używany w lokalnych sieciach komputerowych, określa typ sieci:

Jaką standardową wartość maksymalnej odległości można zastosować pomiędzy urządzeniami sieciowymi, które są ze sobą połączone przewodem UTP kat.5e?

Granice dla obszaru kolizyjnego nie są określane przez porty urządzeń takich jak

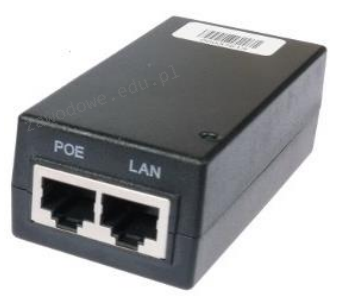

Urządzenie pokazane na ilustracji służy do

Błędy systemu operacyjnego Windows spowodowane przez konflikty zasobów sprzętowych, takie jak przydział pamięci, przydział przerwań IRQ i kanałów DMA, najłatwiej jest wykryć za pomocą narzędzia

Aby zwiększyć lub zmniejszyć rozmiar ikony na pulpicie, trzeba obracać kółkiem myszy, jednocześnie trzymając klawisz

Jaki program powinien zostać zainstalowany na serwerze internetowym opartym na Linuxie, aby umożliwić korzystanie z baz danych?

Wykonanie na komputerze z systemem Windows poleceń ipconfig /release oraz ipconfig /renew umożliwia weryfikację, czy usługa w sieci działa poprawnie

Mysz bezprzewodowa jest podłączona do komputera, jednak kursor nie porusza się gładko i „skacze” po ekranie. Możliwą przyczyną problemu z urządzeniem może być

Które z urządzeń sieciowych funkcjonuje w warstwie fizycznej modelu ISO/OSI, transmitując sygnał z jednego portu do wszystkich pozostałych portów?

Na ilustracji ukazany jest komunikat systemowy. Jakie kroki powinien podjąć użytkownik, aby naprawić błąd?

Adware to program komputerowy

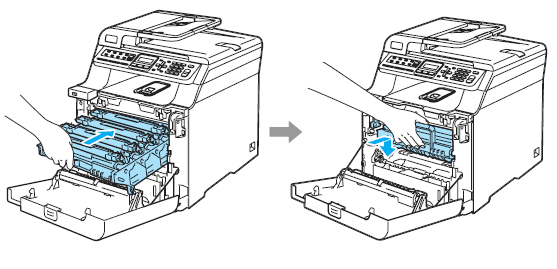

Czynność pokazana na rysunkach ilustruje mocowanie

Program "VirtualPC", dostępny do pobrania z witryny Microsoft, jest przeznaczony do korzystania:

ping 192.168.11.3 Jaką komendę należy wpisać w miejsce kropek, aby w systemie Linux wydłużyć domyślny odstęp czasowy między pakietami podczas używania polecenia ping?

Która z licencji umożliwia korzystanie przez każdego użytkownika z programu bez ograniczeń wynikających z autorskich praw majątkowych?

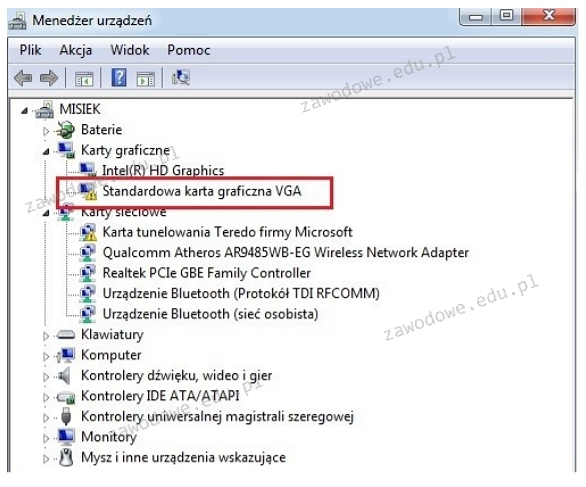

Na ilustracji złącze monitora, które zostało zaznaczone czerwoną ramką, będzie współdziałać z płytą główną posiadającą interfejs

W systemie Windows, domyślne konto administratora po jego dezaktywowaniu oraz ponownym uruchomieniu komputera

Do czego służy program CHKDSK?

W systemie Linux komendą, która jednocześnie podnosi uprawnienia dla procesu uruchamianego z terminala, jest

W celu zrealizowania instalacji sieciowej na stacjach roboczych z systemem operacyjnym Windows, należy na serwerze zainstalować usługi

Której funkcji należy użyć do wykonania kopii zapasowej rejestru systemowego w edytorze regedit?

Który z poniższych protokołów służy do zarządzania urządzeniami w sieciach?

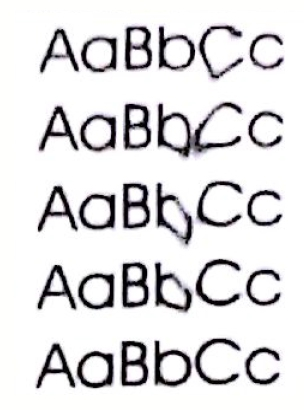

Najbardziej prawdopodobnym powodem niskiej jakości druku z drukarki laserowej, objawiającym się widocznym rozmazywaniem tonera, jest

Aby uniknąć uszkodzenia sprzętu podczas modernizacji komputera przenośnego polegającej na wymianie modułów pamięci RAM należy

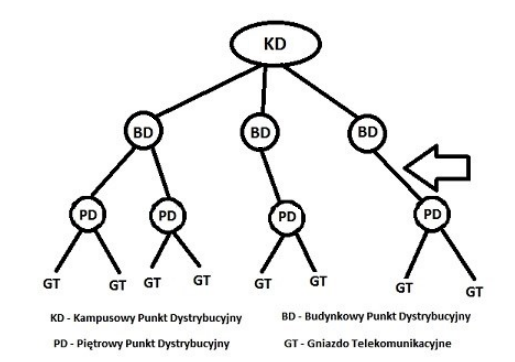

Strzałka na diagramie ilustrującym schemat systemu sieciowego według normy PN-EN 50173 wskazuje na rodzaj okablowania

Procesem nieodwracalnym, całkowicie uniemożliwiającym odzyskanie danych z dysku twardego, jest

Układ cyfrowy wykonujący operację logiczną koniunkcji opiera się na bramce logicznej

Urządzenie sieciowe funkcjonujące w trzeciej warstwie modelu ISO/OSI, posługujące się adresami IP, to

Zjawisko, w którym pliki przechowywane na dysku twardym są umieszczane w nieprzylegających do siebie klastrach, nosi nazwę

Trudności w systemie operacyjnym Windows wynikające z konfliktów dotyczących zasobów sprzętowych, takich jak przydział pamięci, przerwań IRQ oraz kanałów DMA, najłatwiej zidentyfikować za pomocą narzędzia

Jakiej funkcji powinno się użyć, aby utworzyć kopię zapasową rejestru systemowego w programie regedit?

Standard magistrali komunikacyjnej PCI w wersji 2.2 (Peripheral Component Interconnect) definiuje maksymalną szerokość szyny danych na

Parametry katalogowe przedstawione w ramce dotyczą dysku twardego

| ST31000528AS |

| Seagate Barracuda 7200.12 ,32 MB, |

| Serial ATA/300, Heads 4, Capacity 1TB |