Pytanie 1

Urządzenie pokazane na ilustracji ma na celu

Wynik: 23/40 punktów (57,5%)

Wymagane minimum: 20 punktów (50%)

Urządzenie pokazane na ilustracji ma na celu

Jakie będzie rezultatem dodawania liczb 10011012 i 110012 w systemie binarnym?

Na przedstawionym panelu tylnym płyty głównej znajdują się między innymi następujące interfejsy:

Na których urządzeniach do przechowywania danych uszkodzenia mechaniczne są najczęściej spotykane?

Wartość 101011101102 zapisana w systemie szesnastkowym to

Jakie czynności należy wykonać, aby przygotować nowego laptopa do użytkowania?

Wykonanie polecenia net localgroup w systemie Windows spowoduje

Aby osiągnąć przepustowość 4 GB/s w obydwie strony, konieczne jest zainstalowanie w komputerze karty graficznej używającej interfejsu

Jakie procesory można wykorzystać w zestawie komputerowym z płytą główną wyposażoną w gniazdo procesora typu Socket AM3?

Oprogramowanie, które często przerywa działanie przez wyświetlanie komunikatu o konieczności dokonania zapłaty, a które spowoduje zniknięcie tego komunikatu, jest dystrybuowane na podstawie licencji

Jakie polecenie diagnostyczne powinno się użyć, aby uzyskać informacje na temat tego, czy miejsce docelowe odpowiada oraz po jakim czasie nastąpiła odpowiedź?

Jaką maskę powinno się zastosować, aby podzielić sieć z adresem 192.168.1.0 na 4 podsieci?

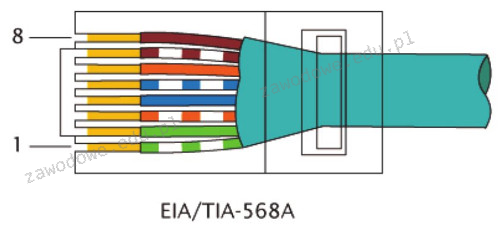

W standardzie Ethernet 100BaseTX do przesyłania danych używane są żyły kabla UTP podłączone do pinów

Jakie polecenie w systemie Windows powinno być użyte do obserwacji listy bieżących połączeń karty sieciowej w komputerze?

Jakie ustawienie należy wprowadzić przy konfiguracji serwera DHCP?

Który z podanych adresów IP jest adresem publicznym?

Co oznacza skrót WAN?

Oprogramowanie, które pozwala na interakcję pomiędzy kartą sieciową a systemem operacyjnym, to

Jakie protokoły przesyłają cykliczne kopie tablic routingu do sąsiadującego rutera i NIE ZAWIERAJĄ pełnych informacji o dalekich ruterach?

Medium transmisyjne oznaczone symbolem S/FTP to skrętka

Podczas realizacji projektu sieci komputerowej, pierwszym krokiem powinno być

Jakie oprogramowanie nie jest przeznaczone do diagnozowania komponentów komputera?

Jakie funkcje posiada program tar?

Komputer prawdopodobnie jest zainfekowany wirusem typu boot. Jakie działanie umożliwi usunięcie wirusa w najbardziej nieinwazyjny sposób dla systemu operacyjnego?

Jaki skrót odpowiada poniższej masce podsieci: 255.255.248.0?

W systemie Linux dane dotyczące haseł użytkowników są zapisywane w pliku:

Pamięć podręczna Intel Smart Cache, która znajduje się w procesorach wielordzeniowych, takich jak Intel Core Duo, to pamięć

Która z poniższych opcji nie jest usługą katalogową?

W systemie Linux istnieją takie prawa dostępu do konkretnego pliku rwxr--r--. Jakie polecenie użyjemy, aby zmienić je na rwxrwx---?

Na zdjęciu widać kartę

Do weryfikacji integralności systemu plików w środowisku Linux trzeba zastosować polecenie

Czynnikiem zagrażającym bezpieczeństwu systemu operacyjnego, który zmusza go do automatycznej aktualizacji, są

W systemie Windows do instalacji aktualizacji oraz przywracania sterowników urządzeń należy użyć przystawki

W którym programie należy zmodyfikować ustawienia, aby użytkownik komputera mógł wybrać z menu i uruchomić jeden z kilku systemów operacyjnych zainstalowanych na jego komputerze?

Aby umożliwić diagnozę systemu operacyjnego Windows oraz utworzyć plik zawierający listę wszystkich zaczytywanych sterowników, należy uruchomić system w trybie

W tabeli przedstawiono pobór mocy poszczególnych podzespołów zestawu komputerowego. Zestaw składa się z:

- płyty głównej,

- procesora,

- 2 modułów pamięci DDR3,

- dysku twardego SSD,

- dysku twardego z prędkością obrotową 7200,

- karty graficznej,

- napędu optycznego,

- myszy i klawiatury,

- wentylatora.

Który zasilacz należy zastosować dla przedstawionego zestawu komputerowego, uwzględniając co najmniej 20% rezerwy poboru mocy?

| Podzespół | Pobór mocy [W] | Podzespół | Pobór mocy [W] |

|---|---|---|---|

| Procesor Intel i5 | 60 | Płyta główna | 35 |

| Moduł pamięci DDR3 | 6 | Karta graficzna | 310 |

| Moduł pamięci DDR2 | 3 | Dysk twardy SSD | 7 |

| Monitor LCD | 80 | Dysk twardy 7200 obr./min | 16 |

| Wentylator | 5 | Dysk twardy 5400 obr./min | 12 |

| Mysz i klawiatura | 2 | Napęd optyczny | 30 |

Symbole i oznaczenia znajdujące się na zamieszczonej tabliczce znamionowej podzespołu informują między innymi o tym, że produkt jest

Komputer ma podłączoną mysz bezprzewodową, a kursor podczas pracy nie porusza się płynnie, „skacze” po ekranie. Przyczyną usterki urządzenia może być

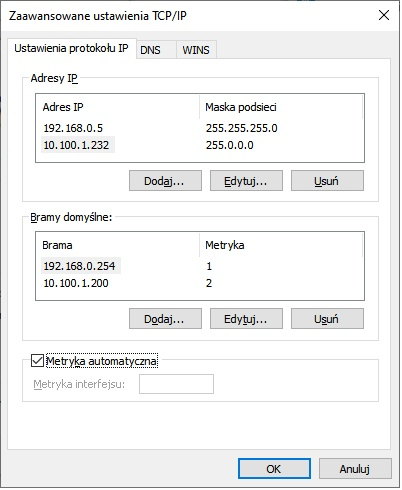

Na podstawie przedstawionej na ilustracji konfiguracji, w przypadku, gdy komputer żąda połączenia z inną siecią, w pierwszej kolejności dane zostaną wysłane do urządzenia o adresie

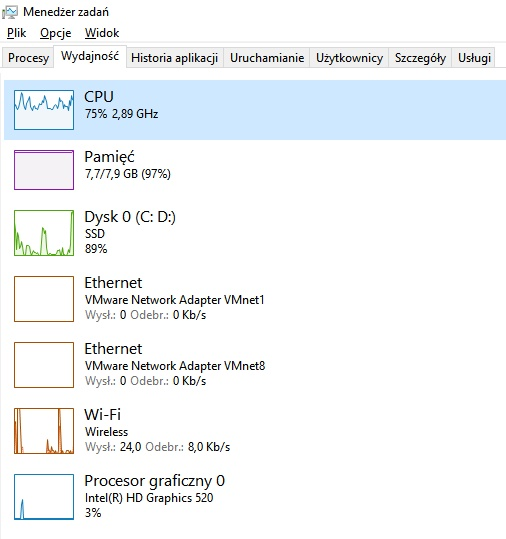

Grafik komputerowy sygnalizuje bardzo wolną pracę komputera. Z ilustracji przedstawiającej okno wydajności komputera wynika, że przyczyną tego może być