Pytanie 1

Który z pakietów powinien być zainstalowany na serwerze Linux, aby komputery z systemem Windows mogły udostępniać pliki oraz drukarki z tego serwera?

Wynik: 23/40 punktów (57,5%)

Wymagane minimum: 20 punktów (50%)

Który z pakietów powinien być zainstalowany na serwerze Linux, aby komputery z systemem Windows mogły udostępniać pliki oraz drukarki z tego serwera?

Zamieszczone atrybuty opisują rodzaj pamięci

| Maksymalne taktowanie | 1600 MHz |

| Przepustowość | PC12800 1600MHz |

| Opóźnienie | Cycle Latency CL 9,0 |

| Korekcja | Nie |

| Dual/Quad | Dual Channel |

| Radiator | Tak |

Jakie polecenie w systemie Linux przyzna możliwość zapisu dla wszystkich obiektów w /usr/share dla wszystkich użytkowników, nie modyfikując innych uprawnień?

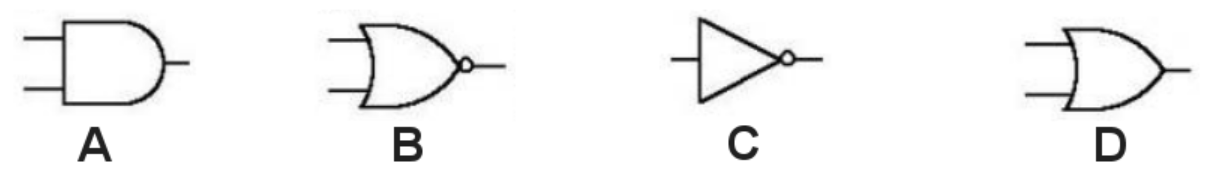

Wskaż ilustrację, która przedstawia symbol bramki logicznej NOT?

Jaka jest prędkość przesyłania danych w standardzie 1000Base-T?

W tabeli przedstawiono pobór mocy poszczególnych podzespołów zestawu komputerowego. Zestaw składa się z:

- płyty głównej,

- procesora,

- 2 modułów pamięci DDR3,

- dysku twardego SSD,

- dysku twardego z prędkością obrotową 7200,

- karty graficznej,

- napędu optycznego,

- myszy i klawiatury,

- wentylatora.

Który zasilacz należy zastosować dla przedstawionego zestawu komputerowego, uwzględniając co najmniej 20% rezerwy poboru mocy?

| Podzespół | Pobór mocy [W] | Podzespół | Pobór mocy [W] |

|---|---|---|---|

| Procesor Intel i5 | 60 | Płyta główna | 35 |

| Moduł pamięci DDR3 | 6 | Karta graficzna | 310 |

| Moduł pamięci DDR2 | 3 | Dysk twardy SSD | 7 |

| Monitor LCD | 80 | Dysk twardy 7200 obr./min | 16 |

| Wentylator | 5 | Dysk twardy 5400 obr./min | 12 |

| Mysz i klawiatura | 2 | Napęd optyczny | 30 |

Jakie polecenie oprócz ls może być użyte przez użytkownika systemu Linux do wyświetlenia zawartości katalogu, w tym plików i podkatalogów?

Grupa, w której uprawnienia przypisane członkom mogą dotyczyć tylko tej samej domeny, co nadrzędna grupa lokalna domeny, to grupa

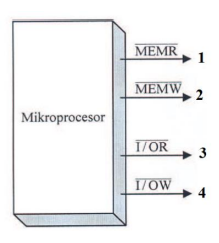

Sygnał kontrolny generowany przez procesor, umożliwiający zapis do urządzeń wejściowych i wyjściowych, został na diagramie oznaczony numerem

W systemie Linux plik posiada uprawnienia ustawione na 765. Grupa przypisana do tego pliku ma możliwość

Czym dokonuje się przekształcenia kodu źródłowego w program do wykonania?

Instalacja systemów Linux oraz Windows 7 przebiegła bez problemów. Oba systemy zainstalowały się prawidłowo z domyślnymi konfiguracjami. Na tym samym komputerze, o tej samej konfiguracji, podczas instalacji systemu Windows XP pojawił się komunikat o braku dysków twardych, co może sugerować

Jaki zakres adresów IPv4 jest prawidłowo przypisany do danej klasy?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Do wykonania kopii danych na dysk USB w systemie Linux stosuje się polecenie

Aby chronić systemy sieciowe przed atakami z zewnątrz, należy zastosować

Która norma w Polsce definiuje zasady dotyczące okablowania strukturalnego?

Aby uniknąć utraty danych w aplikacji do ewidencji uczniów, po zakończonej pracy każdego dnia należy wykonać

Ile pinów znajduje się w wtyczce SATA?

Która para: protokół – warstwa, w której funkcjonuje protokół, jest prawidłowo zestawiona według modelu TCP/IP?

Jakie urządzenie stosuje technikę detekcji zmian w pojemności elektrycznej do sterowania kursorem na monitorze?

Instalacja systemów Linux oraz Windows 7 przebiegła bez żadnych problemów. Systemy zainstalowały się poprawnie z domyślnymi ustawieniami. Na tym samym komputerze, przy tej samej konfiguracji, podczas instalacji systemu Windows XP pojawił się komunikat o braku dysków twardych, co może sugerować

Nierówne wydruki lub bladości w druku podczas korzystania z drukarki laserowej mogą sugerować

Główną metodą ochrony sieci komputerowej przed zagrożeniem z zewnątrz jest zastosowanie

Jakie polecenie jest wysyłane do serwera DHCP, aby zwolnić wszystkie adresy przypisane do interfejsów sieciowych?

W technologii Ethernet 100Base-TX do przesyłania danych używane są żyły kabla UTP podłączone do pinów:

W przypadku dysku twardego, w jakiej jednostce wyrażana jest wartość współczynnika MTBF (Mean Time Between Failure)?

Aby utworzyć kontroler domeny w systemach z rodziny Windows Server na serwerze lokalnym, konieczne jest zainstalowanie roli

Jakie oprogramowanie służy do sprawdzania sterowników w systemie Windows?

Do monitorowania aktywnych połączeń sieciowych w systemie Windows służy polecenie

Aby zmienić ustawienia rozruchu komputera w systemie Windows 7 przy użyciu wiersza poleceń, jakie polecenie powinno być użyte?

W systemach operacyjnych Windows konto użytkownika, które ma najwyższe domyślne uprawnienia, należy do grupy

W biurowcu należy podłączyć komputer do routera ADSL za pomocą przewodu UTP Cat 5e. Jaka powinna być maksymalna odległość między komputerem a routerem?

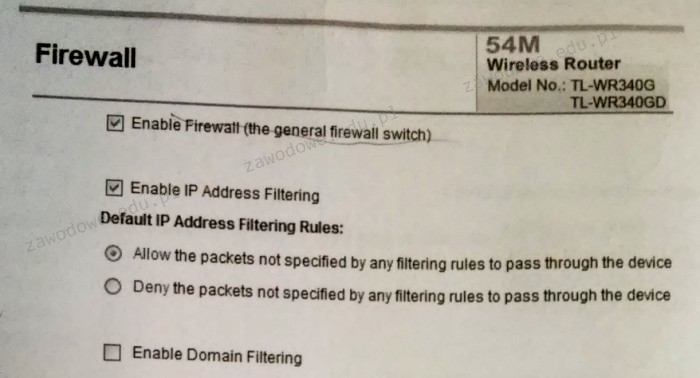

Poniższy rysunek ilustruje ustawienia zapory ogniowej w ruterze TL-WR340G. Jakie zasady dotyczące konfiguracji zapory zostały zastosowane?

Na podstawie danych z "Właściwości systemu" można stwierdzić, że na komputerze zainstalowano fizycznie pamięć RAM o pojemności

| Komputer: Intel(R) Pentium (R)4 CPU 1.8GHz AT/XT Compatible 523 760 kB RAM |

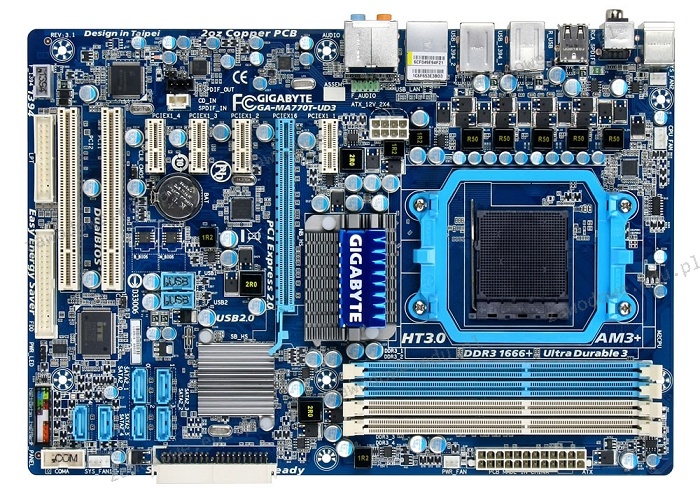

Do pokazanej na diagramie płyty głównej nie można podłączyć urządzenia, które korzysta z interfejsu

Jakie polecenie wykorzystano do analizy zaprezentowanej konfiguracji interfejsów sieciowych w systemie Linux?

enp0s25 Link encap:Ethernet HWaddr a0:b3:cc:28:8f:37 UP BROADCAST MULTICAST MTU:1500 Metric:1 RX packets:0 errors:0 dropped:0 overruns:0 frame:0 TX packets:0 errors:0 dropped:0 overruns:0 carrier:0 collisions:0 txqueuelen:1000 RX bytes:0 (0.0 B) TX bytes:0 (0.0 B) Interrupt:20 Memory:d4700000-d4720000 lo Link encap:Local Loopback inet addr:127.0.0.1 Mask:255.0.0.0 inet6 addr: ::1/128 Scope:Host UP LOOPBACK RUNNING MTU:65536 Metric:1 RX packets:172 errors:0 dropped:0 overruns:0 frame:0 TX packets:172 errors:0 dropped:0 overruns:0 carrier:0 collisions:0 txqueuelen:1000 RX bytes:13728 (13.7 KB) TX bytes:13728 (13.7 KB) wlo1 Link encap:Ethernet HWaddr 60:67:20:3f:91:22 inet addr:192.168.1.11 Bcast:192.168.1.255 Mask:255.255.255.0 inet6 addr: fe80::dcf3:c20b:57f7:21b4/64 Scope:Link UP BROADCAST RUNNING MULTICAST MTU:1500 Metric:1 RX packets:7953 errors:0 dropped:0 overruns:0 frame:0 TX packets:4908 errors:0 dropped:0 overruns:0 carrier:0 collisions:0 txqueuelen:1000 RX bytes:9012314 (9.0 MB) TX bytes:501345 (501.3 KB)

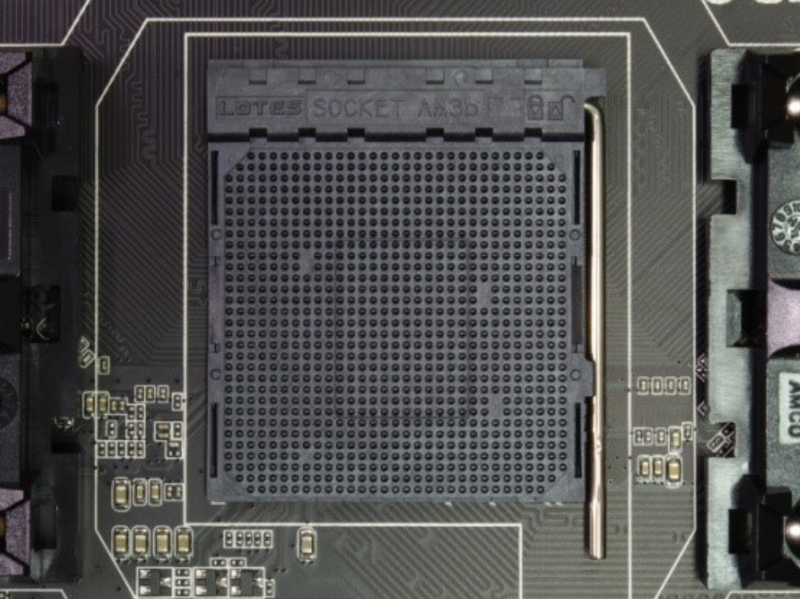

Na płycie głównej wyposażonej w gniazdo przedstawione na zdjęciu można zainstalować procesor

Administrator sieci komputerowej z adresem 192.168.1.0/24 podzielił ją na 8 równych podsieci. Ile adresów hostów będzie dostępnych w każdej z nich?

Brak odpowiedzi na to pytanie.

Aby uzyskać największą prędkość przepływu danych w przypadku, gdy domowy ruter pracuje w paśmie częstotliwości 5 GHz, do notebooka powinno się zamontować bezprzewodową kartę sieciową pracującą w standardzie

Brak odpowiedzi na to pytanie.