Pytanie 1

Podczas pracy dysk twardy wydaje stukanie, a uruchamianie systemu oraz odczyt danych są znacznie spowolnione. W celu naprawienia tej awarii, po wykonaniu kopii zapasowej danych na zewnętrznym nośniku należy

Wynik: 14/40 punktów (35,0%)

Wymagane minimum: 20 punktów (50%)

Podczas pracy dysk twardy wydaje stukanie, a uruchamianie systemu oraz odczyt danych są znacznie spowolnione. W celu naprawienia tej awarii, po wykonaniu kopii zapasowej danych na zewnętrznym nośniku należy

Zamiana taśmy barwiącej wiąże się z eksploatacją drukarki

W komputerach obsługujących wysokowydajne zadania serwerowe, konieczne jest użycie dysku z interfejsem

Która z licencji pozwala na darmowe korzystanie z programu, pod warunkiem, że użytkownik zadba o ekologię?

Aby zminimalizować różnice w kolorach pomiędzy zeskanowanymi obrazami prezentowanymi na monitorze a ich wersjami oryginalnymi, należy przeprowadzić

Który komponent mikroprocesora odpowiada m.in. za odczytywanie instrukcji z pamięci oraz generowanie sygnałów kontrolnych?

Urządzenia wykorzystujące port USB 2.0 są zasilane napięciem, którego wartość znajduje się w przedziale

Urządzenie typu Plug and Play, które jest ponownie podłączane do komputera, jest identyfikowane na podstawie

Jak określa się atak w sieci lokalnej, który polega na usiłowaniu podszycia się pod inną osobę?

Przyczyną niekontrolowanego wypełnienia przestrzeni na dysku może być

Na przedstawionym rysunku widoczna jest karta rozszerzeń z systemem chłodzenia

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Który układ mikroprocesora jest odpowiedzialny między innymi za pobieranie rozkazów z pamięci oraz generowanie sygnałów sterujących?

Po wykonaniu eksportu klucza HKCR zostanie zapisana kopia rejestru, zawierająca informacje dotyczące konfiguracji

Aby przygotować do pracy skaner, którego opis zawarto w tabeli, należy w pierwszej kolejności

| Skaner przenośny IRIScanBook 3 |

| Bezprzewodowy, zasilany baterią i bardzo lekki. Można go przenosić w dowolne miejsce! |

| Idealny do skanowania książek, czasopism i gazet |

| Rozdzielczość skanowania 300/600/900 dpi |

| Prędkość skanowania: 2 sek. dla tekstów biało-czarnych / 3 sek. dla tekstów kolorowych |

| Bezpośrednie skanowanie do formatu PDF i JPEG |

| Zapis skanu na kartę microSD ™ (w zestawie) |

| Kolorowy ekran (do podglądu zeskanowanych obrazów) |

| 3 baterie alkaliczne AAA (w zestawie) |

Która z usług umożliwia centralne zarządzanie identyfikacjami, uprawnieniami oraz zasobami w sieci?

Zadania systemu operacyjnego nie obejmują

Jakie jest IPv4 urządzenia znajdującego się w sieci 10.100.0.0/18?

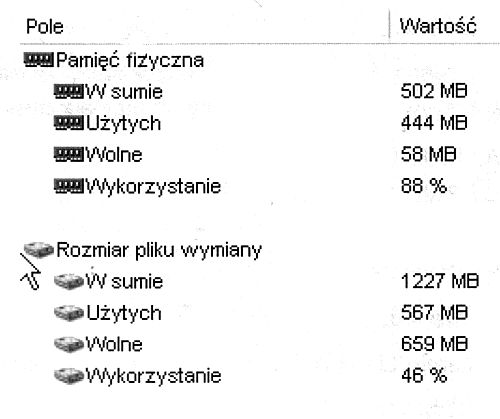

Zgodnie z zamieszczonym fragmentem testu w systemie komputerowym zainstalowane są

Jaką rolę pełni serwer plików w sieciach komputerowych LAN?

Najlepszym sposobem na zabezpieczenie domowej sieci Wi-Fi jest

Adres fizyczny karty sieciowej AC-72-89-17-6E-B2 zapisany jest w formacie

Na ilustracji pokazano część efektu działania programu przeznaczonego do testowania sieci. Sugeruje to użycie polecenia diagnostycznego w sieci

TCP 192.168.0.13:51614 bud02s23-in-f8:https ESTABLISHED TCP 192.168.0.13:51615 edge-star-mini-shv-01-ams3:https ESTABLISHED TCP 192.168.0.13:51617 93.184.220.29:http ESTABLISHED TCP 192.168.0.13:51619 93.184.220.29:http ESTABLISHED TCP 192.168.0.13:51620 93.184.220.29:http TIME_WAIT TCP 192.168.0.13:51621 bud02s23-in-f206:https TIME_WAIT TCP 192.168.0.13:51622 xx-fbcdn-shv-01-ams3:https ESTABLISHED TCP 192.168.0.13:51623 108.161.188.192:https ESTABLISHED TCP 192.168.0.13:51626 23.111.9.32:https TIME_WAIT TCP 192.168.0.13:51628 lg-in-f155:https ESTABLISHED TCP 192.168.0.13:51629 waw02s06-in-f68:https ESTABLISHED

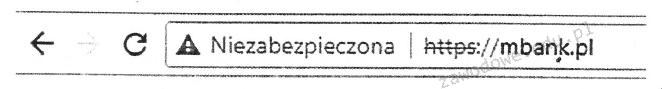

Zidentyfikuj powód pojawienia się komunikatu, który widoczny jest na ilustracji.

Po dokonaniu eksportu klucza HKCU powstanie kopia rejestru zawierająca dane dotyczące ustawień

Aby zmienić istniejące konto użytkownika przy użyciu polecenia net user oraz wymusić reset hasła po kolejnej sesji logowania użytkownika, jaki parametr należy dodać do tego polecenia?

Aby przyznać użytkownikowi w systemie Windows możliwość zmiany czasu systemowego, należy skorzystać z narzędzia

Jaka będzie suma liczb binarnych 1010 oraz 111, gdy przeliczymy ją na system dziesiętny?

Adapter USB do LPT można zastosować w sytuacji, gdy występuje niezgodność złączy podczas podłączania starszych modeli

Jakie parametry mierzy watomierz?

Jak nazywa się protokół oparty na architekturze klient-serwer oraz modelu żądanie-odpowiedź, wykorzystywany do przesyłania plików?

Instalacja serwera stron www w rodzinie systemów Windows Server jest możliwa dzięki roli

Wskaż aplikację w systemie Linux, która służy do kompresji plików.

Jakiego rodzaju złącze powinna mieć płyta główna, aby użytkownik był w stanie zainstalować kartę graficzną przedstawioną na rysunku?

W systemie Windows można przeprowadzić analizę wpływu uruchomionych aplikacji na wydajność komputera, korzystając z polecenia

Thunderbolt to interfejs

Jakie znaczenie ma termin "wykonanie kopii zapasowej systemu"?

Jakie polecenie powinien zastosować użytkownik systemu Linux, aby wydobyć zawartość archiwum o nazwie dane.tar?

Jaką funkcję serwera trzeba dodać w systemach z rodziny Windows Server, aby było możliwe utworzenie nowej witryny FTP?

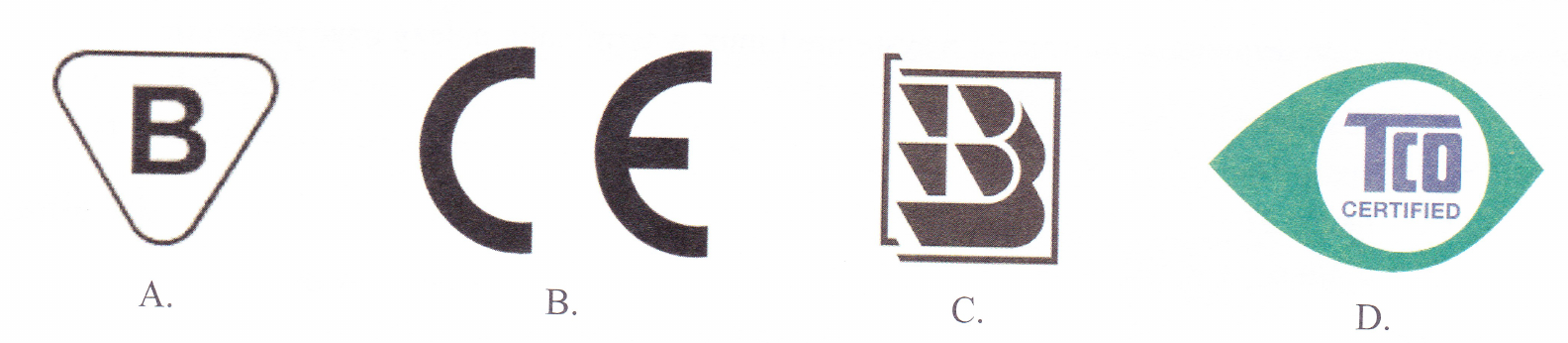

Wskaż symbol umieszczany na urządzeniach elektrycznych, które są przeznaczone do obrotu i sprzedaży na terenie Unii Europejskiej?