Pytanie 1

Jakie urządzenie powinno być wykorzystane do pomiaru mapy połączeń w okablowaniu strukturalnym sieci lokalnej?

Wynik: 11/40 punktów (27,5%)

Wymagane minimum: 20 punktów (50%)

Jakie urządzenie powinno być wykorzystane do pomiaru mapy połączeń w okablowaniu strukturalnym sieci lokalnej?

W systemie operacyjnym Linux proces archiwizacji danych wykonuje się za pomocą polecenia

Na stabilność wyświetlanego obrazu w monitorach CRT istotny wpływ ma

Który protokół jest odpowiedzialny za przekształcanie adresów IP na adresy MAC w kontroli dostępu do nośnika?

Jakie jest ciało odpowiedzialne za publikację dokumentów RFC (Request For Comments), które określają zasady rozwoju Internetu?

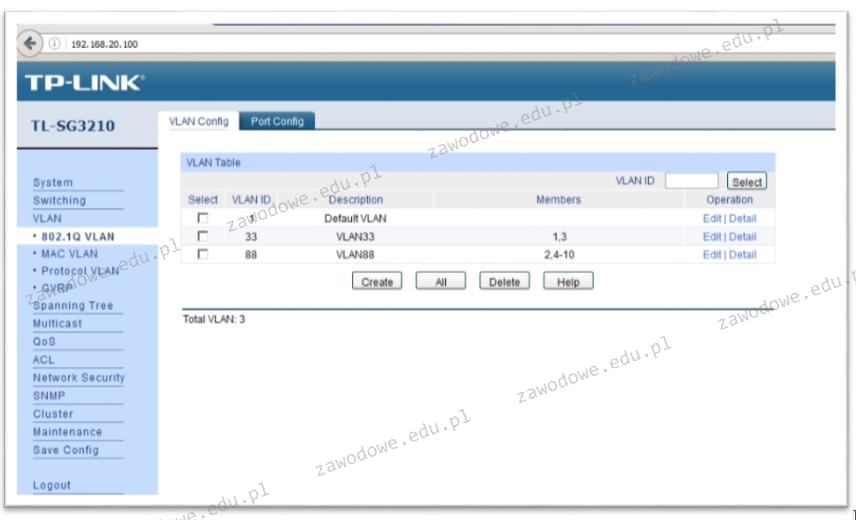

Na schemacie przedstawiono układ urządzenia. Do jakich portów należy podłączyć serwer o adresie IP 192.168.20.254/24 oraz stację roboczą o adresie IP 192.168.20.10/24, aby umożliwić ich komunikację w sieci?

Które narzędzie systemu Windows służy do zdefiniowania polityki haseł dostępowych do kont użytkowników?

Po podłączeniu działającej klawiatury do jednego z portów USB nie ma możliwości wybrania awaryjnego trybu uruchamiania systemu Windows. Mimo to klawiatura działa prawidłowo po uruchomieniu systemu w standardowym trybie. Co to sugeruje?

Aby móc zakładać konta użytkowników, komputerów oraz innych obiektów i centralnie gromadzić o nich informacje, należy zainstalować rolę na serwerze Windows

W systemie Windows 7 narzędzie linii poleceń Cipher.exe jest wykorzystywane do

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Rodzajem macierzy RAID, która nie jest odporna na awarię dowolnego z dysków wchodzących w jej skład, jest

Podstawowym zadaniem mechanizmu Plug and Play jest:

W systemie Linux komenda tty pozwala na

Urządzenie sieciowe nazywane mostem (ang. bridge) to:

Wtyczka zasilająca SATA ma uszkodzony żółty przewód. Jakie to niesie za sobą konsekwencje dla napięcia na złączu?

Co umożliwia zachowanie jednolitego rozkładu temperatury pomiędzy procesorem a radiatorem?

Jak wygląda liczba 51210) w systemie binarnym?

Jakie będą wydatki na zakup kabla UTP kat.5e potrzebnego do stworzenia sieci komputerowej składającej się z 6 stanowisk, przy średniej odległości każdego stanowiska od przełącznika równiej 9m? Należy doliczyć m zapasu dla każdej linii kablowej, a cena za metr kabla wynosi 1,50 zł?

Brak odpowiedzi na to pytanie.

Podczas próby zapisania danych na karcie SD wyświetla się komunikat "usuń ochronę przed zapisem lub użyj innego dysku". Zwykle przyczyną tego komunikatu jest

Brak odpowiedzi na to pytanie.

Liczba BACA zapisana w systemie szesnastkowym odpowiada liczbie

Brak odpowiedzi na to pytanie.

Wskaż aplikację w systemie Linux, która służy do kompresji plików.

Brak odpowiedzi na to pytanie.

Który z standardów korzysta z częstotliwości 5 GHz?

Brak odpowiedzi na to pytanie.

Którego narzędzia można użyć, aby prześledzić trasę, którą pokonują pakiety w sieciach?

Brak odpowiedzi na to pytanie.

Korzystając z podanego urządzenia, możliwe jest przeprowadzenie analizy działania

Brak odpowiedzi na to pytanie.

Jaka liczba hostów może być podłączona w sieci o adresie 192.168.1.128/29?

Brak odpowiedzi na to pytanie.

Narzędziem wykorzystywanym do diagnozowania połączeń między komputerami w systemie Windows jest

Brak odpowiedzi na to pytanie.

Pomiar strukturalnego okablowania metodą Permanent Link polega na

Brak odpowiedzi na to pytanie.

Który protokół jest używany do zdalnego zarządzania komputerem przez terminal w systemach Linux?

Brak odpowiedzi na to pytanie.

Jakie jest odpowiadające adresowi 194.136.20.35 w systemie dziesiętnym przedstawienie w systemie binarnym?

Brak odpowiedzi na to pytanie.

W nowoczesnych ekranach dotykowych działanie ekranu jest zapewniane przez mechanizm, który wykrywa zmianę

Brak odpowiedzi na to pytanie.

Narzędzie System Image Recovery dostępne w zaawansowanych opcjach uruchamiania systemu Windows 7 pozwala na

Brak odpowiedzi na to pytanie.

Zidentyfikuj urządzenie przedstawione na ilustracji

Brak odpowiedzi na to pytanie.

Aby zmontować komputer z poszczególnych elementów, korzystając z obudowy SFF, trzeba wybrać płytę główną w formacie

Brak odpowiedzi na to pytanie.

Możliwość bezprzewodowego połączenia komputera z siecią Internet za pomocą tzw. hotspotu będzie dostępna po zainstalowaniu w nim karty sieciowej posiadającej

Brak odpowiedzi na to pytanie.

Serwer, który realizuje żądania w protokole komunikacyjnym HTTP, to serwer

Brak odpowiedzi na to pytanie.

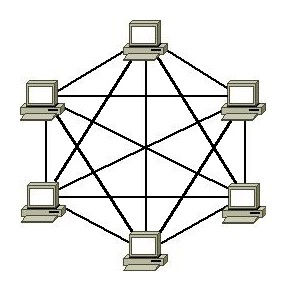

Jakiego rodzaju fizyczna topologia sieci komputerowej jest zobrazowana na rysunku?

Brak odpowiedzi na to pytanie.

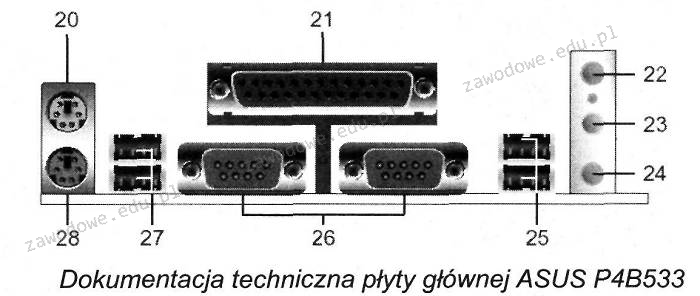

Na zaprezentowanej płycie głównej komputera złącza oznaczono cyframi 25 i 27

Brak odpowiedzi na to pytanie.

Przyczyną niekontrolowanego wypełnienia przestrzeni na dysku może być

Brak odpowiedzi na to pytanie.

Jak nazywa się atak na sieć komputerową, który polega na przechwytywaniu przesyłanych w niej pakietów?

Brak odpowiedzi na to pytanie.