Pytanie 1

Druk z drukarki igłowej realizowany jest z wykorzystaniem zestawu stalowych igieł w liczbie

Wynik: 18/40 punktów (45,0%)

Wymagane minimum: 20 punktów (50%)

Druk z drukarki igłowej realizowany jest z wykorzystaniem zestawu stalowych igieł w liczbie

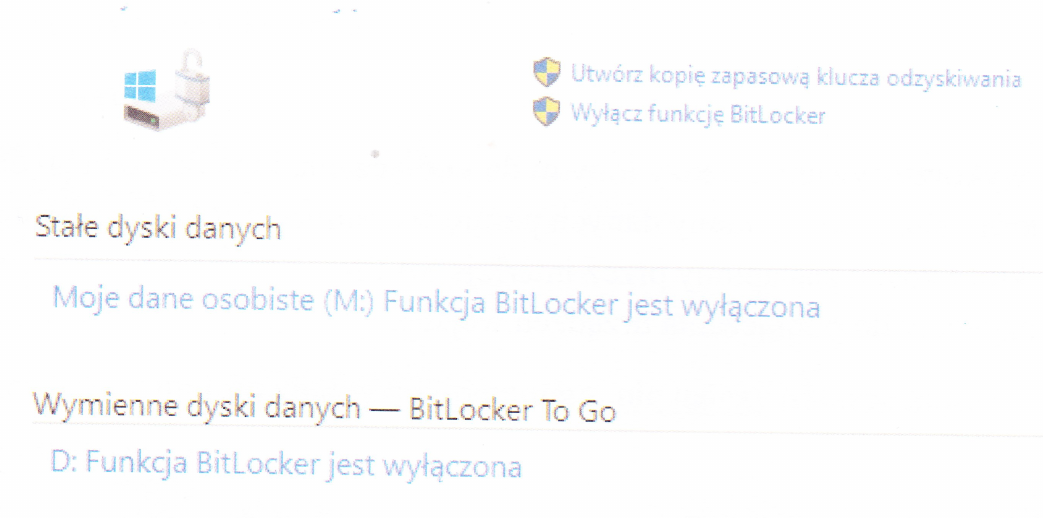

Wbudowane narzędzie dostępne w systemach Windows w edycji Enterprise lub Ultimate jest przeznaczone do

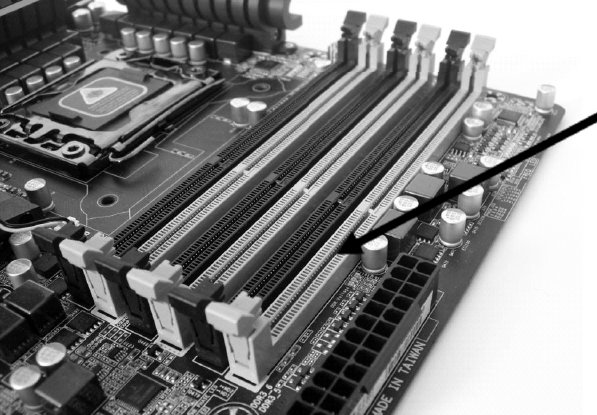

Jaki typ pamięci powinien być umieszczony na płycie głównej komputera w miejscu, które wskazuje strzałka?

Jakie polecenie w systemie Linux pokazuje czas działania systemu oraz jego średnie obciążenie?

W systemie Linux, aby przejść do głównego katalogu w strukturze drzewiastej, używa się komendy

Wykonanie polecenia attrib +h +s +r przykład.txt w konsoli systemu Windows spowoduje

Podczas skanowania reprodukcji obrazu z magazynu, na skanie pojawiły się regularne wzory, zwane morą. Jaką funkcję skanera należy zastosować, aby pozbyć się mory?

Jak nazywa się licencja oprogramowania pozwalająca na bezpłatne dystrybucję aplikacji?

Najlepszą metodą ochrony danych przedsiębiorstwa, którego biura znajdują się w różnych, odległych miejscach, jest wdrożenie

Na zdjęciu ukazano złącze zasilające

Plik zajmuje 2KB. Jakie to jest?

Które urządzenie poprawi zasięg sieci bezprzewodowej?

Na jakich portach brama sieciowa powinna umożliwiać ruch, aby klienci w sieci lokalnej mieli możliwość ściągania plików z serwera FTP?

Jaki protokół sygnalizacyjny jest wykorzystywany w technologii VoIP?

Który z poniższych adresów stanowi adres rozgłoszeniowy dla sieci 172.16.64.0/26?

Jakie urządzenie powinno zostać wykorzystane do podłączenia komputerów, aby mogły funkcjonować w odrębnych domenach rozgłoszeniowych?

Jaki jest standard 1000Base-T?

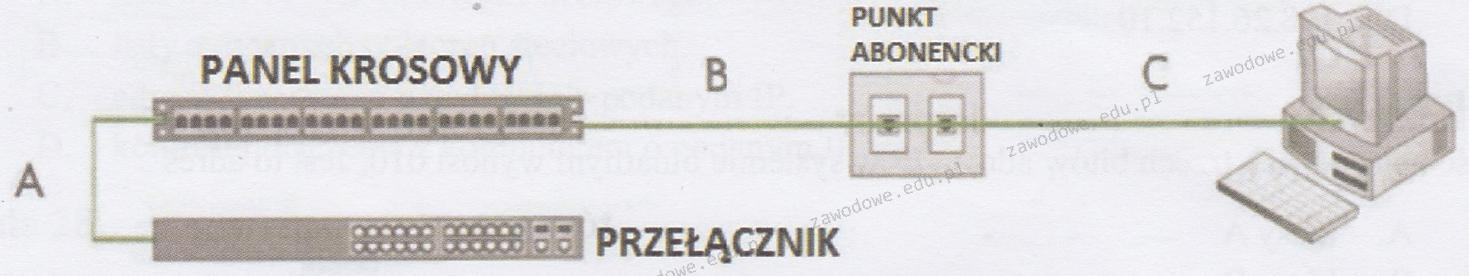

Według normy PN-EN 50174 maksymalna całkowita długość kabla połączeniowego między punktem abonenckim a komputerem oraz kabla krosowniczego A+C) wynosi

Jakie oznaczenie odnosi się do normy dotyczącej okablowania strukturalnego?

Autor zamieszczonego oprogramowania zezwala na jego bezpłatne używanie jedynie w przypadku

| Ancient Domains of Mystery | |

|---|---|

| Autor | Thomas Biskup |

| Platforma sprzętowa | DOS, OS/2, Macintosh, Microsoft Windows, Linux |

| Pierwsze wydanie | 23 października 1994 |

| Aktualna wersja stabilna | 1.1.1 / 20 listopada 2002 r. |

| Aktualna wersja testowa | 1.2.0 Prerelease 18 / 1 listopada 2013 |

| Licencja | postcardware |

| Rodzaj | roguelike |

Symbolika tego procesora wskazuje na

Aby na Pasku zadań pojawiły się ikony z załączonego obrazu, trzeba w systemie Windows ustawić

Oblicz całkowity koszt materiałów potrzebnych do zbudowania sieci w topologii gwiazdy dla 3 komputerów z kartami sieciowymi, używając kabli o długości 2 m. Ceny materiałów są wskazane w tabeli.

| Nazwa elementu | Cena jednostkowa brutto |

|---|---|

| przełącznik | 80 zł |

| wtyk RJ-45 | 1 zł |

| przewód typu „skrętka" | 1 zł za 1 metr |

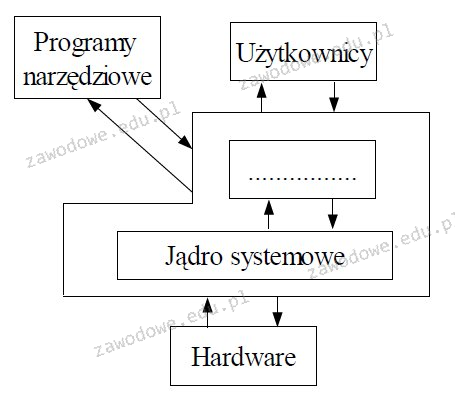

Jaki termin powinien zostać umieszczony w miejscu z kropkami na schemacie blokowym przedstawiającym strukturę systemu operacyjnego?

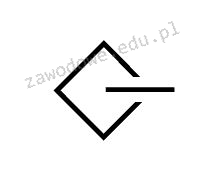

Zapisany symbol dotyczy urządzeń

Sprzęt używany w sieciach komputerowych, posiadający dedykowane oprogramowanie do blokowania nieautoryzowanego dostępu do sieci, to

Jakie medium transmisyjne w sieciach LAN rekomenduje się do użycia w historycznych obiektach?

Rekord startowy dysku twardego w komputerze to

Program df pracujący w systemach z rodziny Linux pozwala na wyświetlenie

Jaka jest maksymalna prędkość przesyłania danych w sieci lokalnej, w której wykorzystano przewód UTP kat.5e do budowy infrastruktury kablowej?

Wykonanie polecenia net use Z:192.168.20.2data /delete spowoduje?

Każdy następny router IP na drodze pakietu

Jakie polecenie w terminalu systemu operacyjnego Microsoft Windows wyświetla dane dotyczące wszystkich zasobów udostępnionych na komputerze lokalnym?

Ustawienia wszystkich kont użytkowników na komputerze znajdują się w gałęzi rejestru oznaczonej akronimem

Dysk z systemem plików FAT32, na którym regularnie przeprowadza się operacje usuwania starych plików oraz dodawania nowych, staje się:

Martwy piksel, który jest defektem w monitorach LCD, to punkt, który ciągle ma ten sam kolor

Komunikat "BIOS checksum error" pojawiający się podczas uruchamiania komputera zazwyczaj wskazuje na

Jakie będą całkowite wydatki na materiały potrzebne do stworzenia 20 kabli połączeniowych typu patchcord, z których każdy ma długość 1,5m, jeśli cena 1 metra bieżącego kabla wynosi 1zł, a cena wtyku to 50 gr?

Po wykonaniu eksportu klucza HKCU zostanie zapisana kopia rejestru zawierająca informacje, dotyczące konfiguracji

Aby uzyskać adres IPv4, za pomocą usługi DHCP, komputer kliencki wysyła żądania z portu