Pytanie 1

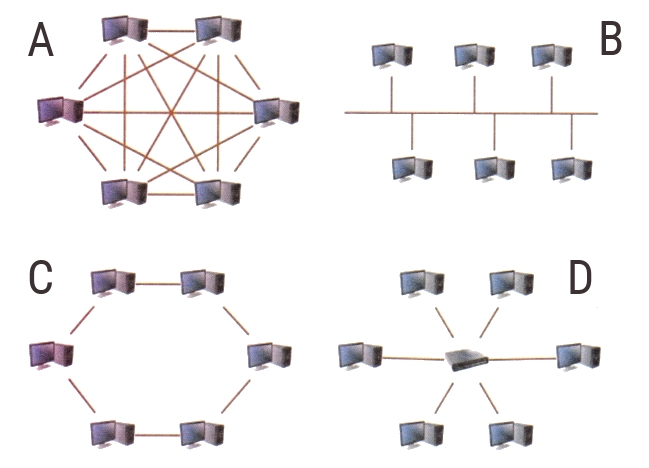

Która z przedstawionych na rysunkach topologii jest topologią siatkową?

Wynik: 18/40 punktów (45,0%)

Wymagane minimum: 20 punktów (50%)

Która z przedstawionych na rysunkach topologii jest topologią siatkową?

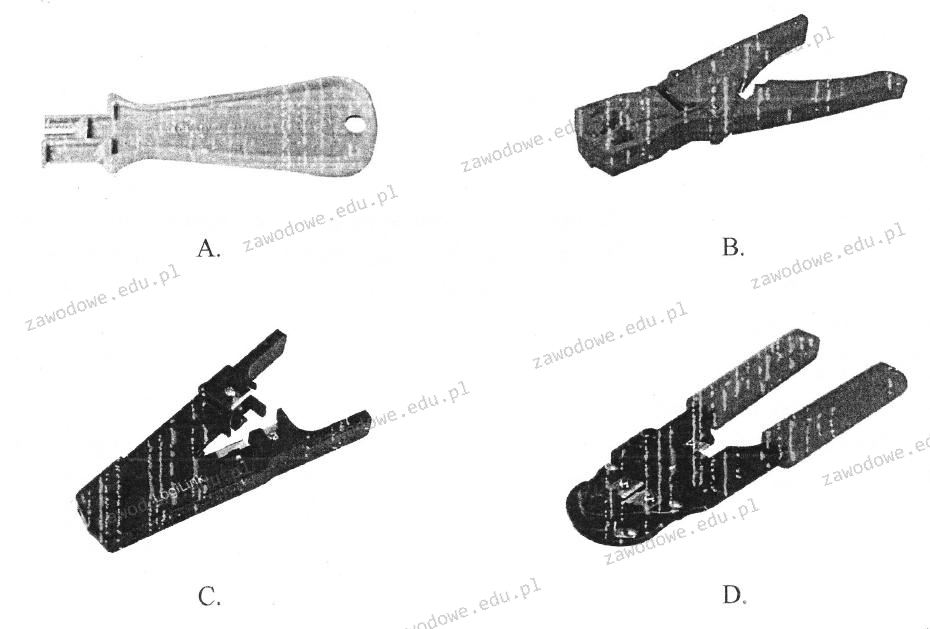

Jakiego narzędzia należy użyć do zakończenia końcówek kabla UTP w module keystone z złączami typu 110?

W systemie Linux polecenie chmod 321 start spowoduje przyznanie poniższych uprawnień plikowi start:

Karta rozszerzeń przedstawiona na ilustracji może być zainstalowana w komputerze, jeśli na płycie głównej znajduje się przynajmniej jeden dostępny slot

Czym jest VOIP?

Które zestawienie: urządzenie - funkcja, którą pełni, jest niepoprawne?

Jakie porty powinny być odblokowane w firewallu komputera, aby uzyskać dostęp do zainstalowanej usługi FTP?

Wskaź na zakres adresów IP klasy A, który jest przeznaczony do prywatnej adresacji w sieciach komputerowych?

Atak na system komputerowy przeprowadzany jednocześnie z wielu maszyn w sieci, który polega na zablokowaniu działania tego systemu przez zajęcie wszystkich dostępnych zasobów, określany jest mianem

Jakie cechy posiadają procesory CISC?

Złącze SC powinno być zainstalowane na przewodzie

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Który z trybów nie jest oferowany przez narzędzie lupa w systemie Windows?

Którym poleceniem można skonfigurować uprawnienia do zasobów sieciowych w systemie Windows?

Ikona z wykrzyknikiem, którą widać na ilustracji, pojawiająca się przy nazwie urządzenia w Menedżerze urządzeń, wskazuje, że to urządzenie

Urządzenie przedstawione na ilustracji oraz jego dane techniczne mogą być użyte do pomiarów rodzaju okablowania

W systemie Linux narzędzie fsck umożliwia

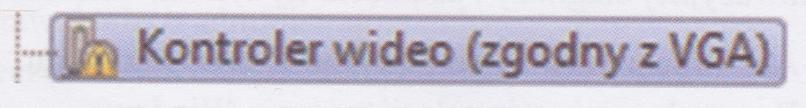

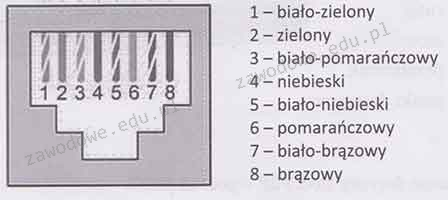

Który typ standardu zakończenia kabla w systemie okablowania strukturalnego ilustruje przedstawiony rysunek?

Aby zablokować hasło dla użytkownika egzamin w systemie Linux, jakie polecenie należy zastosować?

W formacie plików NTFS, do zmiany nazwy pliku potrzebne jest uprawnienie

Jakie narzędzie w systemie Windows pozwala na ocenę wpływu poszczególnych procesów i usług na wydajność procesora oraz na obciążenie pamięci i dysku?

Która z usług serwerowych oferuje automatyczne ustawienie parametrów sieciowych dla stacji roboczych?

W nagłówku ramki standardu IEEE 802.3 w warstwie łącza danych znajduje się

Administrator dostrzegł, że w sieci LAN występuje znaczna ilość kolizji. Jakie urządzenie powinien zainstalować, aby podzielić sieć lokalną na mniejsze domeny kolizji?

Aby zwiększyć efektywność komputera, można w nim zainstalować procesor wspierający technologię Hyper-Threading, co umożliwia

Aby określić rozmiar wolnej oraz zajętej pamięci RAM w systemie Linux, można skorzystać z polecenia

Które polecenie systemu Linux wyświetla czas pracy systemu oraz jego średnie obciążenie?

Karta sieciowa przedstawiona na ilustracji ma zdolność przesyłania danych z maksymalną prędkością

Jakie pasmo częstotliwości definiuje klasa okablowania D?

Jakie narzędzie jest używane do zarządzania alokacjami dyskowymi w systemach Windows 7 i Windows 8?

Zidentyfikowanie głównego rekordu rozruchowego, który uruchamia system z aktywnej partycji, jest możliwe dzięki

Narzędziem wiersza poleceń w systemie Windows, umożliwiającym zamianę tablicy partycji GPT na MBR, jest program

Zastosowanie programu Wireshark polega na

Jaki instrument jest używany do usuwania izolacji?

Ustanowienie połączenia pomiędzy dwoma oddalonymi hostami za pomocą publicznej sieci, takiej jak Internet, w sposób, że węzły tej sieci nie wpływają na przesyłane pakiety, to

W biurze należy zamontować 5 podwójnych gniazd abonenckich. Średnia odległość od lokalnego punktu dystrybucyjnego do gniazda abonenckiego wynosi 10m. Jaki będzie przybliżony koszt zakupu kabla UTP kategorii 5e do utworzenia sieci lokalnej, jeśli cena brutto za 1m kabla UTP kategorii 5e wynosi 1,60 zł?

Na ilustracji ukazano port w komputerze, który służy do podłączenia

Jaki akronim oznacza program do tworzenia graficznych wykresów ruchu, który odbywa się na interfejsach urządzeń sieciowych?

W dokumentacji powykonawczej dotyczącej fizycznej oraz logicznej struktury sieci lokalnej powinny być zawarte

Który standard Gigabit Ethernet pozwala na tworzenie segmentów sieci o długości 550 m lub 5000 m przy prędkości transmisji 1 Gb/s?