Pytanie 1

Zapisana w ramce funkcja zawiera

| Funkcja oblicz(n) Jeżeli n=0 oblicz=1 W przeciwnym wypadku oblicz=(n-1)*oblicz(n-1) |

Wynik: 37/40 punktów (92,5%)

Wymagane minimum: 20 punktów (50%)

Zapisana w ramce funkcja zawiera

| Funkcja oblicz(n) Jeżeli n=0 oblicz=1 W przeciwnym wypadku oblicz=(n-1)*oblicz(n-1) |

Nie uzyskamy pomocy na temat polecenia „net” w wierszu poleceń systemu Windows wpisując

Przedstawiony fragment dokumentacji dotyczy

Częstotliwość: 2.0-10.0MHz; Tryb obrazowania: B, B/B, B/M, M, 4B; Dynamiczne 4-stopniowe ogniskowanie; |

Jaki wpływ na organizm ludzki ma krioterapia?

Który endoskop pozwala na badanie wnętrza tchawicy i oskrzeli?

Który z nośników danych umożliwia wielokrotny zapis i ma największą pojemność?

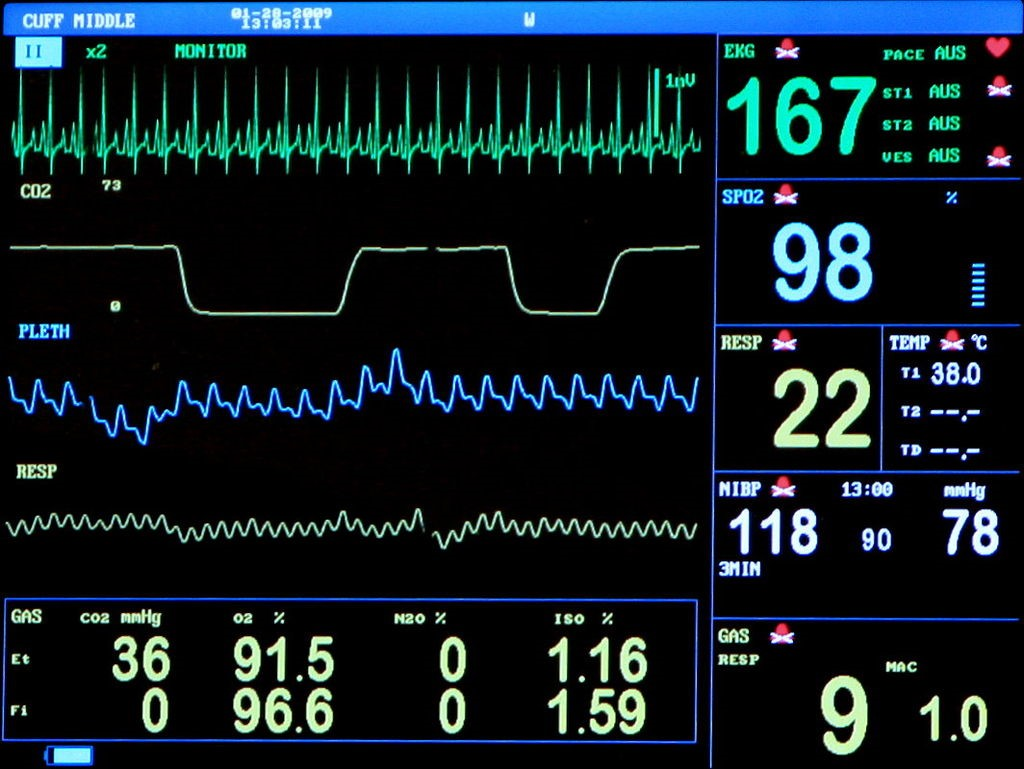

Z ekranu urządzenia wynika, że pełni ono między innymi funkcję

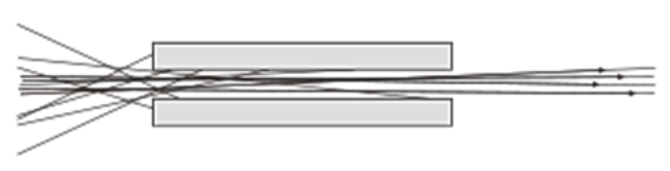

Przedstawiony na rysunku kolimator stanowi część

W dokumentacji sieci centralnego monitoringu zapisano, że sieć jest wykonana w standardzie 802.11 Do montażu takiej sieci są wymagane urządzenia wykorzystujące

W jakim celu stosuje się podział użytkowników na grupy w systemie operacyjnym?

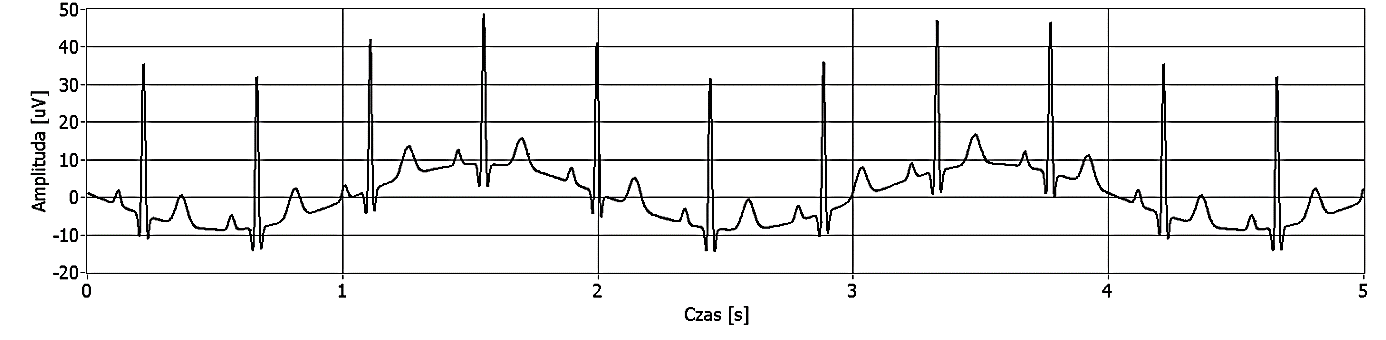

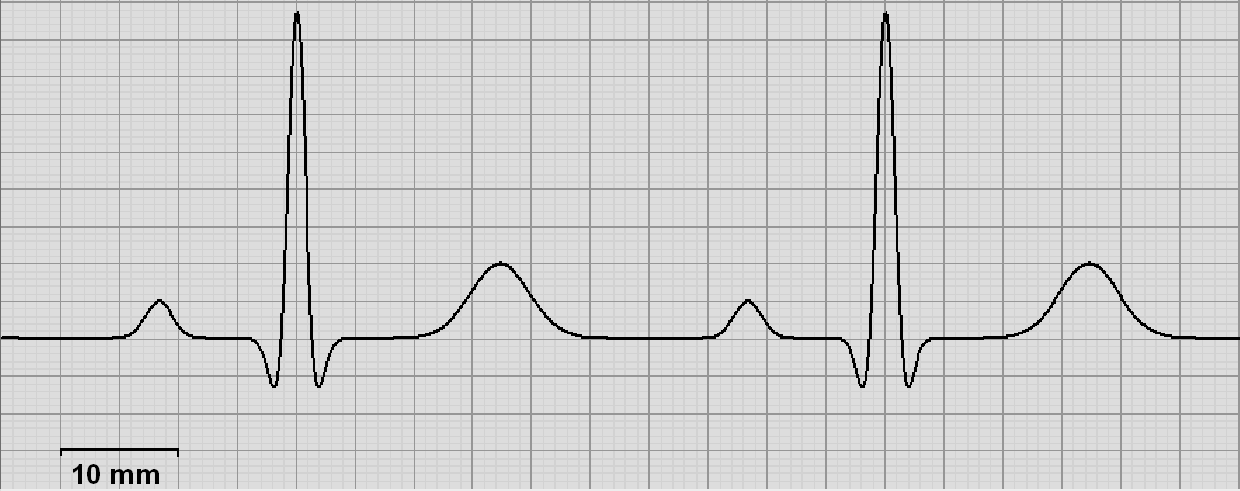

Podczas testowania elektrokardiografu otrzymano przedstawiony przebieg. Na jego podstawie stwierdzono, że nieprawidłowo działa filtr zakłóceń

Którego nośnika pamięci należy użyć w komputerze, aby zapewnić najszybsze ładowanie się systemu operacyjnego podczas jego uruchamiania?

Jaki wpływ na organizm ludzki ma promieniowanie podczerwone IR?

Do badań ultrasonograficznych struktur płytko położonych (np. tarczycy) stosuje się głowicę

Które działanie nie odnosi się do podstawowej funkcji komputera?

Technika diagnostyki obrazowej polegająca na badaniu struktur serca i dużych naczyń krwionośnych za pomocą ultradźwięków jest określana skrótem

Urządzenie, które składa się między innymi z kamery na końcu przewodu i światłowodowych przewodów optycznych, to

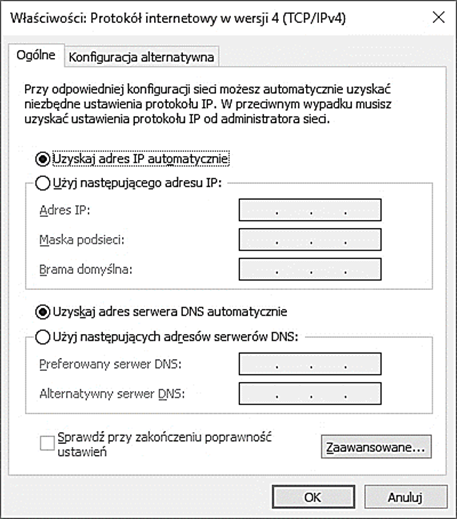

Aby karta sieciowa automatycznie uzyskiwała adres IP, ruter musi mieć włączony serwer

Zestaw przedstawiony na rysunku przeznaczony jest do przeprowadzania testu aparatu

System informatyczny wymaga zabezpieczenia danych poprzez tworzenie kopii zapasowych. Dysponując 2 dyskami, można je połączyć w

Zabieg diametrii krótkofalowej powoduje

Jaki powinien być ustawiony adres maski podsieci, aby umożliwiał podłączenie maksymalnie 30 urządzeń?

Rysunek przedstawia raport sprawdzający połączenie pomiędzy stacjami monitorującymi informatycznego systemu medycznego. Którego polecenia należy użyć aby go uzyskać?

Na rysunku przedstawiono kartę rozszerzeń umożliwiającą

Jakiego typu papier należy zastosować w aparacie elektrokardiograficznym?

Które polecenie SQL nie modyfikuje tabeli bazy danych?

W dokumentacji testera aparatury medycznej podano następujące informacje:

|

Fale mózgowe alfa, beta, gamma, delta i theta są rejestrowane w

Na rysunku przedstawiono badanie za pomocą

Jaka jest prędkość przesuwu prezentowanego elektrokardiogramu, jeżeli zmierzona częstotliwość rytmu serca wynosi 60 uderzeń na minutę?

W zabiegu jonoforezy leki są transportowane przez skórę do głębiej położonych warstw poprzez zastosowanie

Procesor GPU jest odpowiedzialny za wykonywanie operacji obliczeniowych w karcie

Promieniowanie IR jest wykorzystywane w

Membrana półprzepuszczalna jest podstawowym elementem

Urządzenie, którego dotyczy fragment podanej specyfikacji, jest przystosowane do

| ■ Architektura sieci LAN: | Wireless IEEE 802.11ac, Wireless IEEE 802.11a, Wireless IEEE 802.11b, Wireless IEEE 802.11g, Wireless IEEE 802.11n |

| ■ Dodatkowe informacje: | PoE, RJ-45 Serial |

| ■ Typ urządzenia: | Bezprzewodowy kontroler |

| ■ Typ złącza anteny zewnętrznej: | 3x3 MIMO |

Na zdjęciu przedstawiono

Wybierz narzędzie służące do zamocowania przedstawionej na rysunku końcówki kompresyjnej F na kablu koncentrycznym.

Prezentacja A, B, M jest charakterystyczna dla badania

Elementem sieci komputerowej w topologii gwiazdy, pozwalającym przyłączyć wiele urządzeń sieciowych, jest

Aby dodać nowe konto „rejestracja” w systemie Windows, należy wykorzystać polecenie